Pytanie 1

Jak wygląda kolejność przewodów w wtyczce RJ-45 zgodnie z normą TIA/EIA-568 dla zakończeń typu T568B?

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Jak wygląda kolejność przewodów w wtyczce RJ-45 zgodnie z normą TIA/EIA-568 dla zakończeń typu T568B?

Osoba planuje unowocześnić swój komputer poprzez zwiększenie pamięci RAM. Zainstalowana płyta główna ma specyfikacje przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |

Które z poniższych stwierdzeń na temat protokołu DHCP jest poprawne?

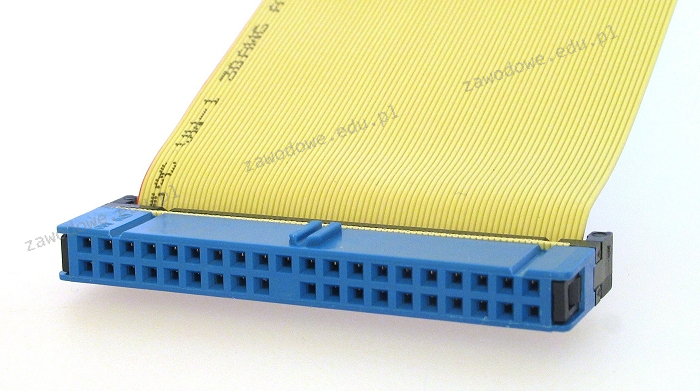

Na ilustracji przedstawiono taśmę (kabel) złącza

Jakie jest zadanie programu Wireshark?

Podłączona mysz bezprzewodowa sprawia, że kursor na ekranie nie porusza się płynnie i „skacze”. Co może być przyczyną tego problemu?

Podczas próby zapisania danych na karcie SD wyświetla się komunikat "usuń ochronę przed zapisem lub użyj innego dysku". Zwykle przyczyną tego komunikatu jest

Który z początkowych znaków w nazwie pliku w systemie Windows wskazuje na plik tymczasowy?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Zachowanie kopii często odwiedzanych witryn oraz zwiększenie ochrony przez filtrowanie pewnych treści witryn internetowych można osiągnąć dzięki

W jakim typie członkostwa w VLAN port może należeć do wielu sieci VLAN?

Protokół TCP (Transmission Control Protocol) funkcjonuje w trybie

Rysunek obrazuje zasadę działania drukarki

Jakie jest właściwe IP dla maski 255.255.255.0?

Atak na system komputerowy przeprowadzany jednocześnie z wielu maszyn w sieci, który polega na zablokowaniu działania tego systemu przez zajęcie wszystkich dostępnych zasobów, określany jest mianem

Wskaż usługę, którą należy skonfigurować na serwerze aby blokować ruch sieciowy?

Urządzenie przedstawione na rysunku

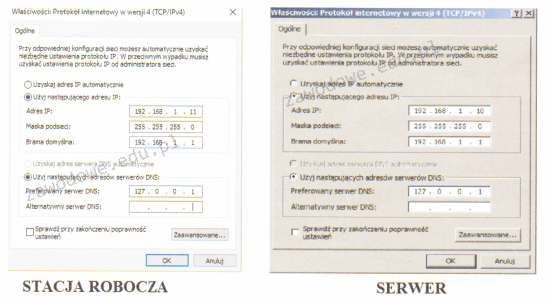

Na rysunku widać ustawienia protokołu TCP/IP serwera oraz komputera roboczego. Na serwerze działa rola serwera DNS. Wykonanie polecenia ping www.cke.edu.pl na serwerze zwraca wynik pozytywny, natomiast na stacji roboczej wynik jest negatywny. Co należy zmienić, aby usługa DNS na stacji pracowała poprawnie?

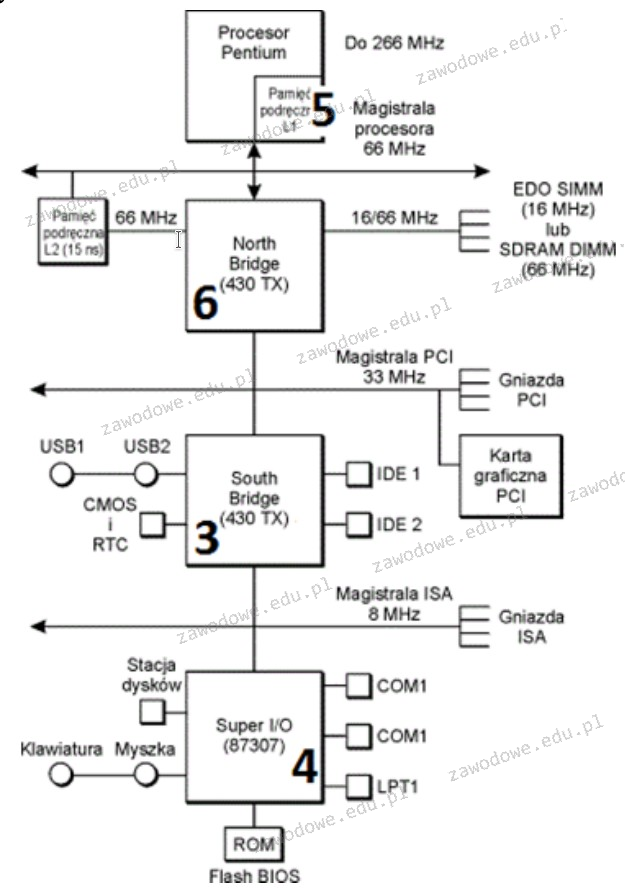

Część płyty głównej, która odpowiada za transmisję danych pomiędzy mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej, jest oznaczona na rysunku numerem

Substancją używaną w drukarkach 3D jest

Zarządzanie konfiguracją karty sieciowej w systemie Windows 7 realizuje polecenie

Poniżej zaprezentowano fragment pliku konfiguracyjnego serwera w systemie Linux. Jaką usługi dotyczy ten fragment?

option domain-name "meinheimnetz";

ddns-update-style none;

default-lease-time 14400;

subnet 192.168.1.0 netmask 255.255.255.0 {

range 192.168.1.10 192.168.1.20;

default-lease-time 14400;

max-lease-time 172800;

}Zanim zainstalujesz sterownik dla urządzenia peryferyjnego, system operacyjny Windows powinien weryfikować, czy sterownik ma ważny podpis

Jak określa się atak w sieci lokalnej, który polega na usiłowaniu podszycia się pod inną osobę?

Przedstawiony panel tylny płyty głównej jest wyposażony między innymi w interfejsy:

Zgodnie z normą Fast Ethernet 100Base-TX, maksymalna długość kabla miedzianego UTP kategorii 5e, który łączy bezpośrednio dwa urządzenia sieciowe, wynosi

Który z adresów IPv4 jest odpowiedni do ustawienia interfejsu serwera DNS zarejestrowanego w lokalnych domenach?

Jakie narzędzie w systemie Windows służy do przeglądania informacji dotyczących problemów z systemem?

Jak nazywa się magistrala, która w komputerze łączy procesor z kontrolerem pamięci i składa się z szyny adresowej, szyny danych oraz linii sterujących?

Z analizy danych przedstawionych w tabeli wynika, że efektywna częstotliwość pamięci DDR SDRAM wynosi 184 styki 64-bitowa magistrala danych Pojemność 1024 MB Przepustowość 3200 MB/s

Polecenie do zmiany adresu MAC karty sieciowej w systemie Linux to

Zainstalowanie gniazda typu keystone w serwerowej szafie jest możliwe w

Aby przeprowadzić instalację systemu operacyjnego z rodziny Windows na stacjach roboczych, konieczne jest dodanie na serwerze usług

Ile maksymalnie dysków twardych można bezpośrednio podłączyć do płyty głównej, której fragment specyfikacji jest przedstawiony w ramce?

|

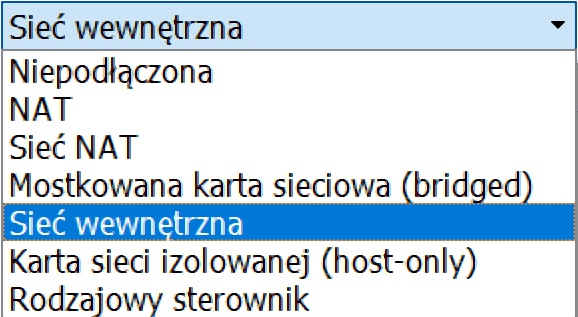

Na ilustracji przedstawiono opcje karty sieciowej w oprogramowaniu VirtualBox. Ustawienie na wartość sieć wewnętrzna, spowoduje, że

Liczbie 16 bitowej 0011110010101110 wyrażonej w systemie binarnym odpowiada w systemie szesnastkowym liczba

Narzędzia do dostosowywania oraz Unity Tweak Tool to aplikacje w systemie Linux przeznaczone do

Jednym z narzędzi zabezpieczających system przed oprogramowaniem, które bez wiedzy użytkownika pozyskuje i wysyła jego autorowi dane osobowe, numery kart płatniczych, informacje o adresach stron WWW odwiedzanych przez użytkownika, hasła i używane adresy mailowe, jest program

Podczas skanowania reprodukcji obrazu z magazynu, na skanie obrazu ukazały się regularne wzory, zwane morą. Jakiej funkcji skanera należy użyć, aby usunąć te wzory?

Jaki adres IPv6 jest stosowany jako adres link-local w procesie autokonfiguracji urządzeń?