Pytanie 1

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Wynik: 12/40 punktów (30,0%)

Wymagane minimum: 20 punktów (50%)

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Który z protokołów umożliwia terminalowe połączenie ze zdalnymi urządzeniami, zapewniając jednocześnie transfer danych w zaszyfrowanej formie?

Jaki rodzaj routingu jest najbardziej odpowiedni w dużych, szybko zmieniających się sieciach?

Jakie parametry otrzyma interfejs sieciowy eth0 po wykonaniu poniższych poleceń w systemie Linux?

Po dokonaniu eksportu klucza HKCU stworzona zostanie kopia rejestru zawierająca dane o konfiguracji

Jak określa się w systemie Windows profil użytkownika, który jest tworzony przy pierwszym logowaniu do komputera i zapisywany na lokalnym dysku twardym, a wszelkie jego modyfikacje dotyczą tylko tego konkretnego komputera?

W systemie Windows zastosowanie zaprezentowanego polecenia spowoduje chwilową modyfikację koloru

Microsoft Windows [Version 10.0.14393] (c) 2016 Microsoft Corporation. Wszelkie prawa zastrzeżone. C:\Users\ak>color 1

Przed rozpoczęciem instalacji sterownika dla urządzenia peryferyjnego system Windows powinien weryfikować, czy dany sterownik ma podpis

Błąd typu STOP Error (Blue Screen) w systemie Windows, który wiąże się z odniesieniem się systemu do niepoprawnych danych w pamięci RAM, to

Moduł Mini-GBiCSFP pełni funkcję

Jakie urządzenie pozwala na podłączenie kabla światłowodowego wykorzystywanego w okablowaniu pionowym sieci do przełącznika z jedynie gniazdami RJ45?

Usterka zaprezentowana na ilustracji, widoczna na monitorze, nie może być spowodowana przez

Poprzez polecenie dxdiag uruchomione w wierszu poleceń Windows można

Układy sekwencyjne stworzone z grupy przerzutników, zazwyczaj synchronicznych typu D, wykorzystywane do magazynowania danych, to

Jakim interfejsem można osiągnąć przesył danych o maksymalnej przepustowości 6Gb/s?

W systemie Linux komenda chown pozwala na

Który protokół z warstwy aplikacji reguluje przesyłanie wiadomości e-mail?

Jak nazywa się identyfikator, który musi być jednakowy, aby urządzenia sieciowe mogły współpracować w danej sieci bezprzewodowej?

Wskaź, które z poniższych stwierdzeń dotyczących zapory sieciowej jest nieprawdziwe?

Złocenie styków złącz HDMI ma na celu

Jakim poleceniem w systemie Linux można utworzyć nowych użytkowników?

Cienki klient (thin client) korzysta z protokołu

Co jest przyczyną wysokiego poziomu przesłuchu zdalnego w kablu?

Jakie polecenie w systemie Windows pozwala na wyświetlenie tabeli routingu hosta?

Do wymiany uszkodzonych kondensatorów w karcie graficznej potrzebne jest

W przypadku adresacji IPv6, zastosowanie podwójnego dwukropka służy do

Jakim protokołem posługujemy się do przesyłania dokumentów hipertekstowych?

Jaki sterownik drukarki jest uniwersalny dla różnych urządzeń oraz systemów operacyjnych i stanowi standard w branży poligraficznej?

Magistrala komunikacyjna PCI ver. 2.2 (Peripheral Component Interconnect) jest standardem magistrali, zgodnie z którym szyna danych ma maksymalną szerokość

Do jakiej grupy w systemie Windows Server 2008 powinien być przypisany użytkownik odpowiedzialny wyłącznie za archiwizację danych przechowywanych na serwerowym dysku?

Na komputerze z zainstalowanymi systemami operacyjnymi Windows i Linux, po przeprowadzeniu reinstalacji systemu Windows, drugi system przestaje się uruchamiać. Aby przywrócić możliwość uruchamiania systemu Linux oraz zachować dane i ustawienia w nim zgromadzone, co należy zrobić?

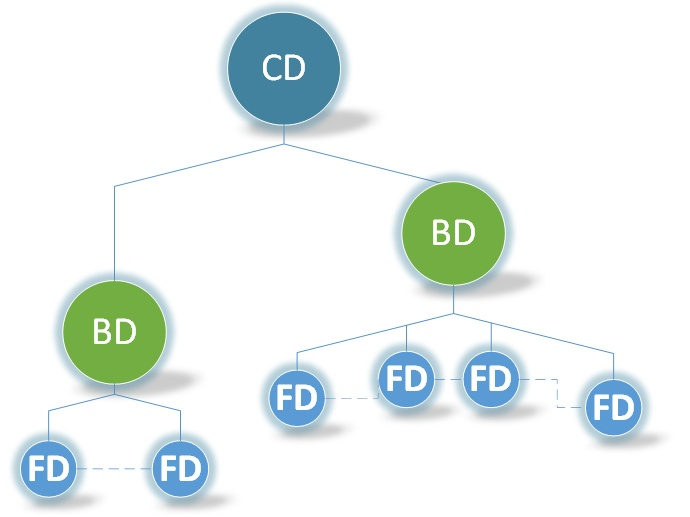

Przedstawiony schemat sieci kampusowej zawiera

Kabel typu skrętka, w którym każda para żył jest umieszczona w oddzielnym ekranie z folii, a wszystkie przewody znajdują się w jednym ekranie, ma oznaczenie

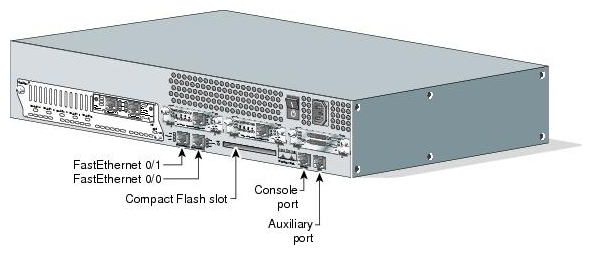

Urządzenie sieciowe, które widoczna jest na ilustracji, to

Jak sprawdzić, który z programów w systemie Windows generuje największe obciążenie dla procesora?

Aby usunąć konto użytkownika student w systemie operacyjnym Ubuntu, można skorzystać z komendy

Zgłoszona awaria ekranu laptopa może być wynikiem

Plik ma przypisane uprawnienia: rwxr-xr--. Jakie uprawnienia będzie miał plik po zastosowaniu polecenia chmod 745?

Najskuteczniejszym zabezpieczeniem sieci bezprzewodowej jest

Aby podczas prac montażowych zabezpieczyć szczególnie wrażliwe podzespoły elektroniczne komputera przed wyładowaniem elektrostatycznym, należy stosować