Pytanie 1

Aby połączyć projektor multimedialny z komputerem, nie można zastosować złącza

Wynik: 29/40 punktów (72,5%)

Wymagane minimum: 20 punktów (50%)

Aby połączyć projektor multimedialny z komputerem, nie można zastosować złącza

Jakie polecenie należy wydać, aby skonfigurować statyczny routing do sieci 192.168.10.0?

Którego polecenia należy użyć, aby w ruterze skonfigurować trasę statyczną dla adresu następnego skoku 192.168.1.1?

Na fotografii ukazana jest pamięć o 168 stykach

Na jakich nośnikach pamięci masowej jednym z najczęstszych powodów uszkodzeń jest zniszczenie powierzchni?

Który z poniższych protokołów nie jest wykorzystywany do konfiguracji wirtualnej sieci prywatnej?

Algorytm wykorzystywany do weryfikacji, czy ramka Ethernet jest wolna od błędów, to

Do kategorii oprogramowania określanego mianem malware (ang. malicious software) nie zalicza się oprogramowania typu

Symbole i oznaczenia znajdujące się na zamieszczonej tabliczce znamionowej podzespołu informują między innymi o tym, że produkt jest

Który z poniższych interfejsów powinien być wybrany do podłączenia dysku SSD do płyty głównej komputera stacjonarnego, aby uzyskać najwyższą szybkość zapisu oraz odczytu danych?

W oznaczeniu procesora INTEL CORE i7-4790 cyfra 4 oznacza

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakie polecenie w systemie Windows służy do monitorowania bieżących połączeń sieciowych?

Literowym symbolem P oznacza się

Prezentowany komunikat pochodzi z wykonania polecenia

Firma Dyn, której serwery DNS zostały zaatakowane, przyznała, że część tego ataku … miała miejsce z użyciem różnych urządzeń podłączonych do sieci. Ekosystem kamer, czujników i kontrolerów określany ogólnie jako 'Internet rzeczy' został wykorzystany przez cyberprzestępców jako botnet − sieć maszyn-zombie. Jakiego rodzaju atak jest opisany w tym cytacie?

W którym systemie operacyjnym może pojawić się komunikat podczas instalacji sterowników dla nowego urządzenia?

| System.......nie może zweryfikować wydawcy tego sterownika. Ten sterownik nie ma podpisu cyfrowego albo podpis nie został zweryfikowany przez urząd certyfikacji. Nie należy instalować tego sterownika, jeżeli nie pochodzi z oryginalnego dysku producenta lub od administratora systemu. |

Czym jest mapowanie dysków?

Program do odzyskiwania danych, stosowany w warunkach domowych, umożliwia przywrócenie danych z dysku twardego w sytuacji

Zamiana baterii jest jedną z czynności związanych z użytkowaniem

W komputerowych stacjach roboczych zainstalowane są karty sieciowe Ethernet 10/100/1000 z interfejsem RJ45. Jakie medium transmisyjne powinno być zastosowane do budowy sieci komputerowej, aby osiągnąć maksymalną przepustowość?

Do zrealizowania macierzy RAID 1 wymagane jest co najmniej

Podczas pracy komputera nastąpił samoczynny twardy reset. Przyczyną resetu najprawdopodobniej jest

Który z protokołów służy do weryfikacji poprawności połączenia pomiędzy dwoma hostami?

Jakie polecenie w systemie Linux pozwala na wyświetlenie informacji o bieżącej godzinie, czasie pracy systemu oraz liczbie użytkowników zalogowanych do systemu?

Komunikat "BIOS checksum error" pojawiający się w trakcie startu komputera zazwyczaj wskazuje na

Do ilu sieci należą komputery o adresach IP i maskach sieci przedstawionych w tabeli?

| Adres IPv4 | Maska |

|---|---|

| 10.120.16.10 | 255.255.0.0 |

| 10.120.18.16 | 255.255.0.0 |

| 10.110.16.18 | 255.255.255.0 |

| 10.110.16.14 | 255.255.255.0 |

| 10.130.16.12 | 255.255.255.0 |

Gniazdo LGA umieszczone na płycie głównej komputera stacjonarnego pozwala na zamontowanie procesora

Złącze IrDA służy do bezprzewodowej komunikacji i jest

Jaki będzie najniższy koszt zakupu kabla UTP, potrzebnego do okablowania kategorii 5e, aby połączyć panel krosowniczy z dwoma podwójnymi gniazdami natynkowymi 2 x RJ45, które są oddalone odpowiednio o 10 m i 20 m od panelu, jeśli cena 1 m kabla wynosi 1,20 zł?

Użytkownik systemu Linux, który pragnie usunąć konto innego użytkownika wraz z jego katalogiem domowym, powinien wykonać polecenie

Magistrala PCI-Express do przesyłania danych stosuje metodę komunikacyjną

Elementem, który umożliwia wymianę informacji pomiędzy procesorem a magistralą PCI-E, jest

W systemie Linux, żeby ustawić domyślny katalog domowy dla nowych użytkowników na katalog /users/home/new, konieczne jest użycie polecenia

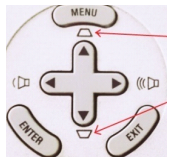

Na przedstawionej grafice wskazano strzałkami funkcje przycisków umieszczonych na obudowie projektora multimedialnego. Dzięki tym przyciskom można

Grupa, w której członkom można nadawać uprawnienia jedynie w obrębie tej samej domeny, co domena nadrzędna lokalnej grupy domeny, nosi nazwę grupa

Który z poniższych protokołów reprezentuje protokół warstwy aplikacji w modelu ISO/OSI?

Poprawność działania lokalnej sieci komputerowej po modernizacji powinna być potwierdzona

Nazwa licencji oprogramowania komputerowego, które jest dystrybuowane bezpłatnie, lecz z ograniczoną przez twórcę funkcjonalnością w porównaniu do pełnej, płatnej wersji, gdzie po upływie 30 dni zaczynają się wyświetlać reklamy oraz przypomnienia o konieczności rejestracji, to

Wypukłe kondensatory elektrolityczne w module zasilania monitora LCD mogą doprowadzić do uszkodzenia