Pytanie 1

Ile adresów można przypisać urządzeniom działającym w sieci o adresie IP 192.168.20.0/26?

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

Ile adresów można przypisać urządzeniom działającym w sieci o adresie IP 192.168.20.0/26?

Jakie narzędzie jest używane w systemie Windows do przywracania właściwych wersji plików systemowych?

Protokół, który pozwala na bezpieczną, zdalną obsługę serwera, to

Jakie urządzenie należy wykorzystać do zestawienia komputerów w sieci przewodowej o strukturze gwiazdy?

W systemie Linux polecenie chown służy do

Technologia opisana w systemach należących do rodziny Windows to

| Jest to technologia obsługująca automatyczną konfigurację komputera PC i wszystkich zainstalowanych w nim urządzeń. Umożliwia ona rozpoczęcie korzystania z nowego urządzenia (na przykład karty dźwiękowej lub modemu) natychmiast po jego zainstalowaniu bez konieczności przeprowadzania ręcznej jego konfiguracji. Technologia ta jest implementowana w warstwach sprzętowej i systemu operacyjnego, a także przy użyciu sterowników urządzeń i BIOS-u. |

Na zdjęciu widoczny jest

Serwer Apache to rodzaj

W systemie operacyjnym Linux, aby sprawdzić ilość dostępnego miejsca na dyskach, można użyć polecenia

W nowoczesnych ekranach dotykowych działanie ekranu jest zapewniane przez mechanizm, który wykrywa zmianę

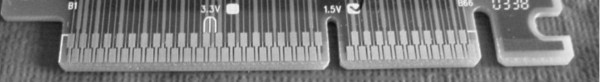

Na ilustracji przedstawiono fragment karty graficznej ze złączem

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Aby uzyskać uprawnienia administratora w systemie Linux, należy w terminalu wpisać polecenie

Protokół pakietów użytkownika, który zapewnia dostarczanie datagramów w trybie bezpołączeniowym, to

Recykling można zdefiniować jako

Aby zmierzyć tłumienie łącza światłowodowego w dwóch zakresach transmisyjnych 1310nm oraz 1550nm, powinno się zastosować

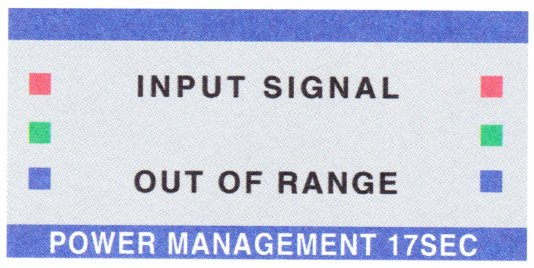

Gdy podłączono sprawny monitor do innego komputera, na ekranie pojawił się komunikat widoczny na rysunku. Co mogło spowodować ten komunikat?

O ile zwiększy się liczba dostępnych adresów IP w podsieci po zmianie maski z 255.255.255.240 (/28) na 255.255.255.224 (/27)?

Jaką postać ma liczba szesnastkowa: FFFF w systemie binarnym?

Dodatkowe właściwości wyniku operacji przeprowadzanej przez jednostkę arytmetyczno-logiczna ALU zawiera

Czy bęben światłoczuły znajduje zastosowanie w drukarkach?

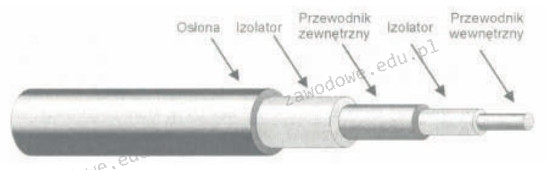

Na ilustracji przedstawiono przekrój kabla

Administrator systemu Linux wydał komendę mount /dev/sda2 /mnt/flash. Co to spowoduje?

Symbol zaprezentowany powyżej, używany w dokumentacji technicznej, wskazuje na

Do bezprzewodowego przesyłania danych pomiędzy dwoma urządzeniami, z wykorzystaniem fal radiowych w paśmie ISM 2,4 GHz, służy interfejs

Jaką rolę pełni serwer FTP?

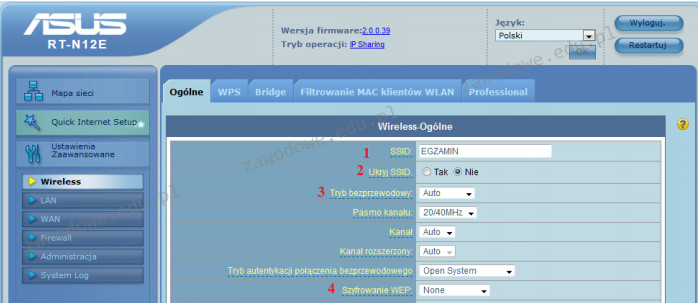

Aby zatuszować identyfikator sieci bezprzewodowej, należy zmodyfikować jego ustawienia w ruterze w polu oznaczonym numerem

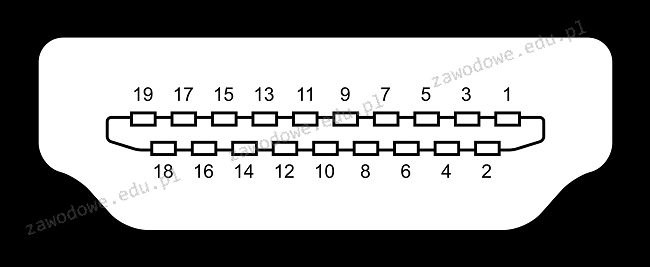

Zilustrowany na obrazku interfejs to

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się operacje usuwania starych plików oraz dodawania nowych, staje się:

Jakie są nazwy licencji, które umożliwiają korzystanie z programu w pełnym zakresie, ale ograniczają liczbę uruchomień do określonej, niewielkiej ilości od momentu instalacji?

Jaką topologię fizyczną charakteryzuje zapewnienie nadmiarowych połączeń między urządzeniami sieciowymi?

Która edycja systemu operacyjnego Windows Server 2008 charakteryzuje się najmniej rozbudowanym interfejsem graficznym?

Jakie będą całkowite koszty materiałów potrzebnych do stworzenia sieci lokalnej dla 6 komputerów, jeśli do budowy sieci wymagane jest 100 m kabla UTP kat. 5e oraz 20 m kanału instalacyjnego? Ceny komponentów sieci przedstawiono w tabeli.

| Elementy sieci | j.m. | cena brutto |

|---|---|---|

| Kabel UTP kat. 5e | m | 1,00 zł |

| Kanał instalacyjny | m | 8,00 zł |

| Gniazdo komputerowe | szt. | 5,00 zł |

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?

Narzędziem wykorzystywanym do diagnozowania połączeń między komputerami w systemie Windows jest

Skrypt o nazwie wykonaj w systemie Linux zawiera: echo -n "To jest pewien parametr " echo $? Wykonanie poleceń znajdujących się w pliku spowoduje wyświetlenie podanego tekstu oraz

Po wykonaniu eksportu klucza HKCU zostanie zapisana kopia rejestru zawierająca informacje, dotyczące konfiguracji

Na ilustracji przedstawiono część procesu komunikacji z serwerem, która została przechwycona przez aplikację Wireshark. Jaki to serwer?

Discover - Transaction ID 0x6a16b7a5 Offer - Transaction ID 0x6a16b7a5 Request - Transaction ID 0x6a16b7a5 ACK - Transaction ID 0x6a16b7a5

Która z usług umożliwia centralne zarządzanie identyfikacjami, uprawnieniami oraz zasobami w sieci?

Jakie informacje można uzyskać na temat konstrukcji skrętki S/FTP?