Pytanie 1

Urządzenie trwale zainstalowane u abonenta, które zawiera zakończenie poziomego okablowania strukturalnego, to

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Urządzenie trwale zainstalowane u abonenta, które zawiera zakończenie poziomego okablowania strukturalnego, to

Użytkownik systemu Windows doświadcza komunikatów o niewystarczającej pamięci wirtualnej. Jak można rozwiązać ten problem?

Która z poniższych form zapisu liczby 77(8) jest nieprawidłowa?

Jaką normę stosuje się w przypadku okablowania strukturalnego w sieciach komputerowych?

Jakie jest ciało odpowiedzialne za publikację dokumentów RFC (Request For Comments), które określają zasady rozwoju Internetu?

Jakie czynności nie są realizowane przez system operacyjny?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Przed dokonaniem zmian w rejestrze systemu Windows, w celu zapewnienia bezpieczeństwa pracy, należy najpierw

Jakim portem domyślnie odbywa się przesyłanie poleceń (command) serwera FTP?

Złącze SC stanowi standard w cablach

Aby przekształcić zeskanowany obraz w tekst, należy użyć oprogramowania, które wykorzystuje metody

Określenie najbardziej efektywnej trasy dla połączenia w sieci to

Nie jest możliwe tworzenie okresowych kopii zapasowych z dysku serwera na przenośnych nośnikach typu

Czym jest MFT w systemie plików NTFS?

Po zainstalowaniu Systemu Windows 7 dokonano zmiany w BIOS-ie komputera, skonfigurowano dysk SATA z AHCI na IDE. Po ponownym uruchomieniu systemu komputer będzie

Która z poniższych opcji nie jest wykorzystywana do zdalnego zarządzania stacjami roboczymi?

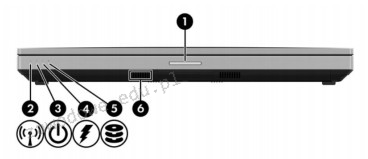

Na ilustracji zaprezentowane jest oznaczenie sygnalizacji świetlnej w dokumentacji technicznej laptopa. Podaj numer kontrolki, która świeci się w czasie ładowania akumulatora?

Jak nazywa się program, który pozwala na interakcję pomiędzy kartą sieciową a systemem operacyjnym?

Jaki element sieci SIP określamy jako telefon IP?

Sieć 192.200.100.0 z maską 255.255.255.128 podzielono na 4 równe podsieci. Ile maksymalnie adresów hostów jest dostępnych w każdej podsieci?

Do instalacji i usuwania oprogramowania w systemie Ubuntu wykorzystywany jest menedżer

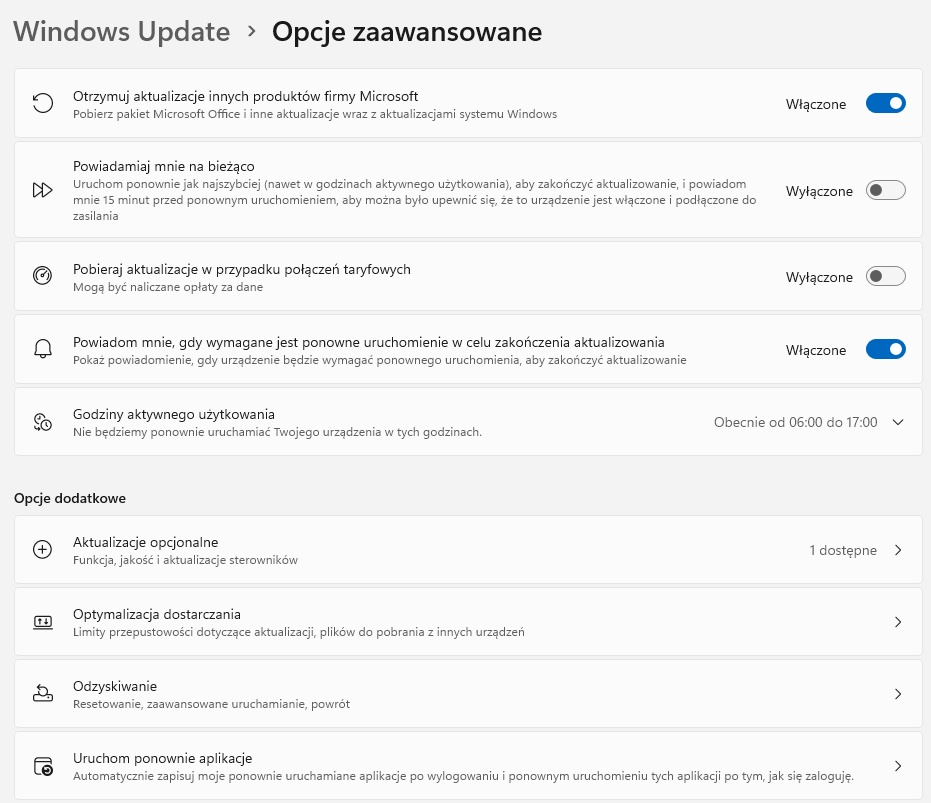

Biorąc pod uwagę konfigurację wykonywaną na ilustracji, administrator po zainstalowaniu systemu operacyjnego uznał za istotne, aby

Transmisję danych w sposób bezprzewodowy umożliwia standard, który zawiera interfejs

Jaką topologię fizyczną stosuje się w sieciach z topologią logiczną Token Ring?

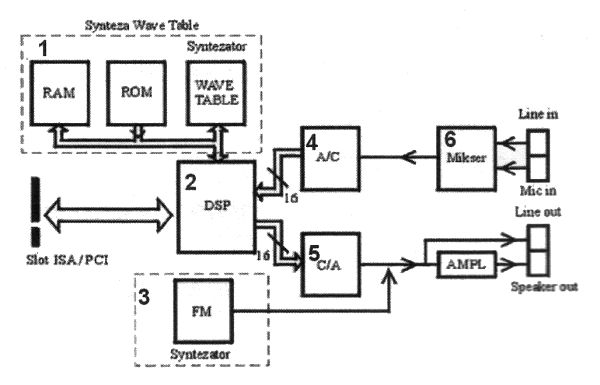

Na diagramie blokowym karty dźwiękowej komponent odpowiedzialny za konwersję sygnału analogowego na cyfrowy jest oznaczony numerem

Sekwencja 172.16.0.1, która reprezentuje adres IP komputera, jest zapisana w systemie

W których nośnikach pamięci masowej jedną z najczęstszych przyczyn uszkodzeń jest uszkodzenie powierzchni?

Gdy komputer się uruchamia, na ekranie wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Która z usług umożliwia rejestrowanie oraz identyfikowanie nazw NetBIOS jako adresów IP wykorzystywanych w sieci?

Administrator pragnie udostępnić w sieci folder C:instrukcje trzem użytkownikom z grupy Serwisanci. Jakie rozwiązanie powinien wybrać?

Aby zrealizować iloczyn logiczny z uwzględnieniem negacji, jaki funktor powinno się zastosować?

Aby stworzyć nowego użytkownika o nazwie egzamin z hasłem qwerty w systemie Windows XP, należy wykorzystać polecenie

W dokumentacji dotyczącej karty dźwiękowej można znaleźć informację: częstotliwość próbkowania 22 kHz oraz rozdzielczość próbkowania 16 bitów. Jaka będzie przybliżona objętość pliku audio z 10-sekundowym nagraniem mono (jednokanałowym)?

Kable łączące dystrybucyjne punkty kondygnacyjne z głównym punktem dystrybucji są określane jako

Fragment pliku httpd.conf serwera Apache przedstawia się jak na diagramie. W celu zweryfikowania prawidłowego funkcjonowania strony WWW na serwerze, należy wprowadzić w przeglądarkę

| Listen 8012 |

| Server Name localhost:8012 |

Liczba 10101110110(2) w systemie szesnastkowym przedstawia się jako

Serwer, który realizuje żądania w protokole komunikacyjnym HTTP, to serwer

Na wydrukach uzyskanych z drukarki laserowej można zauważyć pasma wzdłużne oraz powtarzające się defekty. Jedną z możliwych przyczyn niskiej jakości druku jest wada

Litera S w protokole FTPS oznacza zabezpieczenie danych podczas ich przesyłania poprzez

Zamieszczone atrybuty opisują rodzaj pamięci

| Maksymalne taktowanie | 1600 MHz |

| Przepustowość | PC12800 1600MHz |

| Opóźnienie | Cycle Latency CL 9,0 |

| Korekcja | Nie |

| Dual/Quad | Dual Channel |

| Radiator | Tak |