Pytanie 1

Analiza tłumienia w kablowym systemie przesyłowym umożliwia ustalenie

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

Analiza tłumienia w kablowym systemie przesyłowym umożliwia ustalenie

W specyfikacji technicznej płyty głównej znajduje się zapis Supports up to Athlon XP 3000+ processor. Co to oznacza w kontekście obsługi procesorów przez tę płytę główną?

Podaj standard interfejsu wykorzystywanego do przewodowego łączenia dwóch urządzeń.

Do ilu sieci należą komputery o podanych w tabeli adresach IP i standardowej masce sieci?

| Komputer | Adres IP |

|---|---|

| Komputer 1 | 172.16.15.5 |

| Komputer 2 | 172.18.15.6 |

| Komputer 3 | 172.18.16.7 |

| Komputer 4 | 172.20.16.8 |

| Komputer 5 | 172.20.16.9 |

| Komputer 6 | 172.21.15.10 |

Komputer ma podłączoną mysz bezprzewodową, a kursor podczas pracy nie porusza się płynnie, „skacze” po ekranie. Przyczyną usterki urządzenia może być

Aby zapobiec uszkodzeniu sprzętu podczas modernizacji laptopa, która obejmuje wymianę modułów pamięci RAM, należy

Wskaź zestaw do diagnostyki logicznych układów elektronicznych umiejscowionych na płycie głównej komputera, który nie reaguje na próby uruchomienia zasilania?

Wartość sumy liczb binarnych 1010 i 111 zapisana w systemie dziesiętnym to

Aby zidentyfikować, który program najbardziej obciąża CPU w systemie Windows, należy otworzyć program

Aby zapewnić największe bezpieczeństwo danych przy wykorzystaniu dokładnie 3 dysków, powinny one być zapisywane w macierzy dyskowej

Obudowa oraz wyświetlacz drukarki fotograficznej są bardzo zabrudzone. W celu ich oczyszczenia, należy zastosować

Które urządzenie może zostać wykorzystane do rutowania ruchu sieciowego między sieciami VLAN?

Jakie urządzenie ilustruje ten rysunek?

Jakie jest adres rozgłoszeniowy w podsieci o adresie IPv4 192.168.160.0/21?

Standard zwany IEEE 802.11, używany w lokalnych sieciach komputerowych, określa typ sieci:

Zaprezentowane właściwości karty sieciowej sugerują, że karta

| Kod Producenta | WN-370USB |

| Interfejs | USB |

| Zgodność ze standardem | IEEE 802.11 b/g/n |

| Ilość wyjść | 1 szt. |

| Zabezpieczenia | WEP 64/128, WPA, WPA2 |

| Wymiary | 49(L) x 26(W) x 10(H) mm |

Adres IP (ang. Internet Protocol Address) to

Wskaż efekt działania przedstawionego polecenia.

net user Test /expires:12/09/20

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Które zdanie opisujące domenę Windows jest prawdziwe?

Organizacja zajmująca się normalizacją na świecie, która stworzyła 7-warstwowy Model Referencyjny Otwartej Architektury Systemowej, to

Medium transmisyjne oznaczone symbolem S/FTP wskazuje na skrętkę

Protokół SNMP (Simple Network Management Protocol) jest wykorzystywany do

Okablowanie pionowe w systemie strukturalnym łączy się

Jaką czynność można wykonać podczas konfiguracji przełącznika CISCO w interfejsie CLI, bez przechodzenia do trybu uprzywilejowanego, na poziomie dostępu widocznym w powyższej ramce?

W systemie Linux komenda usermod -s umożliwia dla danego użytkownika

Administrator dostrzegł, że w sieci LAN występuje znaczna ilość kolizji. Jakie urządzenie powinien zainstalować, aby podzielić sieć lokalną na mniejsze domeny kolizji?

W tablecie graficznym bez wyświetlacza pióro nie ustala położenia kursora ekranowego, można jedynie korzystać z jego końcówki do przesuwania kursora ekranowego oraz klikania. Wskaż możliwą przyczynę nieprawidłowej pracy urządzenia.

Co się stanie, jeśli w systemie operacyjnym komputera zainstalowany zostanie program określany jako Trojan?

Ustawienie rutingu statycznego na ruterze polega na

Najczęstszym powodem, dla którego toner rozmazuje się na wydrukach z drukarki laserowej, jest

Jak nazywa się licencja w systemie Windows Server, która pozwala użytkownikom komputerów stacjonarnych na korzystanie z usług serwera?

Posiadacz notebooka pragnie zainstalować w nim dodatkowy dysk twardy. Urządzenie ma jedynie jedną zatokę na HDD. Możliwością rozwiązania tego wyzwania może być użycie dysku z interfejsem

Aby skonfigurować usługę rutingu w systemie Windows Serwer, należy zainstalować rolę

Wykonanie polecenia net use Z:192.168.20.2data /delete spowoduje?

Aby odzyskać dane ze sformatowanego dysku twardego, należy wykorzystać program

Który standard sieci lokalnej określa dostęp do medium w oparciu o token (żeton)?

Czym jest układ RAMDAC?

Który z protokołów przesyła datagramy użytkownika BEZ GWARANCJI ich dostarczenia?

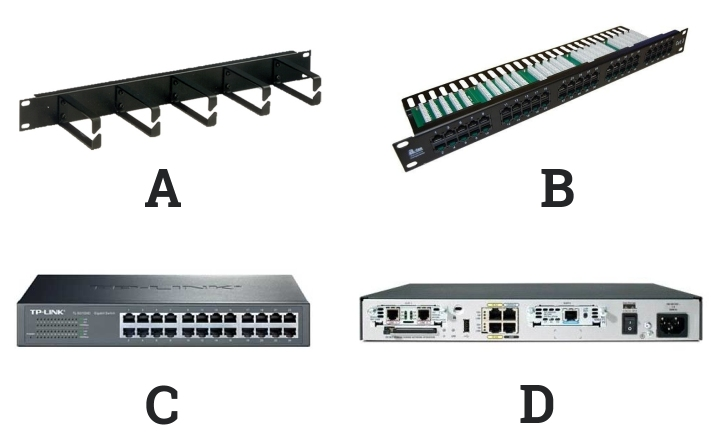

Na którym schemacie znajduje się panel krosowniczy?