Pytanie 1

Do wykonywania spawów włókien światłowodowych nie jest konieczne:

Wynik: 36/40 punktów (90,0%)

Wymagane minimum: 20 punktów (50%)

Do wykonywania spawów włókien światłowodowych nie jest konieczne:

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Gdzie w systemie Linux umieszczane są pliki specjalne urządzeń, które są tworzone podczas instalacji sterowników?

W systemie Linux dane dotyczące okresu ważności hasła są przechowywane w pliku

Jakie narzędzie jest używane do zakończenia skrętki wtykiem 8P8C?

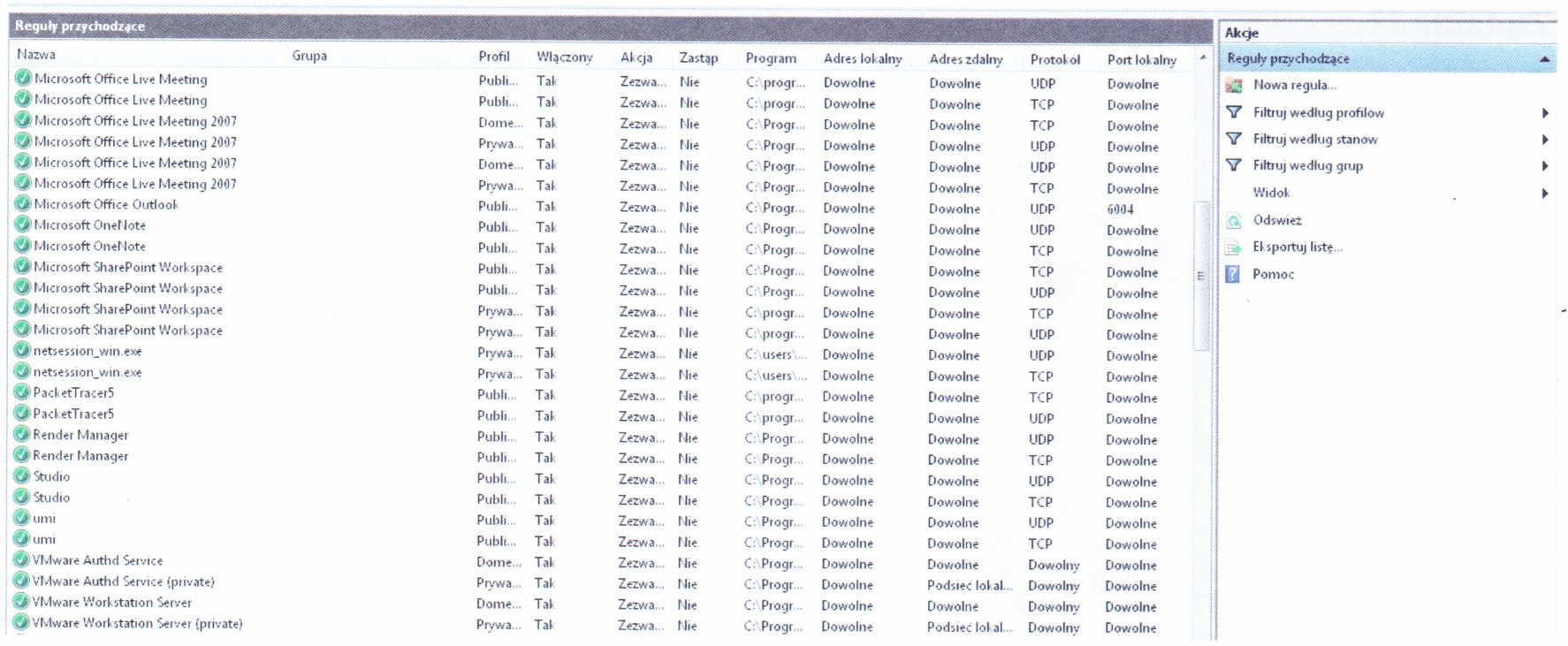

Pokazany zrzut ekranu dotyczy programu

Umowa, na mocy której użytkownik ma między innymi wgląd do kodu źródłowego oprogramowania w celu jego analizy oraz udoskonalania, to licencja

Które stwierdzenie opisuje profil tymczasowy użytkownika?

Z jakiej puli adresowej usługa APIPA przypisuje adres IP dla komputera z systemem Windows, jeśli w sieci nie funkcjonuje serwer DHCP?

Które z metod szyfrowania wykorzystywanych w sieciach bezprzewodowych jest najsłabiej zabezpieczone przed łamaniem haseł?

W jakiej warstwie modelu ISO/OSI wykorzystywane są adresy logiczne?

Podstawowym celem użycia przełącznika /renew w poleceniu ipconfig w systemie Windows jest

Która z grup w systemie Windows Server ma najniższe uprawnienia?

Wykonanie polecenia tar -xf dane.tar w systemie Linux spowoduje

Która karta graficzna nie będzie kompatybilna z monitorem, który posiada złącza pokazane na zdjęciu, przy założeniu, że do podłączenia monitora nie użyjemy adaptera?

Rejestr procesora, znany jako licznik rozkazów, przechowuje

Która topologia fizyczna umożliwia nadmiarowe połączenia pomiędzy urządzeniami w sieci?

Wydanie komendy chmod 400 nazwa_pliku w systemie Linux spowoduje, że właściciel pliku

Wskaż komponent, który reguluje wartość napięcia pochodzącego z sieci elektrycznej, wykorzystując transformator do przeniesienia energii między dwoma obwodami elektrycznymi z zastosowaniem zjawiska indukcji magnetycznej?

Aby zwiększyć wydajność komputera, można zainstalować procesor obsługujący technologię Hyper-Threading, która pozwala na

Element płyty głównej, który jest odpowiedzialny za wymianę danych między procesorem a innymi komponentami płyty, to

Aby podczas prac montażowych zabezpieczyć szczególnie wrażliwe podzespoły elektroniczne komputera przed wyładowaniem elektrostatycznym, należy stosować

W systemie Windows, domyślne konto administratora po jego dezaktywowaniu oraz ponownym uruchomieniu komputera

Aby telefon VoIP działał poprawnie, należy skonfigurować adres

Na rysunkach technicznych dotyczących instalacji sieci komputerowej oraz dedykowanej instalacji elektrycznej, symbolem pokazanym na rysunku oznaczane jest gniazdo

Na komputerze z zainstalowanymi systemami operacyjnymi Windows i Linux, po przeprowadzeniu reinstalacji systemu Windows, drugi system przestaje się uruchamiać. Aby przywrócić możliwość uruchamiania systemu Linux oraz zachować dane i ustawienia w nim zgromadzone, co należy zrobić?

Zastosowanie której zasady zwiększy bezpieczeństwo podczas korzystania z portali społecznościowych?

Jaki akronim oznacza wydajność sieci oraz usługi, które mają na celu między innymi priorytetyzację przesyłanych pakietów?

Który z adresów protokołu IP w wersji 4 jest poprawny pod względem struktury?

Złocenie styków złącz HDMI ma na celu

Komputer zarejestrowany w domenie Active Directory nie ma możliwości połączenia się z kontrolerem domeny, na którym znajduje się profil użytkownika. Jaki rodzaj profilu użytkownika zostanie utworzony na tym urządzeniu?

Część programu antywirusowego działająca w tle jako kluczowy element zabezpieczeń, mająca na celu nieustanne monitorowanie ochrony systemu komputerowego, to

Zgodnie ze specyfikacją JEDEC typowe napięcie zasilania modułów niskonapięciowych pamięci RAM DDR3L wynosi

Według specyfikacji JEDEC standardowe napięcie zasilania modułów RAM DDR3L o niskim napięciu wynosi

Interfejs SATA 2 (3Gb/s) oferuje prędkość transferu

Zgodnie z przedstawionymi zaleceniami dla drukarki atramentowej, kolorowe dokumenty powinny być drukowane przynajmniej

„Czyszczenie głowicy drukarki …. ….. W tym przypadku najskuteczniejszym rozwiązaniem jest wyczyszczenie głowicy drukarki z zaschniętego tuszu. Z reguły wystarcza przetarcie głównego źródła problemu wilgotnym ręcznikiem. Jeżeli to nie pomoże należy zassać tusz do dysz, co pozwoli usunąć z nich powietrze. ….. Kiedy również i to nie pomoże należy przejść do ręcznego czyszczenia głowicy. Drukarka….. powinna być wyłączana na noc, ponieważ po każdym włączeniu przeprowadzane są mini cykle czyszczenia. Warto również pamiętać o wydrukowaniu przynajmniej raz w tygodniu kolorowego dokumentu, dzięki czemu zminimalizujemy prawdopodobieństwo zaschnięcia tuszu." Fragment instrukcji czyszczenia drukarki |

Po zainstalowaniu Systemu Windows 7 dokonano zmiany w BIOS-ie komputera, skonfigurowano dysk SATA z AHCI na IDE. Po ponownym uruchomieniu systemu komputer będzie

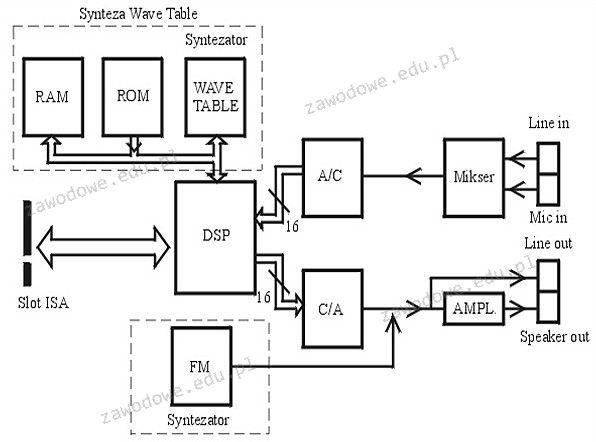

Na ilustracji zaprezentowano schemat działania

Pliki specjalne urządzeń, tworzone podczas instalacji sterowników w systemie Linux, są zapisywane w katalogu

Przerywając działalność na komputerze, możemy szybko wrócić do pracy, wybierając w systemie Windows opcję: