Pytanie 1

Komputer stracił łączność z siecią. Jakie działanie powinno być podjęte w pierwszej kolejności, aby naprawić problem?

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Komputer stracił łączność z siecią. Jakie działanie powinno być podjęte w pierwszej kolejności, aby naprawić problem?

W systemach Windows XP Pro/Windows Vista Business/Windows 7 Pro/Windows 8 Pro, funkcją zapewniającą ochronę danych dla użytkowników dzielących ten sam komputer, których informacje mogą być wykorzystywane wyłącznie przez nich, jest

Ile par kabli jest używanych w standardzie 100Base-TX do obustronnej transmisji danych?

Jakie są korzyści płynące z użycia systemu plików NTFS?

Która z usług umożliwia centralne zarządzanie identyfikacjami, uprawnieniami oraz zasobami w sieci?

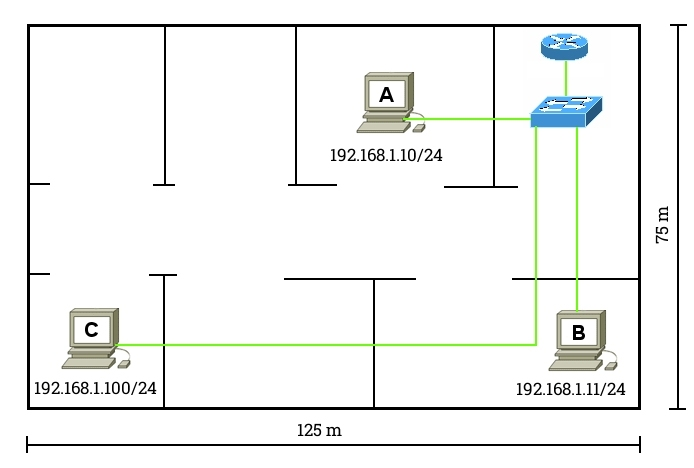

Na schemacie pokazano sieć LAN wykorzystującą okablowanie kategorii 6. Stacja robocza C nie może nawiązać połączenia z siecią. Jaki problem warstwy fizycznej może być przyczyną braku komunikacji?

Po zainstalowaniu aplikacji VNC, używanej do obserwacji pulpitu konkretnego komputera, oprócz numeru portu należy wskazać jego

Na ilustracji ukazano złącze zasilające

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie jest odpowiednik maski 255.255.252.0 w postaci prefiksu?

Program typu recovery, w warunkach domowych, pozwala na odzyskanie danych z dysku twardego w przypadku

Jakie polecenie pozwala na uzyskanie informacji o bieżących połączeniach TCP oraz o portach źródłowych i docelowych?

Atak informatyczny, który polega na wyłudzaniu wrażliwych danych osobowych poprzez udawanie zaufanej osoby lub instytucji, nazywamy

Przedstawione narzędzie podczas naprawy zestawu komputerowego przeznaczone jest do

W jakim typie członkostwa w VLAN port może należeć do wielu sieci VLAN?

Jaki protokół stosują komputery, aby informować router o zamiarze dołączenia lub opuszczenia konkretnej grupy rozgłoszeniowej?

Znak przedstawiony na ilustracji, zgodny z normą Energy Star, wskazuje na urządzenie

Serwer WWW o otwartym kodzie źródłowym, który działa na różnych systemach operacyjnych, to

Symbol umieszczony na obudowie komputera stacjonarnego informuje o zagrożeniu przed

W systemie Linux, polecenie usermod -s dla danego użytkownika umożliwia

Jaki poziom macierzy RAID umożliwia równoległe zapisywanie danych na wielu dyskach działających jako jedno urządzenie?

Narzędziem wykorzystywanym do diagnozowania połączeń między komputerami w systemie Windows jest

Medium transmisyjne oznaczone symbolem S/FTP to skrętka

Metoda przesyłania danych między urządzeniem CD/DVD a pamięcią komputera w trybie bezpośredniego dostępu do pamięci to

Najwyższą prędkość przesyłania danych w sieci bezprzewodowej można osiągnąć używając urządzeń o standardzie

Administrator sieci LAN dostrzegł przełączenie w tryb awaryjny urządzenia UPS. To oznacza, że wystąpiła awaria systemu

Urządzenie trwale zainstalowane u abonenta, które zawiera zakończenie poziomego okablowania strukturalnego, to

ACPI jest skrótem oznaczającym

Aby podczas prac montażowych zabezpieczyć szczególnie wrażliwe podzespoły elektroniczne komputera przed wyładowaniem elektrostatycznym, należy stosować

Każdy następny router IP na ścieżce pakietu

Zgodnie z zamieszczonym cennikiem, średni koszt wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

W systemie Windows, domyślne konto administratora po jego dezaktywowaniu oraz ponownym uruchomieniu komputera

Udostępniono w sieci lokalnej jako udział specjalny folder o nazwie egzamin znajdujący się na komputerze o nazwie SERWER_2 w katalogu głównym dysku C:. Jak powinna wyglądać ścieżka dostępu do katalogu egzamin, w którym przechowywany jest folder macierzysty dla konta użytkownika o określonym loginie?

Laptopy zazwyczaj są wyposażone w bezprzewodowe sieci LAN. Ograniczenia ich stosowania dotyczą emisji fal radiowych, które mogą zakłócać działanie innych, istotnych dla bezpieczeństwa, urządzeń?

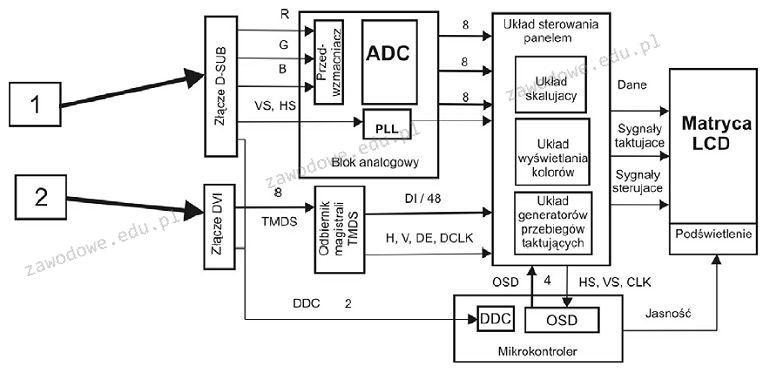

Które z połączeń zaznaczonych strzałkami na diagramie monitora stanowi wejście cyfrowe?

Przyczyną niekontrolowanego wypełnienia przestrzeni na dysku może być

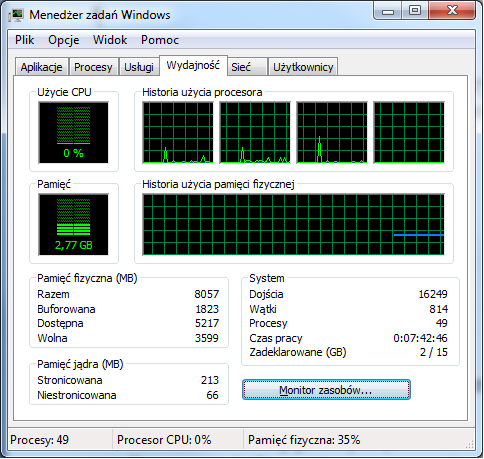

W systemie Windows do uruchomienia przedstawionego narzędzia należy użyć polecenia

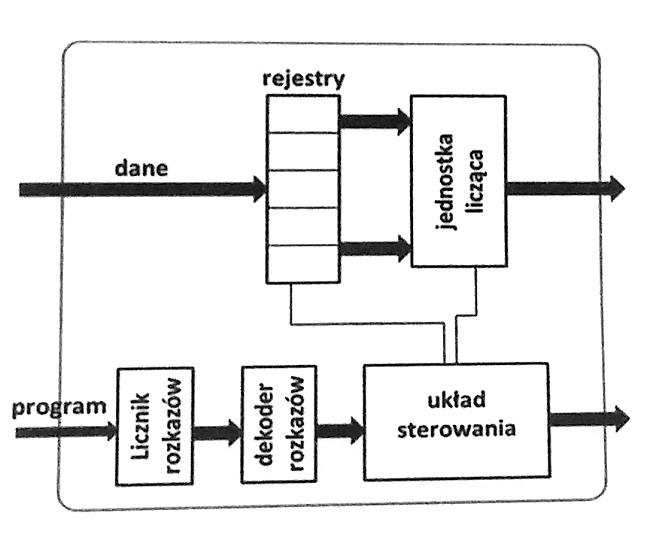

Rejestry przedstawione na diagramie procesora mają zadanie

W systemie Linux plik posiada uprawnienia ustawione na 541. Właściciel ma możliwość pliku

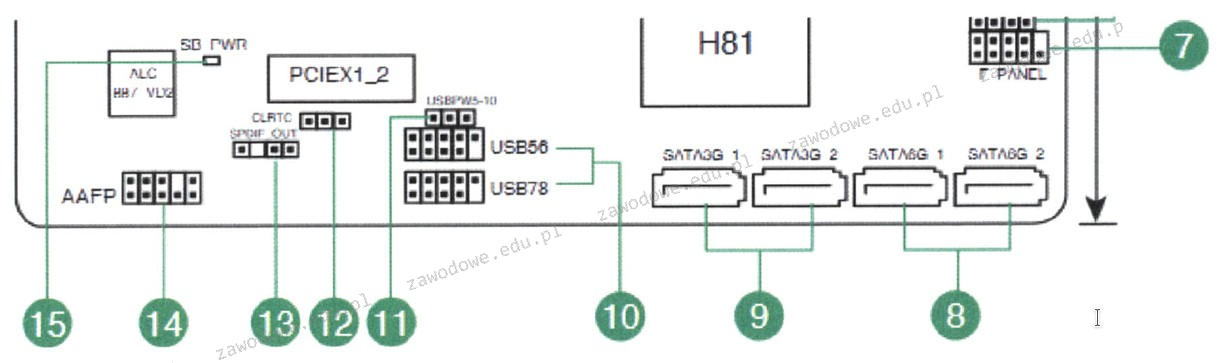

Na diagramie płyty głównej, który znajduje się w dokumentacji laptopa, złącza oznaczone numerami 8 i 9 to