Pytanie 1

Zasady filtrowania ruchu w sieci przez firewall określane są w formie

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Zasady filtrowania ruchu w sieci przez firewall określane są w formie

Program wykorzystywany w wierszu poleceń systemu Windows do kompresji i dekompresji plików oraz katalogów to

Do zarządzania przydziałami przestrzeni dyskowej w systemach Windows 7 oraz Windows 8 wykorzystywane jest narzędzie

Jakim protokołem połączeniowym w warstwie transportowej, który zapewnia niezawodność dostarczania pakietów, jest protokół

W pierwszym oktecie adresów IPv4 klasy B znajdują się liczby mieszczące się w przedziale

Jakie są skutki działania poniższego polecenia ```netsh advfirewall firewall add rule name="Open" dir=in action=deny protocol=TCP localport=53```?

W dokumentacji technicznej głośnika komputerowego oznaczenie "10 W" dotyczy jego

Zamontowany w notebooku trackpoint jest urządzeniem wejściowym reagującym na

Standard magistrali komunikacyjnej PCI w wersji 2.2 (Peripheral Component Interconnect) definiuje maksymalną szerokość szyny danych na

Na ilustracji złącze monitora, które zostało zaznaczone czerwoną ramką, będzie współdziałać z płytą główną posiadającą interfejs

Po włączeniu komputera na ekranie wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Możliwą przyczyną tego może być

Jaki protokół posługuje się portami 20 oraz 21?

Serwis serwerowy, który pozwala na udostępnianie usług drukowania w systemie Linux oraz plików dla stacji roboczych Windows, to

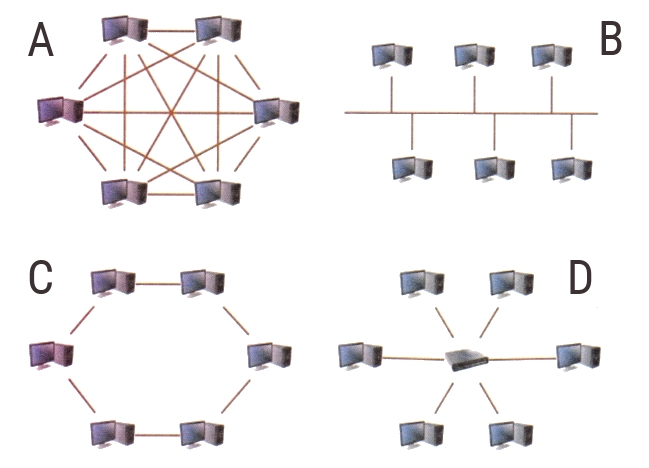

Która z przedstawionych na rysunkach topologii jest topologią siatkową?

Urządzenie pokazane na ilustracji to

Jak nazywa się urządzenie wskazujące, które współpracuje z monitorami CRT i ma końcówkę z elementem światłoczułym, a jego dotknięcie ekranu monitora skutkuje przesłaniem sygnału do komputera, co umożliwia lokalizację kursora?

Błąd typu STOP w systemie Windows (Blue Screen), który występuje w momencie, gdy system odwołuje się do niepoprawnych danych w pamięci RAM, to

Jak przywrócić stan rejestru systemowego w edytorze Regedit, wykorzystując wcześniej utworzoną kopię zapasową?

Adres projektowanej sieci należy do klasy C. Sieć została podzielona na 4 podsieci, z 62 urządzeniami w każdej z nich. Która z poniżej wymienionych masek jest adekwatna do tego zadania?

Materiałem eksploatacyjnym stosowanym w drukarkach tekstylnych jest

Narzędziem wiersza poleceń w systemie Windows, umożliwiającym zamianę tablicy partycji GPT na MBR, jest program

Ikona z wykrzyknikiem, którą widać na ilustracji, pojawiająca się przy nazwie urządzenia w Menedżerze urządzeń, wskazuje, że to urządzenie

Który z parametrów czasowych w pamięci RAM określany jest jako czas dostępu?

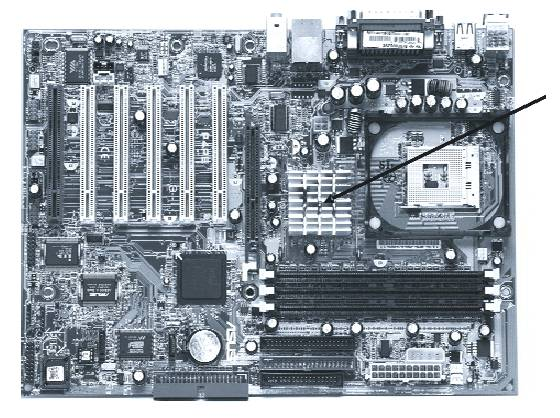

Na ilustracji pokazano płytę główną komputera. Strzałką wskazano

W jakiej topologii sieci komputerowej każdy węzeł ma bezpośrednie połączenie z każdym innym węzłem?

Aby skonfigurować usługę rutingu w systemie Windows Serwer, należy zainstalować rolę

Podaj standard interfejsu wykorzystywanego do przewodowego łączenia dwóch urządzeń.

Aby stworzyć bezpieczny wirtualny tunel pomiędzy dwoma komputerami korzystającymi z Internetu, należy użyć technologii

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

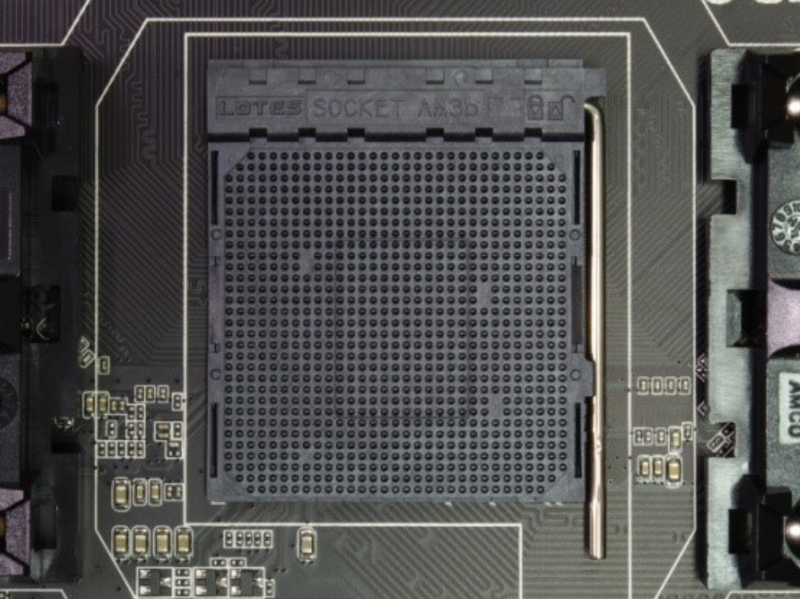

Na płycie głównej wyposażonej w gniazdo przedstawione na zdjęciu można zainstalować procesor

Wymogi działalności przedsiębiorstwa nakładają konieczność używania systemów plików, które zapewniają wysoki poziom zabezpieczeń oraz umożliwiają szyfrowanie informacji. W związku z tym należy wybrać system operacyjny Windows

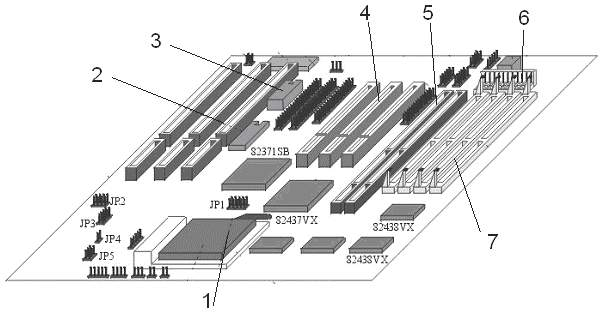

Na schemacie płyty głównej port PCI oznaczony jest numerem

W technologii Ethernet, protokół CSMA/CD do dostępu do medium działa na zasadzie

Jakie jest właściwe IP dla maski 255.255.255.0?

Które urządzenie może zostać wykorzystane do rutowania ruchu sieciowego między sieciami VLAN?

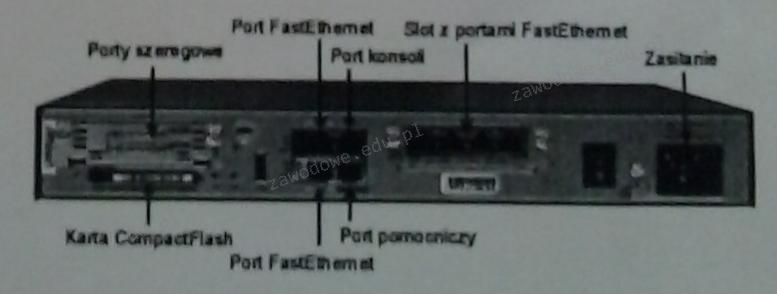

Na ilustracji przedstawiono urządzenie sieciowe, którym jest

Komenda systemowa ipconfig pozwala na konfigurację

Uzyskanie przechowywania kopii często odwiedzanych witryn oraz zwiększenia bezpieczeństwa przez odfiltrowanie konkretnych treści w sieci Internet można osiągnąć dzięki

Elementem, który umożliwia wymianę informacji pomiędzy procesorem a magistralą PCI-E, jest

Jakie materiały eksploatacyjne wykorzystuje się w rzutniku multimedialnym?