Pytanie 1

Zidentyfikuj najprawdopodobniejszą przyczynę pojawienia się komunikatu "CMOS checksum error press F1 to continue press DEL to setup" podczas uruchamiania systemu komputerowego?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Zidentyfikuj najprawdopodobniejszą przyczynę pojawienia się komunikatu "CMOS checksum error press F1 to continue press DEL to setup" podczas uruchamiania systemu komputerowego?

Czym charakteryzuje się atak typu hijacking na serwerze sieciowym?

Jaki rodzaj dysków jest podłączany do złącza IDE na płycie głównej komputera?

Aby zasilić najbardziej wydajne karty graficzne, konieczne jest dodatkowe 6-pinowe gniazdo zasilacza PCI-E, które dostarcza napięcia

Aby zwiększyć bezpieczeństwo osobistych danych podczas przeglądania stron internetowych, warto dezaktywować w ustawieniach przeglądarki

Jaki protokół stosują komputery, aby informować router o zamiarze dołączenia lub opuszczenia konkretnej grupy rozgłoszeniowej?

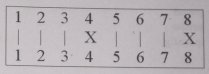

Jaki błąd w okablowaniu można dostrzec na ekranie testera, który pokazuje mapę połączeń żył kabla typu "skrętka"?

Jaki protokół aplikacyjny w modelu TCP/IP pozwala klientowi na nawiązanie bezpiecznego połączenia z firmowym serwerem przez Internet, aby zyskać dostęp do zasobów przedsiębiorstwa?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

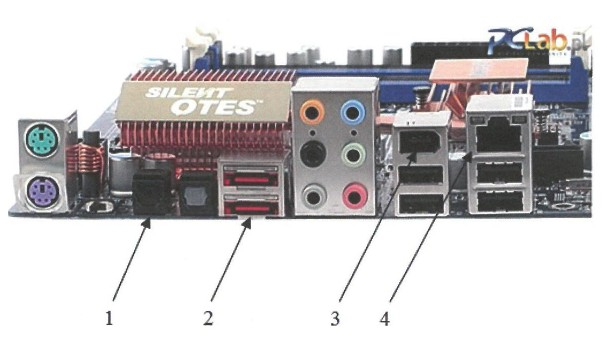

Który z portów na zaprezentowanej płycie głównej umożliwia podłączenie zewnętrznego dysku przez interfejs e-SATA?

Oblicz koszt wykonania okablowania strukturalnego od 5 punktów abonenckich do panelu krosowego wraz z wykonaniem kabli połączeniowych dla stacji roboczych. W tym celu wykorzystano 50 m skrętki UTP. Punkt abonencki składa się z 2 gniazd typu RJ

| Materiał | Jednostka | Cena |

|---|---|---|

| Gniazdo podtynkowe 45x45, bez ramki, UTP 2xRJ45 kat.5e | szt. | 17 zł |

| UTP kabel kat.5e PVC 4PR 305m | karton | 305 zł |

| RJ wtyk UTP kat.5e beznarzędziowy | szt. | 6 zł |

W instrukcji obsługi karty dźwiękowej można znaleźć następujące dane: - częstotliwość próbkowania wynosząca 22 kHz, - rozdzielczość wynosząca 16 bitów. Jaką przybliżoną objętość będzie miało mono jednokanałowe nagranie dźwiękowe trwające 10 sekund?

Jakie urządzenie powinno zostać wykorzystane do podłączenia komputerów, aby mogły funkcjonować w odrębnych domenach rozgłoszeniowych?

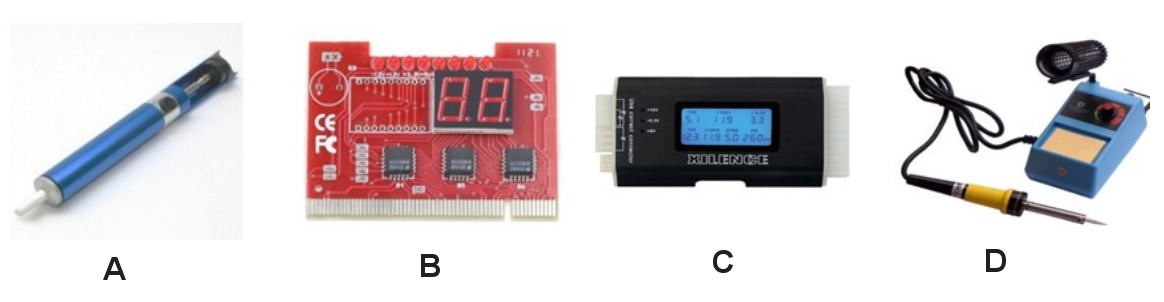

Jakie narzędzie powinno być użyte do uzyskania rezultatów testu POST dla komponentów płyty głównej?

Jaki protokół służy do przesyłania plików bez konieczności tworzenia połączenia?

W systemie Linux, aby wyświetlić informację o nazwie bieżącego katalogu roboczego, należy zastosować polecenie

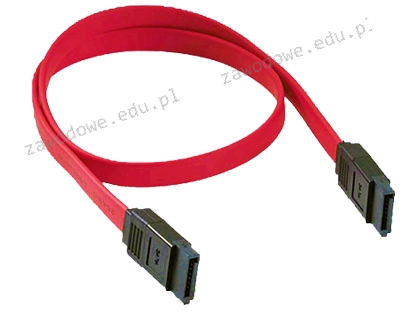

Na ilustracji przedstawiono przewód z wtykami

Zainstalowanie serwera WWW w środowisku Windows Server zapewnia rola

Jaką operację należy wykonać, aby chronić dane przesyłane w sieci przed działaniem sniffera?

Jak najlepiej chronić zgromadzone dane przed ich odczytem w przypadku kradzieży komputera?

W komputerowych stacjach roboczych zainstalowane są karty sieciowe Ethernet 10/100/1000 z interfejsem RJ45. Jakie medium transmisyjne powinno być zastosowane do budowy sieci komputerowej, aby osiągnąć maksymalną przepustowość?

W doborze zasilacza do komputera kluczowe znaczenie

Jakie oprogramowanie należy zainstalować, aby serwer Windows mógł obsługiwać usługi katalogowe?

Wskaż sygnał, który wskazuje na uszkodzenie karty graficznej w komputerze z BIOS POST od firmy AWARD?

Jak należy ustawić w systemie Windows Server 2008 parametry protokołu TCP/IP karty sieciowej, aby komputer mógł jednocześnie łączyć się z dwiema różnymi sieciami lokalnymi posiadającymi odrębne adresy IP?

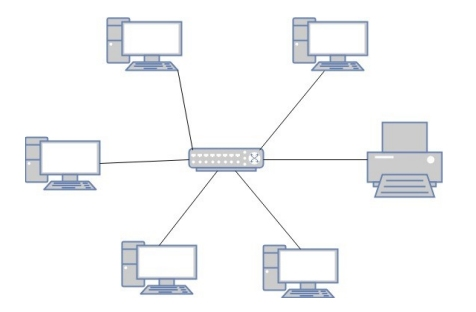

Jaką fizyczną topologię sieci komputerowej ilustruje ten rysunek?

Który protokół umożliwia zarządzanie wieloma folderami pocztowymi oraz pobieranie i operowanie na listach znajdujących się na zdalnym serwerze?

Który z podanych adresów IPv4 należy do kategorii B?

Jaki jest powód sytuacji widocznej na przedstawionym zrzucie ekranu, mając na uwadze adres IP serwera, na którym umieszczona jest domena www.wp.pl, wynoszący 212.77.98.9?

C:\>ping 212.77.98.9

Pinging 212.77.98.9 with 32 bytes of data:

Reply from 212.77.98.9: bytes=32 time=29ms TTL=60

Reply from 212.77.98.9: bytes=32 time=29ms TTL=60

Reply from 212.77.98.9: bytes=32 time=30ms TTL=60

Reply from 212.77.98.9: bytes=32 time=29ms TTL=60

Ping statistics for 212.77.98.9:

Packets: Sent = 4, Received = 4, Lost = 0 (0% loss),

Approximate round trip times in milli-seconds:

Minimum = 29ms, Maximum = 30ms, Average = 29ms

C:\>ping www.wp.pl

Ping request could not find host www.wp.pl. Please check the name and try again.Jakie elementy łączy okablowanie pionowe w sieci LAN?

Jakie polecenie w systemach Windows należy użyć, aby ustawić statyczny adres IP w konsoli poleceń?

Jaką normę wykorzystuje się przy okablowaniu strukturalnym w komputerowych sieciach?

Aby była możliwa komunikacja pomiędzy dwiema różnymi sieciami, do których należą karty sieciowe serwera, należy w systemie Windows Server dodać rolę

Aktywacja opcji OCR w procesie ustawiania skanera umożliwia

Jakim elementem sieci SIP jest telefon IP?

Podczas próby nawiązania połączenia z serwerem FTP, uwierzytelnienie anonimowe nie powiodło się, natomiast logowanie za pomocą loginu i hasła zakończyło się sukcesem. Co może być przyczyną tej sytuacji?

Do ilu sieci należą komputery o adresach IP i maskach sieci przedstawionych w tabeli?

| Adres IPv4 | Maska |

|---|---|

| 10.120.16.10 | 255.255.0.0 |

| 10.120.18.16 | 255.255.0.0 |

| 10.110.16.18 | 255.255.255.0 |

| 10.110.16.14 | 255.255.255.0 |

| 10.130.16.12 | 255.255.255.0 |

Która z usług musi być aktywna na ruterze, aby mógł on modyfikować adresy IP źródłowe oraz docelowe podczas przekazywania pakietów pomiędzy różnymi sieciami?

Wykonując w konsoli systemu Windows Server komendę convert, co można zrealizować?

Który z poniższych programów nie jest wykorzystywany do zdalnego administrowania komputerami w sieci?