Pytanie 1

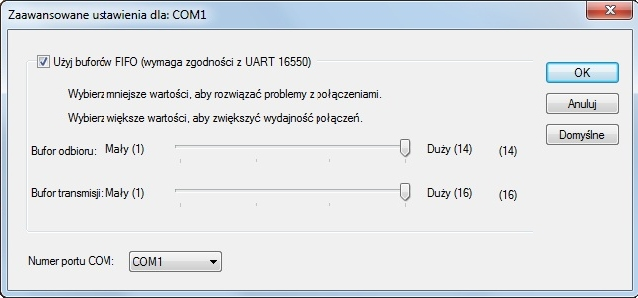

Ustawienia przedstawione na ilustracji odnoszą się do

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Ustawienia przedstawione na ilustracji odnoszą się do

Do ilu sieci należą komputery o podanych w tabeli adresach IP i standardowej masce sieci?

| Komputer | Adres IP |

|---|---|

| Komputer 1 | 172.16.15.5 |

| Komputer 2 | 172.18.15.6 |

| Komputer 3 | 172.18.16.7 |

| Komputer 4 | 172.20.16.8 |

| Komputer 5 | 172.20.16.9 |

| Komputer 6 | 172.21.15.10 |

Zjawisko przekazywania tokena (ang. token) występuje w sieci o fizycznej strukturze

Do jakiej grupy w systemie Windows Server 2008 powinien być przypisany użytkownik odpowiedzialny wyłącznie za archiwizację danych przechowywanych na serwerowym dysku?

Jakim skrótem określa się połączenia typu punkt-punkt w ramach publicznej infrastruktury telekomunikacyjnej?

Komputer stracił łączność z siecią. Jakie działanie powinno być podjęte w pierwszej kolejności, aby naprawić problem?

Jakim protokołem jest protokół dostępu do sieci pakietowej o maksymalnej prędkości 2 Mbit/s?

W jakim trybie pracy znajduje się system Linux, kiedy osiągalny jest tylko minimalny zestaw funkcji systemowych, często używany do napraw?

Jaka usługa musi być aktywna na serwerze, aby stacja robocza mogła automatycznie uzyskać adres IP?

Który rodzaj pracy Access Pointa jest używany, aby umożliwić urządzeniom bezprzewodowym dostęp do przewodowej sieci LAN?

Lokalny komputer dysponuje adresem 192.168.0.5. Po otwarciu strony internetowej z tego urządzenia, która identyfikuje adresy w sieci, uzyskano informację, że adresem komputera jest 195.182.130.24. Co to oznacza?

Który z protokołów przesyła datagramy użytkownika BEZ GWARANCJI ich dostarczenia?

Procesem nieodwracalnym, całkowicie uniemożliwiającym odzyskanie danych z dysku twardego, jest

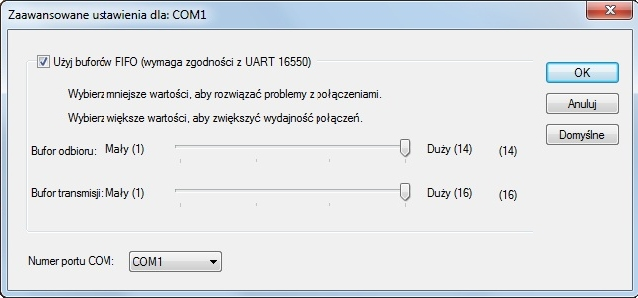

Biorąc pod uwagę konfigurację wykonywaną na ilustracji, administrator po zainstalowaniu systemu operacyjnego uznał za istotne, aby

Symbole i oznaczenia znajdujące się na zamieszczonej tabliczce znamionowej podzespołu informują między innymi o tym, że produkt jest

Okablowanie wertykalne w sieci strukturalnej łączy

W dokumentacji płyty głównej zapisano „Wsparcie dla S/PDIF Out”. Co to oznacza w kontekście tego modelu płyty głównej?

Która z anten charakteryzuje się najwyższym zyskiem energetycznym oraz pozwala na nawiązywanie połączeń na dużą odległość?

Jakiego systemu plików powinno się użyć podczas instalacji dystrybucji Linux?

Co oznacza standard ACPI w BIOSie komputera?

Jakie złącze jest przypisane do kategorii 7?

Jakim sposobem zapisuje się dane na nośnikach BD-R?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie napięcie jest obniżane z 230 V w zasilaczu komputerowym w standardzie ATX dla różnych podzespołów komputera?

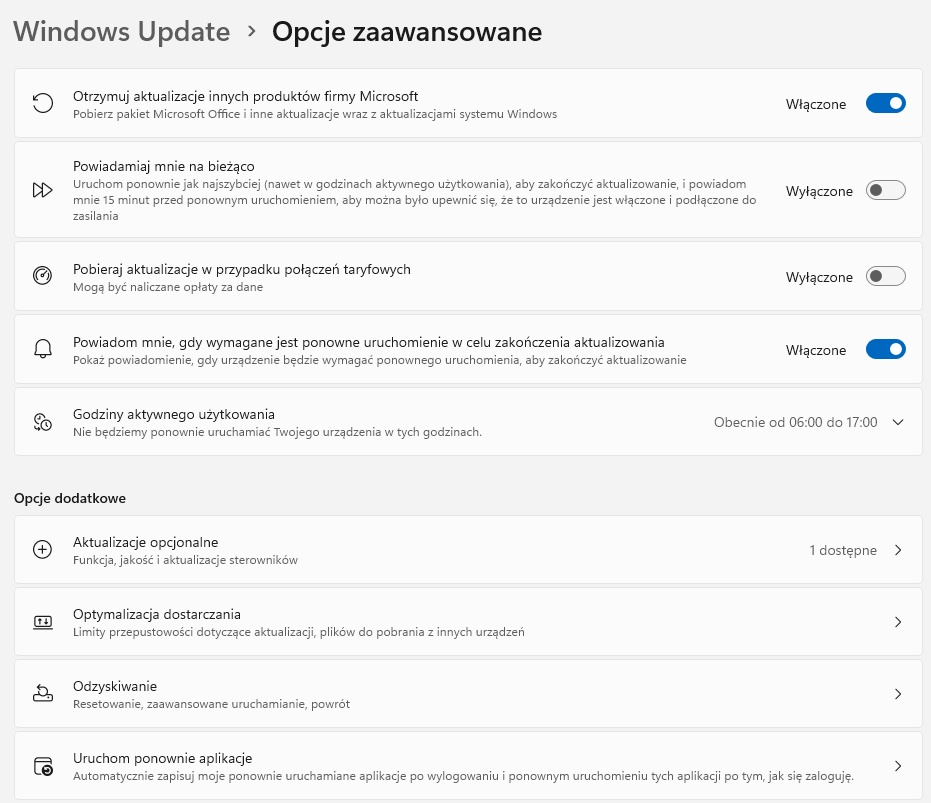

Na podstawie zrzutu ekranu ilustrującego ustawienia przełącznika można wnioskować, że

Jaką maksymalną ilość rzeczywistych danych można przesłać w ciągu 1 sekundy przez łącze synchroniczne o wydajności 512 kbps, bez użycia sprzętowej i programowej kompresji?

Magistrala komunikacyjna PCI ver. 2.2 (Peripheral Component Interconnect) jest standardem magistrali, zgodnie z którym szyna danych ma maksymalną szerokość

W jakim typie skanera stosuje się fotopowielacze?

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?

Jakie składniki systemu komputerowego wymagają utylizacji w wyspecjalizowanych zakładach przetwarzania z powodu obecności niebezpiecznych substancji lub pierwiastków chemicznych?

Elementem aktywnym w elektronice jest

W drukarce laserowej do stabilizacji druku na papierze używane są

Dokument służący do zaprezentowania oferty cenowej dla inwestora dotyczącej wykonania robót instalacyjnych sieci komputerowej, to

Zgodnie z normą PN-EN 50174, maksymalna długość kabla poziomego kategorii 6 pomiędzy punktem abonenckim a punktem dystrybucji w panelu krosowym wynosi

Komenda msconfig uruchamia w systemie Windows:

Przyczyną niekontrolowanego wypełnienia przestrzeni na dysku może być

Który z protokołów funkcjonuje w warstwie aplikacji modelu ISO/OSI, umożliwiając wymianę informacji kontrolnych między urządzeniami sieciowymi?

Co oznacza skrót RAID w kontekście pamięci masowej?

Poprzez użycie opisanego urządzenia możliwe jest wykonanie diagnostyki działania

Ile elektronów jest zgromadzonych w matrycy LCD?