Pytanie 1

W dokumentacji dotyczącej karty dźwiękowej można znaleźć informację: częstotliwość próbkowania 22 kHz oraz rozdzielczość próbkowania 16 bitów. Jaka będzie przybliżona objętość pliku audio z 10-sekundowym nagraniem mono (jednokanałowym)?

Wynik: 15/40 punktów (37,5%)

Wymagane minimum: 20 punktów (50%)

W dokumentacji dotyczącej karty dźwiękowej można znaleźć informację: częstotliwość próbkowania 22 kHz oraz rozdzielczość próbkowania 16 bitów. Jaka będzie przybliżona objętość pliku audio z 10-sekundowym nagraniem mono (jednokanałowym)?

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?

Podczas normalnego działania systemu operacyjnego w laptopie pojawił się komunikat o konieczności formatowania wewnętrznego dysku twardego. Wskazuje on na

Który z parametrów twardego dysku NIE ma wpływu na jego wydajność?

Aby komputer stacjonarny mógł współdziałać z urządzeniami używającymi złącz pokazanych na ilustracji, konieczne jest wyposażenie go w interfejs

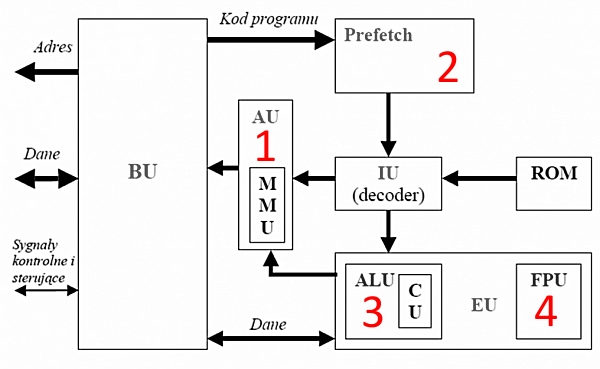

Koprocesor arytmetyczny, który pełni funkcję wykonywania obliczeń na liczbach zmiennoprzecinkowych w mikroprocesorze, został na schemacie oznaczony cyfrą

Aby osiągnąć przepustowość wynoszącą 4 GB/s w obie strony, konieczne jest zainstalowanie w komputerze karty graficznej korzystającej z interfejsu

Aby określić rozmiar wolnej oraz zajętej pamięci RAM w systemie Linux, można skorzystać z polecenia

Aby podnieść wydajność komputera w grach, karta graficzna Sapphire Radeon R9 FURY OC, 4GB HBM (4096 Bit), HDMI, DVI, 3xDP została wzbogacona o technologię

Dokument służący do zaprezentowania oferty cenowej dla inwestora dotyczącej wykonania robót instalacyjnych sieci komputerowej, to

Jakie wbudowane narzędzie w systemie Windows służy do identyfikowania problemów związanych z animacjami w grach oraz odtwarzaniem filmów?

Podczas analizy ruchu sieciowego przy użyciu sniffera zauważono, że urządzenia przesyłają dane na portach 20 oraz 21. Przyjmując standardową konfigurację, oznacza to, że analizowanym protokołem jest protokół

Jakim materiałem eksploatacyjnym dysponuje ploter solwentowy?

Jakiego typu rozbudowa serwera wymaga zainstalowania dodatkowych sterowników?

Jakie elementy wspierają okablowanie pionowe w sieci LAN?

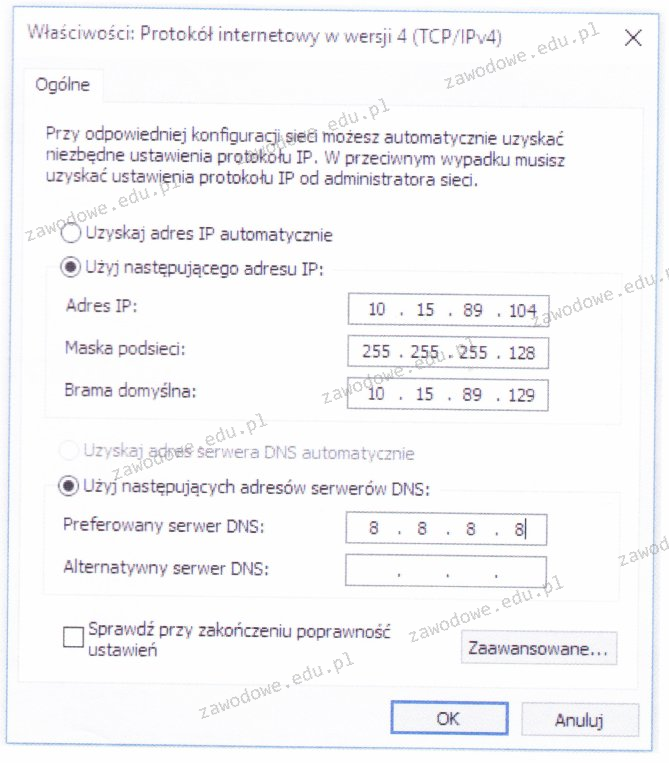

Schemat ilustruje ustawienia karty sieciowej dla urządzenia z adresem IP 10.15.89.104/25. Można z niego wywnioskować, że

Narzędziem systemu Windows, służącym do sprawdzenia wpływu poszczególnych procesów i usług na wydajność procesora oraz tego, w jakim stopniu generują one obciążenie pamięci czy dysku, jest

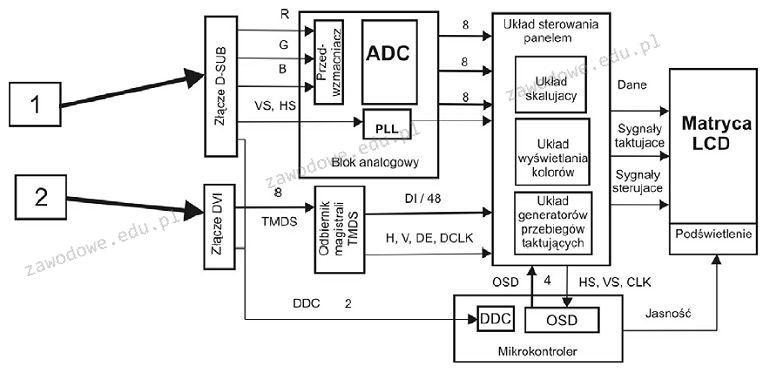

Które z połączeń zaznaczonych strzałkami na diagramie monitora stanowi wejście cyfrowe?

Jakie oprogramowanie nie jest przeznaczone do diagnozowania komponentów komputera?

Jakie urządzenie w sieci lokalnej NIE ROZDZIELA obszaru sieci komputerowej na domeny kolizyjne?

Aby bezpośrednio połączyć dwa komputery w przewodowej sieci LAN, należy zastosować

Termin określający zdolność do rozbudowy sieci to

Urządzenie peryferyjne, które jest kontrolowane przez komputer i służy do pracy z dużymi, płaskimi powierzchniami, a do produkcji druku odpornego na warunki atmosferyczne wykorzystuje farby na bazie rozpuszczalników, nosi nazwę ploter

Który z podanych elementów jest częścią mechanizmu drukarki igłowej?

Które z wymienionych oznaczeń wskazuje, że jest to kabel typu skrętka z podwójnym ekranowaniem?

/dev/sda: Czas odczytu z pamięci podręcznej: 18100 MB w 2.00 sekundy = 9056.95 MB/sek. Przedstawiony wynik wykonania polecenia systemu Linux jest używany do diagnostyki

Wynikiem dodawania dwóch liczb binarnych 1101011 oraz 1001001 jest liczba w systemie dziesiętnym

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się operacje usuwania starych plików oraz dodawania nowych, staje się:

Przekształć liczbę dziesiętną 129(10) na reprezentację binarną.

Plik ma wielkość 2 KiB. Co to oznacza?

Dysk znajdujący się w komputerze ma zostać podzielony na partycje. Jaką maksymalną liczbę partycji rozszerzonych można utworzyć na jednym dysku?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Schemat ilustruje fizyczną strukturę

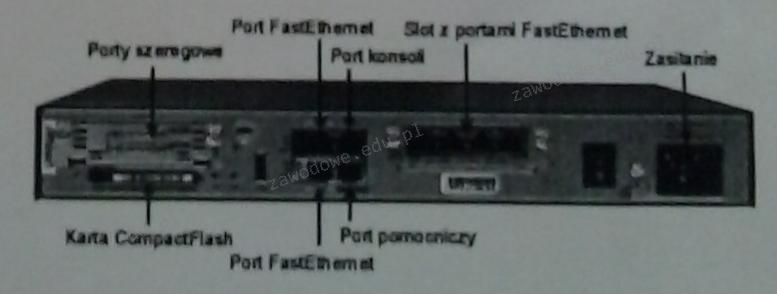

Na ilustracji przedstawiono urządzenie sieciowe, którym jest

Jaką maskę trzeba zastosować, aby podzielić sieć z adresem 192.168.1.0 na 4 podsieci?

Cechą charakterystyczną transmisji w interfejsie równoległym synchronicznym jest to, że

Wskaż nieprawidłowy sposób podziału dysków MBR na partycje?

Po włączeniu komputera wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Może to być spowodowane

Aby uzyskać na ekranie monitora odświeżanie obrazu 85 razy w ciągu sekundy, trzeba częstotliwość jego odświeżania ustawić na

Zaprezentowane właściwości karty sieciowej sugerują, że karta

| Kod Producenta | WN-370USB |

| Interfejs | USB |

| Zgodność ze standardem | IEEE 802.11 b/g/n |

| Ilość wyjść | 1 szt. |

| Zabezpieczenia | WEP 64/128, WPA, WPA2 |

| Wymiary | 49(L) x 26(W) x 10(H) mm |