Pytanie 1

Wskaż podzespół niekompatybilny z płytą główną o przedstawionych w tabeli parametrach.

| Podzespół | Parametry |

|---|---|

| Płyta główna GIGABYTE | 4x DDR4, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8x USB 2.0, S-AM3+ |

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Wskaż podzespół niekompatybilny z płytą główną o przedstawionych w tabeli parametrach.

| Podzespół | Parametry |

|---|---|

| Płyta główna GIGABYTE | 4x DDR4, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8x USB 2.0, S-AM3+ |

Jakie urządzenie sieciowe zostało zilustrowane na podanym rysunku?

Jakie zakresy zostaną przydzielone przez administratora do adresów prywatnych w klasie C, przy użyciu maski 24 bitowej dla komputerów w lokalnej sieci?

Przyczyną niekontrolowanego wypełnienia przestrzeni na dysku może być

Programem służącym do archiwizacji danych w systemie Linux jest

Narzędzia do dostosowywania oraz Unity Tweak Tool to aplikacje w systemie Linux przeznaczone do

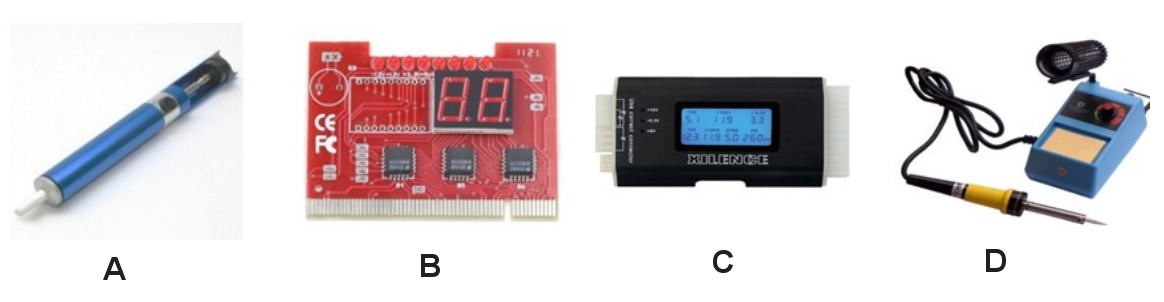

Jakie narzędzie powinno być użyte do uzyskania rezultatów testu POST dla komponentów płyty głównej?

Jaką przepustowość określa standard Ethernet IEEE 802.3z?

Główny punkt, z którego odbywa się dystrybucja okablowania szkieletowego, to punkt

W trakcie instalacji oraz konfiguracji serwera DHCP w systemach z rodziny Windows Server istnieje możliwość dodania zastrzeżeń adresów, które określą

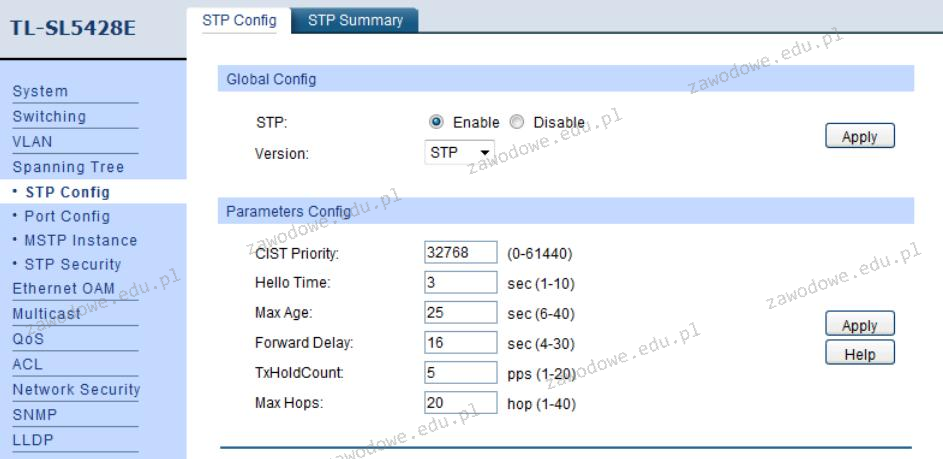

Na podstawie zrzutu ekranu ilustrującego ustawienia przełącznika można wnioskować, że

Podaj poprawną sekwencję czynności, które należy wykonać, aby przygotować nowy laptop do użycia.

Jak nazywa się protokół, który umożliwia pobieranie wiadomości z serwera?

Podaj nazwę funkcji przełącznika, która pozwala na przypisanie wyższego priorytetu dla transmisji VoIP?

Najefektywniejszym zabezpieczeniem danych firmy, której siedziby znajdują się w różnych, odległych od siebie lokalizacjach, jest zastosowanie

Urządzenie trwale zainstalowane u abonenta, które zawiera zakończenie poziomego okablowania strukturalnego, to

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Która z wymienionych czynności nie jest związana z personalizacją systemu operacyjnego Windows?

W systemie Linux można uzyskać kopię danych przy użyciu komendy

Która usługa pozwala na zdalne zainstalowanie systemu operacyjnego?

Problemy związane z zawieszaniem się systemu operacyjnego w trakcie jego uruchamiania są zazwyczaj spowodowane

Trudności w systemie operacyjnym Windows wynikające z konfliktów dotyczących zasobów sprzętowych, takich jak przydział pamięci, przerwań IRQ oraz kanałów DMA, najłatwiej zidentyfikować za pomocą narzędzia

Emisja przez BIOS firmy AMI jednego długiego oraz dwóch krótkich sygnałów dźwiękowych oznacza

Ile adresów można przypisać urządzeniom działającym w sieci o adresie IP 192.168.20.0/26?

Aby zasilić najbardziej wydajne karty graficzne, konieczne jest dodatkowe 6-pinowe gniazdo zasilacza PCI-E, które dostarcza napięcia

W systemie Windows pamięć wirtualna ma na celu

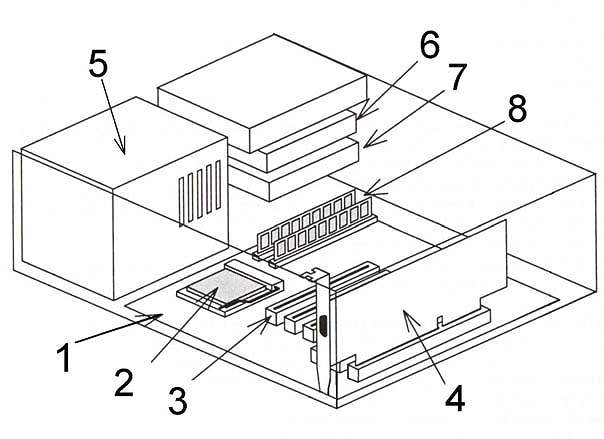

Na ilustracji karta rozszerzeń jest oznaczona numerem

Zbiór zasad określających metodę wymiany danych w sieci to

Aby zwiększyć wydajność komputera, można zainstalować procesor obsługujący technologię Hyper-Threading, która pozwala na

Do zrealizowania macierzy RAID 1 wymagane jest co najmniej

Element elektroniczny przedstawiony na ilustracji to:

Jakie kable powinny być używane z narzędziem pokazanym na fotografii?

Podane dane katalogowe odnoszą się do routera z wbudowaną pamięcią masową

| CPU | AtherosAR7161 680MHz |

| Memory | 32MB DDR SDRAM onboard memory |

| Boot loader | RouterBOOT |

| Data storage | 64MB onboard NAND memory chip |

| Ethernet | One 10/100 Mbit/s Fast Ethernet port with Auto-MDI/X |

| miniPCI | One MiniPCI Type IIIA/IIIB slot One MiniPCIe slot for 3G modem only (onboard SIM connector) |

| Wireless | Built in AR2417 802. 11 b/g wireless, 1x MMCX connector |

| Expansion | One USB 2.0 ports (without powering, needs power adapter, available separately) |

| Serial port | One DB9 RS232C asynchronous serial port |

| LEDs | Power, NAND activity, 5 user LEDs |

| Power options | Power over Ethernet: 10..28V DC (except power over datalines). Power jack: 10..28V DC. Includes voltage monitor |

| Dimensions | 105 mm x 105 mm, Weight: 82 g |

| Power consumption | Up to 5W with wireless at full activity |

| Operating System | MikroTik RouterOS v3, Level4 license |

Aby przywrócić dane z sformatowanego dysku twardego, konieczne jest zastosowanie programu

W systemach Windows XP Pro/ Windows Vista Bizness/Windows 7 Pro/Windows 8 Pro, rozwiązaniem zapewniającym poufność danych dla użytkowników korzystających z jednego komputera, których informacje mogą być wykorzystywane wyłącznie przez nich, jest

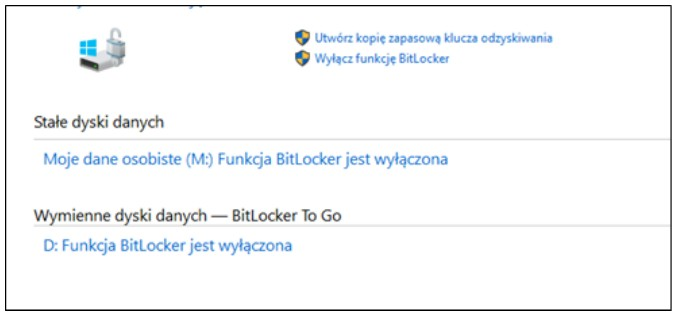

Narzędzie wbudowane w systemy Windows w edycji Enterprise lub Ultimate ma na celu

W wyniku wykonania przedstawionych poleceń systemu Linux interfejs sieciowy eth0 otrzyma:

ifconfig eth0 10.0.0.100 netmask 255.255.255.0 broadcast 10.0.0.255 up route add default gw 10.0.0.10

Jaką minimalną liczbę bitów potrzebujemy w systemie binarnym, aby zapisać liczbę heksadecymalną 110 (h)?

Aby zminimalizować wpływ zakłóceń elektromagnetycznych na przesyłany sygnał w projektowanej sieci komputerowej, co należy zastosować?

Jakie jest właściwe IP dla maski 255.255.255.0?