Pytanie 1

Aby wyświetlić listę wszystkich zainstalowanych urządzeń w systemie Windows lub zmienić ich właściwości, należy skorzystać z narzędzia

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Aby wyświetlić listę wszystkich zainstalowanych urządzeń w systemie Windows lub zmienić ich właściwości, należy skorzystać z narzędzia

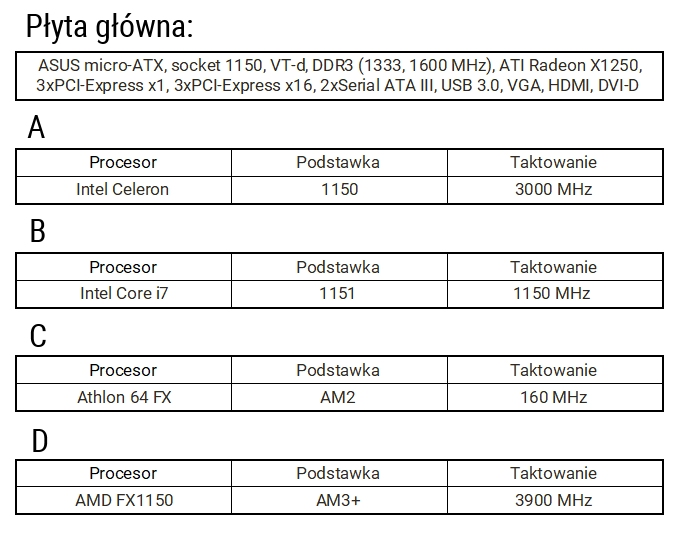

Wskaż komponent, który nie jest zgodny z płytą główną o parametrach przedstawionych w tabeli

| Podzespół | Parametry |

|---|---|

| Płyta główna GIGABYTE | 4x DDR4, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8 x USB 2.0, S-AM3+ |

Zgodnie z wytycznymi dotyczącymi karty graficznej, jej możliwości pracy z systemem AGP 2X/4X pozwalają na

Aby procesor działał poprawnie, konieczne jest podłączenie złącza zasilania 4-stykowego lub 8-stykowego o napięciu

Który protokół przesyła datagramy bez gwarancji ich dostarczenia?

Na świeżo zainstalowanym komputerze program antywirusowy powinno się zainstalować

Jakie czynności należy wykonać, aby przygotować nowego laptopa do użytkowania?

W usłudze, jaką funkcję pełni protokół RDP?

Podczas normalnego działania systemu operacyjnego w laptopie pojawił się komunikat o konieczności formatowania wewnętrznego dysku twardego. Wskazuje on na

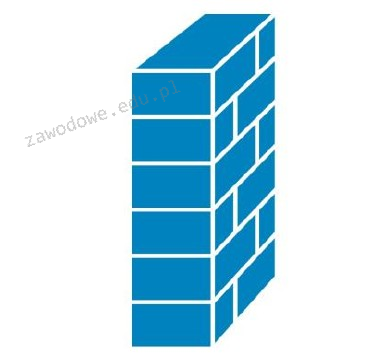

Przedmiot widoczny na ilustracji to

W systemie Windows, po dezaktywacji domyślnego konta administratora i ponownym uruchomieniu komputera

Jaki procesor pasuje do płyty głównej o podanej specyfikacji?

Podstawowy rekord uruchamiający na dysku twardym to

Aby serwer z systemem Linux mógł udostępniać pliki i drukarki komputerom klienckim z systemem Windows, należy zainstalować na nim

Komputer jest połączony z siecią Internetową i nie posiada zainstalowanego oprogramowania antywirusowego. Jak można sprawdzić, czy ten komputer jest zainfekowany wirusem, nie wchodząc w ustawienia systemowe?

Wskaż cechę platformy wirtualizacji Hyper-V.

Które z poniższych stwierdzeń odnosi się do sieci P2P – peer to peer?

Wyższą efektywność aplikacji multimedialnych w systemach z rodziny Windows zapewnia technologia

Który port stosowany jest przez protokół FTP (File Transfer Protocol) do przesyłania danych?

Aby zrealizować usługę zdalnego uruchamiania systemów operacyjnych na komputerach stacjonarnych, należy w Windows Server zainstalować rolę

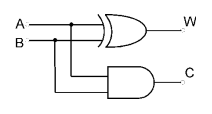

Jakie wartości logiczne otrzymamy w wyniku działania podanego układu logicznego, gdy na wejścia A i B wprowadzimy sygnały A=1 oraz B=1?

W IPv6 odpowiednikiem adresu pętli zwrotnej jest adres

Liczba 5110 w zapisie binarnym wygląda jak

Jakie narzędzie wykorzystuje się do połączenia pigtaila z włóknami światłowodowymi?

Jakie polecenie w systemie operacyjnym Linux służy do monitorowania komunikacji protokołów TCP/IP lub innych przesyłanych lub odbieranych w sieci komputerowej, do której jest podłączony komputer użytkownika?

W systemie DNS, aby powiązać nazwę hosta z adresem IPv4, konieczne jest stworzenie rekordu

Systemy operacyjne należące do rodziny Linux są dystrybuowane na mocy licencji

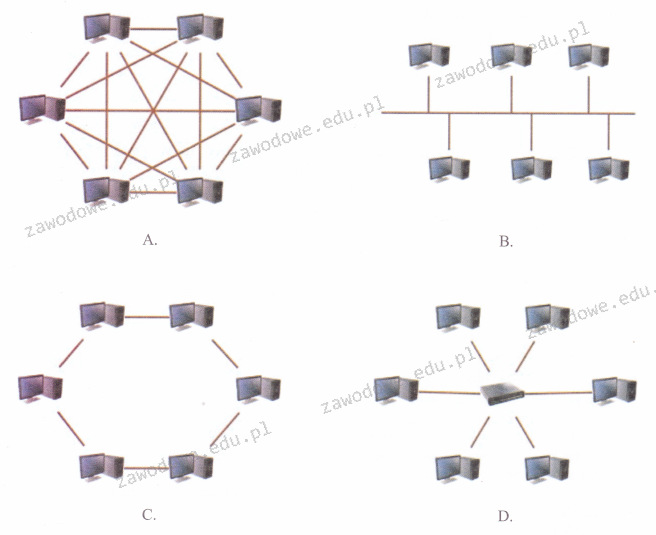

Która z zaprezentowanych na rysunkach topologii odpowiada topologii siatki?

Narzędziem do monitorowania wydajności i niezawodności w systemach Windows 7, Windows Server 2008 R2 oraz Windows Vista jest

Który układ mikroprocesora jest odpowiedzialny między innymi za pobieranie rozkazów z pamięci oraz generowanie sygnałów sterujących?

W wyniku polecenia net accounts /MINPWLEN:11 w systemie Windows, wartość 11 będzie przypisana do

Rodzaj ataku komputerowego, który polega na pozyskiwaniu wrażliwych informacji osobistych poprzez podszywanie się pod zaufaną osobę lub instytucję, to

Na ilustracji zaprezentowany jest graficzny symbol

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Norma opisująca standard transmisji Gigabit Ethernet to

Rodzajem pamięci RAM, charakteryzującym się minimalnym zużyciem energii, jest

Do usunięcia kurzu z wnętrza obudowy drukarki fotograficznej zaleca się zastosowanie

Adres IP 192.168.2.0/24 podzielono na cztery różne podsieci. Jaką maskę mają te nowe podsieci?

Router przypisany do interfejsu LAN dysponuje adresem IP 192.168.50.1. Został on skonfigurowany w taki sposób, aby przydzielać komputerom wszystkie dostępne adresy IP w sieci 192.168.50.0 z maską 255.255.255.0. Jaką maksymalną liczbę komputerów można podłączyć w tej sieci?

Narzędziem do zarządzania usługami katalogowymi w systemach Windows Server, które umożliwia przeniesienie komputerów do jednostki organizacyjnej wskazanej przez administratora, jest polecenie