Pytanie 1

Zastosowanie programu w różnych celach, badanie jego działania oraz wprowadzanie modyfikacji, a także możliwość publicznego udostępniania tych zmian, to charakterystyka licencji typu

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Zastosowanie programu w różnych celach, badanie jego działania oraz wprowadzanie modyfikacji, a także możliwość publicznego udostępniania tych zmian, to charakterystyka licencji typu

Wtyczka zaprezentowana na fotografii stanowi element obwodu elektrycznego zasilającego

Jaką maksymalną długość kabla typu skrętka pomiędzy panelem krosowniczym a gniazdem abonenckim przewiduje norma PN-EN 50174-2?

Komputery K1, K2, K3, K4 są podłączone do interfejsów przełącznika, które są przypisane do VLAN-ów wymienionych w tabeli. Które z tych komputerów mają możliwość komunikacji ze sobą?

| Nazwa komputera | Adres IP | Nazwa interfejsu | VLAN |

| K1 | 10.10.10.1/24 | F1 | VLAN 10 |

| K2 | 10.10.10.2/24 | F2 | VLAN 11 |

| K3 | 10.10.10.3/24 | F3 | VLAN 10 |

| K4 | 10.10.11.4/24 | F4 | VLAN 11 |

Typ systemu plików, który nie obsługuje tworzenia wewnętrznego rejestru zmian, zwanego księgowaniem, to

Narzędzia do dostosowywania oraz Unity Tweak Tool to aplikacje w systemie Linux przeznaczone do

Ile sieci obejmują komputery z adresami IP przedstawionymi w tabeli oraz standardową maską sieci?

| Komputer 1 | 172.16.15.5 |

| Komputer 2 | 172.18.15.6 |

| Komputer 3 | 172.18.16.7 |

| Komputer 4 | 172.20.16.8 |

| Komputer 5 | 172.20.16.9 |

| Komputer 6 | 172.21.15.10 |

Czym wyróżniają się procesory CISC?

Na ilustracji ukazany jest komunikat systemowy. Jakie kroki powinien podjąć użytkownik, aby naprawić błąd?

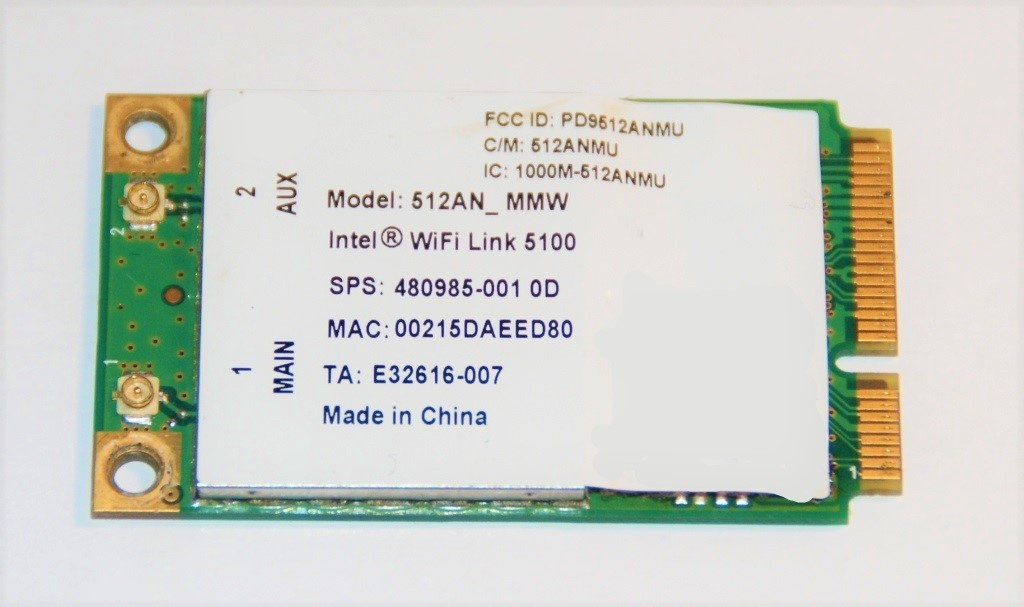

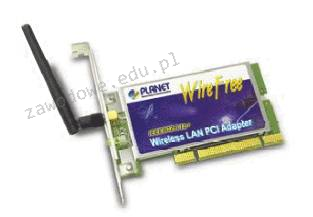

Urządzenie przedstawione na obrazie jest przeznaczone do

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

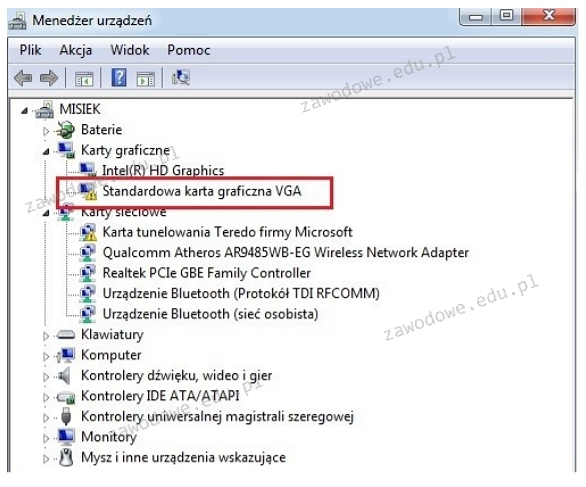

Na ilustracji przedstawiono

Zastosowanie programu Wireshark polega na

Jak nazywa się pamięć podręczna?

Aby odzyskać dane ze sformatowanego dysku twardego, należy wykorzystać program

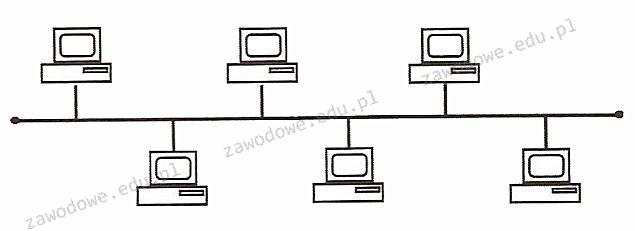

Na ilustracji ukazano sieć o układzie

Protokół, który pozwala na ściąganie wiadomości e-mail z serwera, to

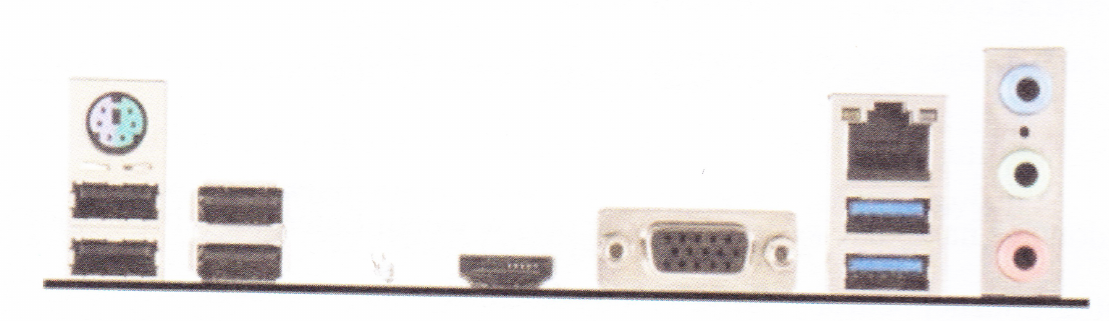

Na ilustracji ukazano port w komputerze, który służy do podłączenia

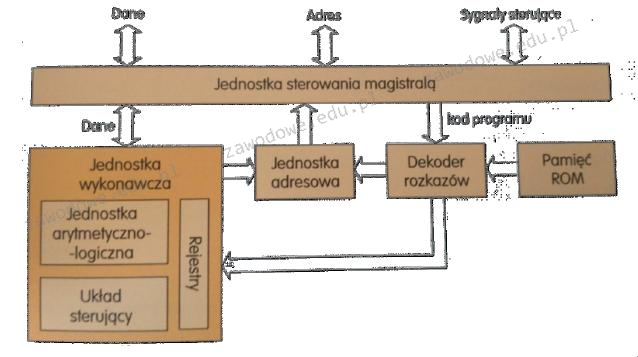

Na ilustracji przedstawiono schemat konstrukcji logicznej

Narzędziem służącym do monitorowania efektywności oraz niezawodności w systemach Windows 7, Windows Server 2008 R2 i Windows Vista jest

Grupa protokołów, która charakteryzuje się wspólną metodą szyfrowania, to

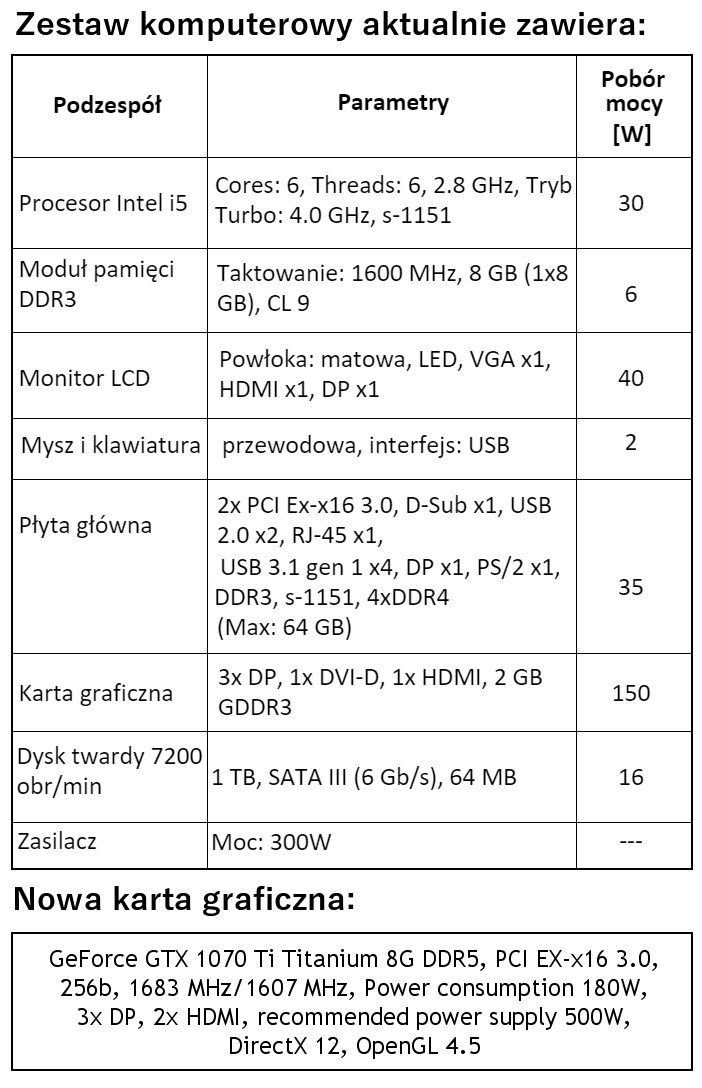

W zestawie komputerowym o parametrach wymienionych w tabeli konieczne jest zastąpienie karty graficznej nową, wskazaną w ramce. W związku z tym modernizacja tego komputera wymaga także wymiany

W jakim miejscu są przechowywane dane o kontach użytkowników domenowych w środowisku Windows Server?

Jakie urządzenie pozwala na podłączenie kabla światłowodowego wykorzystywanego w okablowaniu pionowym sieci do przełącznika z jedynie gniazdami RJ45?

Jakie urządzenie pozwala na połączenie lokalnej sieci komputerowej z Internetem?

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie został zobowiązany do podziału istniejącej lokalnej sieci komputerowej na 16 podsieci. Pierwotna sieć miała adres IP 192.168.20.0 z maską 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?

Zapis #102816 oznacza reprezentację w systemie

W sekcji zasilania monitora LCD, powiększone kondensatory elektrolityczne mogą prowadzić do uszkodzenia

Aby utworzyć obraz dysku twardego, można skorzystać z programu

W systemie Windows można zweryfikować parametry karty graficznej, używając następującego polecenia

Po zainstalowaniu systemu Linux, użytkownik pragnie skonfigurować kartę sieciową poprzez wprowadzenie ustawień dotyczących sieci. Jakie działanie należy podjąć, aby to osiągnąć?

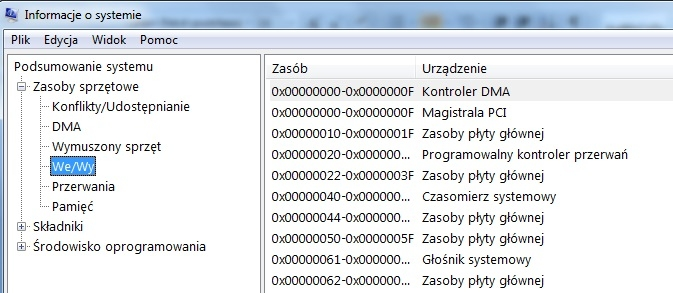

W którym systemie liczbowym zapisano zakresy We/Wy przedstawione na ilustracji?

Liczby zapisane w systemie binarnym jako 10101010 oraz w systemie heksadecymalnym jako 2D odpowiadają następującym wartościom:

Plik ma wielkość 2 KiB. Co to oznacza?

Narzędzie systemów operacyjnych Windows używane do zmiany ustawień interfejsów sieciowych, na przykład przekształcenie dynamicznej konfiguracji karty sieciowej w konfigurację statyczną, to

Na przedstawionym zdjęciu widoczna jest

Jakim systemem operacyjnym jest system czasu rzeczywistego?

Cena wydrukowania jednej strony tekstu to 95 gr, a koszt przygotowania jednej płyty CD wynosi 1,54 zł. Jakie wydatki poniesie firma, tworząca płytę z prezentacjami oraz 120-stronicowy poradnik?

Jakie polecenie powinno się wykorzystać do zainstalowania pakietów Pythona w systemie Ubuntu z oficjalnego repozytorium?

Zidentyfikuj interfejsy znajdujące się na panelu tylnym płyty głównej: