Pytanie 1

Aby zidentyfikować, który program najbardziej obciąża CPU w systemie Windows, należy otworzyć program

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Aby zidentyfikować, który program najbardziej obciąża CPU w systemie Windows, należy otworzyć program

Serwisant zrealizował w ramach zlecenia działania przedstawione w poniższej tabeli. Całkowity koszt zlecenia obejmuje wartość usług wymienionych w tabeli oraz koszt pracy serwisanta, którego stawka za godzinę wynosi 60,00 zł netto. Oblicz całkowity koszt zlecenia brutto. Stawka VAT na usługi wynosi 23%.

| LP | Czynność | Czas wykonania w minutach | Cena usługi netto w zł |

|---|---|---|---|

| 1. | Instalacja i konfiguracja programu | 35 | 20,00 |

| 2. | Wymiana płyty głównej | 80 | 50,00 |

| 3. | Wymiana karty graficznej | 30 | 25,00 |

| 4. | Tworzenie kopii zapasowej i archiwizacja danych | 65 | 45,00 |

| 5. | Konfiguracja rutera | 30 | 20,00 |

Przedsiębiorca przekazujący do składowania odpady inne niż komunalne ma obowiązek prowadzić

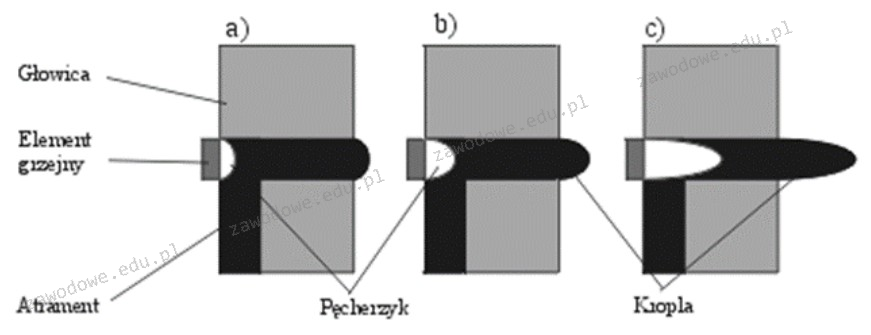

Rysunek obrazuje zasadę działania drukarki

Aby przywrócić dane, które zostały usunięte za pomocą kombinacji klawiszy Shift + Delete, co należy zrobić?

Czym jest mapowanie dysków?

W jakim systemie jest przedstawiona liczba 1010(o)?

Na przedstawionym rysunku widoczna jest karta rozszerzeń z systemem chłodzenia

Na początku procesu uruchamiania sprzętowego komputera, wykonywany jest test

Jakie jest główne zadanie programu Wireshark?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakie polecenie pozwala na uzyskanie informacji o bieżących połączeniach TCP oraz o portach źródłowych i docelowych?

Jaki akronim oznacza wydajność sieci oraz usługi, które mają na celu między innymi priorytetyzację przesyłanych pakietów?

Który z poniższych systemów operacyjnych nie jest wspierany przez system plików ext4?

Program df pracujący w systemach z rodziny Linux pozwala na wyświetlenie

W hurtowni materiałów budowlanych zachodzi potrzeba równoczesnego wydruku faktur w kilku kopiach. Jakiej drukarki należy użyć?

Jaki system plików powinien być wybrany przy instalacji systemu Linux?

Programy CommView oraz WireShark są wykorzystywane do

Który protokół należy do bezpołączeniowych protokołów warstwy transportowej?

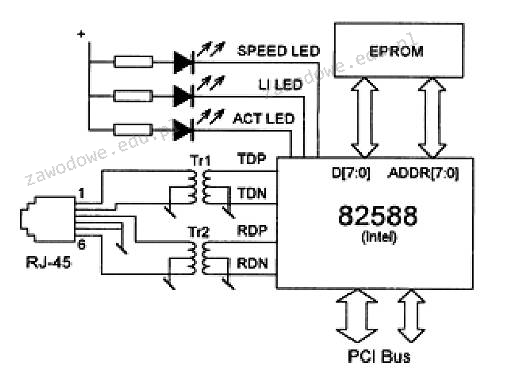

Jaką rolę pełnią elementy Tr1 i Tr2, które są widoczne na schemacie ilustrującym kartę sieciową Ethernet?

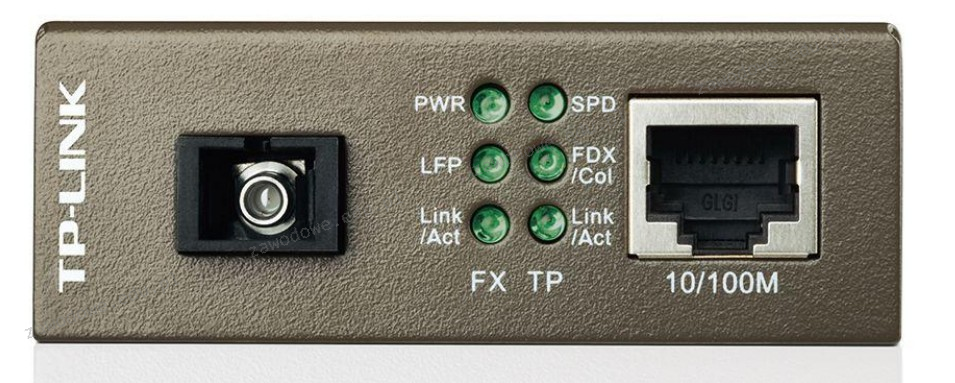

Narzędzie przedstawione do nadzorowania sieci LAN to

C:\Users\egzamin>nmap localhost Starting Nmap 7.80 ( https://nmap.org ) at 2019-11-26 20:23 ?rodkowoeuropejski czas stand. Nmap scan report for localhost (127.0.0.1) Host is up (0.00s latency). Other addresses for localhost (not scanned): ::1 Not shown: 988 closed ports PORT STATE SERVICE 135/tcp open msrpc 445/tcp open microsoft-ds 1025/tcp open NFS-or-IIS 1026/tcp open LSA-or-nterm 1027/tcp open IIS 1029/tcp open ms-lsa 1030/tcp open iad1 1031/tcp open iad2 1044/tcp open dcutility 1234/tcp open hotline 2869/tcp open icslap 16992/tcp open amt-soap-http Nmap done: 1 IP address (1 host up) scanned in 0.94 seconds

Na zdjęciu widać

Programem, który pozwala na zdalne monitorowanie działań użytkownika w sieci lokalnej lub przejęcie pełnej kontroli nad zdalnym komputerem, jest

Jakie urządzenie sieciowe powinno zastąpić koncentrator, aby podzielić sieć LAN na cztery odrębne domeny kolizji?

W systemie Windows, zainstalowanym w wersji obsługującej przydziały dyskowe, użytkownik o nazwie Gość

Topologia fizyczna, w której wszystkie urządzenia końcowe są bezpośrednio połączone z jednym punktem centralnym, takim jak koncentrator lub switch, to topologia

Rysunek ilustruje sposób działania drukarki

W jakim typie skanera stosuje się fotopowielacze?

Zapisany symbol dotyczy urządzeń

Postcardware to typ

Aby zapewnić największe bezpieczeństwo danych przy wykorzystaniu dokładnie 3 dysków, powinny one być zapisywane w macierzy dyskowej

Który z poniższych adresów IPv4 należy do klasy C?

Na ilustracji pokazano końcówkę kabla

Aby sprawdzić statystyki użycia pamięci wirtualnej w systemie Linux, należy sprawdzić zawartość pliku

Wskaż najkorzystniejszą trasę sumaryczną dla podsieci IPv4?

| 10.10.168.0/23 |

| 10.10.170.0/23 |

| 10.10.172.0/23 |

| 10.10.174.0/24 |

Połączenia typu point-to-point, realizowane za pośrednictwem publicznej infrastruktury telekomunikacyjnej, oznacza się skrótem

Która funkcja przełącznika zarządzalnego umożliwia kontrolę przepustowości każdego z wbudowanych portów?

Korzystając z polecenia taskmgr, użytkownik systemu Windows może

Urządzenie pokazane na grafice służy do

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?