Pytanie 1

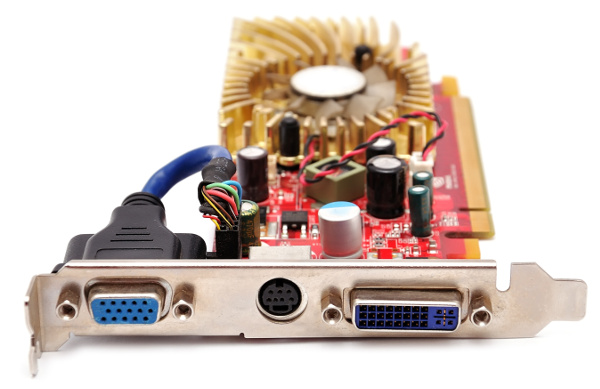

Na przedstawionej fotografii karta graficzna ma widoczne złącza

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Na przedstawionej fotografii karta graficzna ma widoczne złącza

Pamięć Intel® Smart Cache, która jest wbudowana w procesory o wielu rdzeniach, takie jak Intel® Core TM Duo, to pamięć

Zastosowanie programu Wireshark polega na

Możliwości zmiany uprawnień dostępu do plików w systemie Windows 10 można uzyskać za pomocą komendy

Zgodnie z normą PN-EN 50173, minimalna liczba punktów rozdzielczych, które należy zainstalować, wynosi

Add-Computer -DomainName egzamin.local -Restart

Przedstawione polecenie jest sposobem dodania stacji roboczej do domeny egzamin.local za pomocą

Który z materiałów eksploatacyjnych nie jest stosowany w ploterach?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jak można zaktualizować wprowadzone zmiany w konfiguracji systemu operacyjnego Windows, korzystając z edytora zasad grup?

Ile minimalnie pamięci RAM powinien mieć komputer, aby możliwe było uruchomienie 32-bitowego systemu operacyjnego Windows 7 w trybie graficznym?

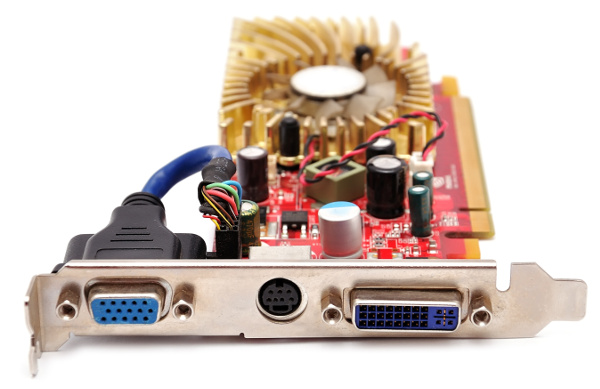

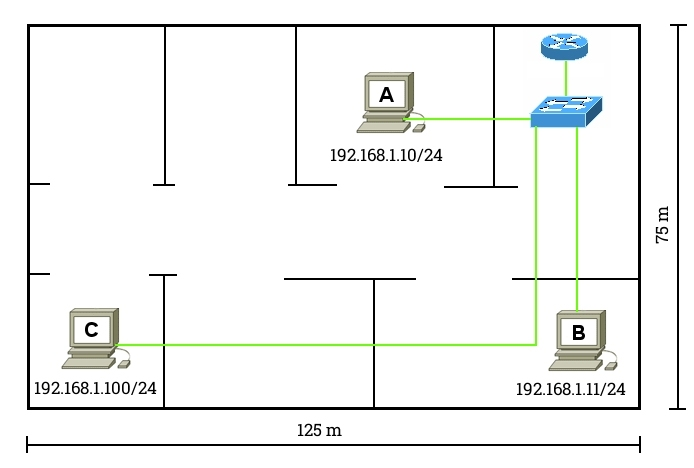

Na schemacie pokazano sieć LAN wykorzystującą okablowanie kategorii 6. Stacja robocza C nie może nawiązać połączenia z siecią. Jaki problem warstwy fizycznej może być przyczyną braku komunikacji?

Celem złocenia styków złącz HDMI jest

FDDI (ang. Fiber Distributed Data Interface) jest standardem przesyłania danych opartym na technologii światłowodowej. Jaką topologię wykorzystuje się w sieciach zbudowanych według tej technologii?

Złocenie styków złącz HDMI ma na celu

Podaj standard interfejsu wykorzystywanego do przewodowego łączenia dwóch urządzeń.

Cienki klient (thin client) to?

Podczas realizacji projektu sieci komputerowej, pierwszym krokiem powinno być

Układ cyfrowy wykonujący operację logiczną koniunkcji opiera się na bramce logicznej

Jaką liczbę komputerów można zaadresować w sieci z maską 255.255.255.224?

Procesem nieodwracalnym, całkowicie uniemożliwiającym odzyskanie danych z dysku twardego, jest

Jakiego systemu plików powinno się użyć podczas instalacji dystrybucji Linux?

W programie Explorator systemu Windows, naciśnięcie klawisza F5 zazwyczaj powoduje wykonanie następującej operacji:

Podczas pracy komputera nastąpił samoczynny twardy reset. Przyczyną resetu najprawdopodobniej jest

W technologii Ethernet protokół dostępu do medium CSMA/CD jest metodą z

W jakiej topologii fizycznej sieci każde urządzenie ma dokładnie dwa połączenia, jedno z najbliższymi sąsiadami, a dane są przesyłane z jednego komputera do kolejnego w formie pętli?

Zatrzymując pracę na komputerze, możemy szybko wznowić działania po wybraniu w systemie Windows opcji

Która z wymienionych właściwości kabla koncentrycznego RG-58 sprawia, że nie jest on obecnie używany do tworzenia lokalnych sieci komputerowych?

W czterech różnych sklepach ten sam model komputera oferowany jest w różnych cenach. Gdzie można go kupić najtaniej?

Jakie medium transmisyjne powinno być użyte do połączenia dwóch punktów dystrybucyjnych oddalonych o 600m?

W adresie IP z klasy A, wartość pierwszego bajtu mieści się w zakresie

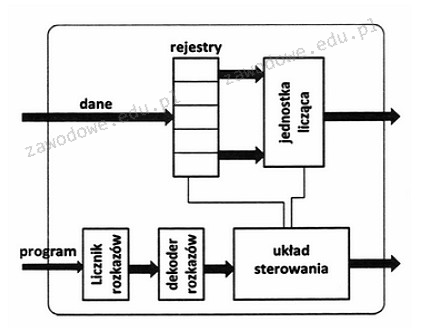

Na schemacie procesora rejestry mają za zadanie przechowywać adres do

Jak wygląda liczba 356 w systemie binarnym?

Jakie oprogramowanie można wykorzystać do wykrywania problemów w pamięciach RAM?

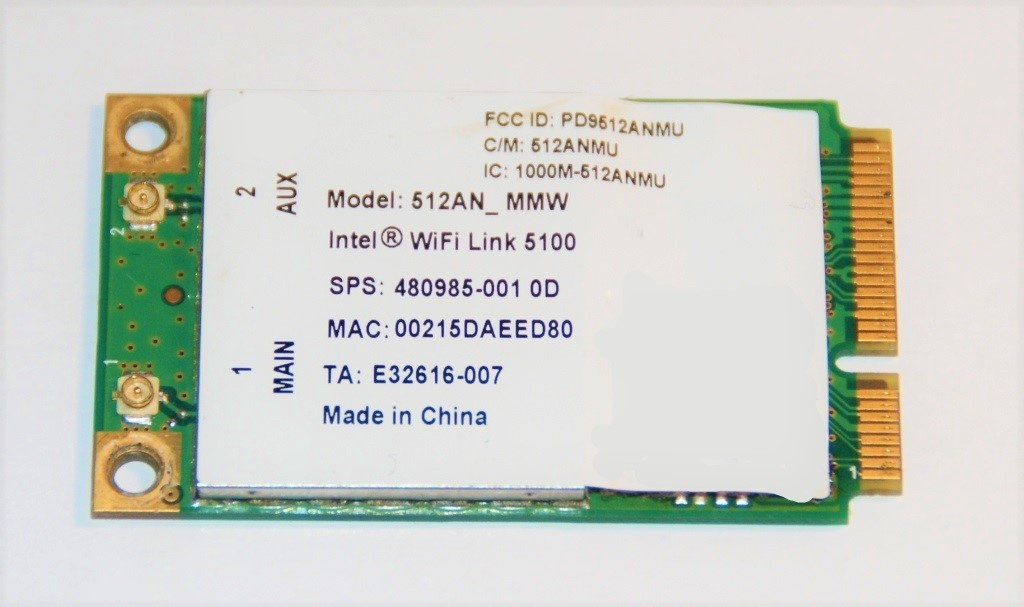

Na ilustracji przedstawiono

Umożliwienie stacjom roboczym Windows, OS X oraz Linux korzystania z usług drukowania Linuxa i serwera plików zapewnia serwer

Który z protokołów służy do weryfikacji poprawności połączenia między dwoma hostami?

Jakie pole znajduje się w nagłówku protokołu UDP?

Jakie jest zadanie usługi DNS?

Wskaź zestaw wykorzystywany do diagnozowania logicznych systemów elektronicznych na płycie głównej komputera, który nie reaguje na próbę uruchomienia zasilania?

Protokół ARP (Address Resolution Protocol) pozwala na przypisanie logicznych adresów warstwy sieciowej do rzeczywistych adresów warstwy