Pytanie 1

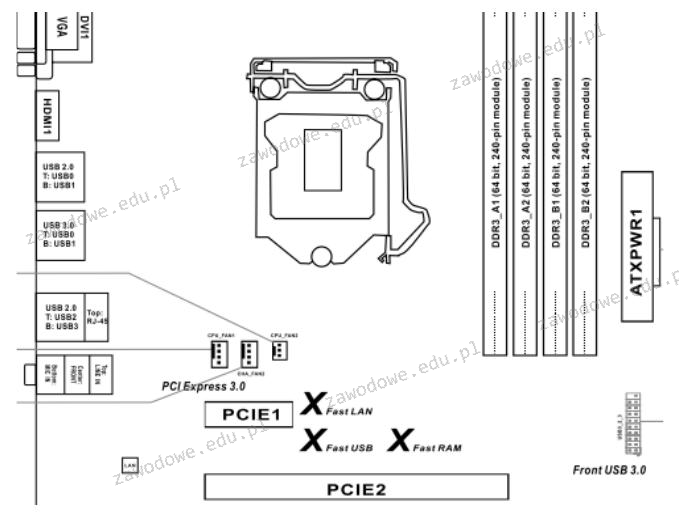

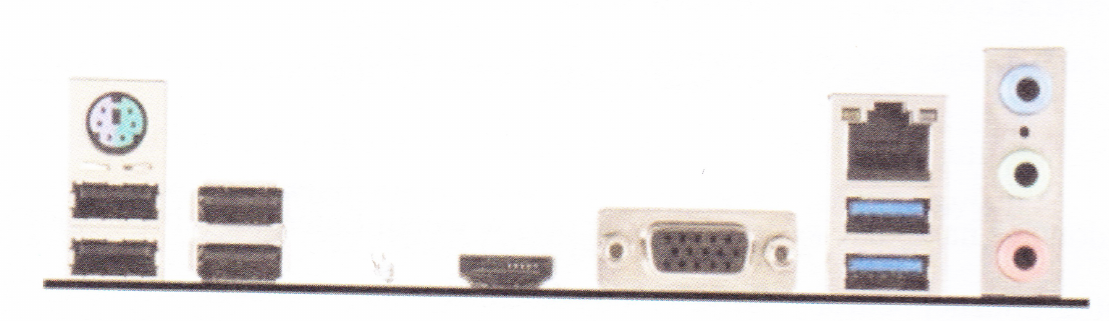

Zidentyfikuj interfejsy znajdujące się na panelu tylnym płyty głównej:

Wynik: 14/40 punktów (35,0%)

Wymagane minimum: 20 punktów (50%)

Zidentyfikuj interfejsy znajdujące się na panelu tylnym płyty głównej:

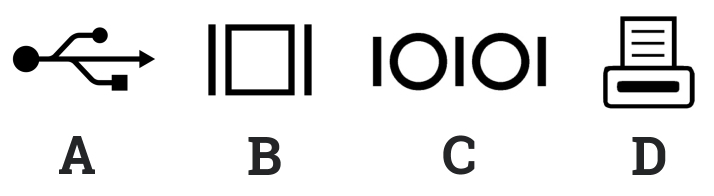

Wskaż ilustrację ilustrującą symbol stosowany do oznaczania portu równoległego LPT?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

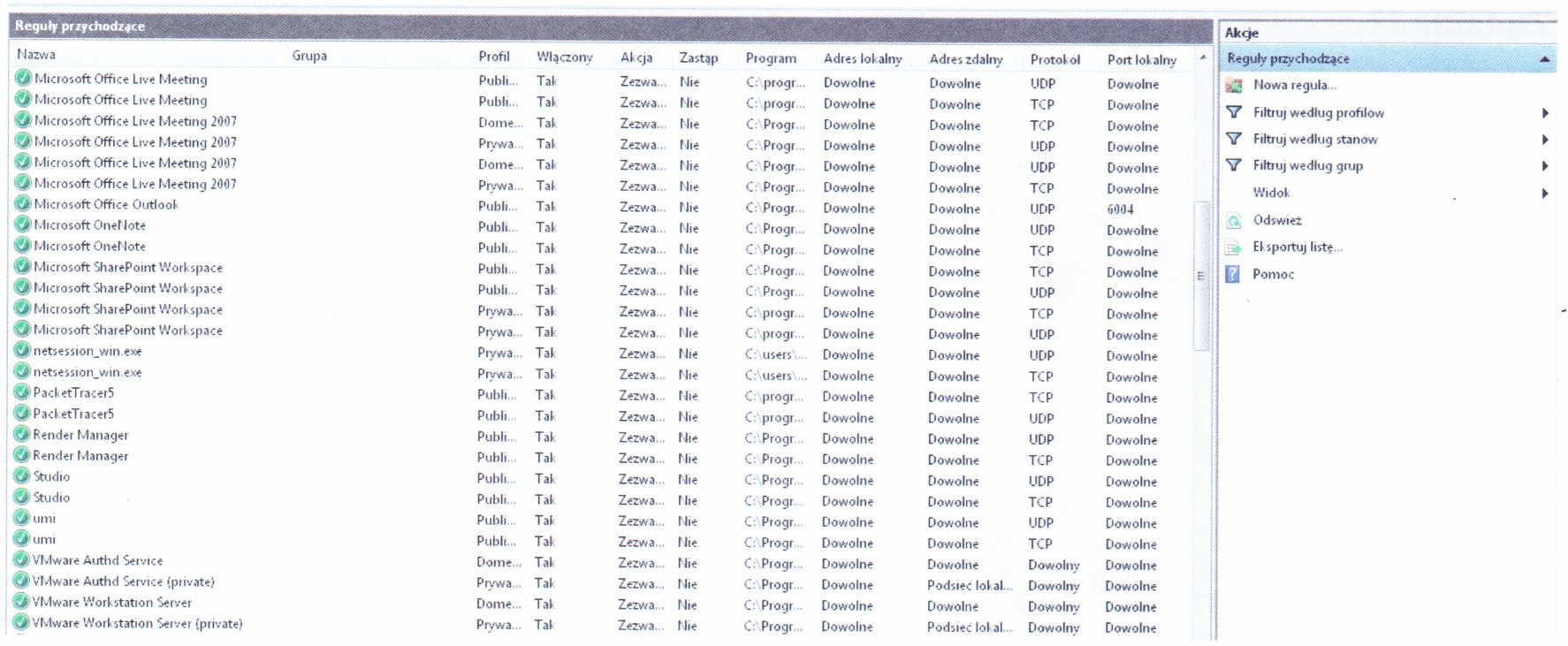

Pokazany zrzut ekranu dotyczy programu

Funkcja Intel Turbo Boost w mikroprocesorze umożliwia

Jak ustawić w systemie Windows Server 2008 parametry protokołu TCP/IP karty sieciowej, aby komputer mógł jednocześnie funkcjonować w dwóch sieciach lokalnych o różnych adresach IP?

Polecenie to zostało wydane przez Administratora systemu operacyjnego w trakcie ręcznej konfiguracji sieciowego interfejsu. Wynikiem wykonania tego polecenia jest ```netsh interface ip set address name="Glowna" static 151.10.10.2 255.255.0.0 151.10.0.1```

Jaki adres IP został przypisany do hosta na interfejsie sieciowym eth0?

[root@ipv6 tspc]# ifconfig

eth0 Link encap:Ethernet HWaddr 00:A0:C9:89:02:F8

inet addr:128.171.104.26 Bcast:128.171.104.255 Mask:255.255.255.0

inet6 addr: fe80::2a0:c9ff:fe89:2f8/10 Scope:Link

UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1

RX packets:663940 errors:0 dropped:0 overruns:0 frame:0

TX packets:67717 errors:0 dropped:0 overruns:0 carrier:0

collisions:7797 txqueuelen:100

RX bytes:234400485 (223.5 Mb) TX bytes:17743338 (16.9 Mb)

Interrupt:10 Base address:0xef80

lo Link encap:Local Loopback

inet addr:127.0.0.1 Mask:255.0.0.0

inet6 addr: ::1/128 Scope:Host

UP LOOPBACK RUNNING MTU:16436 Metric:1

RX packets:3070 errors:0 dropped:0 overruns:0 frame:0

TX packets:3070 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:0

RX bytes:153813 (150.2 Kb) TX bytes:153813 (150.2 Kb)

sit1 Link encap:IPv6-in-IPv4

inet6 addr: 3ffe:b80:2:482::2/64 Scope:Global

inet6 addr: fe80::80ab:681a/10 Scope:Link

UP POINTOPOINT RUNNING NOARP MTU:1480 Metric:1

RX packets:82 errors:0 dropped:0 overruns:0 frame:0

TX packets:78 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:0

RX bytes:8921 (8.7 Kb) TX bytes:8607 (8.4 Kb)Aby aktywować funkcję S.M.A.R.T. dysku twardego, która odpowiada za monitorowanie i wczesne ostrzeganie przed awariami, należy skorzystać z

Ile bajtów odpowiada jednemu terabajtowi?

Czym jest licencja OEM?

Jaki będzie rezultat odejmowania dwóch liczb zapisanych w systemie heksadecymalnym 60Ah - 3BFh?

Metoda przesyłania danych pomiędzy urządzeniami CD/DVD a pamięcią komputera w trybie bezpośredniego dostępu do pamięci to

Przed dokonaniem zakupu komponentu komputera lub urządzenia peryferyjnego na platformach aukcyjnych, warto zweryfikować, czy nabywane urządzenie ma wymagany w Polsce certyfikat

Który z wymienionych elementów stanowi część mechanizmu drukarki igłowej?

Aby chronić urządzenia w sieci LAN przed przepięciami oraz różnicami potencjałów, które mogą się pojawić w trakcie burzy lub innych wyładowań atmosferycznych, należy zastosować

Oprogramowanie diagnostyczne komputera pokazało komunikat NIC ERROR. Co ten komunikat wskazuje?

Ile maksymalnie kanałów z dostępnego pasma kanałów w standardzie 802.11b może być używanych w Polsce?

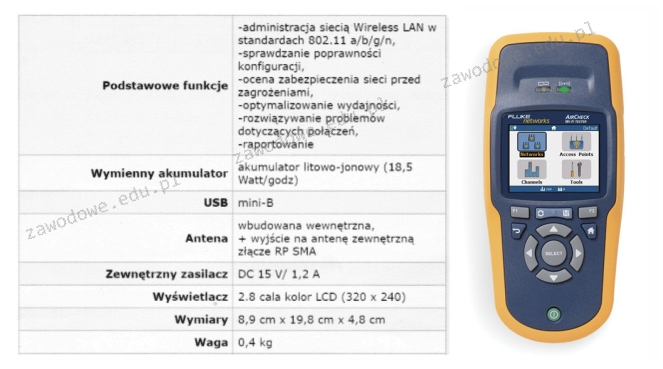

Jakie urządzenie diagnostyczne zostało zaprezentowane na ilustracji oraz opisane w specyfikacji zawartej w tabeli?

Magistrala PCI-Express wykorzystuje do transmisji danych metodę komunikacji

Do pielęgnacji elementów łożyskowych oraz ślizgowych w urządzeniach peryferyjnych wykorzystuje się

Gniazdo w sieciach komputerowych, które jednoznacznie identyfikuje dany proces na urządzeniu, stanowi kombinację

Użytkownik systemu Windows może logować się na każdym komputerze w sieci, korzystając z profilu, który jest przechowywany na serwerze i może być zmieniany przez użytkownika. Jak nazywa się ten profil?

Komputer stracił łączność z siecią. Jakie działanie powinno być podjęte w pierwszej kolejności, aby naprawić problem?

W systemie Windows Server, możliwość udostępnienia folderu jako zasobu sieciowego, który jest widoczny na stacji roboczej jako dysk oznaczony literą, można uzyskać poprzez realizację czynności

Serwisant zrealizował w ramach zlecenia działania przedstawione w poniższej tabeli. Całkowity koszt zlecenia obejmuje wartość usług wymienionych w tabeli oraz koszt pracy serwisanta, którego stawka za godzinę wynosi 60,00 zł netto. Oblicz całkowity koszt zlecenia brutto. Stawka VAT na usługi wynosi 23%.

| LP | Czynność | Czas wykonania w minutach | Cena usługi netto w zł |

|---|---|---|---|

| 1. | Instalacja i konfiguracja programu | 35 | 20,00 |

| 2. | Wymiana płyty głównej | 80 | 50,00 |

| 3. | Wymiana karty graficznej | 30 | 25,00 |

| 4. | Tworzenie kopii zapasowej i archiwizacja danych | 65 | 45,00 |

| 5. | Konfiguracja rutera | 30 | 20,00 |

Za pomocą narzędzia diagnostycznego Tracert można ustalić trasę do punktu docelowego. Przez ile routerów przeszedł pakiet wysłany dl hosta 172.16.0.99?

C:\>tracert 172.16.0.99 Trasa śledzenia do 172.16.0.99 z maksymalną liczbą przeskoków 30 | ||||

| 1 | 2 ms | 3 ms | 2 ms | 10.0.0.1 |

| 2 | 12 ms | 8 ms | 8 ms | 192.168.0.1 |

| 3 | 10 ms | 15 ms | 10 ms | 172.17.0.2 |

| 4 | 11 ms | 11 ms | 20 ms | 172.17.48.14 |

| 5 | 21 ms | 16 ms | 24 ms | 172.16.0.99 |

Śledzenie zakończone. | ||||

Jaki protokół jest używany przez komendę ping?

Switch jako kluczowy komponent występuje w sieci o strukturze

Jakie polecenie należy wydać, aby skonfigurować statyczny routing do sieci 192.168.10.0?

Do przechowywania fragmentów dużych plików programów i danych, które nie mieszczą się w pamięci, wykorzystuje się

Jakim wynikiem jest suma liczb binarnych 1001101 oraz 11001?

Proces, który uniemożliwia całkowicie odzyskanie danych z dysku twardego, to

Do kategorii oprogramowania określanego mianem malware (ang. malicious software) nie zalicza się oprogramowania typu

Które z kont nie jest standardowym w Windows XP?

Usługa odpowiedzialna za konwersję nazw domen na adresy sieciowe to

Usługa umożliwiająca przechowywanie danych na zewnętrznym serwerze, do którego dostęp możliwy jest przez Internet to

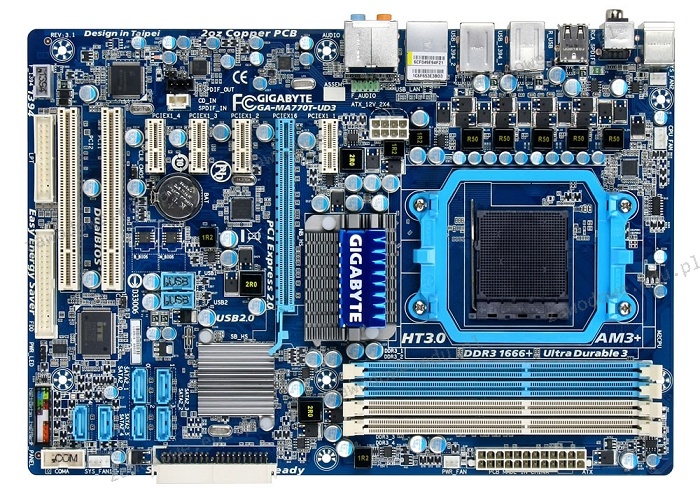

Do pokazanej na diagramie płyty głównej nie można podłączyć urządzenia, które korzysta z interfejsu

Na rysunku ukazany jest diagram blokowy zasilacza

Na wskazanej płycie głównej możliwe jest zainstalowanie procesora w obudowie typu