Pytanie 1

Który z poniższych systemów operacyjnych nie jest wspierany przez system plików ext4?

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Który z poniższych systemów operacyjnych nie jest wspierany przez system plików ext4?

Aby dostęp do systemu Windows Serwer 2016 był możliwy dla 50 urządzeń, bez względu na liczbę użytkowników, należy w firmie zakupić licencję

Ile wyniesie całkowity koszt wymiany karty sieciowej w komputerze, jeżeli cena karty to 40 zł, czas pracy serwisanta wyniesie 90 minut, a koszt każdej rozpoczętej roboczogodziny to 60 zł?

W biurze należy zamontować 5 podwójnych gniazd abonenckich. Średnia odległość od lokalnego punktu dystrybucyjnego do gniazda abonenckiego wynosi 10m. Jaki będzie przybliżony koszt zakupu kabla UTP kategorii 5e do utworzenia sieci lokalnej, jeśli cena brutto za 1m kabla UTP kategorii 5e wynosi 1,60 zł?

Medium transmisyjne oznaczone symbolem S/FTP to skrętka

Jak najlepiej chronić zebrane dane przed dostępem w przypadku kradzieży komputera?

W dokumentacji dotyczącej karty dźwiękowej można znaleźć informację: częstotliwość próbkowania 22 kHz oraz rozdzielczość próbkowania 16 bitów. Jaka będzie przybliżona objętość pliku audio z 10-sekundowym nagraniem mono (jednokanałowym)?

Obudowa oraz wyświetlacz drukarki fotograficznej są bardzo zabrudzone. W celu ich oczyszczenia, należy zastosować

Drukarka, która zapewnia zdjęcia o wysokiej jakości to drukarka

Który z wymienionych systemów operacyjnych nie obsługuje wielozadaniowości?

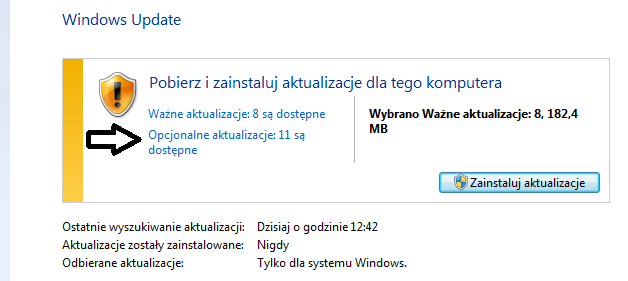

Jeśli użytkownik wybierze pozycję wskazaną strzałką, będzie mógł zainstalować aktualizacje

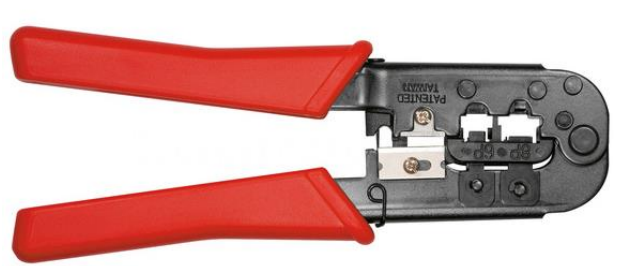

Narzędzie pokazane na ilustracji służy do

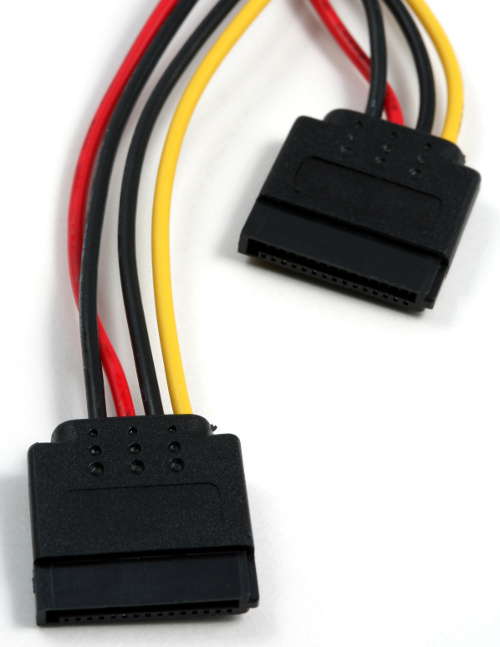

Jakie kable powinny być używane z narzędziem pokazanym na fotografii?

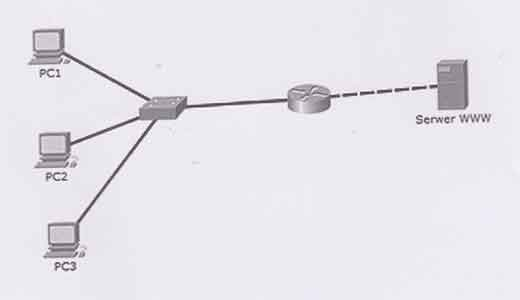

Użytkownicy w sieci lokalnej mogą się komunikować między sobą, lecz nie mają możliwości połączenia z serwerem WWW. Wynik polecenia ping z komputerów do bramy jest pozytywny. Który element sieci nie może być źródłem problemu?

Zainstalowanie w komputerze wskazanej karty pozwoli na

Jak nazywa się magistrala, która w komputerze łączy procesor z kontrolerem pamięci i składa się z szyny adresowej, szyny danych oraz linii sterujących?

echo off echo ola.txt >> ala.txt pauseJakie będą skutki wykonania podanego skryptu?

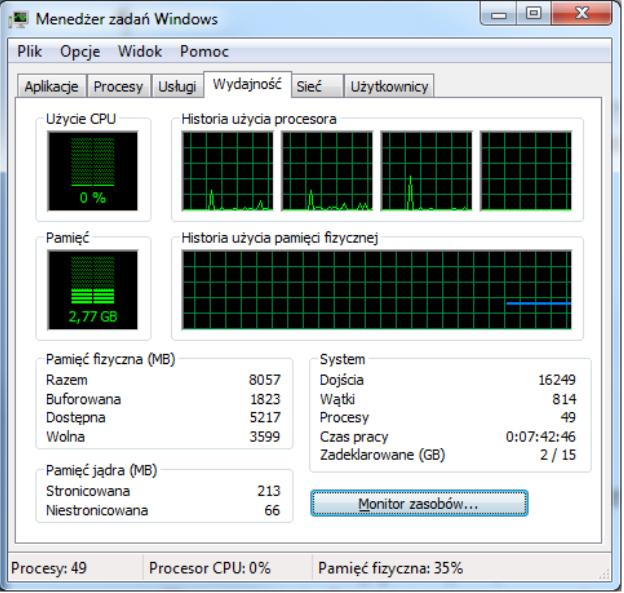

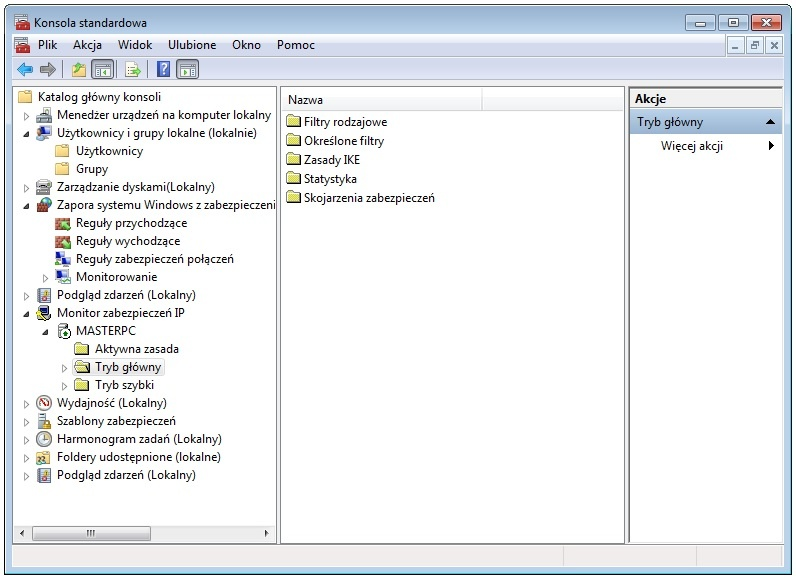

Aby uruchomić przedstawione narzędzie w systemie Windows, jakie polecenie należy zastosować?

Symbol przedstawiony na ilustracji oznacza produkt

Do czego służy program firewall?

Tworzenie obrazu dysku ma na celu

Czym jest postcardware?

Aby zwiększyć wydajność komputera, można zainstalować procesor obsługujący technologię Hyper-Threading, która pozwala na

Rejestry procesora są resetowane poprzez

Przypisanie licencji oprogramowania do pojedynczego komputera lub jego komponentów stanowi charakterystykę licencji

Najwyższy stopień zabezpieczenia sieci bezprzewodowej zapewnia szyfrowanie

Jaka jest maksymalna prędkość przesyłania danych w sieci lokalnej, w której wykorzystano przewód UTP kat.5e do budowy infrastruktury kablowej?

Zidentyfikuj powód pojawienia się komunikatu, który widoczny jest na ilustracji.

Jakie jest najwyższe możliwe tempo odczytu płyt CD-R w urządzeniu o oznaczeniu x48?

Które urządzenie należy zainstalować, w celu zwiększenia obszaru zasięgu sieci bezprzewodowej?

Okno narzędzia przedstawionego na ilustracji można uzyskać poprzez wykonanie polecenia

Podczas pracy wskaźnik przewodowej myszy optycznej nie reaguje na przesuwanie urządzenia po padzie, dopiero po odpowiednim ułożeniu myszy kursor zaczyna zmieniać położenie. Objawy te wskazują na uszkodzenie

Ikona z wykrzyknikiem, którą widać na ilustracji, pojawiająca się przy nazwie urządzenia w Menedżerze urządzeń, wskazuje, że to urządzenie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Aplikacją, która umożliwia wyświetlenie listy aktywnych urządzeń w sieci LAN, jest

W drukarce laserowej do utrwalenia wydruku na papierze stosuje się

Atak typu hijacking na serwer internetowy charakteryzuje się

Jaką liczbę warstw określa model ISO/OSI?

Na przedstawionym zdjęciu złącza pozwalają na

Do stworzenia projektu sieci komputerowej dla obiektu szkolnego najlepiej użyć edytora grafiki wektorowej, którym jest oprogramowanie