Pytanie 1

Jakie złącze jest opisywane skrótem SC/APC?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Jakie złącze jest opisywane skrótem SC/APC?

Parametr określający niezawodność działania dysku twardego to

Który z poniższych opisów odnosi się do telefonicznej łącznicy pośredniej?

Keyloggery to aplikacje, które

Sygnał zgłoszenia z centrali jest przesyłany do abonenta jako

Zgodnie z zasadą Kotielnikowa-Shannona częstotliwość próbkowania powinna wynosić

Maksymalna wartość tłumienia dla poprawnie wykonanych spawów światłowodów telekomunikacyjnych wynosi

Rysunek przedstawia złącze w kolorze szarym

GPRS (General Packet Radio Services) definiuje się jako

Podczas montażu światłowodu kluczowymi parametrami, ze względu na ich właściwości mechaniczne, są:

Na stanowisku komputerowym szerokość oraz głębokość blatu powinny umożliwiać umieszczenie klawiatury z zachowaniem odpowiedniej przestrzeni pomiędzy klawiaturą a przednią krawędzią blatu. Ta odległość musi wynosić

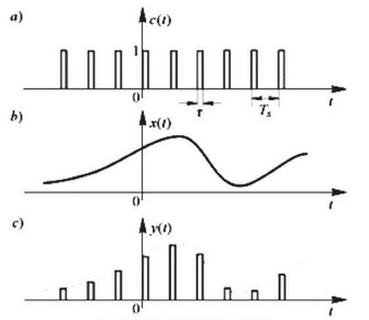

Jaką modulację przedstawiają wykresy, na którym są zamieszczone przebiegi sygnału nośnego (rys. a), sygnału modulującego (rys. b) i sygnału zmodulowanego (rys. c)?

Można zrezygnować z obowiązku udzielenia pomocy przedmedycznej zgodnie z art.162 Kodeksu Karnego jedynie w sytuacji, gdy

Jakie cechy ma licencja oprogramowania Donationware?

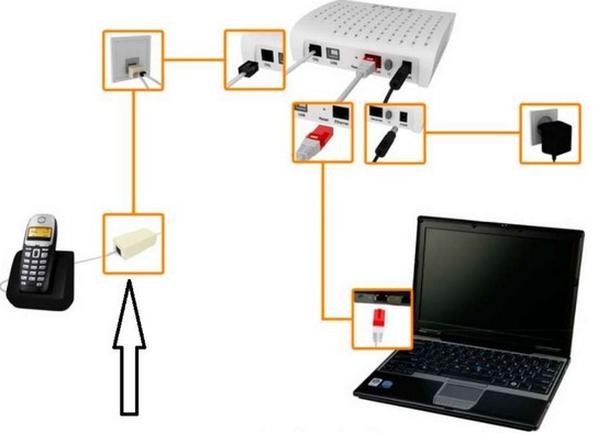

Na rysunku strzałką wskazano filtr

Węzeł w systemie telekomunikacyjnym to

Która klasa kabla UTP pozwala na przesył danych z prędkością 1000 Mbit/s?

Wskaźniki stosowane przez protokoły routingu nie biorą pod uwagę

Najskuteczniejszym sposobem ochrony komputera przed złośliwym oprogramowaniem jest

Który z poniższych adresów jest adresem niepublicznym?

Sygnalizacja odnosi się do wymiany informacji związanych

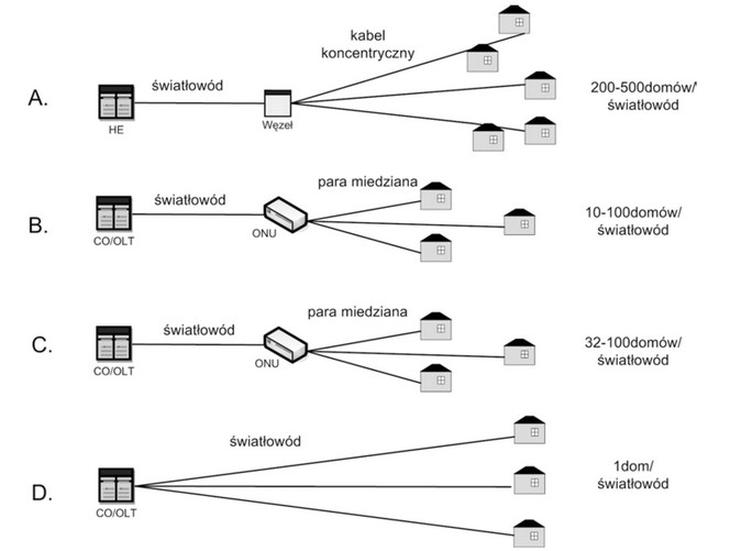

Zamieszczony rysunek przedstawia

W systemie Windows narzędzie quota służy do ustanawiania ograniczeń

Jak można zdiagnozować nieciągłość w kablu światłowodowym?

Która z metod polega na tworzeniu na żądanie połączenia między dwiema lub więcej stacjami końcowymi, które pozostaje do ich wyłącznego użytku aż do momentu rozłączenia?

Funkcja MSN (Multiple Subscriber Number) w systemie ISDN pozwala na

Na którym schemacie blokowym jest przedstawiona struktura sieci FTTH (Fiber to the home)?

W tabeli zamieszczono fragment dokumentacji technicznej przełącznika. Jaka jest maksymalna prędkość transmisji tego przełącznika?

| The front panel of the Switch consists of LED indicators for Power, Console, Link/Act and Speed, 16 Fast-Ethernet ports and a 100BASE-FX Ethernet port. Also, the front panel has a RS-232 communication port. |

Jak długo trwa ramka STM-1 w technologii SDH przy przepływności 155 Mbit/s?

Jakim kolorem oznacza się patchord światłowodowy jednomodowy?

Jak definiuje się dokładność przetwornika C/A?

Ile wynosi nominalna przepływność systemu transmisyjnego oznaczonego symbolem E4?

Aby stacje podłączone do routera mogły automatycznie otrzymać konfigurację sieciową (np. adres IP, adres bramy), należy w tym samym segmencie sieci, gdzie znajdują się stacje oraz router, zainstalować i uruchomić serwer

Jakie jednostki są używane do opisu zysku energetycznego anten?

Który kabel powinno się wybrać do stworzenia sieci teleinformatycznej w obszarze, w którym występują intensywne zakłócenia elektromagnetyczne?

Co oznacza skrót SSH w kontekście protokołów?

Jak wiele razy w systemie SDH przepływność jednostki transportowej STM-4 przewyższa przepływność jednostki transportowej STM-1?

Jaką trasę należy ustawić, aby zapewnić najwyższą wiarygodność informacji o ścieżkach uzyskanych przez ruter?

Jakie polecenie należy użyć, aby otrzymać listę zainstalowanych pakietów w systemie Linux?

Podstawową miarą przepływności w medium transmisyjnym jest ilość