Pytanie 1

Który z rodzajów rekordów DNS w systemach Windows Server określa alias (inną nazwę) dla rekordu A związanej z kanoniczną (rzeczywistą) nazwą hosta?

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Który z rodzajów rekordów DNS w systemach Windows Server określa alias (inną nazwę) dla rekordu A związanej z kanoniczną (rzeczywistą) nazwą hosta?

Optyczna rozdzielczość to jeden z właściwych parametrów

Aby podłączyć drukarkę igłową o wskazanych parametrach do komputera, należy umieścić kabel dołączony do drukarki w porcie

Aby zwiększyć lub zmniejszyć rozmiar ikony na pulpicie, należy obracać kółkiem myszy, trzymając jednocześnie wciśnięty klawisz

W trakcie instalacji systemu Windows Serwer 2022 istnieje możliwość instalacji w trybie Core. Oznacza to, że system zostanie zainstalowany

Aby zorganizować pliki na dysku w celu poprawy wydajności systemu, należy:

Na zdjęciu widać kartę

Do wykonania obrazu dysku twardego można użyć programu

W lokalnej sieci protokołem odpowiedzialnym za dynamiczną konfigurację adresów IP jest

Jakie urządzenie stosuje się do pomiaru rezystancji?

Jakie oprogramowanie nie jest przeznaczone do diagnozowania komponentów komputera?

Nieprawidłowa forma zapisu liczby 778 to

Które z wymienionych oznaczeń wskazuje, że jest to kabel typu skrętka z podwójnym ekranowaniem?

Usługi na serwerze są konfigurowane za pomocą

Narzędziem wykorzystywanym do diagnozowania połączeń między komputerami w systemie Windows jest

Po wykonaniu instalacji z domyślnymi parametrami system Windows XP NIE OBSŁUGUJE formatu systemu plików

Aby w edytorze Regedit przywrócić stan rejestru systemowego za pomocą wcześniej utworzonej kopii zapasowej, należy użyć funkcji

Aby w systemie Windows Professional ustawić czas pracy drukarki oraz uprawnienia drukowania, należy skonfigurować

Który z poniższych adresów należy do klasy B?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

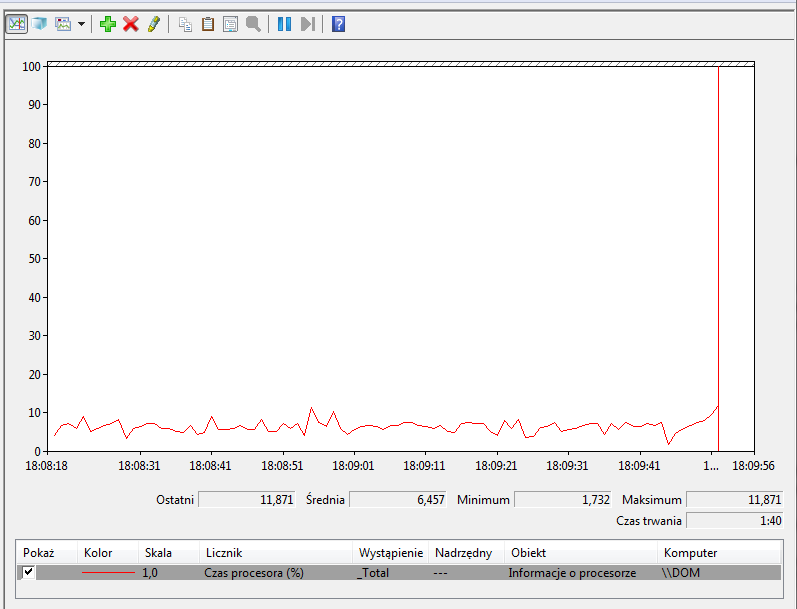

By uruchomić w systemie Windows oprogramowanie narzędziowe monitorujące wydajność komputera przedstawione na rysunku, należy uruchomić

Zbiór zasad określających metodę wymiany danych w sieci to

Dokumentacja końcowa dla planowanej sieci LAN powinna między innymi zawierać

Wynikiem wykonania komendy arp -a 192.168.1.1 w systemie MS Windows jest pokazanie

Zgodnie z ustawą z 14 grudnia 2012 roku o odpadach, wymagane jest

Standardowe napięcie zasilające dla modułów pamięci RAM DDR4 wynosi

Złącze widoczne na obrazku pozwala na podłączenie

W systemie Windows, aby uruchomić usługę związaną z wydajnością komputera, należy użyć polecenia

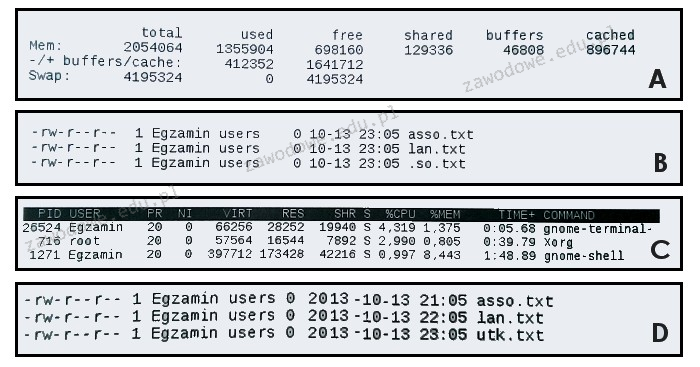

Wynik wykonania polecenia ```ls -l``` w systemie Linux przedstawia poniższy rysunek

Liczba BACA zapisana w systemie szesnastkowym odpowiada liczbie

Jaki adres IP został przypisany do hosta na interfejsie sieciowym eth0?

[root@ipv6 tspc]# ifconfig

eth0 Link encap:Ethernet HWaddr 00:A0:C9:89:02:F8

inet addr:128.171.104.26 Bcast:128.171.104.255 Mask:255.255.255.0

inet6 addr: fe80::2a0:c9ff:fe89:2f8/10 Scope:Link

UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1

RX packets:663940 errors:0 dropped:0 overruns:0 frame:0

TX packets:67717 errors:0 dropped:0 overruns:0 carrier:0

collisions:7797 txqueuelen:100

RX bytes:234400485 (223.5 Mb) TX bytes:17743338 (16.9 Mb)

Interrupt:10 Base address:0xef80

lo Link encap:Local Loopback

inet addr:127.0.0.1 Mask:255.0.0.0

inet6 addr: ::1/128 Scope:Host

UP LOOPBACK RUNNING MTU:16436 Metric:1

RX packets:3070 errors:0 dropped:0 overruns:0 frame:0

TX packets:3070 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:0

RX bytes:153813 (150.2 Kb) TX bytes:153813 (150.2 Kb)

sit1 Link encap:IPv6-in-IPv4

inet6 addr: 3ffe:b80:2:482::2/64 Scope:Global

inet6 addr: fe80::80ab:681a/10 Scope:Link

UP POINTOPOINT RUNNING NOARP MTU:1480 Metric:1

RX packets:82 errors:0 dropped:0 overruns:0 frame:0

TX packets:78 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:0

RX bytes:8921 (8.7 Kb) TX bytes:8607 (8.4 Kb)W którym modelu płyty głównej można zamontować procesor o podanych parametrach?

| Intel Core i7-4790 3,6 GHz 8MB cache s. 1150 Box |

W złączu zasilania SATA uszkodzeniu uległ żółty kabel. Jakie to ma konsekwencje dla napięcia, które nie jest przesyłane?

Diagnostykę systemu Linux można przeprowadzić używając polecenia

Architecture: x86_64 CPU op-mode(s): 32-bit, 64-bit Byte Order: Little Endian CPU(s): 8 On-line CPU(s) list: 0-7 Thread(s) per core: 2 Core(s) per socket: 4 Socket(s): 1 NUMA node(s): 1 Vendor ID: GenuineIntel CPU family: 6 Model: 42 Stepping: 7 CPU MHz: 1600.000 BogoMIPS: 6784.46 Virtualization: VT-x L1d cache: 32K L1i cache: 32K L2 cache: 256K L3 cache: 8192K NUMA node0 CPU(s): 0-7

Jakie urządzenie jest kluczowe dla połączenia pięciu komputerów w sieci o strukturze gwiazdy?

Który z protokołów jest używany w komunikacji głosowej przez internet?

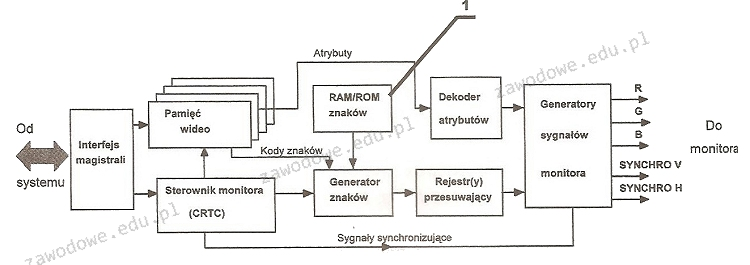

Element oznaczony cyfrą 1 na diagramie blokowym karty graficznej?

Które bity w 48-bitowym adresie MAC identyfikują producenta?

Aby przetestować funkcjonowanie serwera DNS w systemach Windows Server, można skorzystać z narzędzia nslookup. Jeśli w poleceniu podamy nazwę komputera, np. nslookup host.domena.com, to dojdzie do weryfikacji

W norma PN-EN 50174 brak jest wskazówek odnoszących się do