Pytanie 1

Do badania przewodnictwa powietrznego i kostnego służy

Wynik: 40/40 punktów (100,0%)

Wymagane minimum: 20 punktów (50%)

Do badania przewodnictwa powietrznego i kostnego służy

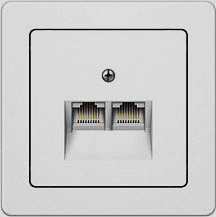

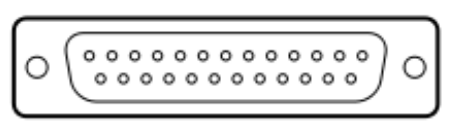

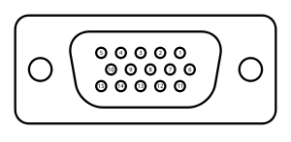

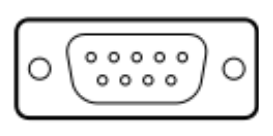

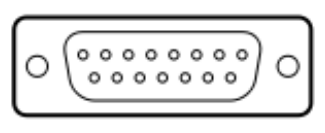

W sieci centralnego monitoringu zamontowane są gniazda przedstawione na rysunku. Jakiego typu wtykami muszą być zakończone kable?

Jaki wpływ na organizm ludzki ma promieniowanie podczerwone IR?

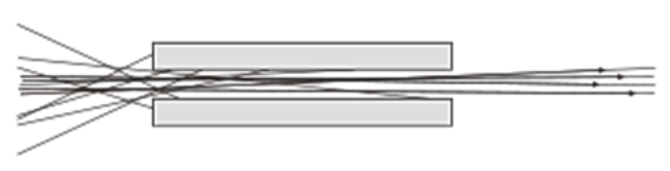

Przedstawiony na rysunku kolimator stanowi część

Przepływ przez organizm człowieka prądów o wysokiej częstotliwości, mających zastosowanie w elektrochirurgii, może powodować

Zasilacz, który podczas normalnej pracy zasila urządzenie, jednocześnie ładując akumulator, a podczas awarii zasilania sieciowego zasila urządzenie z akumulatora, oznaczany jest skrótem

Płyta jednostronna dwuwarstwowa DVD pozwala na przechowanie danych o pojemności około

Jak nazywa się w programowaniu obiektowym instancję klasy?

Organizm człowieka ma zakłóconą zdolność do termoregulacji, gdy wartość temperatury wewnętrznej organizmu spada poniżej

Ilość jodu-131 podana pacjentowi w terapii tarczycy zmniejszy się o połowę po

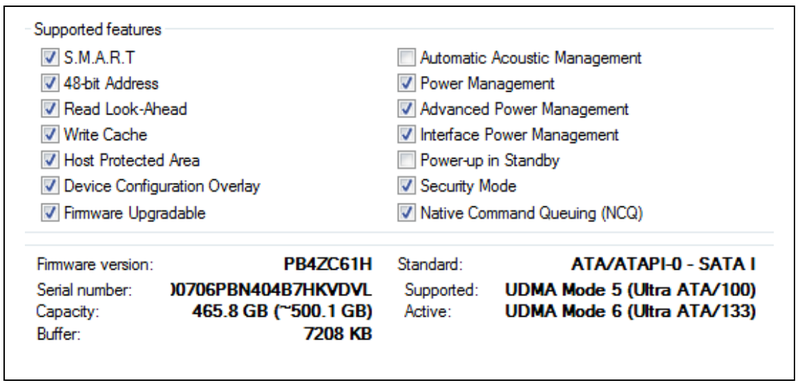

Przedstawiony fragment dokumentacji dotyczy

Częstotliwość: 2.0-10.0MHz; Tryb obrazowania: B, B/B, B/M, M, 4B; Dynamiczne 4-stopniowe ogniskowanie; |

Które urządzenie medyczne wspomaga lub zastępuje mięśnie pacjenta w oddychaniu?

Aby usunąć katalog w systemie Windows należy wykonać polecenie

Na zdjęciu przedstawiono

Pod wpływem bodźca świetlnego, dźwiękowego lub czuciowego mózg generuje elektryczne potencjały wywołane rejestrowane przez

W dokumentacji sieci centralnego monitoringu zapisano, że sieć jest wykonana w standardzie 802.11 Do montażu takiej sieci są wymagane urządzenia wykorzystujące

Która konsola MMC pozwala na zmianę ważności hasła i ustawienie blokady hasła po określonej liczbie logowań?

Jaki powinien być ustawiony adres maski podsieci, aby umożliwiał podłączenie maksymalnie 30 urządzeń?

W urządzeniu medycznym wyznaczono charakterystykę filtru jak na rysunku. Jest to filtr

Która usługa serwera przydziela adresy IP komputerom w sieci LAN?

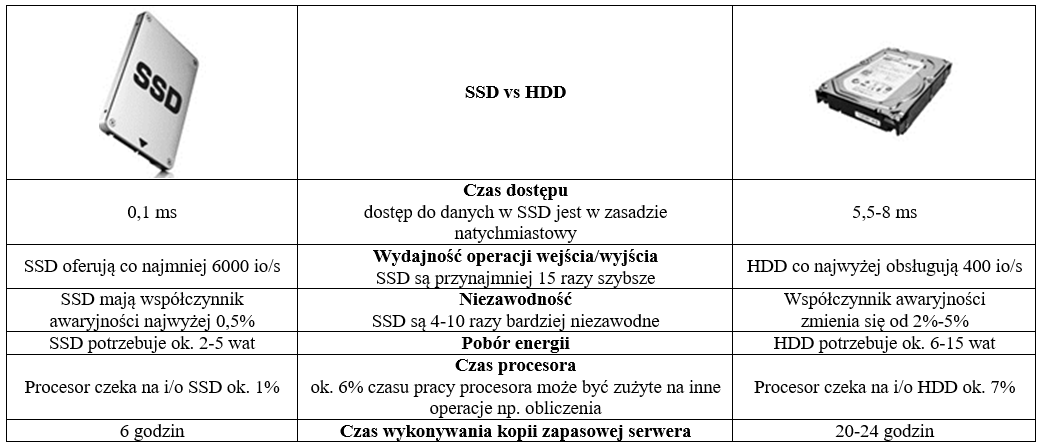

W tabeli zestawiono parametry pamięci półprzewodnikowej i pamięci magnetycznej. Zastosowanie którego rodzaju pamięci umożliwi szybszą pracę komputera?

W systemie bazodanowym wymagane jest dodatkowe sprzętowe zabezpieczenie danych przed ich utratą. Która macierz dyskowa pozwala uodpornić się na utratę danych w przypadku awarii wszystkich dysków poza jednym?

Pojęcie „Architektura Harvardska” odnosi się do

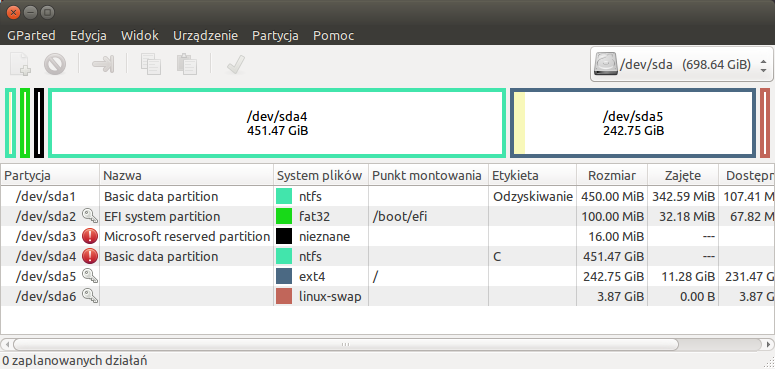

Ile dysków i z jakim interfejsem zostało wykazanych na zrzucie programu GParted?

Podstawowym elementem sztucznej nerki jest pompa do przetłaczania krwi, zwana

Sterowniki klawiatury, magistral i przerwań są elementami

Z przedstawionego zrzutu wynika, że na dyskach zastosowano partycjonowanie

W celu archiwizacji danych w systemie Windows, jest wymagane kopiowanie z katalogu źródłowego (kat_zrodlowy) do katalogu docelowego (kat_docelowy). Do kopiowania danych należy użyć polecenia

Do zaktualizowania rekordu tabeli należy zastosować polecenie

Fale mózgowe alfa, beta, gamma, delta i theta są rejestrowane w

Struktura anatomiczna człowieka, która jest nazywana krytyczną ze względu na szczególną wrażliwość na zewnętrzne promieniowanie jonizujące, to

Który system plików jest dedykowany systemowi Linux oraz nie jest używany w systemie Windows?

Nie uzyskamy pomocy na temat polecenia „net” w wierszu poleceń systemu Windows wpisując

Zgodnie z przedstawionym opisem, gniazdo interfejsu służące do podłączenia audiometru ze stanowiskiem komputerowym przedstawione jest na rysunku

| Opis: |

| − 125 Hz ÷ 8.000 Hz − -10 dB do 120 dB HL na wyjściu − połączenie z komputerem PC – interfejs RS232 − połączenie z drukarką laserową − połączenie z drukarką atramentową |

Który rozdzielacz sygnału należy zastosować w celu wykorzystania jednego przewodu U/UTP5e do podłączenia dwóch urządzeń do sieci LAN?

W zabiegu jonoforezy leki są transportowane przez skórę do głębiej położonych warstw poprzez zastosowanie

Badanie obrazujące fizyczny rozwój płodu wykonywane jest przy użyciu

Który zabieg wymusza naprzemienną pracę mięśni zginaczy i prostowników poprzez stymulację mięśni impulsem prądowym?

Która tkanka najsilniej pochłania fale ultradźwiękowe?

Przedstawiony zrzut ekranu prezentuje parametry