Pytanie 1

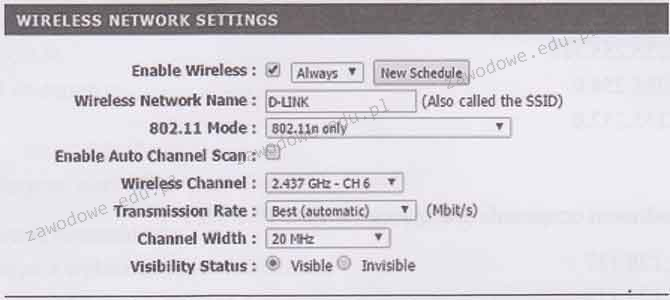

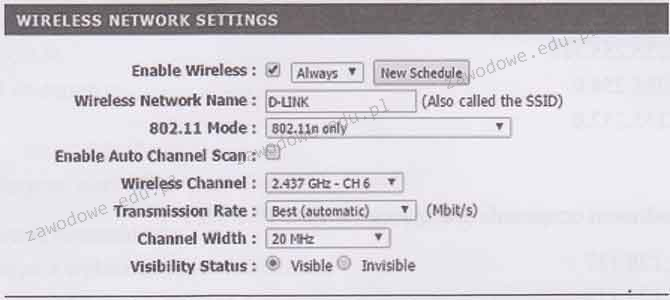

Który z parametrów w ustawieniach punktu dostępowego działa jako login używany podczas próby połączenia z punktem dostępowym w sieci bezprzewodowej?

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Który z parametrów w ustawieniach punktu dostępowego działa jako login używany podczas próby połączenia z punktem dostępowym w sieci bezprzewodowej?

Jakie polecenie diagnostyczne powinno się użyć, aby uzyskać informacje na temat tego, czy miejsce docelowe odpowiada oraz po jakim czasie nastąpiła odpowiedź?

W oznaczeniu procesora INTEL CORE i7-4790 liczba 4 wskazuje na

Gdzie w systemie Linux umieszczane są pliki specjalne urządzeń, które są tworzone podczas instalacji sterowników?

Program df pracujący w systemach z rodziny Linux pozwala na wyświetlenie

Jakie urządzenia wyznaczają granice domeny rozgłoszeniowej?

W których nośnikach pamięci masowej jedną z najczęstszych przyczyn uszkodzeń jest uszkodzenie powierzchni?

Toner stanowi materiał eksploatacyjny w drukarce

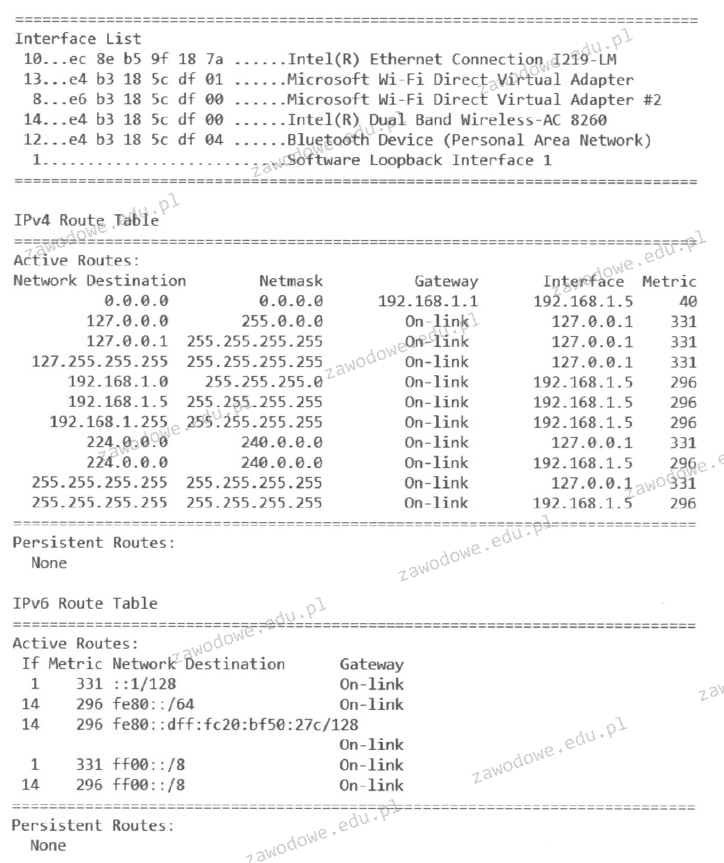

Informacje, które zostały pokazane na wydruku, uzyskano w wyniku wykonania

Zgodnie z normą EIA/TIA T568B, żyły pary odbiorczej w skrętce są pokryte izolatorem w kolorze

Urządzenie warstwy dystrybucji, które umożliwia komunikację pomiędzy różnymi sieciami, to

W systemie Windows przy użyciu polecenia assoc można

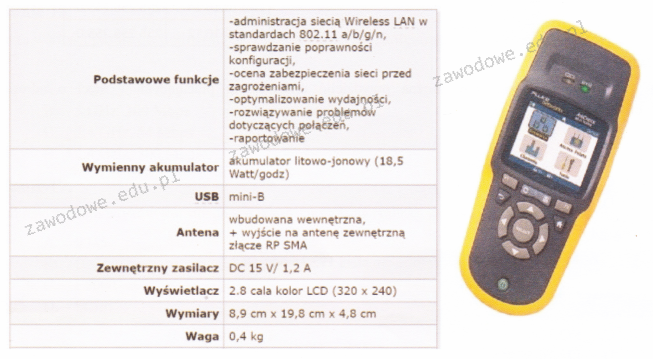

Jakie urządzenie diagnostyczne jest pokazane na ilustracji oraz opisane w specyfikacji zawartej w tabeli?

Jaki adres IP w formacie dziesiętnym odpowiada adresowi IP 10101010.00001111.10100000.11111100 zapisanym w formacie binarnym?

Polecenie df w systemie Linux umożliwia

Dwie stacje robocze w tej samej sieci nie są w stanie się skomunikować. Która z poniższych okoliczności może być przyczyną opisanego problemu?

Dokument mający na celu przedstawienie oferty cenowej dla inwestora dotyczącej przeprowadzenia robót instalacyjnych w sieci komputerowej, to

Na zdjęciu widać

Zgodnie z normą PN-EN 50174, maksymalna długość kabla poziomego kategorii 6 pomiędzy punktem abonenckim a punktem dystrybucji w panelu krosowym wynosi

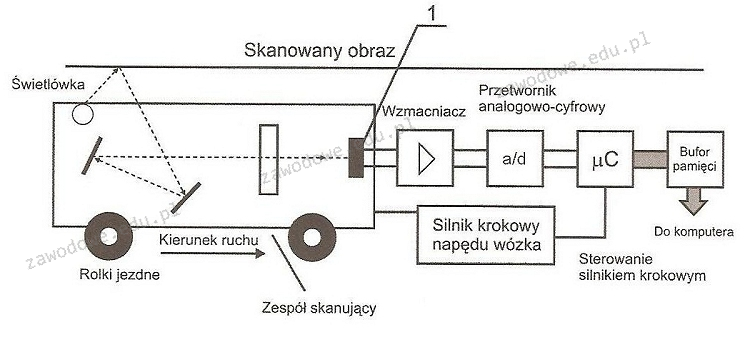

Na diagramie działania skanera, element oznaczony numerem 1 odpowiada za

Na wydruku z drukarki laserowej występują jasne i ciemne fragmenty. Jakie działania należy podjąć, by poprawić jakość druku oraz usunąć problemy z nieciągłością?

Po podłączeniu działającej klawiatury do jednego z portów USB nie ma możliwości wyboru awaryjnego trybu uruchamiania systemu Windows. Mimo to po uruchomieniu systemu w standardowym trybie klawiatura funkcjonuje prawidłowo. Co to oznacza?

Każdy następny router IP na ścieżce pakietu

Jak można zwolnić miejsce na dysku, nie tracąc przy tym danych?

Jakie urządzenie powinno być użyte w sieci Ethernet, aby zredukować liczbę kolizji pakietów?

W którym z rejestrów wewnętrznych procesora są przechowywane dodatkowe informacje o wyniku realizowanej operacji?

Jakie narzędzie jest używane w systemie Windows do przywracania właściwych wersji plików systemowych?

W dokumentacji jednego z komponentów komputera zawarto informację, że urządzenie obsługuje OpenGL. Jakiego elementu dotyczy ta dokumentacja?

Instalacja systemów Linux oraz Windows 7 przebiegła bez problemów. Oba systemy zainstalowały się prawidłowo z domyślnymi konfiguracjami. Na tym samym komputerze, o tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Narzędzie, które chroni przed nieautoryzowanym dostępem do sieci lokalnej, to

Wskaż cechę platformy wirtualizacji Hyper-V.

Protokołem umożliwiającym dostęp do sieci pakietowej o prędkości nieprzekraczającej 2 Mbit/s jest protokół

Który z protokołów NIE jest używany do ustawiania wirtualnej sieci prywatnej?

Zanim przystąpisz do modernizacji komputerów osobistych oraz serwerów, polegającej na dodaniu nowych modułów pamięci RAM, powinieneś zweryfikować

Na ilustracji przedstawiony jest tylny panel jednostki komputerowej. Jakie jest nazewnictwo dla złącza oznaczonego strzałką?

Główny punkt, z którego odbywa się dystrybucja okablowania szkieletowego, to punkt

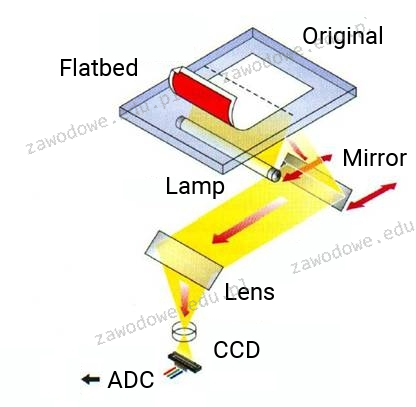

Jakie urządzenie jest przedstawione na rysunku?

Zaprezentowany schemat ilustruje funkcjonowanie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

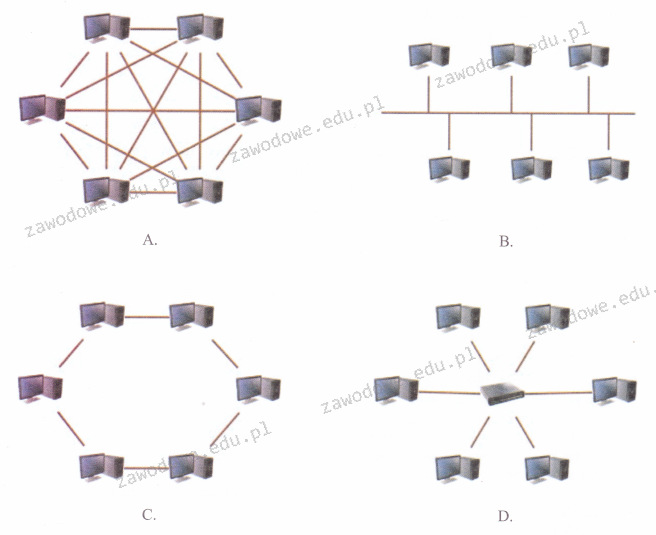

Która z zaprezentowanych na rysunkach topologii odpowiada topologii siatki?