Pytanie 1

Długi oraz dwa krótkie dźwięki sygnałowe BIOS POST od AMI i AWARD sygnalizują problem

Wynik: 39/40 punktów (97,5%)

Wymagane minimum: 20 punktów (50%)

Długi oraz dwa krótkie dźwięki sygnałowe BIOS POST od AMI i AWARD sygnalizują problem

W jaki sposób skonfigurować zaporę Windows, aby spełniała zasady bezpieczeństwa i umożliwiała użycie polecenia ping do weryfikacji komunikacji z innymi urządzeniami w sieci?

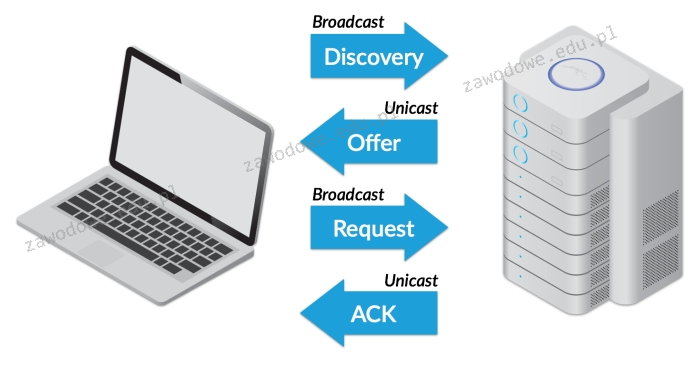

Wykonanie na komputerze z systemem Windows poleceń ipconfig /release oraz ipconfig /renew umożliwia weryfikację, czy usługa w sieci działa poprawnie

Który podzespół nie jest kompatybilny z płytą główną MSI A320M Pro-VD-S socket AM4, 1 x PCI-Ex16, 2 x PCI-Ex1, 4 x SATA III, 2 x DDR4- max 32 GB, 1 x D-SUB, 1x DVI-D, ATX?

Aby zasilić najbardziej wydajne karty graficzne, konieczne jest dodatkowe 6-pinowe gniazdo zasilacza PCI-E, które dostarcza napięcia

Jaki adres IPv6 jest stosowany jako adres link-local w procesie autokonfiguracji urządzeń?

Aby zrealizować iloczyn logiczny z uwzględnieniem negacji, jaki funktor powinno się zastosować?

Jaką maskę powinno się zastosować, aby podzielić sieć z adresem 192.168.1.0 na 4 podsieci?

Na płycie głównej uszkodzona została zintegrowana karta sieciowa. Komputer nie ma możliwości uruchomienia systemu operacyjnego, ponieważ brakuje dysku twardego oraz napędów optycznych, a system operacyjny uruchamia się z lokalnej sieci. W celu odzyskania utraconej funkcjonalności należy zainstalować w komputerze

Program antywirusowy oferowany przez Microsoft bezpłatnie dla posiadaczy legalnych wersji systemu operacyjnego Windows to

Koprocesor (Floating Point Unit) w systemie komputerowym jest odpowiedzialny za realizację

Jakie urządzenie wykorzystuje się do łączenia lokalnej sieci bezprzewodowej z siecią kablową?

Zgodnie z aktualnymi normami BHP, zalecana odległość oczu od ekranu monitora powinna wynosić

Na jakich nośnikach pamięci masowej jednym z najczęstszych powodów uszkodzeń jest zniszczenie powierzchni?

Kluczowe znaczenie przy tworzeniu stacji roboczej, na której ma funkcjonować wiele maszyn wirtualnych, ma:

Maksymalna długość łącza światłowodowego używanego do przesyłania danych w standardzie 10GBASE-SR wynosi

Jaki protokół stosują komputery, aby informować rutera o przynależności do konkretnej grupy multicastowej?

Który aplet w panelu sterowania systemu Windows 7 pozwala na ograniczenie czasu, jaki użytkownik spędza przed komputerem?

Aby osiągnąć optymalną prędkość przesyłu danych, gdy domowy ruter działa w paśmie 5 GHz, do laptopa należy zainstalować kartę sieciową bezprzewodową obsługującą standard

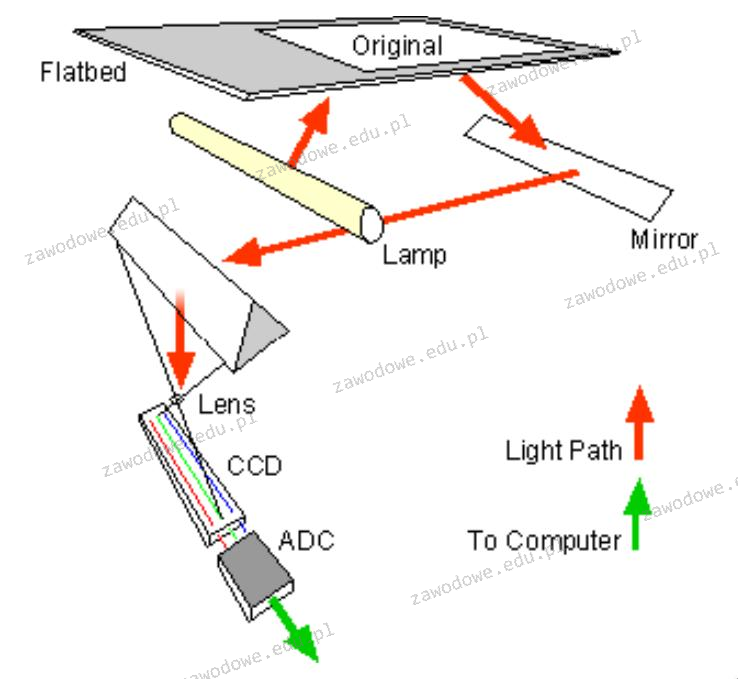

Ilustrowany schemat obrazuje zasadę funkcjonowania

Główny punkt, z którego odbywa się dystrybucja okablowania szkieletowego, to punkt

Jakie złącze, które pozwala na podłączenie monitora, znajduje się na karcie graficznej pokazanej na ilustracji?

Która z poniższych wskazówek nie jest właściwa w kontekście konserwacji skanera płaskiego?

Wymiana baterii należy do czynności związanych z eksploatacją

Zjawisko crosstalk, które występuje w sieciach komputerowych, polega na

Którego protokołu działanie zostało zaprezentowane na diagramie?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Na ilustracji widoczny jest

Jakiego protokołu używa warstwa aplikacji w modelu TCP/IP?

Ikona błyskawicy widoczna na ilustracji służy do identyfikacji złącza

W systemie Windows, aby udostępnić folder jako ukryty, należy na końcu nazwy udostępniania umieścić znak

Uruchomienie systemu Windows w trybie debugowania pozwala na

Pamięć, która działa jako pośrednik pomiędzy pamięcią operacyjną a procesorem o dużej prędkości, to

Zidentyfikuj urządzenie przedstawione na ilustracji

Program, który ocenia wydajność zestawu komputerowego, to

Aby chronić urządzenia w sieci LAN przed przepięciami oraz różnicami potencjałów, które mogą się pojawić w trakcie burzy lub innych wyładowań atmosferycznych, należy zastosować

W sieciach bezprzewodowych Ad-Hoc (Independent Basic Service Set) wykorzystywana jest fizyczna struktura

Zainstalowanie gniazda typu keystone w serwerowej szafie jest możliwe w

W tabeli przedstawiono pobór mocy poszczególnych podzespołów zestawu komputerowego. Zestaw składa się z:

- płyty głównej,

- procesora,

- 2 modułów pamięci DDR3,

- dysku twardego SSD,

- dysku twardego z prędkością obrotową 7200,

- karty graficznej,

- napędu optycznego,

- myszy i klawiatury,

- wentylatora.

Który zasilacz należy zastosować dla przedstawionego zestawu komputerowego, uwzględniając co najmniej 20% rezerwy poboru mocy?

| Podzespół | Pobór mocy [W] | Podzespół | Pobór mocy [W] |

|---|---|---|---|

| Procesor Intel i5 | 60 | Płyta główna | 35 |

| Moduł pamięci DDR3 | 6 | Karta graficzna | 310 |

| Moduł pamięci DDR2 | 3 | Dysk twardy SSD | 7 |

| Monitor LCD | 80 | Dysk twardy 7200 obr./min | 16 |

| Wentylator | 5 | Dysk twardy 5400 obr./min | 12 |

| Mysz i klawiatura | 2 | Napęd optyczny | 30 |

Aby przyznać użytkownikowi w systemie Windows możliwość zmiany czasu systemowego, należy skorzystać z narzędzia