Pytanie 1

Dysk twardy IDE wewnętrzny jest zasilany przez połączenie typu

Wynik: 13/40 punktów (32,5%)

Wymagane minimum: 20 punktów (50%)

Dysk twardy IDE wewnętrzny jest zasilany przez połączenie typu

Aby zrealizować transfer danych pomiędzy siecią w pracowni a siecią ogólnoszkolną, która ma inną adresację IP, należy zastosować

Jakie procesory można wykorzystać w zestawie komputerowym z płytą główną wyposażoną w gniazdo procesora typu Socket AM3?

Norma TIA/EIA-568-B.2 definiuje szczegóły dotyczące parametrów transmisji

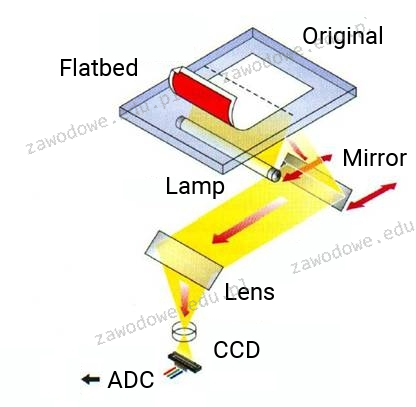

Zamieszczony poniżej diagram ilustruje zasadę działania skanera

W hierarchicznym modelu sieci komputery użytkowników stanowią część warstwy

Jaki rodzaj kabla powinien być użyty do podłączenia komputera w miejscu, gdzie występują zakłócenia elektromagnetyczne?

Która z kart graficznych nie będzie kompatybilna z monitorem, posiadającym złącza pokazane na ilustracji (zakładając, że nie można użyć adaptera do jego podłączenia)?

Z informacji przedstawionych w tabeli wynika, że efektywna częstotliwość pamięci DDR SDRAM wynosi

| 184 styki |

| 64-bitowa szyna danych |

| Pojemność 1024 MB |

| Przepustowość 3200 MB/s |

W jednostce ALU w akumulatorze zapisano liczbę dziesiętną 500. Jaką ona ma binarną postać?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Wskaż złącze, które nie jest obecne w zasilaczach ATX?

Aby poprawić niezawodność i efektywność przesyłu danych na serwerze, należy

Wskaż rysunek ilustrujący kondensator stały?

Jakie cyfry należy wprowadzić na klawiaturze telefonu podłączonego do bramki VoIP po wcześniejszym wpisaniu *** aby ustalić adres bramy domyślnej sieci?

| Aby wejść w tryb konfiguracji należy wprowadzić *** po podniesieniu słuchawki. | ||

| Tabela przedstawia wszystkie parametry oraz ich opis | ||

| Parametr | Informacja | Opcje |

|---|---|---|

| Menu główne po wprowadzeniu *** | Wejście w tryb programowania | - następna opcja + powrót do menu głównego Należy wybrać parametr 01-05, 07, 12-17, 47 lub 99 |

| 01 | „DHCP" lub „statyczny IP" | Używając cyfry „9" przełączanie pomiędzy : statycznym i dynamicznym adresem. |

| 02 | Statyczny adres IP | Zostanie wyemitowany komunikat z adresem IP Należy wprowadzić nowy adres 12 cyfrowy za pomocą klawiatury numerycznej. |

| 03 | Maska podsieci + adres | Tak samo jak w przypadku 02 |

| 04 | Brama domyślna + adres | Tak samo jak w przypadku 02 |

| 05 | Adres serwera DNS | Tak samo jak w przypadku 02 |

Najmniejszy czas dostępu charakteryzuje się

Jakim materiałem eksploatacyjnym jest ploter solwentowy?

Technologia procesorów serii Intel Core stosowana w modelach i5, i7 oraz i9, pozwalająca na zwiększenie taktowania w przypadku gdy komputer potrzebuje wyższej mocy obliczeniowej, to

Który z komponentów komputera można wymienić bez konieczności wyłączania zasilania?

Aby komputer stacjonarny mógł współdziałać z urządzeniami używającymi złącz pokazanych na ilustracji, konieczne jest wyposażenie go w interfejs

Jakie urządzenie jest używane do pomiaru wartości rezystancji?

Thunderbolt to interfejs

Nierówne wydruki lub bladości w druku podczas korzystania z drukarki laserowej mogą sugerować

Elementem, który jest odpowiedzialny za utrwalanie tonera na kartce podczas drukowania z drukarki laserowej, jest

Drukarką przeznaczoną do druku etykiet i kodów kreskowych, która drukuje poprzez roztapianie pokrycia specjalnej taśmy, w wyniku czego barwnik z niej zostaje przyklejony do materiału, na którym następuje drukowanie jest drukarka

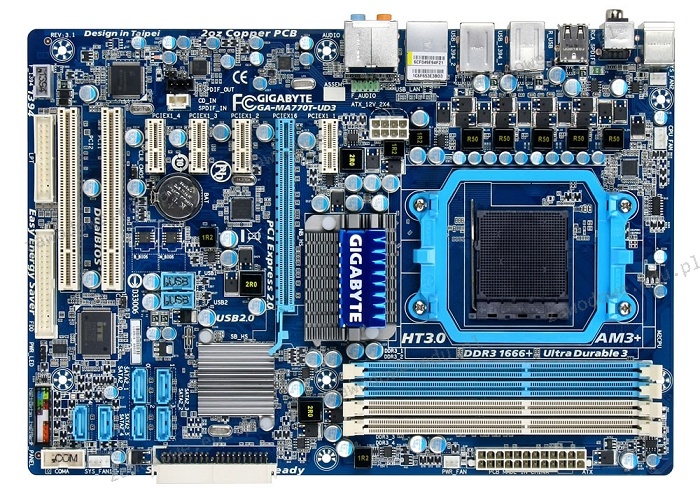

Do pokazanej na diagramie płyty głównej nie można podłączyć urządzenia, które korzysta z interfejsu

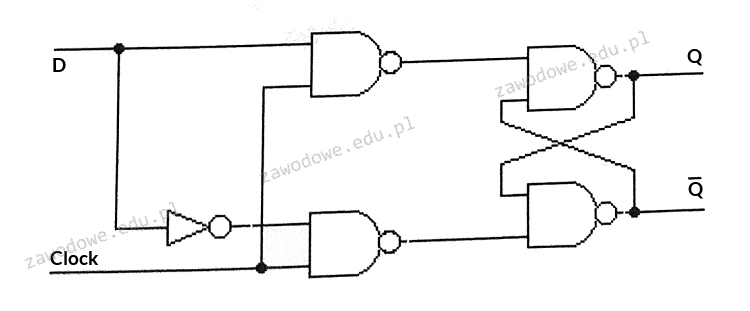

Zaprezentowany schemat ilustruje funkcjonowanie

Wskaź 24-pinowe lub 29-pinowe złącze żeńskie, które jest w stanie przesyłać skompresowany sygnał cyfrowy do monitora?

Przedstawione na ilustracji narzędzie służy do

Na dysku należy umieścić 100 tysięcy oddzielnych plików, z których każdy ma rozmiar 2570 bajtów. W takim przypadku, zapisane pliki będą zajmować najmniej miejsca na dysku z jednostką alokacji wynoszącą

Licencja obejmująca oprogramowanie układowe, umieszczone na stałe w sprzętowej części systemu komputerowego, to

Aby podłączyć dysk z interfejsem SAS, konieczne jest użycie kabla przedstawionego na ilustracji

Na podstawie danych z "Właściwości systemu" można stwierdzić, że na komputerze zainstalowano fizycznie pamięć RAM o pojemności

| Komputer: Intel(R) Pentium (R)4 CPU 1.8GHz AT/XT Compatible 523 760 kB RAM |

Jakie urządzenie jest kluczowe dla połączenia pięciu komputerów w sieci o strukturze gwiazdy?

Rysunek obrazuje zasadę działania drukarki

W sytuacji, gdy nie ma możliwości uruchomienia programu BIOS Setup, jak przywrócić domyślne ustawienia płyty głównej?

Jakie zabezpieczenie w dokumentacji technicznej określa mechanizm zasilacza komputerowego zapobiegający przegrzaniu urządzenia?

Jak wygląda schemat połączeń bramek logicznych?

Zastąpienie koncentratorów przełącznikami w sieci Ethernet doprowadzi do

W biurowcu należy podłączyć komputer do routera ADSL za pomocą przewodu UTP Cat 5e. Jaka powinna być maksymalna odległość między komputerem a routerem?