Pytanie 1

Administrator pragnie udostępnić w sieci folder C:instrukcje trzem użytkownikom z grupy Serwisanci. Jakie rozwiązanie powinien wybrać?

Wynik: 14/40 punktów (35,0%)

Wymagane minimum: 20 punktów (50%)

Administrator pragnie udostępnić w sieci folder C:instrukcje trzem użytkownikom z grupy Serwisanci. Jakie rozwiązanie powinien wybrać?

Norma EN 50167 odnosi się do rodzaju okablowania

Jakim protokołem jest protokół dostępu do sieci pakietowej o maksymalnej prędkości 2 Mbit/s?

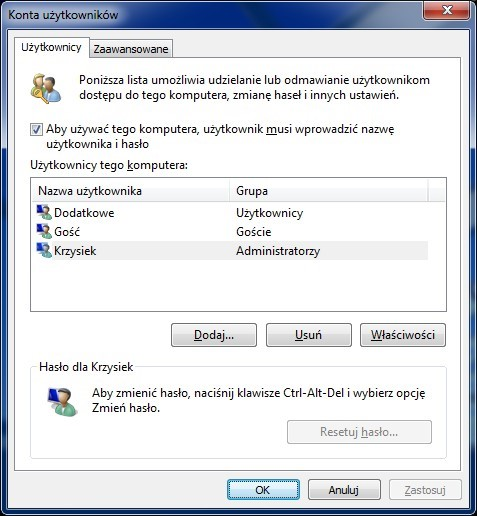

Aby uruchomić przedstawione narzędzie systemu Windows, należy użyć polecenia

Określ rezultat wykonania zamieszczonego polecenia

| net user Test /expires:12/09/20 |

W tabeli zaprezentowano specyfikacje czterech twardych dysków. Dysk, który oferuje najwyższą średnią prędkość odczytu danych, to

| Pojemność | 320 GB | 320 GB | 320 GB | 320 GB |

| Liczba talerzy | 2 | 3 | 2 | 2 |

| Liczba głowic | 4 | 6 | 4 | 4 |

| Prędkość obrotowa | 7200 obr./min | 7200 obr./min | 7200 obr./min | 7200 obr./min |

| Pamięć podręczna | 16 MB | 16 MB | 16 MB | 16 MB |

| Czas dostępu | 8.3 ms | 8.9 ms | 8.5 ms | 8.6 ms |

| Interfejs | SATA II | SATA II | SATA II | SATA II |

| Obsługa NCQ | TAK | NIE | TAK | TAK |

| Dysk | A. | B. | C. | D. |

System S.M.A.R.T jest stworzony do kontrolowania działania i identyfikacji usterek

Protokół User Datagram Protocol (UDP) należy do

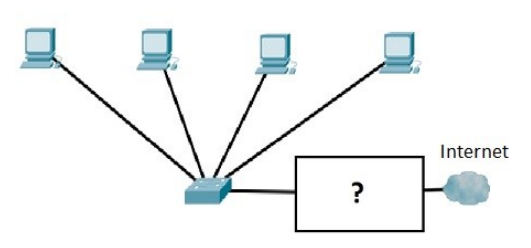

Jakie urządzenie powinno być podłączone do lokalnej sieci w miejscu zaznaczonym na rysunku, aby komputery mogły korzystać z Internetu?

Liczby 1001 i 100 w wierszu pliku /etc/passwd reprezentują

Jaka liczba hostów może być zaadresowana w podsieci z adresem 192.168.10.0/25?

Procesem nieodwracalnym, całkowicie uniemożliwiającym odzyskanie danych z dysku twardego, jest

Na zdjęciu ukazano złącze zasilające

Jakie złącze na tylnym panelu komputera jest przedstawione przez podany symbol graficzny?

W systemie Linux narzędzie, które umożliwia śledzenie trasy pakietów od źródła do celu, pokazując procentowe straty oraz opóźnienia, to

Wtyczka zaprezentowana na fotografii stanowi element obwodu elektrycznego zasilającego

Jakie oznaczenie odnosi się do normy dotyczącej okablowania strukturalnego?

Sprzętem, który umożliwia wycinanie wzorów oraz grawerowanie w różnych materiałach, takich jak drewno, szkło i metal, jest ploter

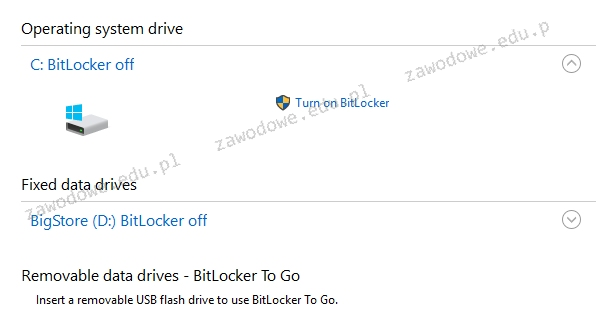

Prezentowane wbudowane narzędzie systemów Windows w wersji Enterprise lub Ultimate jest przeznaczone do

Która część stanowi treść dokumentacji powykonawczej?

Dokument służący do zaprezentowania oferty cenowej dla inwestora dotyczącej wykonania robót instalacyjnych sieci komputerowej, to

W systemie Linux do obserwacji działania sieci, urządzeń sieciowych oraz serwerów można zastosować aplikację

Jak nazywa się atak na sieć komputerową, który polega na przechwytywaniu przesyłanych w niej pakietów?

Jakie polecenie trzeba wydać w systemie Windows, aby zweryfikować tabelę mapowania adresów IP na adresy MAC wykorzystywane przez protokół ARP?

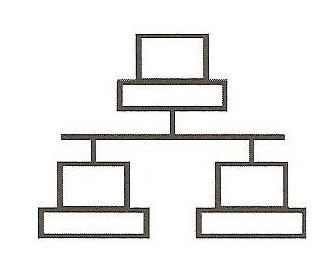

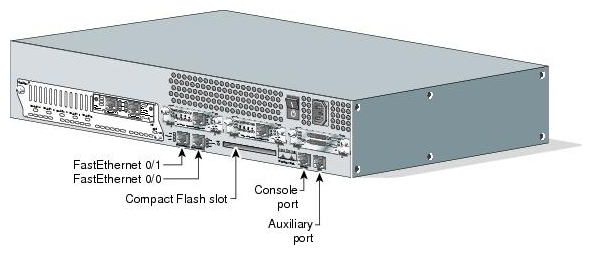

Urządzenie sieciowe, które widoczna jest na ilustracji, to

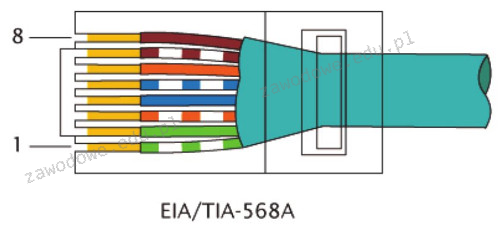

W standardzie Ethernet 100BaseTX do przesyłania danych używane są żyły kabla UTP podłączone do pinów

Klawiatura w układzie QWERTY, która pozwala na wpisywanie znaków typowych dla języka polskiego, jest znana jako klawiatura

Jakie jednostki stosuje się do wyrażania przesłuchu zbliżonego NEXT?

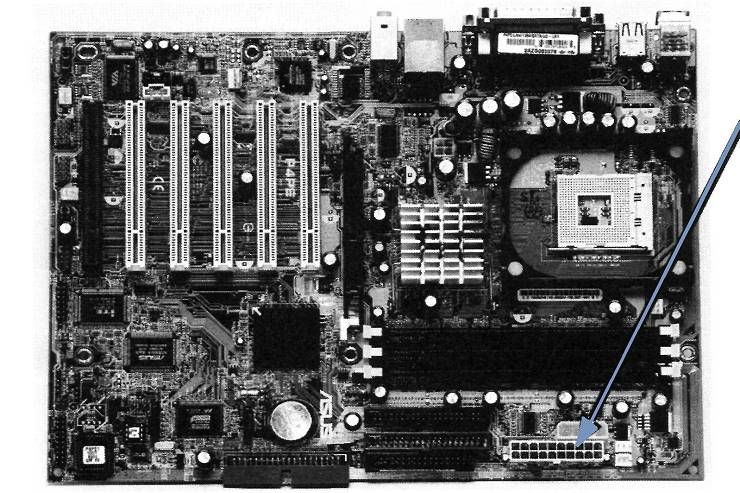

Wskaż procesor współpracujący z przedstawioną płytą główną.

Na ilustracji ukazano złącze zasilające

Aby osiągnąć wysoką jakość połączeń głosowych VoIP kosztem innych przesyłanych informacji, konieczne jest włączenie i skonfigurowanie na routerze usługi

Jakie jest najwyższe możliwe tempo odczytu płyt CD-R w urządzeniu o oznaczeniu x48?

Wykonując w konsoli systemu Windows Server komendę convert, co można zrealizować?

W systemach Linux, aby wprowadzić nowe repozytorium, należy wykorzystać komendy

Na zdjęciu widać płytę główną komputera. Strzałka wskazuje na

Jakie jest właściwe IP dla maski 255.255.255.0?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Ile hostów można zaadresować w podsieci z maską 255.255.255.248?

Jakie czynności nie są realizowane przez system operacyjny?

Jakie zagrożenia eliminują programy antyspyware?