Pytanie 1

W których nośnikach pamięci masowej jedną z najczęstszych przyczyn uszkodzeń jest uszkodzenie powierzchni?

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

W których nośnikach pamięci masowej jedną z najczęstszych przyczyn uszkodzeń jest uszkodzenie powierzchni?

Po wykonaniu eksportu klucza HKCR zostanie zapisana kopia rejestru, zawierająca informacje dotyczące konfiguracji

Aby zabezpieczyć system przed oprogramowaniem mającym możliwość reprodukcji, konieczne jest zainstalowanie

Do jednoczesnej zmiany tła pulpitu, kolorów okien, dźwięków oraz wygaszacza ekranu na komputerze z zainstalowanym systemem Windows należy wykorzystać

Użytkownicy z grupy Pracownicy nie mają możliwości drukowania dokumentów za pośrednictwem serwera drukarskiego w systemie operacyjnym Windows Server. Przysługuje im jedynie uprawnienie 'Zarządzanie dokumentami'. Co należy uczynić, aby rozwiązać przedstawiony problem?

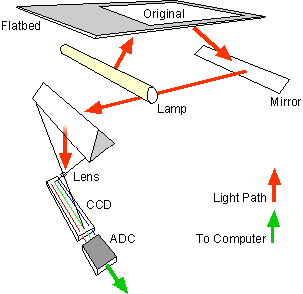

Przedstawiony schemat przedstawia zasadę działania

Jak nazywa się współpracujące z monitorami CRT urządzenie wskazujące z końcówką wyposażoną w światłoczuły element, która poprzez dotknięcie ekranu monitora powoduje przesłanie sygnału do komputera, umożliwiając w ten sposób lokalizację kursora?

Druk z drukarki igłowej realizowany jest z wykorzystaniem zestawu stalowych igieł w liczbie

Adapter USB do LPT może być użyty w przypadku braku kompatybilności złączy podczas podłączania starszych urządzeń

Udostępniono w sieci lokalnej jako udział specjalny folder o nazwie egzamin znajdujący się na komputerze o nazwie SERWER_2 w katalogu głównym dysku C:. Jak powinna wyglądać ścieżka dostępu do katalogu egzamin, w którym przechowywany jest folder macierzysty dla konta użytkownika o określonym loginie?

Wskaż program w systemie Linux, który jest przeznaczony do kompresji plików?

Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

Wyższą efektywność aplikacji multimedialnych w systemach z rodziny Windows zapewnia technologia

Jakim portem domyślnie odbywa się przesyłanie poleceń (command) serwera FTP?

Menedżer usług IIS (Internet Information Services) w systemie Windows stanowi graficzny interfejs do konfiguracji serwera

Aby określić rozmiar wolnej oraz zajętej pamięci RAM w systemie Linux, można skorzystać z polecenia

Modułem pamięci RAM, kompatybilnym z płytą główną GIGABYTE GA-X99- ULTRA GAMING/ X99/ 8x DDR4 2133, ECC, max 128GB/ 4x PCI-E 16x/ RAID/ USB 3.1/ S-2011-V3/ATX, jest pamięć

Aby w systemie Windows, przy użyciu wiersza poleceń, zmienić partycję FAT na NTFS bez utraty danych, powinno się zastosować polecenie

Jak nazywa się jednostka przeprowadzająca obliczenia stałoprzecinkowe?

Funkcje z różnych dziedzin (data i czas, finanse, tekst, matematyka, statystyka) są składnikiem

Jak określana jest transmisja w obie strony w sieci Ethernet?

W której warstwie modelu ISO/OSI odbywa się segmentacja danych, komunikacja w trybie połączeniowym z użyciem protokołu TCP oraz komunikacja w trybie bezpołączeniowym z zastosowaniem UDP?

Drukarka została zainstalowana w systemie Windows. Aby ustawić między innymi domyślną orientację wydruku, liczbę stron na arkusz oraz kolorystykę, podczas jej konfiguracji należy skorzystać z opcji

Według modelu TCP/IP, protokoły DNS, FTP oraz SMTP zaliczają się do warstwy

Jaką operację można wykonać podczas konfiguracji przełącznika CISCO w interfejsie CLI, nie przechodząc do trybu uprzywilejowanego, w zakresie dostępu widocznym w ramce?

| Switch> |

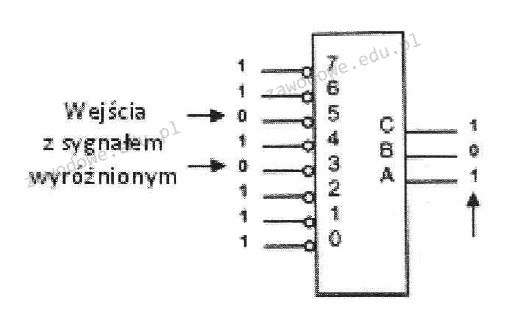

Na ilustracji przedstawiono symbol urządzenia cyfrowego

W systemie Windows, aby założyć nową partycję podstawową, trzeba skorzystać z przystawki

Protokół używany do zarządzania urządzeniami w sieci to

Wskaź zestaw do diagnostyki logicznych układów elektronicznych umiejscowionych na płycie głównej komputera, który nie reaguje na próby uruchomienia zasilania?

Rysunek obrazuje zasadę działania drukarki

Kable łączące dystrybucyjne punkty kondygnacyjne z głównym punktem dystrybucji są określane jako

Co oznacza oznaczenie kabla skrętkowego U/FTP?

Podczas konfiguracji nowego routera, użytkownik został poproszony o skonfigurowanie WPA2. Czego dotyczy to ustawienie?

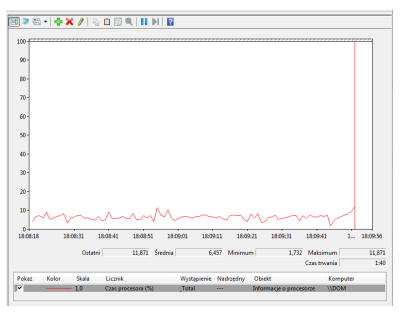

Aby zainicjować w systemie Windows oprogramowanie do monitorowania wydajności komputera przedstawione na ilustracji, należy otworzyć

Aby uniknąć utraty danych w systemie do ewidencji uczniów, po zakończeniu codziennej pracy należy wykonać

Procesem nieodwracalnym, całkowicie uniemożliwiającym odzyskanie danych z dysku twardego, jest

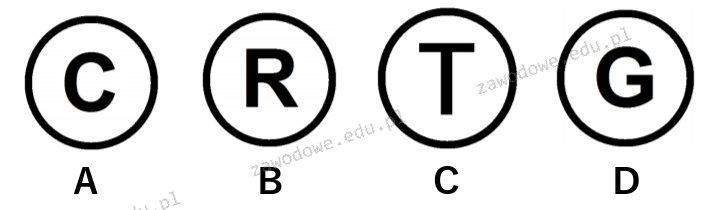

Który z symboli wskazuje na zastrzeżenie praw autorskich?

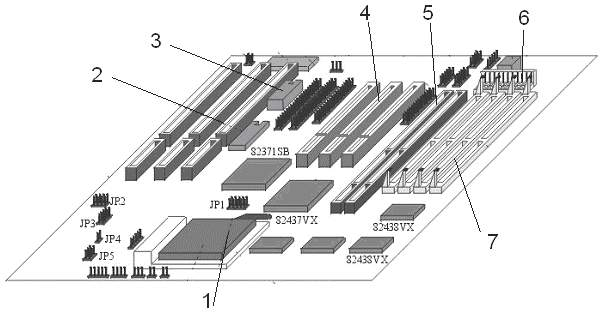

Na schemacie płyty głównej port PCI oznaczony jest numerem

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Wskaż podzespół niekompatybilny z płytą główną o przedstawionych w tabeli parametrach.

| Podzespół | Parametry |

|---|---|

| Płyta główna GIGABYTE | 4x DDR4, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8x USB 2.0, S-AM3+ |