Pytanie 1

Standardowe badanie USG średniej wielkości piersi wykonuje się głowicą w zakresie częstotliwości

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Standardowe badanie USG średniej wielkości piersi wykonuje się głowicą w zakresie częstotliwości

Chorobą układu oddechowego typu obturacyjnego jest

W leczeniu izotopowym tarczycy należy podać

W celu wyeliminowania zakłóceń obrazu MR przez sygnały pochodzące z tkanki tłuszczowej, stosuje się

Który załamek odzwierciedla szybką repolaryzację komór w zapisie EKG?

Parametr SNR w obrazowaniu MR oznacza

Zgodnie ze standardami do wykonania zdjęcia bocznego czaszki, należy zastosować kasetę o wymiarze

Do wczesnych odczynów popromiennych po radioterapii zalicza się

Pomiaru impedancji akustycznej ucha środkowego dokonuje się podczas badania

Limfografia to badanie kontrastowe

Dawka graniczna wyrażona jako dawka skuteczna (efektywna), dla osób zawodowo narażonych na działanie promieniowania jonizującego wynosi w ciągu roku kalendarzowego

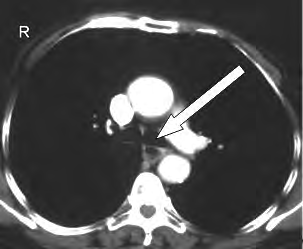

Na obrazie TK klatki piersiowej w przekroju poprzecznym strzałką oznaczono

Zarejestrowane na elektrokardiogramie miarowe fale f w kształcie „zębów piły” poprzedzielane prawidłowymi zespołami QRS są charakterystyczne dla

W których projekcjach wykonuje się standardowe badanie mammograficzne?

Wskaż przyczynę powstania artefaktu widocznego na obrazie MR.

Zgodnie z obowiązującymi przepisami powierzchnia gabinetu rentgenowskiego, w którym jest zainstalowany zestaw rentgenowski do badań naczyniowych, powinna wynosić

Przedstawiony obraz został zarejestrowany podczas wykonywania

Fistulografia to badanie kontrastowe

W badaniu PET stosuje się tylko radioizotopy emitujące

Odprowadzenie II rejestruje różnicę potencjałów między

Na radiogramie uwidoczniono

Po zakończeniu badania angiograficznego należy zapisać w dokumentacji medycznej pacjenta:

Który środek kontrastujący stosuje się w badaniu metodą rezonansu magnetycznego?

Dobierz dla standardowego pacjenta projekcję, pozycję i sposób ułożenia kasety o wymiarach 30 cm x 40 cm do zdjęcia przeglądowego układu moczowego.

| Projekcja | Pozycja | Ułożenie kasety | |||

|---|---|---|---|---|---|

| 1. | AP | 3. | stojąca | 5. | poprzeczne |

| 2. | PA | 4. | leżąca | 6. | podłużne |

Podczas wykonywania badania EEG elektrodę P4 umieszcza się w okolicy

Na rentgenogramie przedstawione jest złamanie Saltera-Harrisa typu

Którą strukturę anatomiczną i w jakiej projekcji uwidoczniono na radiogramie?

Elementem pomocniczym w radioterapii, zapewniającym powtarzalność ułożenia w pozycji terapeutycznej, a także unieruchomienie pacjenta, jest

W radiologii stomatologicznej ząb o numerze 23 to kieł

Za wyrównanie ciśnienia między uchem środkowym a otoczeniem odpowiada

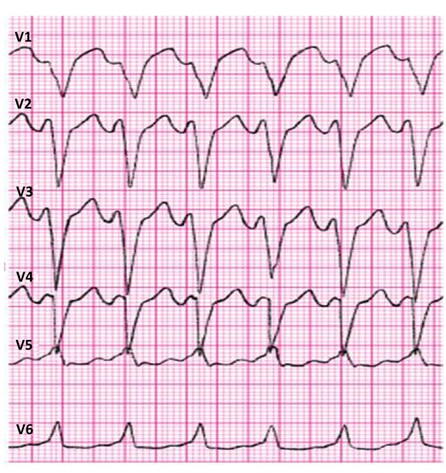

Które zaburzenie rytmu serca zarejestrowano na elektrokardiogramie?

Zadaniem technika elektroradiologa w pracowni naczyniowej jest

Zwiększenie napięcia na lampie rentgenowskiej powoduje

W badaniu EEG elektrody referencyjne przymocowane do płatka ucha to

Radiogram jamy brzusznej uwidacznia

Emisja fali elektromagnetycznej występuje w procesie rozpadu promieniotwórczego

W medycznym przyspieszaczu liniowym jest generowana wiązka fotonów o energii w zakresie

W badaniu audiometrycznym rezerwa ślimakowa to odległość między krzywą

Testy specjalistyczne aparatów rentgenowskich do zdjęć wewnątrzustnych są przeprowadzane

DSA to cyfrowa