Pytanie 1

Jakie polecenie w systemie Linux przyzna pełne uprawnienia wszystkim użytkownikom do zasobów?

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Jakie polecenie w systemie Linux przyzna pełne uprawnienia wszystkim użytkownikom do zasobów?

Jaką maksymalną prędkość danych można osiągnąć w sieci korzystającej z skrętki kategorii 5e?

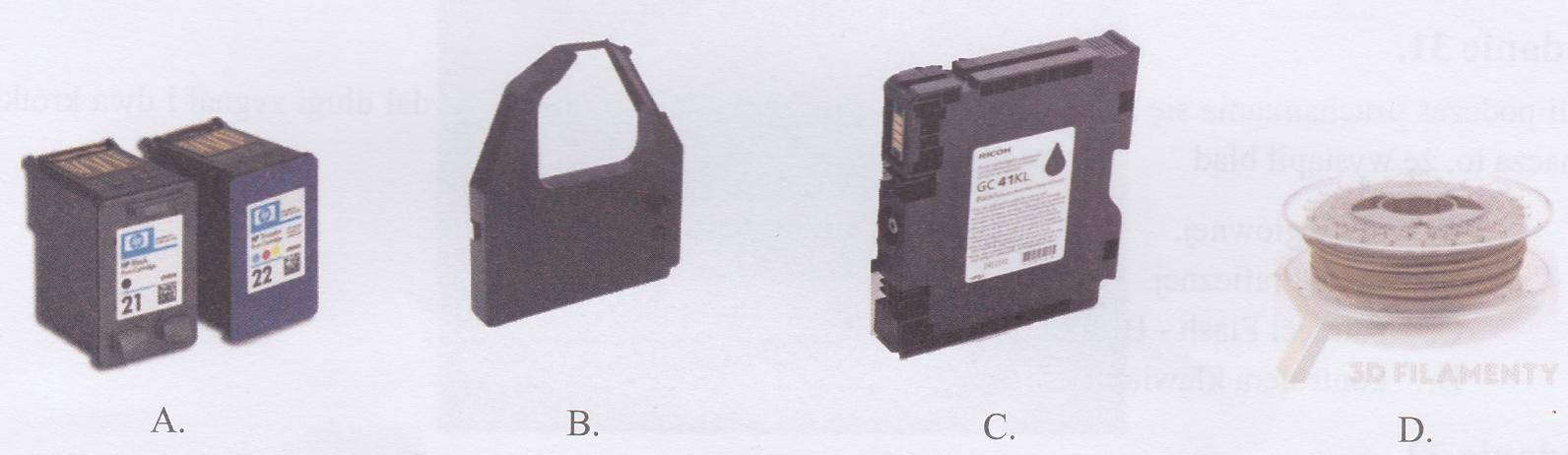

Wskaż ilustrację przedstawiającą materiał eksploatacyjny charakterystyczny dla drukarek żelowych?

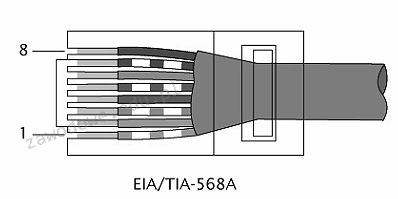

W technologii Ethernet 100BaseTX do przesyłania danych wykorzystywane są żyły kabla UTP podłączone do pinów

Jakie narzędzie w systemie Windows Server umożliwia zarządzanie zasadami grupy?

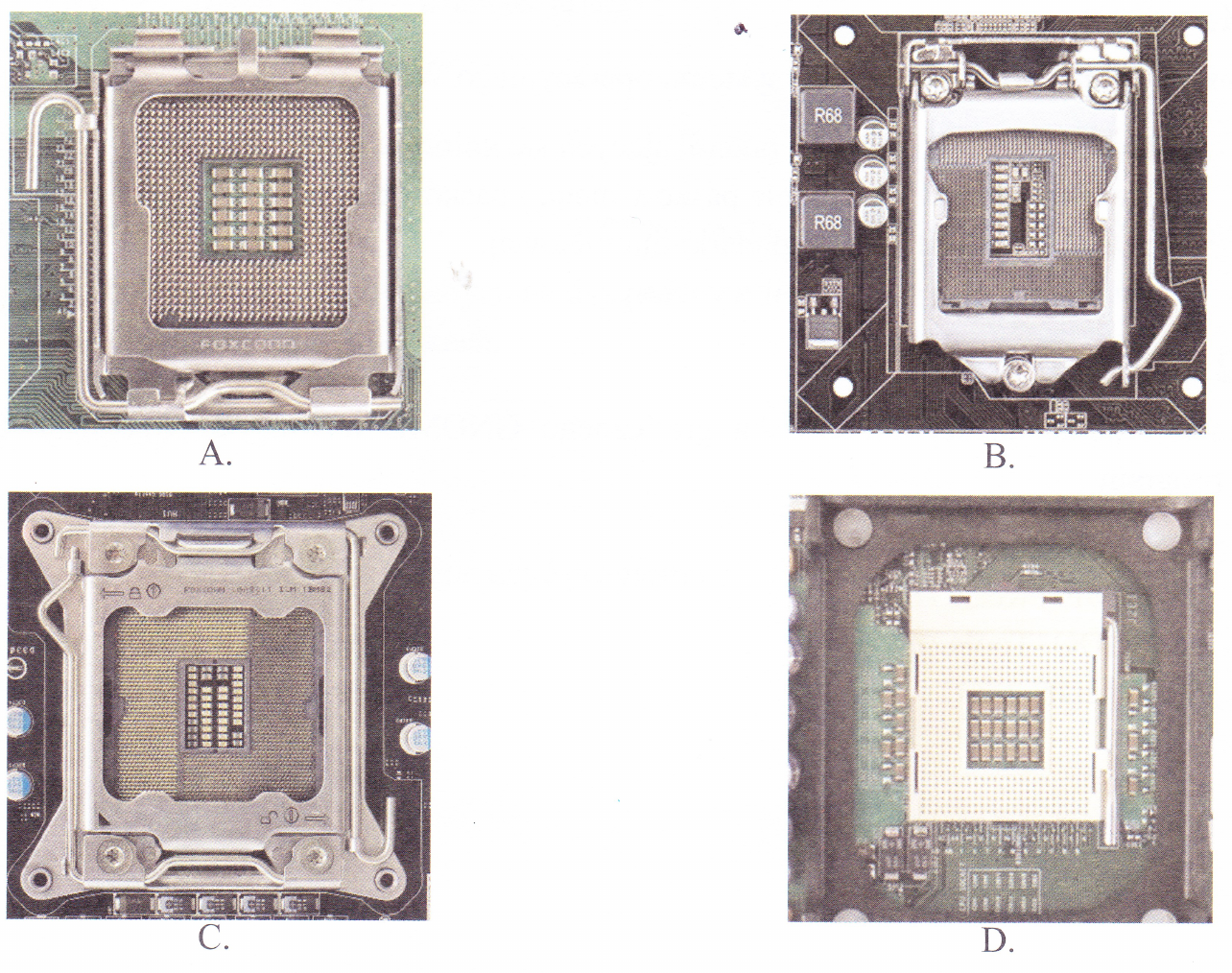

W jakim gnieździe należy umieścić procesor INTEL CORE i3-4350- 3.60 GHz, x2/4, 4MB, 54W, HD 4600, BOX, s-1150?

Co jest głównym zadaniem protokołu DHCP?

Interfejs HDMI w komputerze umożliwia przesyłanie sygnału

Czym jest procesor Athlon 2800+?

System S.M.A.R.T. służy do śledzenia funkcjonowania oraz identyfikacji usterek

Jakiego portu używa protokół FTP (File transfer Protocol)?

Jaki akronim oznacza wydajność sieci oraz usługi, które mają na celu między innymi priorytetyzację przesyłanych pakietów?

Topologia fizyczna, w której wszystkie urządzenia końcowe są bezpośrednio połączone z jednym punktem centralnym, takim jak koncentrator lub switch, to topologia

Jakie polecenie w systemie Windows powinno zostać użyte, aby uzyskać wynik zbliżony do tego na załączonym obrazku?

TCP 192.168.0.14:57989 185.118.124.154:http ESTABLISHED TCP 192.168.0.14:57997 fra15s17-in-f8:http ESTABLISHED TCP 192.168.0.14:58010 fra15s11-in-f14:https TIME_WAIT TCP 192.168.0.14:58014 wk-in-f156:https ESTABLISHED TCP 192.168.0.14:58015 wk-in-f156:https TIME_WAIT TCP 192.168.0.14:58016 104.20.87.108:https ESTABLISHED TCP 192.168.0.14:58022 ip-2:http TIME_WAIT

Jakie polecenie jest wykorzystywane do odzyskiwania struktury kluczy rejestru z kopii zapasowej w systemie Windows?

Aby zrealizować aktualizację zainstalowanego systemu operacyjnego Linux Ubuntu, należy wykonać polecenie

Na 16 bitach możemy przechować

Korzystając z programu Cipher, użytkownik systemu Windows ma możliwość

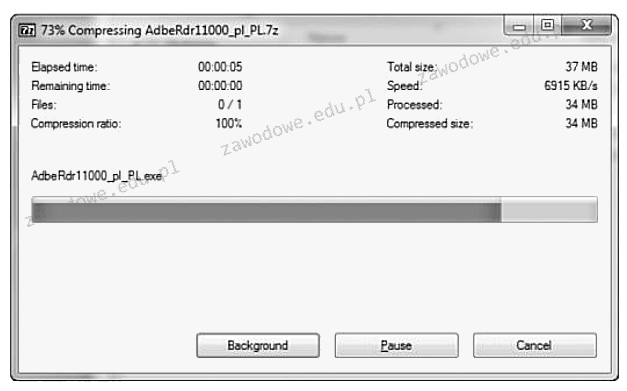

Na dołączonym obrazku pokazano działanie

W biurowcu należy podłączyć komputer do routera ADSL za pomocą przewodu UTP Cat 5e. Jaka powinna być maksymalna odległość między komputerem a routerem?

Jakie polecenie jest używane do monitorowania statystyk protokołów TCP/IP oraz bieżących połączeń sieciowych w systemach operacyjnych z rodziny Windows?

Aby zminimalizować główne zagrożenia dotyczące bezpieczeństwa podczas pracy na komputerze podłączonym do sieci Internet, najpierw należy

W jaki sposób skonfigurować zaporę Windows, aby spełniała zasady bezpieczeństwa i umożliwiała użycie polecenia ping do weryfikacji komunikacji z innymi urządzeniami w sieci?

Która norma w Polsce definiuje zasady dotyczące okablowania strukturalnego?

Komputer zainstalowany w domenie Active Directory nie jest w stanie nawiązać połączenia z kontrolerem domeny, na którym znajduje się profil użytkownika. Jaki rodzaj profilu użytkownika zostanie stworzony na tym urządzeniu?

Jakie polecenie należy wykorzystać, aby zmienić właściciela pliku w systemie Linux?

Jakie polecenie w systemie operacyjnym Linux służy do monitorowania komunikacji pakietów TCP/IP lub protokołów wysyłanych lub odbieranych w sieci komputerowej, do której podłączony jest komputer użytkownika?

Urządzenie sieciowe funkcjonujące w trzeciej warstwie modelu ISO/OSI, posługujące się adresami IP, to

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Przedstawiony moduł pamięci należy zamontować na płycie głównej w gnieździe

Diody LED RGB funkcjonują jako źródło światła w różnych modelach skanerów

Ile bitów minimum będzie wymaganych w systemie binarnym do zapisania liczby szesnastkowej 110ₕ?

Jakie będzie rezultatem dodawania liczb 10011012 i 110012 w systemie binarnym?

W interfejsie graficznym systemów Ubuntu lub SuSE Linux, aby zainstalować aktualizacje programów systemowych, można zastosować aplikacje

Katalog Nakładów Rzeczowych w projektowaniu sieci służy do

Jakie właściwości topologii fizycznej sieci zostały przedstawione w poniższej ramce?

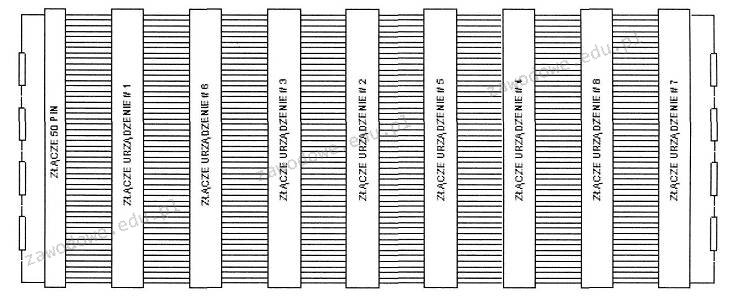

Za pomocą taśmy 60-pinowej pokazanej na ilustracji łączy się z płytą główną komputera

Do jakiej grupy w systemie Windows Server 2008 powinien być przypisany użytkownik odpowiedzialny jedynie za archiwizację danych zgromadzonych na dysku serwera?

Który standard implementacji sieci Ethernet określa sieć wykorzystującą kabel koncentryczny, z maksymalną długością segmentu wynoszącą 185 m?