Pytanie 1

Które polecenie systemu Linux wyświetla czas pracy systemu oraz jego średnie obciążenie?

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Które polecenie systemu Linux wyświetla czas pracy systemu oraz jego średnie obciążenie?

Program fsck jest stosowany w systemie Linux do

Jakie oprogramowanie nie jest przeznaczone do diagnozowania komponentów komputera?

Najkrótszy czas dostępu charakteryzuje się

W której warstwie modelu ISO/OSI odbywa się segmentacja danych, komunikacja w trybie połączeniowym z użyciem protokołu TCP oraz komunikacja w trybie bezpołączeniowym z zastosowaniem UDP?

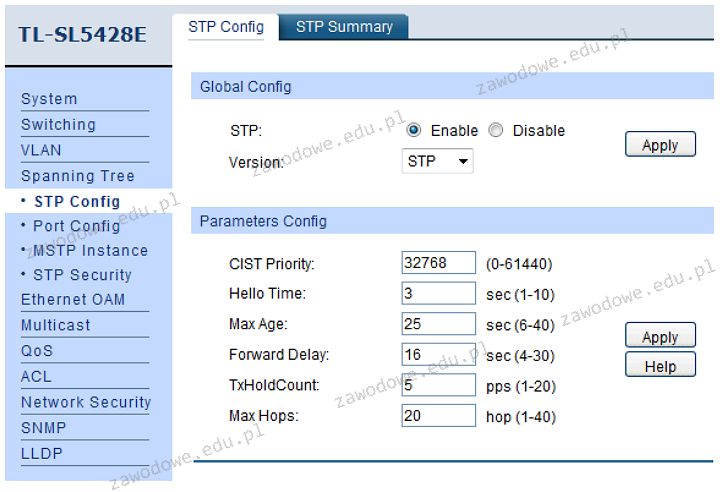

Analizując zrzut ekranu prezentujący ustawienia przełącznika, można zauważyć, że

Gniazdo LGA umieszczone na płycie głównej komputera stacjonarnego pozwala na zamontowanie procesora

Określenie najlepszej trasy dla połączenia w sieci to

Moduł w systemie Windows, który odpowiada za usługi informacyjne w Internecie, to

Które wbudowane narzędzie systemu Windows pozwala rozwiązywać problemy z błędnymi sektorami i integralnością plików?

W systemie Linux komenda chmod pozwala na

Licencja Windows OEM nie umożliwia wymiany

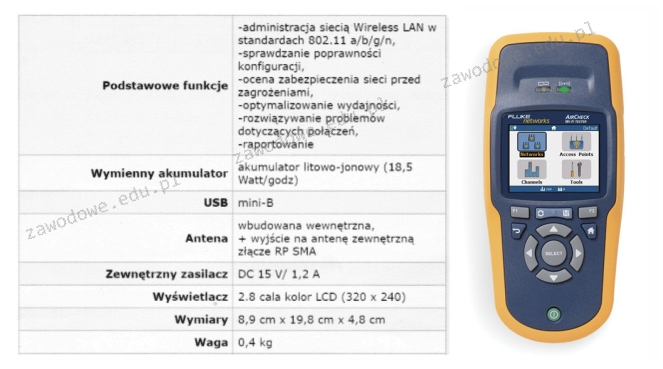

Jakie urządzenie diagnostyczne zostało zaprezentowane na ilustracji oraz opisane w specyfikacji zawartej w tabeli?

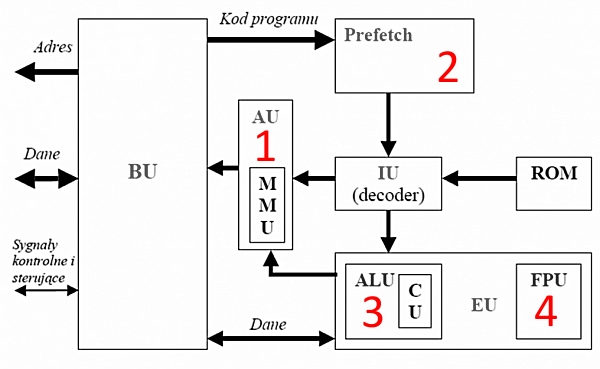

Koprocesor arytmetyczny, który pełni funkcję wykonywania obliczeń na liczbach zmiennoprzecinkowych w mikroprocesorze, został na schemacie oznaczony cyfrą

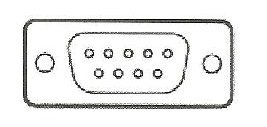

Na ilustracji przedstawiono złącze

Która z ról w systemie Windows Server umożliwia m.in. zdalną, bezpieczną i uproszczoną instalację systemów operacyjnych Windows na komputerach w sieci?

W dwóch sąsiadujących pomieszczeniach w pewnej firmie występują bardzo silne zakłócenia elektromagnetyczne. Aby osiągnąć jak największą przepustowość podczas działania istniejącej sieci LAN, jakie medium transmisyjne powinno zostać użyte?

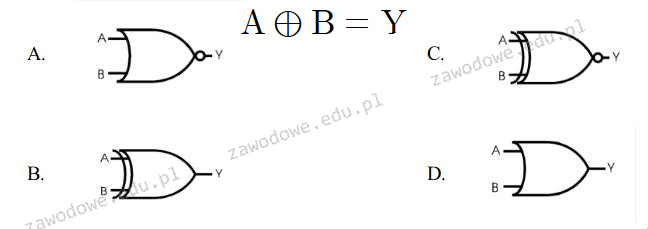

Jaką bramkę logiczną reprezentuje to wyrażenie?

PCI\VEN_10EC&DEV_8168&SUBSYS_05FB1028&REV_12

Przedstawiony zapis jest

Tworzenie zaszyfrowanych połączeń pomiędzy hostami przez publiczną sieć Internet, wykorzystywane w rozwiązaniach VPN (Virtual Private Network), to

Który z protokołów należy do warstwy transportowej, działa bez nawiązywania połączenia i nie posiada mechanizmów weryfikujących poprawność dostarczania danych?

W IPv6 odpowiednikiem adresu pętli zwrotnej jest adres

Wskaź protokół działający w warstwie aplikacji, który umożliwia odbieranie wiadomości e-mail, a w pierwszym etapie pobiera jedynie nagłówki wiadomości, podczas gdy pobranie ich treści oraz załączników następuje dopiero po otwarciu wiadomości.

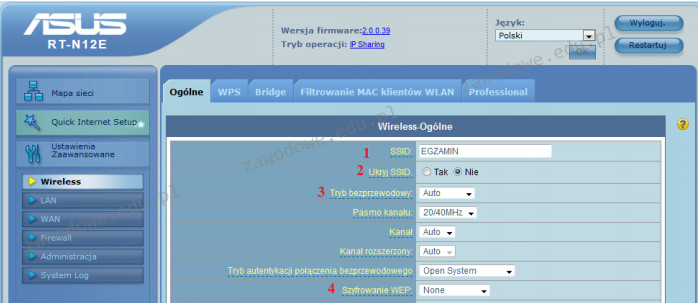

Aby zatuszować identyfikator sieci bezprzewodowej, należy zmodyfikować jego ustawienia w ruterze w polu oznaczonym numerem

Firma świadcząca usługi sprzątania potrzebuje drukować faktury tekstowe w czterech kopiach równocześnie, na papierze samokopiującym. Jaką drukarkę powinna wybrać?

Do interfejsów pracujących równolegle należy interfejs

W systemie operacyjnym Linux, do konfigurowania sieci VLAN wykorzystuje się polecenie

Które z urządzeń nie powinno być serwisowane podczas korzystania z urządzeń antystatycznych?

Adware to program komputerowy

Jednym z czynników, dla których zapis na dysku SSD jest szybszy niż na dysku HDD, jest

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Które z kont nie jest wbudowanym kontem w systemie Windows XP?

Jakim elementem sieci SIP jest telefon IP?

Jakie polecenie należy użyć w wierszu poleceń systemu Windows, aby utworzyć nowy katalog?

Zjawisko przekazywania tokena (ang. token) występuje w sieci o fizycznej strukturze

W cenniku usług komputerowych znajdują się przedstawione niżej zapisy. Ile będzie wynosił koszt dojazdu serwisanta do klienta mieszkającego poza miastem, w odległości 15 km od siedziby firmy?

Dojazd do klienta na terenie miasta - 25 zł netto

Dojazd do klienta poza miastem - 2 zł netto za każdy km odległości od siedziby firmy liczony w obie strony.

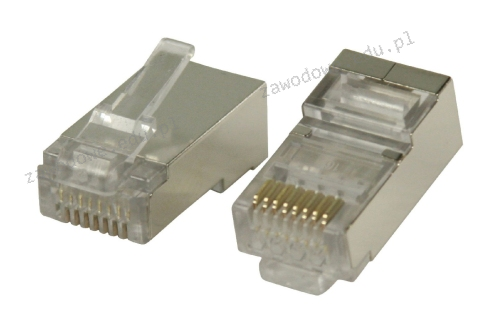

Wtyczka (modularne złącze męskie) przedstawiona na rysunku stanowi zakończenie przewodu

Aby zminimalizować główne zagrożenia dotyczące bezpieczeństwa podczas pracy na komputerze podłączonym do sieci Internet, najpierw należy

Wartość liczby ABBA zapisana w systemie heksadecymalnym odpowiada w systemie binarnym liczbie

Jakie procesory można wykorzystać w zestawie komputerowym z płytą główną wyposażoną w gniazdo procesora typu Socket AM3?