Pytanie 1

System S.M.A.R.T. służy do śledzenia funkcjonowania oraz identyfikacji usterek

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

System S.M.A.R.T. służy do śledzenia funkcjonowania oraz identyfikacji usterek

Aby zapewnić możliwość odzyskania ważnych danych, należy regularnie

Jakie jest IPv4 urządzenia znajdującego się w sieci 10.100.0.0/18?

Scandisk to narzędzie, które wykorzystuje się do

W której warstwie modelu odniesienia ISO/OSI działają protokoły IP oraz ICMP?

Jakie urządzenie umożliwia testowanie strukturalnego okablowania światłowodowego?

Jak nazywa się translacja adresów źródłowych w systemie NAT routera, która zapewnia komputerom w sieci lokalnej dostęp do internetu?

W systemie Linux komenda tty pozwala na

Port AGP służy do łączenia

W skanerze z systemem CIS źródłem światła oświetlającym skanowany dokument jest

Podaj poprawną sekwencję czynności, które należy wykonać, aby przygotować nowy laptop do użycia.

Narzędziem służącym do tworzenia logicznych podziałów na dysku twardym w systemie GNU/Linux jest

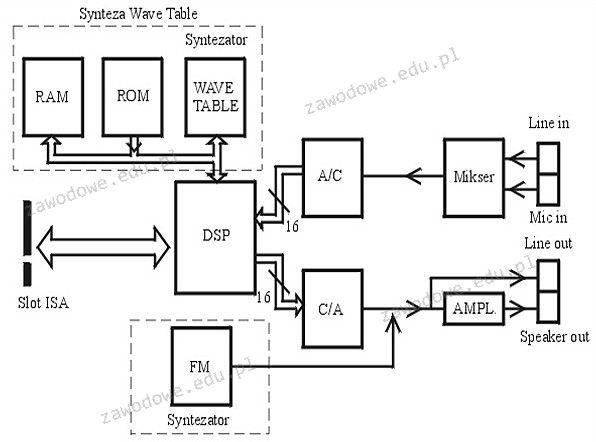

Na ilustracji zaprezentowano schemat działania

W komunikacie błędu systemowego informacja prezentowana w formacie szesnastkowym oznacza

Jakie protokoły są używane w komunikacji między hostem a serwerem WWW po wpisaniu URL w przeglądarkę internetową hosta?

Co robi polecenie Gpresult?

Jaką funkcję pełni protokół ARP (Address Resolution Protocol)?

W trakcie konserwacji oraz czyszczenia drukarki laserowej, która jest odłączona od zasilania, pracownik serwisu komputerowego może zastosować jako środek ochrony osobistej

Sieci lokalne o architekturze klient-serwer są definiowane przez to, że

Nie można uruchomić systemu Windows z powodu błędu oprogramowania. Jak można przeprowadzić diagnozę i usunąć ten błąd w jak najmniej inwazyjny sposób?

W systemie Windows, z jakiego polecenia można skorzystać, aby sprawdzić bieżące połączenia sieciowe i ich statystyki?

W systemie Windows, zainstalowanym w wersji obsługującej przydziały dyskowe, użytkownik o nazwie Gość

Kluczowym mechanizmem zabezpieczającym dane przechowywane na serwerze jest

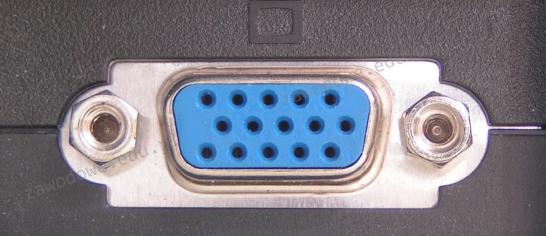

Złącze widoczne na ilustracji służy do podłączenia

Rysunek obrazuje zasadę działania drukarki

Aby uniknąć różnic w kolorystyce pomiędzy zeskanowanymi zdjęciami na wyświetlaczu komputera a ich oryginałami, konieczne jest przeprowadzenie

Gdy użytkownik wpisuje w przeglądarkę internetową adres www.egzamin.pl, nie ma możliwości otwarcia strony WWW, natomiast wprowadzenie adresu 211.0.12.41 umożliwia dostęp do niej. Problem ten spowodowany jest brakiem skonfigurowanego serwera

Użycie trunkingowego połączenia między dwoma przełącznikami umożliwia

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Urządzeniem wejściowym komputera, realizującym z najwyższą precyzją funkcje wskazujące w środowisku graficznym 3D, jest

Aby umożliwić diagnozę systemu operacyjnego Windows oraz utworzyć plik zawierający listę wszystkich zaczytywanych sterowników, należy uruchomić system w trybie

Standard magistrali komunikacyjnej PCI w wersji 2.2 (Peripheral Component Interconnect) definiuje maksymalną szerokość szyny danych na

Które z poniższych twierdzeń nie odnosi się do pamięci cache L1?

Udostępnienie drukarki sieciowej codziennie o tej samej porze należy ustawić we właściwościach drukarki, w zakładce

W drukarce laserowej do utrwalania obrazu na papierze stosuje się

Podaj adres rozgłoszeniowy sieci, do której przynależy host o adresie 88.89.90.91/6?

Która z opcji konfiguracji ustawień konta użytkownika o ograniczonych uprawnieniach w systemie Windows jest dostępna dzięki narzędziu secpol?

ile bajtów odpowiada jednemu terabajtowi?

Wskaż najkorzystniejszą trasę sumaryczną dla podsieci IPv4?

| 10.10.168.0/23 |

| 10.10.170.0/23 |

| 10.10.172.0/23 |

| 10.10.174.0/24 |

Jaką maksymalną prędkość transferu danych umożliwia interfejs USB 3.0?