Pytanie 1

Jakie urządzenie należy wykorzystać do zestawienia komputerów w sieci przewodowej o strukturze gwiazdy?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Jakie urządzenie należy wykorzystać do zestawienia komputerów w sieci przewodowej o strukturze gwiazdy?

Aby komputer stacjonarny mógł współdziałać z urządzeniami używającymi złącz pokazanych na ilustracji, konieczne jest wyposażenie go w interfejs

Podczas pracy wskaźnik przewodowej myszy optycznej nie reaguje na przesuwanie urządzenia po padzie, dopiero po odpowiednim ułożeniu myszy kursor zaczyna zmieniać położenie. Objawy te wskazują na uszkodzenie

Proces zapisu na nośnikach BD-R realizowany jest przy użyciu

Jaką maksymalną wartość rozplotu kabla UTP można uzyskać we wtyku RJ45 według normy PN-EN 50173?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Scandisk to narzędzie, które wykorzystuje się do

Jak w systemie Windows Professional można ustalić czas działania drukarki oraz jej uprawnienia do drukowania?

Jeśli podczas podłączania stacji dysków elastycznych 1,44 MB kabel sygnałowy zostanie włożony odwrotnie, to

Maksymalna długość łącza światłowodowego używanego do przesyłania danych w standardzie 10GBASE-SR wynosi

Jakie informacje można uzyskać na temat konstrukcji skrętki S/FTP?

Oprogramowanie, które pozwala na interakcję pomiędzy kartą sieciową a systemem operacyjnym, to

Dane dotyczące kont użytkowników w systemie Linux są przechowywane w pliku

Planowanie wykorzystania przestrzeni na dysku komputera do gromadzenia i udostępniania informacji takich jak pliki oraz aplikacje dostępne w sieci, a także ich zarządzanie, wymaga skonfigurowania komputera jako

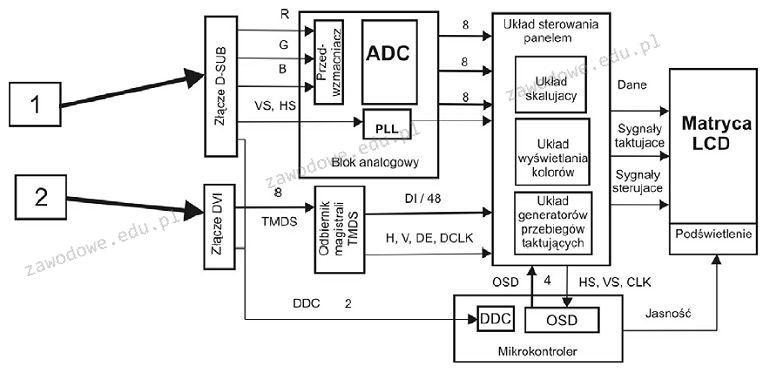

Które z połączeń zaznaczonych strzałkami na diagramie monitora stanowi wejście cyfrowe?

Wskaż podzespół niekompatybilny z płytą główną o przedstawionych w tabeli parametrach.

| Podzespół | Parametry |

|---|---|

| Płyta główna GIGABYTE | 4x DDR4, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8x USB 2.0, S-AM3+ |

Pamięć Intel® Smart Cache, która jest wbudowana w procesory o wielu rdzeniach, takie jak Intel® Core TM Duo, to pamięć

Osoba odpowiedzialna za zarządzanie siecią komputerową pragnie ustalić, jakie połączenia są aktualnie nawiązywane na komputerze z systemem operacyjnym Windows oraz które porty są wykorzystywane do nasłuchu. W tym celu powinna użyć polecenia

Z jakiego typu pamięci korzysta dysk SSD?

Korzystając z polecenia systemowego ipconfig, można skonfigurować

Samodzielną strukturą sieci WLAN jest

Jak można przywrócić domyślne ustawienia płyty głównej, gdy nie ma możliwości uruchomienia BIOS Setup?

Okablowanie strukturalne klasyfikuje się jako część infrastruktury

Aby zminimalizować główne zagrożenia dotyczące bezpieczeństwa podczas pracy na komputerze podłączonym do sieci Internet, najpierw należy

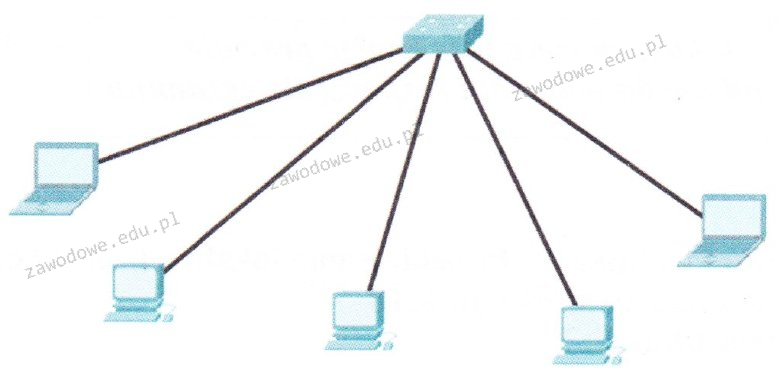

Jaką topologię fizyczną sieci ilustruje zamieszczony rysunek?

Symbol "LGA 775" obecny w dokumentacji technicznej płyty głównej wskazuje na typ gniazda dla procesorów:

Jednym z programów stosowanych do tworzenia kopii zapasowych partycji oraz dysków jest

Jakie polecenie w systemie Linux służy do przypisania adresu IP oraz maski podsieci dla interfejsu eth0?

Podczas konserwacji i czyszczenia drukarki laserowej, która jest odłączona od zasilania, pracownik serwisu komputerowego może zastosować jako środek ochrony indywidualnej

Wskaż nośnik, który w sieciach komputerowych umożliwia najszybszą wymianę danych?

Wykonanie polecenia perfmon w terminalu systemu Windows spowoduje

W ramce przedstawiono treść jednego z plików w systemie operacyjnym MS Windows. Jest to plik

| [boot loader] Time out=30 Default=Multi(0)disk(0)rdisk(0)partition(1)WINDOWS [operating system] Multi(0)disk(0)rdisk(0)partition(1)WINDOWS="Microsoft Windows XP Home Edition"/ fastdetect/NoExecute=OptOut |

Wskaż procesor współpracujący z przedstawioną płytą główną.

Aby oddzielić komputery działające w sieci z tym samym adresem IPv4, które są podłączone do zarządzalnego przełącznika, należy przypisać

Jakie jest zastosowanie maty antystatycznej oraz opaski podczas instalacji komponentu?

W sieciach opartych na standardzie, jaką metodę dostępu do medium wykorzystuje CSMA/CA?

Jakie polecenie w systemach Windows/Linux jest zazwyczaj wykorzystywane do monitorowania trasy pakietów w sieciach IP?

Jakie pole znajduje się w nagłówku protokołu UDP?

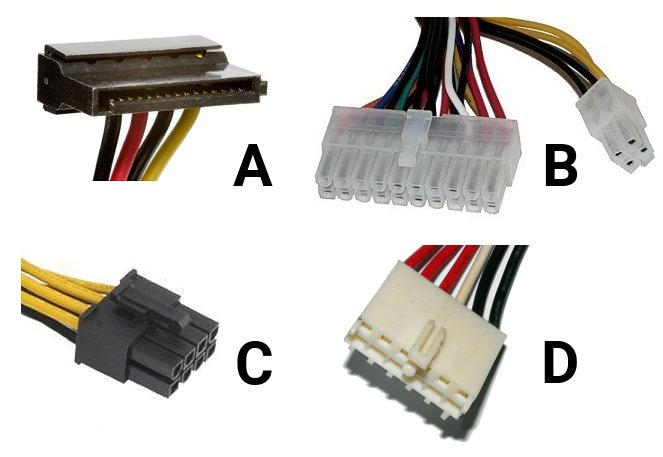

Wskaż rodzaj wtyczki zasilającej, którą należy podłączyć do napędu optycznego podczas montażu komputera.

Zgodnie z aktualnymi normami BHP, zalecana odległość oczu od ekranu monitora powinna wynosić