Pytanie 1

Rozpoczęcie badania TK nerek po 20-30 sekundach od początku podania środka kontrastowego umożliwia diagnostykę

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Rozpoczęcie badania TK nerek po 20-30 sekundach od początku podania środka kontrastowego umożliwia diagnostykę

W pracowni radioterapii wyświetlenie na ekranie monitora aparatu komunikatu „ROTATION” oznacza prowadzoną terapię

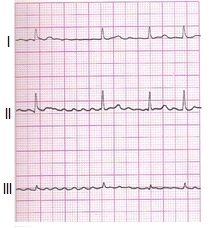

W zapisie EKG prawidłowego rytmu zatokowego wszystkie załamki P są

Wskazaniem do wykonania przesiewowego badania densytometrycznego jest

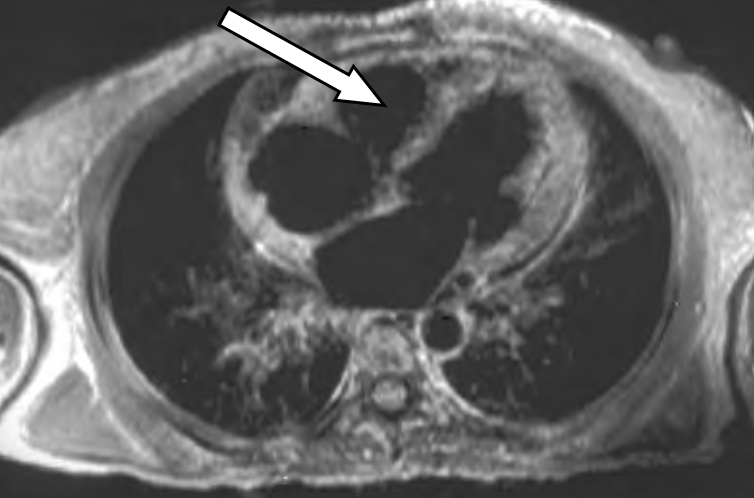

Na skanie rezonansu magnetycznego serca oznaczono

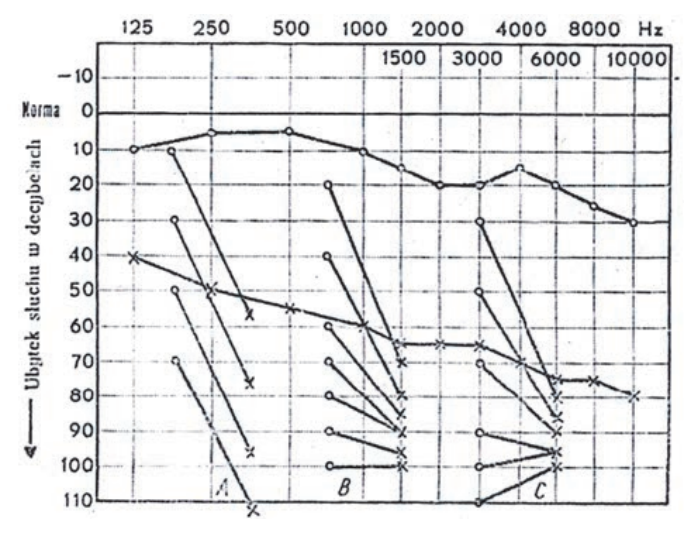

Audiogram przedstawia próbę

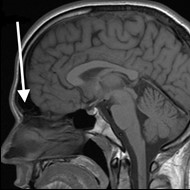

Na obrazie rezonansu magnetycznego głowy strzałką wskazano zatokę

W jakiej pozycji układa się pacjenta do standardowego badania MR kręgosłupa szyjnego?

W jaki sposób należy ustawić promień centralny w stosunku do ramienia i przedramienia, by wykonać zdjęcie rentgenograficzne stawu łokciowego u pacjenta z przykurczem?

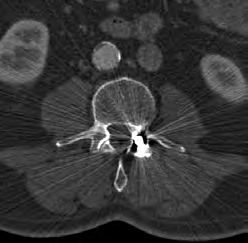

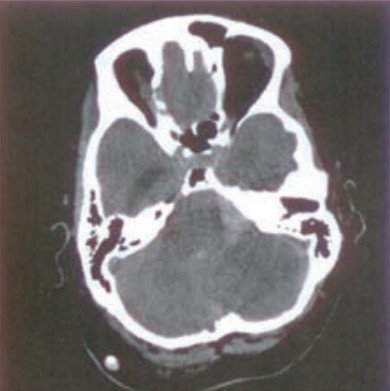

Który artefakt jest widoczny na skanie tomografii komputerowej?

Promieniowanie jonizujące pośrednio to

W pracowni ultrasonograficznej technik elektroradiolog nie korzysta z przepisów dotyczących

Obszary napromieniania w technice IMRT w trakcie wykonywania zabiegu radioterapeutycznego wyznacza

„Ognisko zimne” w obrazie scyntygraficznym określa się jako

Kiedy w procesie terapii wykonuje się badanie CBCT (cone beam computed tomography)?

Hałas podczas badania tomografii rezonansu magnetycznego jest efektem ubocznym pracy

Folia wzmacniająca umieszczona w kasecie rentgenowskiej emituje pod wpływem promieniowania X światło

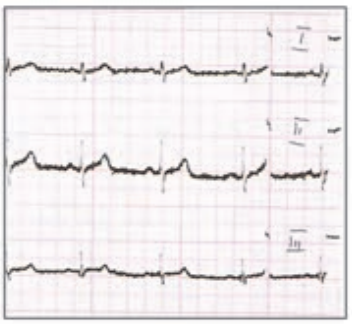

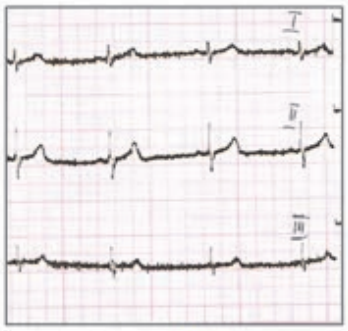

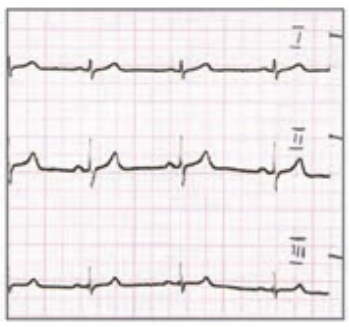

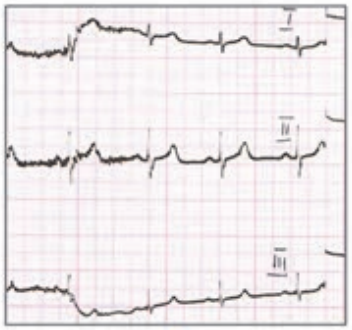

Który elektrokardiogram jest poprawny technicznie?

Odprowadzenie II rejestruje różnicę potencjałów między

Czas repetycji w obrazowaniu metodą rezonansu magnetycznego to

W którym okresie ciąży wykonanie u kobiety zdjęcia rentgenowskiego klatki piersiowej jest najbardziej szkodliwe dla płodu?

Obraz stawu kolanowego otrzymano metodą

W zapisie EKG załamki P dodatnie w odprowadzeniu I i II, a ujemne w aVR oraz częstotliwość rytmu mniejsza niż 60/min wskazują na

Jak przebiega promień centralny w projekcji AP czaszki?

W celu oceny wieku kostnego u dziecka praworęcznego, wykonuje się pojedyncze zdjęcie w projekcji

Kasety do pośredniej radiografii cyfrowej CR są wyposażone

Który z nowotworów jest hormonozależny?

Ilustracja przedstawia pozycjonowanie pacjentki do badania mammograficznego w projekcji

Zamieszczony obraz został wykonany metodą

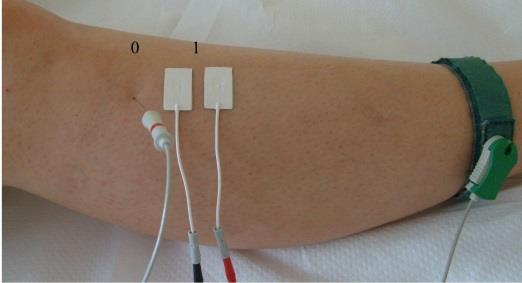

Na ilustracji przedstawiono przygotowanie pacjenta do badania

Podstawowym elementem diagnostycznym aparatury izotopowej wykorzystującej emisyjne metody pomiaru jest

W badaniu PET stosuje się tylko radioizotopy emitujące

Które środki kontrastujące wykorzystywane są w diagnostyce rezonansem magnetycznym?

Zamieszczone badanie elektrokardiograficzne wykazało u pacjenta

Testy specjalistyczne aparatów rentgenowskich do zdjęć wewnątrzustnych są przeprowadzane

Podczas którego badania zostały zarejestrowane przedstawione obrazy?

Która przyczyna spowodowała powstanie artefaktu widocznego na zamieszczonym obrazie MR?

Ligand stosuje się

Glukoza podawana pacjentowi w badaniu PET jest znakowana radioaktywnym

W badaniu EKG punktem przyłożenia odprowadzenia przedsercowego C2 jest