Pytanie 1

Jaką wartość ma transfer danych napędu DVD przy prędkości przesyłu x48?

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Jaką wartość ma transfer danych napędu DVD przy prędkości przesyłu x48?

Na przedstawionym panelu tylnym płyty głównej znajdują się między innymi następujące interfejsy:

Aby usunąć konto użytkownika student w systemie operacyjnym Ubuntu, można skorzystać z komendy

Aby nagrać dane na nośniku przedstawionym na ilustracji, konieczny jest odpowiedni napęd

Aby zatrzymać wykonywanie programu zapisanego w pliku wsadowym Windows do momentu naciśnięcia dowolnego klawisza, należy zastosować komendę

Można przywrócić pliki z kosza, korzystając z polecenia

Kabel pokazany na ilustracji może być zastosowany do realizacji okablowania sieci o standardzie

W której warstwie modelu ISO/OSI odbywa się segmentacja danych, komunikacja w trybie połączeniowym z użyciem protokołu TCP oraz komunikacja w trybie bezpołączeniowym z zastosowaniem UDP?

Najczęściej używany kodek audio przy ustawianiu bramki VoIP to

Jaka jest binarna reprezentacja adresu IP 192.168.1.12?

W norma PN-EN 50174 brak jest wskazówek odnoszących się do

Ile maksymalnie kanałów z dostępnego pasma kanałów w standardzie 802.11b może być używanych w Polsce?

Jakie polecenie uruchamia edytor polityk grup w systemach z rodziny Windows Server?

Jaką rolę pełni protokół DNS?

Profil mobilny staje się profilem obowiązkowym użytkownika po

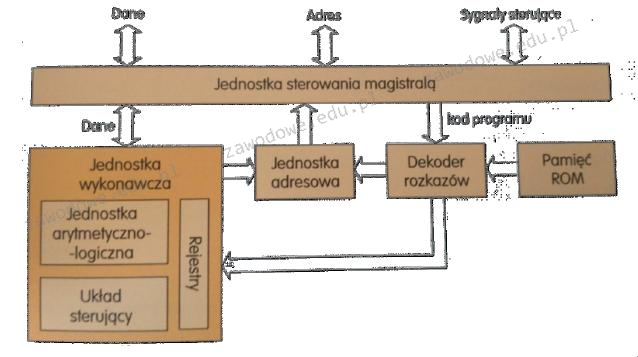

Na ilustracji przedstawiono schemat konstrukcji logicznej

Aktywacja opcji Udostępnienie połączenia internetowego w systemie Windows powoduje automatyczne przydzielanie adresów IP dla komputerów (hostów) z niej korzystających. W tym celu używana jest usługa

Która z poniższych opcji nie jest wykorzystywana do zdalnego zarządzania stacjami roboczymi?

Jak nazywa się materiał używany w drukarkach 3D?

W systemie Windows harmonogram zadań umożliwia przydzielenie

Jaki instrument jest wykorzystywany do sprawdzania zasilaczy komputerowych?

Urządzenie typu Plug and Play, które jest ponownie podłączane do komputera, jest identyfikowane na podstawie

Które z poniższych stwierdzeń odnosi się do sieci P2P - peer to peer?

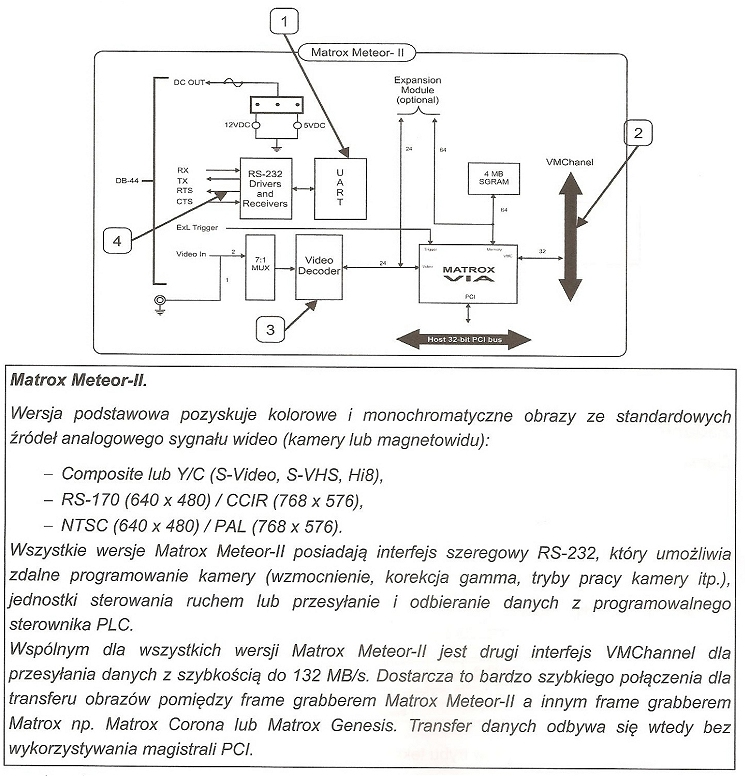

Który z elementów oznaczonych numerami od 1 do 4, ukazanych na schemacie blokowym frame grabbera oraz opisanych w fragmencie dokumentacji technicznej, jest odpowiedzialny za wymianę danych z innymi urządzeniami przetwarzającymi obraz wideo, unikając zbędnego obciążenia magistrali PCI?

Użytkownik systemu Windows napotyka komunikaty o zbyt małej ilości pamięci wirtualnej. W jaki sposób można rozwiązać ten problem?

Konwencja zapisu ścieżki do udziału sieciowego zgodna z UNC (Universal Naming Convention) ma postać

Jakie rozwiązanie należy wdrożyć i prawidłowo ustawić, aby chronić lokalną sieć komputerową przed atakami typu Smurf pochodzącymi z Internetu?

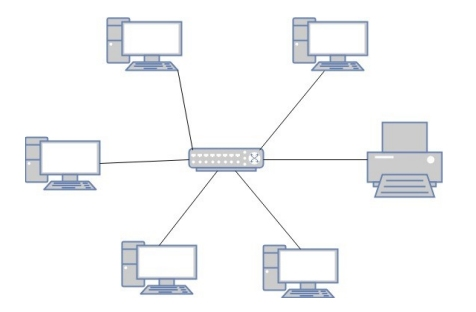

Jaką fizyczną topologię sieci komputerowej ilustruje ten rysunek?

Aby umożliwić transfer danych między dwiema odmiennymi sieciami, należy zastosować

Jakie urządzenie umożliwia połączenie sieci lokalnej z siecią rozległą?

Jeśli w określonej przestrzeni będą funkcjonowały równocześnie dwie sieci WLAN w standardzie 802.11g, to aby zredukować ryzyko wzajemnych zakłóceń, należy przypisać im kanały o numerach różniących się o

Atak na system komputerowy przeprowadzany jednocześnie z wielu maszyn w sieci, który polega na zablokowaniu działania tego systemu przez zajęcie wszystkich dostępnych zasobów, określany jest mianem

Jeśli rozdzielczość myszki wynosi 200 dpi, a rozdzielczość monitora to Full HD, to aby przesunąć kursor w poziomie po ekranie, należy przemieścić mysz o

Jaki akronim odnosi się do przepustowości sieci oraz usług, które mają między innymi na celu nadawanie priorytetów przesyłanym pakietom?

Jaki parametr powinien być użyty do wywołania komendy netstat, aby pokazać statystykę interfejsu sieciowego (ilość wysłanych oraz odebranych bajtów i pakietów)?

Czym jest układ RAMDAC?

Przedstawiony zestaw komputerowy jest niekompletny. Który element nie został uwzględniony w tabeli, a jest niezbędny do prawidłowego działania zestawu i należy go dodać?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Cooler Master obudowa komputerowa CM Force 500W czarna |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, TRAY/OEM |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Która z wymienionych czynności konserwacyjnych drukarek dotyczy tylko drukarki laserowej?

Błędy systemu operacyjnego Windows spowodowane przez konflikty zasobów sprzętowych, takie jak przydział pamięci, przydział przerwań IRQ i kanałów DMA, najłatwiej jest wykryć za pomocą narzędzia

Aby skonfigurować usługę rutingu w systemie Windows Serwer, należy zainstalować rolę