Pytanie 1

Który z pakietów powinien być zainstalowany na serwerze Linux, aby komputery z systemem Windows mogły udostępniać pliki oraz drukarki z tego serwera?

Wynik: 29/40 punktów (72,5%)

Wymagane minimum: 20 punktów (50%)

Który z pakietów powinien być zainstalowany na serwerze Linux, aby komputery z systemem Windows mogły udostępniać pliki oraz drukarki z tego serwera?

Aby aktywować tryb awaryjny w systemach z rodziny Windows, w trakcie uruchamiania komputera trzeba nacisnąć klawisz

W systemie Linux plik posiada uprawnienia ustawione na 541. Właściciel ma możliwość pliku

Jednym z narzędzi zabezpieczających system przed oprogramowaniem, które bez wiedzy użytkownika pozyskuje i wysyła jego autorowi dane osobowe, numery kart płatniczych, informacje o adresach stron WWW odwiedzanych przez użytkownika, hasła i używane adresy mailowe, jest program

Rodzajem macierzy RAID, która nie jest odporna na awarię dowolnego z dysków wchodzących w jej skład, jest

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakie narzędzie pozwala na zarządzanie menedżerem rozruchu w systemach Windows od wersji Vista?

W komunikacie o błędzie w systemie, informacja przedstawiana w formacie heksadecymalnym oznacza

Wskaż znak umieszczany na urządzeniach elektrycznych przeznaczonych do obrotu i sprzedaży w Unii Europejskiej.

ACPI to interfejs, który pozwala na

Protokół Transport Layer Security (TLS) jest rozszerzeniem którego z poniższych protokołów?

Który model pamięci RAM, można umieścić na płycie, której fragment specyfikacji przedstawiono na ilustracji?

| Pamięć | |

|---|---|

| Obsługiwana pamięć | DDR4 |

| Rodzaj obsługiwanej pamięci | DIMM (do PC) |

| Typ obsługiwanej pamięci | DDR4-2133 (PC4-17000) DDR4-2400 (PC4-19200) DDR4-2666 (PC4-21300) DDR4-2800 (PC4-22400) DDR4-3200 (PC4-25600) |

| Typ obsługiwanej pamięci OC | DDR4-3466 (PC4-27700) DDR4-3600 (PC4-28800) DDR4-3866 (PC4-30900) DDR4-4000 (PC4-32000) DDR4-4133 (PC4-33000) DDR4-4400 (PC4-35200) DDR4-4600 (PC4-36800) |

| Dwukanałowa obsługa pamięci | tak |

| Ilość gniazd pamięci | 4 szt. |

| Maks. pojemność pamięci | 128 GB |

Jakie narzędzie w systemie Windows pozwala na kontrolowanie stanu sprzętu, aktualizowanie sterowników oraz rozwiązywanie problemów z urządzeniami?

W komputerze o parametrach przedstawionych w tabeli konieczna jest wymiana karty graficznej na kartę GeForce GTX 1070 Ti Titanium 8G DDR5, PCI EX-x16 3.0, 256b, 1683 MHz/1607 MHz, Power consumption 180W, 3x DP, 2x HDMI, recommended power supply 500W, DirectX 12, OpenGL 4.5. W związku z tym należy również zaktualizować

| Podzespół | Parametry | Pobór mocy [W] |

|---|---|---|

| Procesor Intel i5 | Cores: 6, Threads: 6, 2.8 GHz, Tryb Turbo: 4.0 GHz, s-1151 | 30 |

| Moduł pamięci DDR3 | Taktowanie: 1600 MHz, 8 GB (1x8 GB), CL 9 | 6 |

| Monitor LCD | Powłoka: matowa, LED, VGA x1, HDMI x1, DP x1 | 40 |

| Mysz i klawiatura | przewodowa, interfejs: USB | 2 |

| Płyta główna | 2x PCI Ex-x16 3.0, D-Sub x1, USB 2.0 x2, RJ-45 x1, USB 3.1 gen 1 x4, DP x1, PS/2 x1, DDR3, s-1151, 4xDDR4 (Max: 64 GB) | 35 |

| Karta graficzna | 3x DP, 1x DVI-D, 1x HDMI, 2 GB GDDR3 | 150 |

| Dysk twardy 7200 obr/min | 1 TB, SATA III (6 Gb/s), 64 MB | 16 |

| Zasilacz | Moc: 300W | --- |

Który z systemów operacyjnych przeznaczonych do sieci jest dostępny na zasadach licencji GNU?

Jaką cechę posiada przełącznik w sieci?

Ile adresów urządzeń w sieci jest dostępnych dzięki zastosowaniu klasy adresowej C w systemach opartych na protokołach TCP/IP?

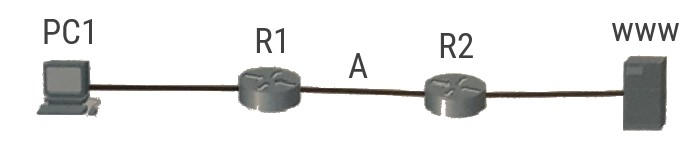

Ramka danych przesyłanych z komputera PC1 do serwera www znajduje się pomiędzy ruterem R1 a ruterem R2 (punkt A). Jakie adresy są w niej zawarte?

W nagłówku ramki standardu IEEE 802.3 w warstwie łącza danych znajduje się

Najkrótszy czas dostępu charakteryzuje się

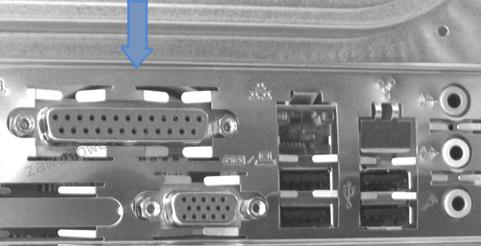

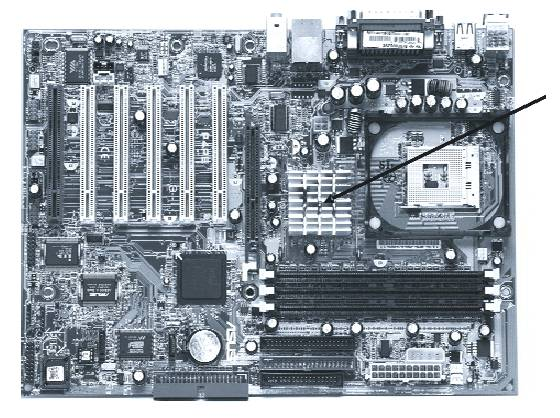

Na ilustracji, strzałka wskazuje na złącze interfejsu

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue press DEL to setup. Naciśnięcie klawisza DEL spowoduje

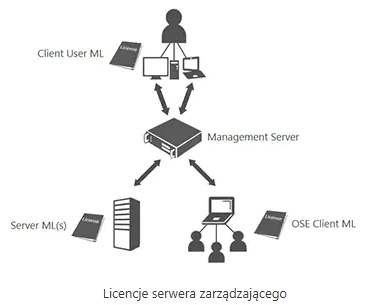

Wskaż model licencjonowania serwera zarządzającego (Management Serwer), oferowanego firmom przez Microsoft, którego schemat przedstawiono na ilustracji.

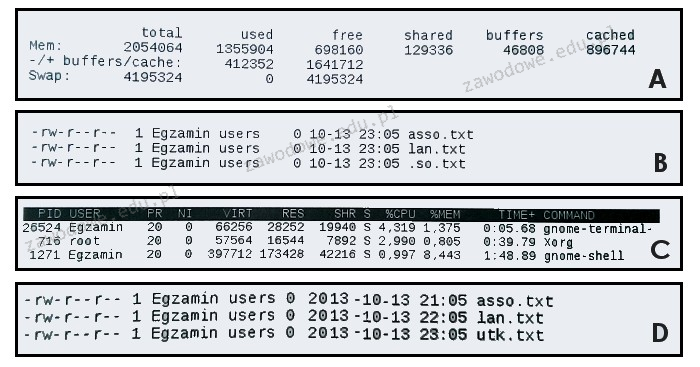

Wynik wykonania polecenia ```ls -l``` w systemie Linux przedstawia poniższy rysunek

Który z elementów szafy krosowniczej został pokazany na ilustracji?

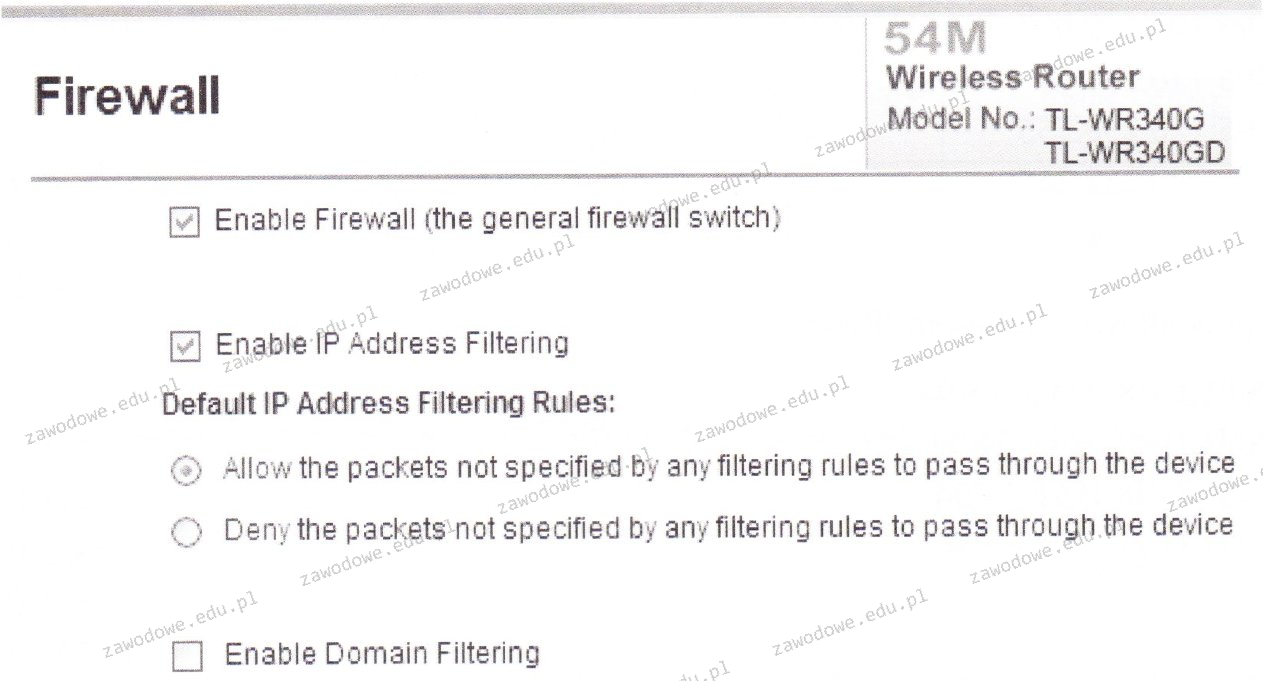

Na rysunku poniżej przedstawiono ustawienia zapory ogniowej w ruterze TL-WR340G. Jakie zasady dotyczące konfiguracji zapory zostały zastosowane?

Jakim protokołem połączeniowym w warstwie transportowej, który zapewnia niezawodność dostarczania pakietów, jest protokół

Program wykorzystywany w wierszu poleceń systemu Windows do kompresji i dekompresji plików oraz katalogów to

Jakie miejsce nie powinno być wykorzystywane do przechowywania kopii zapasowych danych z dysku twardego komputera?

Do przeprowadzenia aktualizacji systemu Windows służy polecenie

Jakie zadanie pełni router?

Aby zwiększyć wydajność komputera, można zainstalować procesor obsługujący technologię Hyper-Threading, która pozwala na

Liczba 129 w systemie dziesiętnym będzie przedstawiona w formacie binarnym na

W którym typie macierzy, wszystkie fizyczne dyski są postrzegane jako jeden dysk logiczny?

Ile maksymalnie kanałów z dostępnego pasma kanałów w standardzie 802.11b może być używanych w Polsce?

Przedstawiony moduł pamięci należy zamontować na płycie głównej w gnieździe

Na ilustracji pokazano płytę główną komputera. Strzałką wskazano

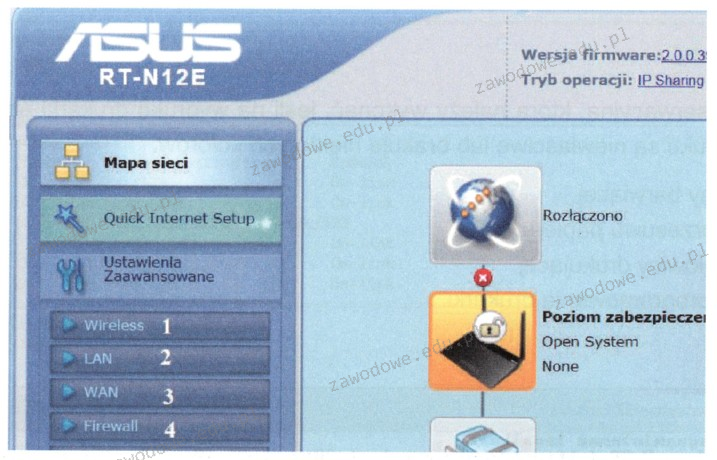

Aby skonfigurować ruter i wprowadzić parametry połączenia od dostawcy internetowego, którą sekcję oznaczoną numerem należy wybrać?

Do jednoczesnej zmiany tła pulpitu, kolorów okien, dźwięków oraz wygaszacza ekranu na komputerze z zainstalowanym systemem Windows należy wykorzystać

W specyfikacji procesora można znaleźć informację: "Procesor 32bitowy". Co to oznacza?