Pytanie 1

Czym charakteryzuje się atak typu hijacking na serwerze sieciowym?

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Czym charakteryzuje się atak typu hijacking na serwerze sieciowym?

Obrazek ilustruje rodzaj złącza

Kabel pokazany na ilustracji może być zastosowany do realizacji okablowania sieci o standardzie

Narzędziem wbudowanym w systemie Windows, wykorzystywanym do diagnozowania problemów związanych z działaniem animacji w grach lub odtwarzaniem filmów, jest

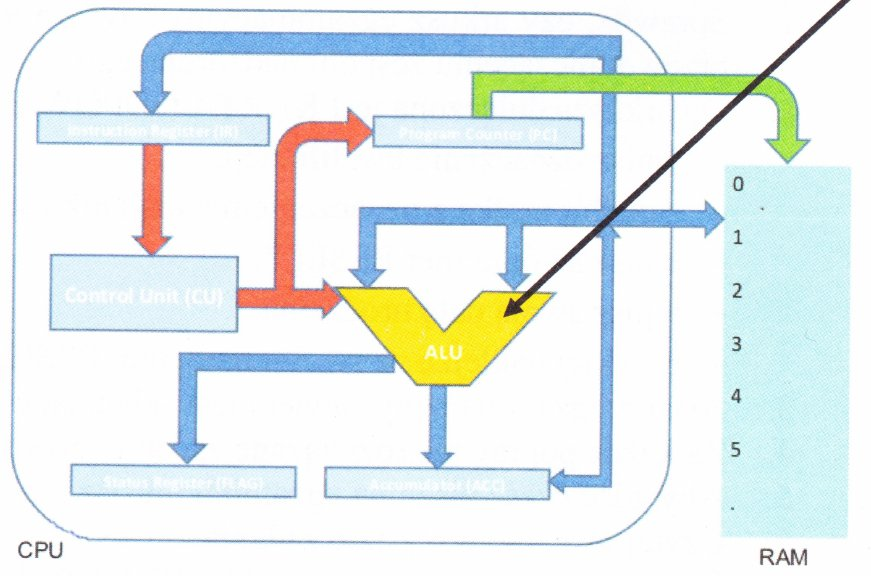

Na diagramie mikroprocesora zidentyfikowany strzałką blok odpowiada za

W standardzie IEEE 802.3af metoda zasilania różnych urządzeń sieciowych została określona przez technologię

Który protokół jest używany do zdalnego zarządzania komputerem przez terminal w systemach Linux?

Jak nazywa się urządzenie wskazujące, które współpracuje z monitorami CRT i ma końcówkę z elementem światłoczułym, a jego dotknięcie ekranu monitora wysyła sygnał do komputera, co pozwala na określenie pozycji kursora?

Który z protokołów umożliwia terminalowe połączenie ze zdalnymi urządzeniami, zapewniając jednocześnie transfer danych w zaszyfrowanej formie?

Protokół, który pozwala na ściąganie wiadomości e-mail z serwera, to

Najskuteczniejszym sposobem na dodanie skrótu do konkretnego programu na pulpitach wszystkich użytkowników w domenie jest

Postcardware to typ

Która z opcji konfiguracji ustawień konta użytkownika o ograniczonych uprawnieniach w systemie Windows jest dostępna dzięki narzędziu secpol?

W cenniku usług komputerowych znajdują się przedstawione niżej zapisy. Ile będzie wynosił koszt dojazdu serwisanta do klienta mieszkającego poza miastem, w odległości 15 km od siedziby firmy?

Dojazd do klienta na terenie miasta - 25 zł netto

Dojazd do klienta poza miastem - 2 zł netto za każdy km odległości od siedziby firmy liczony w obie strony.

Jeśli rozdzielczość myszy wynosi 200dpi, a monitor ma rozdzielczość Full HD, to aby przesunąć kursor wzdłuż ekranu, należy przesuń mysz o

ARP (Adress Resolution Protocol) jest protokołem, który umożliwia przekształcenie adresu IP na

Z jaką informacją wiąże się parametr TTL po wykonaniu polecenia ping?

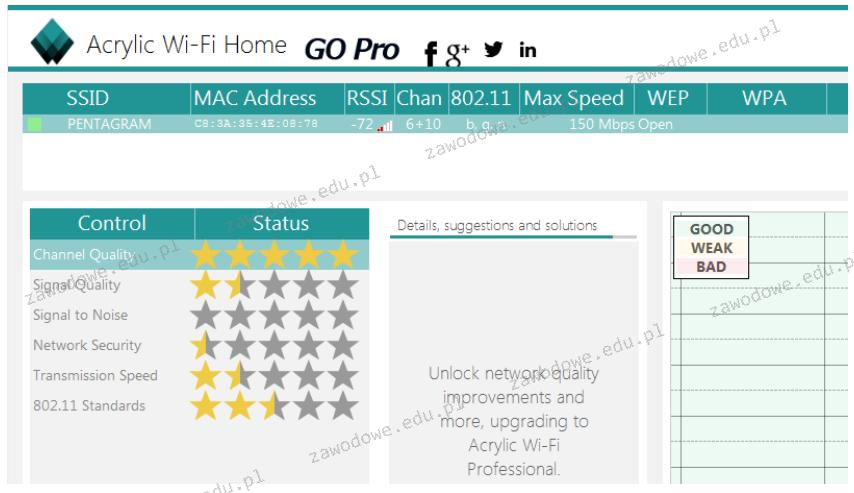

Wykonano test przy użyciu programu Acrylic Wi-Fi Home, a wyniki przedstawiono na zrzucie ekranu. Na ich podstawie można wnioskować, że dostępna sieć bezprzewodowa

Jakie urządzenie można kontrolować pod kątem parametrów za pomocą S.M.A.R.T.?

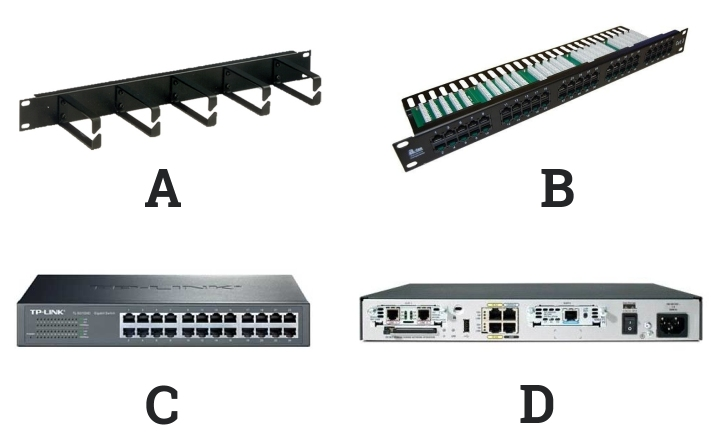

Urządzenie pokazane na ilustracji jest przeznaczone do

Funkcję S.M.A.R.T. w twardym dysku, która jest odpowiedzialna za nadzorowanie i wczesne ostrzeganie o możliwych awariach, można uruchomić poprzez

Na którym schemacie znajduje się panel krosowniczy?

Aby stworzyć partycję w systemie Windows, należy skorzystać z narzędzia

Norma PN-EN 50173 rekomenduje montaż przynajmniej

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Tworzenie obrazu dysku ma na celu

W jaki sposób oznaczona jest skrętka bez zewnętrznego ekranu, mająca każdą parę w osobnym ekranie folii?

Jaką maksymalną prędkość transferu danych pozwala osiągnąć interfejs USB 3.0?

Jakie urządzenie jest używane do łączenia lokalnej sieci bezprzewodowej z siecią kablową?

Którym poleceniem można skonfigurować uprawnienia do zasobów sieciowych w systemie Windows?

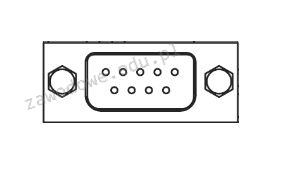

Na ilustracji ukazano port w komputerze, który służy do podłączenia

Ataki na systemy komputerowe, które odbywają się poprzez podstępne pozyskiwanie od użytkowników ich danych osobowych, często wykorzystywane są w postaci fałszywych komunikatów z różnych instytucji lub od dostawców usług e-płatności i innych znanych organizacji, to

Prawo majątkowe twórcy dotyczące oprogramowania komputerowego

Skrót MAN odnosi się do rodzaju sieci

Dodatkowe właściwości wyniku operacji przeprowadzanej przez jednostkę arytmetyczno-logiczna ALU zawiera

Jakie polecenie umożliwia śledzenie drogi datagramu IP do miejsca docelowego?

Bez zgody właściciela praw autorskich do oprogramowania jego legalny użytkownik, zgodnie z ustawą o prawie autorskim i prawach pokrewnych, co może zrobić?

Przyczyną niekontrolowanego wypełnienia przestrzeni na dysku może być

Najskuteczniejszym sposobem na ochronę komputera przed wirusami jest zainstalowanie

Jeżeli podczas uruchamiania systemu BIOS od AWARD komputer wydał długi sygnał oraz dwa krótkie, co to oznacza?