Pytanie 1

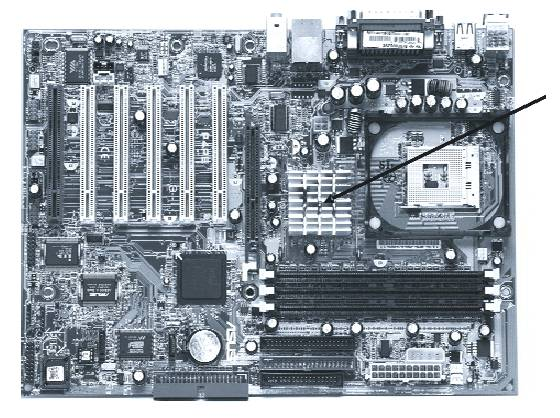

Na ilustracji pokazano płytę główną komputera. Strzałką wskazano

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Na ilustracji pokazano płytę główną komputera. Strzałką wskazano

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W systemie Linux narzędzie top pozwala na

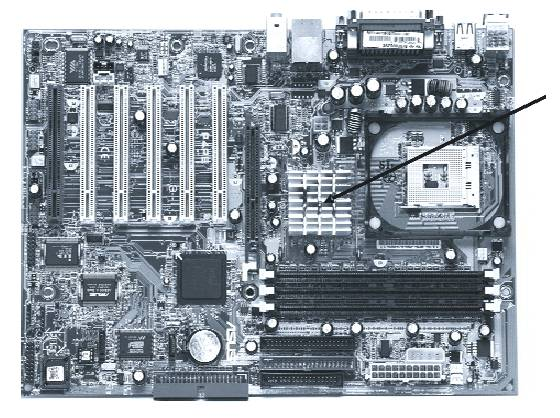

Aby za pomocą złącza DE-15F podłączyć przedstawiony projektor do laptopa, należy wykorzystać gniazdo oznaczone numerem

W topologii elementem centralnym jest switch

Główną rolą serwera FTP jest

Jak wygląda sekwencja w złączu RJ-45 według normy TIA/EIA-568 dla zakończenia typu T568B?

Jakie polecenie powinien wydać root w systemie Ubuntu Linux, aby przeprowadzić aktualizację wszystkich pakietów (całego systemu) do najnowszej wersji z zainstalowaniem nowego jądra?

Określenie najbardziej efektywnej trasy dla połączenia w sieci to

Aby zmienić ustawienia rozruchu komputera w systemie Windows 7 przy użyciu wiersza poleceń, jakie polecenie powinno być użyte?

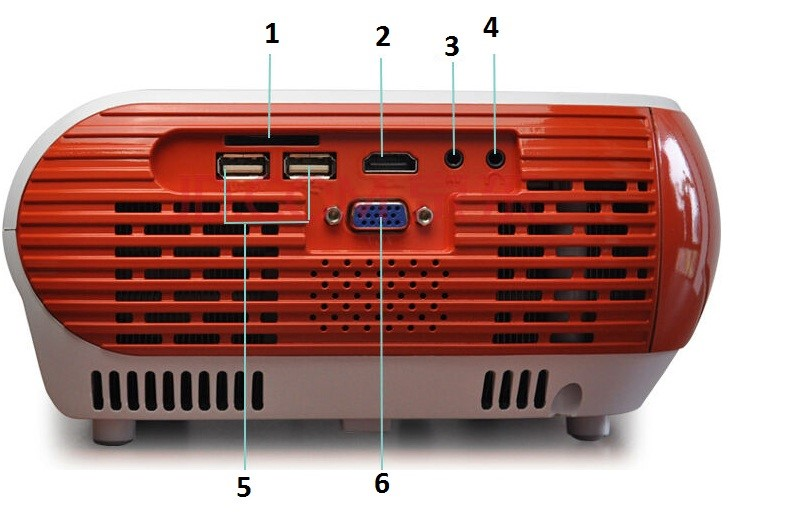

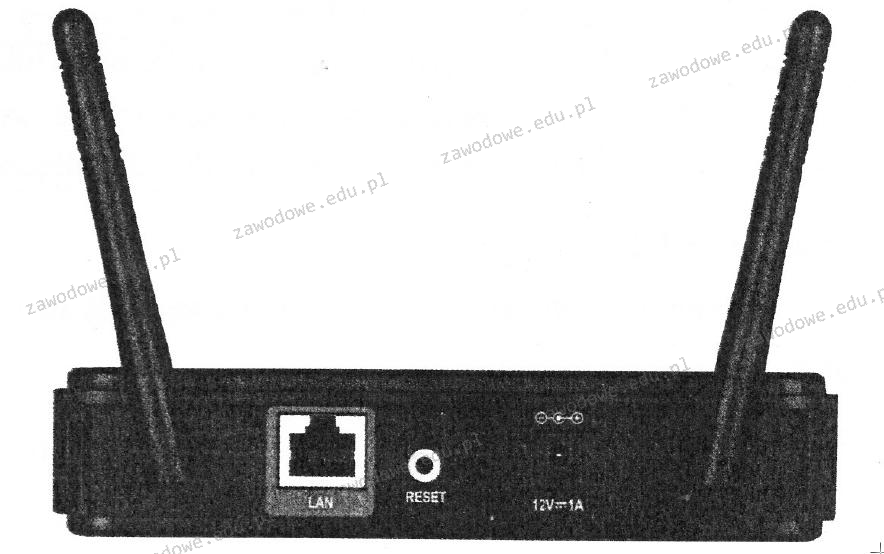

Jakie urządzenie zostało pokazane na ilustracji?

Dobrze zaplanowana sieć komputerowa powinna pozwalać na rozbudowę, co oznacza, że musi charakteryzować się

Co umożliwia zachowanie jednolitego rozkładu temperatury pomiędzy procesorem a radiatorem?

Która usługa pozwala na zdalne logowanie do komputerów, wykonywanie poleceń systemowych oraz zarządzanie siecią?

Aby stworzyć partycję w systemie Windows, należy skorzystać z narzędzia

W przypadku sieci strukturalnej rekomendowane jest zainstalowanie jednego punktu abonenckiego na obszarze wynoszącym

Aby zapobiec uszkodzeniu sprzętu w trakcie modernizacji laptopa polegającej na wymianie modułów pamięci RAM, należy

Urządzenie pokazane na ilustracji ma na celu

Który z protokołów jest używany w komunikacji głosowej przez internet?

Gdzie w dokumencie tekstowym Word umieszczony jest nagłówek oraz stopka?

Natychmiast po usunięciu ważnych plików na dysku twardym użytkownik powinien

Najskuteczniejszym sposobem na ochronę komputera przed wirusami jest zainstalowanie

Jaką długość ma adres IP wersji 4?

Najczęstszą przyczyną niskiej jakości wydruku z drukarki laserowej, która objawia się widocznym rozmazywaniem tonera, jest

Jakie urządzenie umożliwia połączenie sieci lokalnej z siecią rozległą?

Wskaż sygnał, który wskazuje na uszkodzenie karty graficznej w komputerze z BIOS POST od firmy AWARD?

Metoda zwana rytownictwem dotyczy zasady działania plotera

W jakiej topologii fizycznej sieci każde urządzenie ma dokładnie dwa połączenia, jedno z najbliższymi sąsiadami, a dane są przesyłane z jednego komputera do kolejnego w formie pętli?

Jak wiele adresów IP można wykorzystać do przypisania komputerom w sieci o adresie 192.168.100.0 z maską 255.255.255.0?

Zasilacz UPS o mocy nominalnej 480 W nie powinien być używany do zasilania

Na podstawie załączonego obrazu, który adres powinien zostać zmieniony w ustawieniach klienta lub serwera, aby umożliwić podłączenie komputera do domeny?

Jakie oznaczenie na schematach sieci LAN przypisuje się punktom rozdzielczym dystrybucyjnym znajdującym się na różnych kondygnacjach budynku według normy PN-EN 50173?

Aby komputery mogły udostępniać swoje zasoby w sieci, muszą mieć przypisane różne

Do pokazanej na ilustracji płyty głównej nie da się podłączyć urządzenia korzystającego z interfejsu

Gdy sprawny monitor zostaje podłączony do innego komputera, na ekranie ukazuje się komunikat widoczny na rysunku. Co powoduje pojawienie się tego komunikatu?

Jakie znaczenie ma termin "wykonanie kopii zapasowej systemu"?

Aby procesor działał poprawnie, konieczne jest podłączenie złącza zasilania 4-stykowego lub 8-stykowego o napięciu

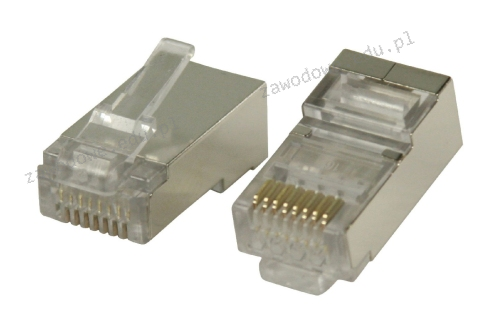

Wtyczka (modularne złącze męskie) przedstawiona na rysunku stanowi zakończenie przewodu

Kiedy wygasa autorskie prawo majątkowe dotyczące programu komputerowego, stworzonego przez kilku programistów, którzy jako jego autorzy podpisali aplikację swoimi imionami i nazwiskami?

CommView oraz WireShark to aplikacje wykorzystywane do