Pytanie 1

Do jakiego złącza, które pozwala na podłączenie monitora, jest wyposażona karta graficzna pokazana na ilustracji?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Do jakiego złącza, które pozwala na podłączenie monitora, jest wyposażona karta graficzna pokazana na ilustracji?

Jakie złącze jest potrzebne do podłączenia zasilania do CD-ROM?

Pamięć podręczna Intel Smart Cache, która znajduje się w procesorach wielordzeniowych, takich jak Intel Core Duo, to pamięć

Ile podsieci obejmują komputery z adresami: 192.168.5.12/25, 192.168.5.200/25 oraz 192.158.5.250/25?

Aby zwolnić adres IP przypisany do konkretnej karty sieciowej w systemie Windows, należy wykorzystać polecenie systemowe

Dodatkowe właściwości wyniku operacji przeprowadzanej przez jednostkę arytmetyczno-logiczna ALU zawiera

Jakie polecenie należy zastosować w systemach operacyjnych z rodziny Windows, aby ustawić plik w trybie tylko do odczytu?

W systemie Windows konto użytkownika można założyć za pomocą polecenia

Zanim zainstalujesz sterownik dla urządzenia peryferyjnego, system operacyjny Windows powinien weryfikować, czy sterownik ma ważny podpis

Instalacja serwera stron www w rodzinie systemów Windows Server jest możliwa dzięki roli

Jakie polecenie w systemie Windows powinno być użyte do obserwacji listy bieżących połączeń karty sieciowej w komputerze?

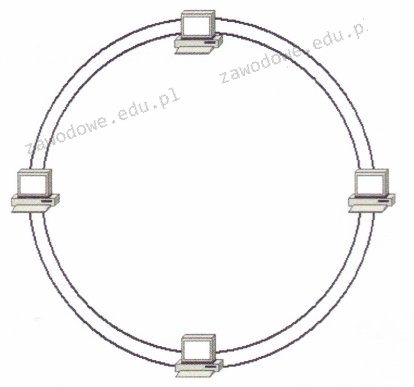

Na ilustracji zaprezentowano strukturę topologiczną

Na dysku należy umieścić 100 tysięcy oddzielnych plików, z których każdy ma rozmiar 2570 bajtów. W takim przypadku, zapisane pliki będą zajmować najmniej miejsca na dysku z jednostką alokacji wynoszącą

Zgodnie z normą PN-EN 50174, okablowanie poziome w systemie okablowania strukturalnego to segment okablowania pomiędzy

Jaką topologię fizyczną sieci komputerowej przedstawia rysunek?

Pozyskiwanie materiałów z odpadów w celu ich ponownego użycia to

Protokołem umożliwiającym bezpołączeniowe przesyłanie datagramów jest

Gdzie w dokumencie tekstowym Word umieszczony jest nagłówek oraz stopka?

W dokumentacji dotyczącej karty dźwiękowej można znaleźć informację: częstotliwość próbkowania 22 kHz oraz rozdzielczość próbkowania 16 bitów. Jaka będzie przybliżona objętość pliku audio z 10-sekundowym nagraniem mono (jednokanałowym)?

Jakim protokołem łączności, który gwarantuje pewne dostarczenie informacji, jest protokół

Demon serwera Samba pozwala na udostępnianie plików oraz drukarek w sieci

W systemie Linux polecenie chmod 321 start spowoduje nadanie następujących uprawnień plikowi start:

Jakie stwierdzenie o routerach jest poprawne?

Na urządzeniu znajduje się symbol, który stanowi certyfikat potwierdzający zgodność sprzętu w zakresie emisji promieniowania, ergonomii, efektywności energetycznej oraz ekologii, co przedstawiono na rysunku

Jakie polecenie w systemie Linux prawidłowo ustawia kartę sieciową, przypisując adres IP oraz maskę sieci dla interfejsu eth1?

W architekturze ISO/OSI protokoły TCP oraz UDP funkcjonują w warstwie

Z analizy danych przedstawionych w tabeli wynika, że efektywna częstotliwość pamięci DDR SDRAM wynosi 184 styki 64-bitowa magistrala danych Pojemność 1024 MB Przepustowość 3200 MB/s

Użycie skrętki kategorii 6 (CAT 6) o długości 20 metrów w sieci LAN wskazuje na jej maksymalną przepustowość wynoszącą

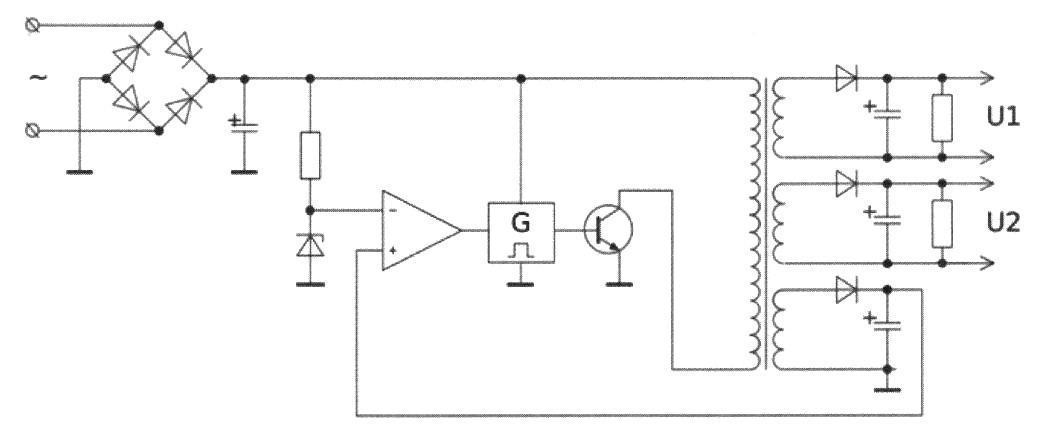

Na rysunku zobrazowano schemat

Jeżeli w konfiguracji karty graficznej zostanie wybrane odświeżanie obrazu większe od zalecanego, monitor CRT spełniający normy TCO 99

Jakie polecenie używa się do tworzenia kopii danych na pamięci USB w systemie Linux?

Przedstawione na ilustracji narzędzie służy do

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Wykonanie komendy NET USER GRACZ * /ADD w wierszu poleceń systemu Windows spowoduje

Jakie parametry mierzy watomierz?

Oprogramowanie, które pozwala na interakcję pomiędzy kartą sieciową a systemem operacyjnym, to

Na ilustracji widoczna jest pamięć operacyjna

Najwyższą prędkość transmisji danych w sieciach bezprzewodowych zapewnia standard

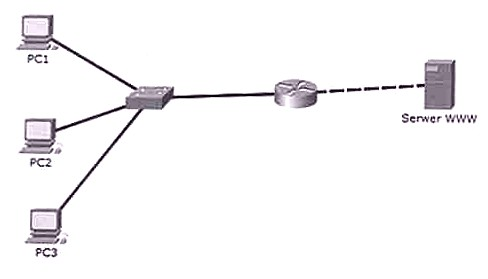

Użytkownicy w sieci lokalnej mogą się komunikować między sobą, lecz nie mają dostępu do serwera WWW. Wynik polecenia ping z komputerów bramy jest pozytywny. Który komponent sieci NIE MOŻE być powodem problemu?

Po zauważeniu przypadkowego skasowania istotnych danych na dysku, najlepszym sposobem na odzyskanie usuniętych plików jest