Pytanie 1

Komputer A, który potrzebuje przesłać dane do komputera B działającego w sieci z innym adresem IP, najpierw wysyła pakiety do adresu IP

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Komputer A, który potrzebuje przesłać dane do komputera B działającego w sieci z innym adresem IP, najpierw wysyła pakiety do adresu IP

Użycie polecenia net accounts w Wierszu poleceń systemu Windows, które ustawia maksymalny czas ważności hasła, wymaga zastosowania opcji

Który z wewnętrznych protokołów routingu bazuje na metodzie wektora odległości?

Do pielęgnacji elementów łożyskowych oraz ślizgowych w urządzeniach peryferyjnych wykorzystuje się

W systemie Linux, aby uzyskać informację o nazwie aktualnego katalogu roboczego, należy użyć polecenia

Na podstawie przedstawionego w tabeli standardu opisu pamięci PC-100 wskaż pamięć, która charakteryzuje się maksymalnym czasem dostępu wynoszącym 6 nanosekund oraz minimalnym opóźnieniem między sygnałami CAS i RAS równym 2 cyklom zegara?

| Specyfikacja wzoru: PC 100-abc-def jednolitego sposobu oznaczania pamięci. | ||

| a | CL (ang. CAS Latency) | minimalna liczba cykli sygnału taktującego, liczona podczas operacji odczytu, od momentu uaktywnienia sygnału CAS, do momentu pojawienia się danych na wyjściu modułu DIMM (wartość CL wynosi zwykle 2 lub 3); |

| b | tRCD (ang. RAS to CAS Delay) | minimalne opóźnienie pomiędzy sygnałami RAS i CAS, wyrażone w cyklach zegara systemowego; |

| c | tRP (ang. RAS Precharge) | czas wyrażony w cyklach zegara taktującego, określający minimalną pauzę pomiędzy kolejnymi komendami, wykonywanymi przez pamięć; |

| d | tAC | Maksymalny czas dostępu (wyrażony w nanosekundach); |

| e | SPD Rev | specyfikacja komend SPD (parametr może nie występować w oznaczeniach); |

| f | Parametr zapasowy | ma wartość 0; |

Gdzie w dokumencie tekstowym Word umieszczony jest nagłówek oraz stopka?

Jakie urządzenie powinno być użyte do podłączenia żył kablowych skrętki do gniazda Ethernet?

Które polecenie pozwala na mapowanie zasobów sieciowych w systemie Windows Serwer?

Jaką maksymalną ilość rzeczywistych danych można przesłać w ciągu 1 sekundy przez łącze synchroniczne o wydajności 512 kbps, bez użycia sprzętowej i programowej kompresji?

Który z podanych adresów IP v.4 należy do klasy C?

Komunikat biosu POST od firmy Award o treści "Display switch is set incorrectly" sugeruje

Jaki protokół do obsługi poczty elektronicznej pozwala na przykład na przechowywanie odebranych e-maili na serwerze, zarządzanie różnymi folderami, usuwanie wiadomości oraz przenoszenie ich pomiędzy folderami?

Programem służącym do archiwizacji danych w systemie Linux jest

Rysunek obrazuje zasadę działania drukarki

Złocenie styków złącz HDMI ma na celu

Po dokonaniu eksportu klucza HKCU stworzona zostanie kopia rejestru zawierająca dane o konfiguracji

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?

Która para: protokół – warstwa, w której funkcjonuje protokół, jest prawidłowo zestawiona według modelu TCP/IP?

Gdy chce się, aby jedynie wybrane urządzenia mogły uzyskiwać dostęp do sieci WiFi, należy w punkcie dostępowym

W biurze rachunkowym znajduje się sześć komputerów w jednym pomieszczeniu, połączonych kablem UTP Cat 5e z koncentratorem. Pracownicy korzystający z tych komputerów muszą mieć możliwość drukowania bardzo dużej ilości dokumentów monochromatycznych (powyżej 5 tys. stron miesięcznie). Aby zminimalizować koszty zakupu i eksploatacji sprzętu, najlepszym wyborem będzie:

W systemach Windows profil użytkownika tymczasowego jest

Do interfejsów pracujących równolegle należy interfejs

Narzędziem wykorzystywanym do diagnozowania połączeń między komputerami w systemie Windows jest

Do konfiguracji i personalizacji środowiska graficznego GNOME w różnych systemach Linux należy wykorzystać program

Który z protokołów umożliwia terminalowe połączenie ze zdalnymi urządzeniami, zapewniając jednocześnie transfer danych w zaszyfrowanej formie?

Co należy zrobić, gdy podczas uruchamiania komputera procedura POST sygnalizuje błąd odczytu lub zapisu pamięci CMOS?

Osoba odpowiedzialna za zarządzanie siecią komputerową pragnie ustalić, jakie połączenia są aktualnie nawiązywane na komputerze z systemem operacyjnym Windows oraz które porty są wykorzystywane do nasłuchu. W tym celu powinna użyć polecenia

W dokumentacji technicznej procesora znajdującego się na płycie głównej komputera, jaką jednostkę miary stosuje się do określenia szybkości zegara?

Jakie polecenie powinien wydać root w systemie Ubuntu Linux, aby przeprowadzić aktualizację wszystkich pakietów (całego systemu) do najnowszej wersji z zainstalowaniem nowego jądra?

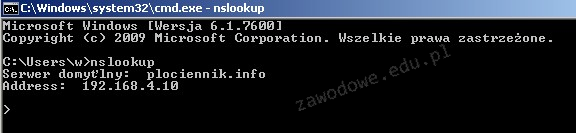

W terminalu systemu operacyjnego wydano komendę nslookup. Jakie dane zostały uzyskane?

Urządzenie warstwy dystrybucji, które realizuje połączenie pomiędzy różnymi sieciami oraz kontroluje przepływ informacji między nimi, nazywane jest

Jakie elementy wspierają okablowanie pionowe w sieci LAN?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Mamy do czynienia z siecią o adresie 192.168.100.0/24. Ile podsieci można utworzyć, stosując maskę 255.255.255.224?

Jakie urządzenie należy wykorzystać w sieci Ethernet, aby zredukować liczbę kolizji pakietów?

Router przypisany do interfejsu LAN dysponuje adresem IP 192.168.50.1. Został on skonfigurowany w taki sposób, aby przydzielać komputerom wszystkie dostępne adresy IP w sieci 192.168.50.0 z maską 255.255.255.0. Jaką maksymalną liczbę komputerów można podłączyć w tej sieci?

W systemach operacyjnych Windows konto użytkownika, które ma najwyższe domyślne uprawnienia, należy do grupy

W jakiej warstwie modelu ISO/OSI wykorzystywane są adresy logiczne?

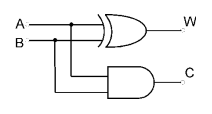

Jakie wartości logiczne otrzymamy w wyniku działania podanego układu logicznego, gdy na wejścia A i B wprowadzimy sygnały A=1 oraz B=1?