Pytanie 1

Użytkownik systemu Windows napotyka komunikaty o niewystarczającej pamięci wirtualnej. Jak można rozwiązać ten problem?

Wynik: 9/40 punktów (22,5%)

Wymagane minimum: 20 punktów (50%)

Użytkownik systemu Windows napotyka komunikaty o niewystarczającej pamięci wirtualnej. Jak można rozwiązać ten problem?

Która z ról w systemie Windows Server umożliwia m.in. zdalną, bezpieczną i uproszczoną instalację systemów operacyjnych Windows na komputerach w sieci?

Na podstawie danych przedstawionych w tabeli dotyczącej twardego dysku, ustal, który z wniosków jest poprawny?

Do konfiguracji i personalizacji środowiska graficznego GNOME w różnych systemach Linux należy wykorzystać program

Czynnikiem zagrażającym bezpieczeństwu systemu operacyjnego, który zmusza go do automatycznej aktualizacji, są

Licencja Windows OEM nie zezwala na wymianę

Strategia zapisywania kopii zapasowych ukazana na diagramie określana jest mianem

| Day | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 | 12 | 13 | 14 | 15 | 16 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Media Set | A | A | A | A | A | A | A | A | ||||||||

| B | B | B | B | |||||||||||||

| C | C | C | ||||||||||||||

| E |

Jakie polecenie trzeba wydać w systemie Windows, aby zweryfikować tabelę mapowania adresów IP na adresy MAC wykorzystywane przez protokół ARP?

Jakie polecenie w systemach Windows należy użyć, aby ustawić statyczny adres IP w konsoli poleceń?

Aby uruchomić monitor wydajności oraz niezawodności w systemie Windows, należy skorzystać z przystawki

Podaj polecenie w systemie Windows Server, które umożliwia usunięcie jednostki organizacyjnej z katalogu.

Proces aktualizacji systemów operacyjnych ma na celu przede wszystkim

Technik serwisowy, po przeprowadzeniu testu na serwerze NetWare, otrzymał informację, że obiekt dysponuje prawem

W systemie operacyjnym Linux proces archiwizacji danych wykonuje się za pomocą polecenia

Wykonanie polecenia tar –xf dane.tar w systemie Linux spowoduje

/dev/sda: Czas odczytu z pamięci podręcznej: 18100 MB w 2.00 sekundy = 9056.95 MB/sek. Przedstawiony wynik wykonania polecenia systemu Linux jest używany do diagnostyki

Po zainstalowaniu systemu z domyślnymi parametrami, Windows XP nie obsługuje tego systemu plików.

W systemie Windows powiązanie rozszerzeń plików z odpowiednimi programami realizuje się za pomocą polecenia

W systemach operacyjnych z rodziny Windows odpowiednikiem programu fsck z systemu Linux jest aplikacja

Użytkownik napotyka trudności przy uruchamianiu systemu Windows. W celu rozwiązania tego problemu, skorzystał z narzędzia System Image Recovery, które

Do zainstalowania serwera proxy w systemie Linux, konieczne jest zainstalowanie aplikacji

W podejściu archiwizacji danych określanym jako Dziadek – Ojciec – Syn na poziomie Dziadek wykonuje się kopię danych na koniec

Partycja w systemie Linux, która tymczasowo przechowuje dane w przypadku niedoboru pamięci RAM, to

Aby w systemie Windows nadać użytkownikowi możliwość zmiany czasu systemowego, potrzebna jest przystawka

Jednym z rezultatów realizacji podanego polecenia jest

| sudo passwd -n 1 -x 5 test |

Wykonanie polecenia net localgroup w systemie Windows skutkuje

Fragment pliku httpd.conf serwera Apache przedstawia się jak na diagramie. W celu zweryfikowania prawidłowego funkcjonowania strony WWW na serwerze, należy wprowadzić w przeglądarkę

| Listen 8012 |

| Server Name localhost:8012 |

Użytkownik napotyka trudności z uruchomieniem systemu Windows. W celu rozwiązania tego problemu skorzystał z narzędzia System Image Recovery, które

System operacyjny został poddany atakowi przez oprogramowanie szpiegujące. Po usunięciu problemów, aby zapobiec przyszłym atakom, należy

Oprogramowanie OEM (Original Equipment Manufacturer) jest przypisane do

Gdzie w systemie Linux umieszczane są pliki specjalne urządzeń, które są tworzone podczas instalacji sterowników?

Poniżej zaprezentowano fragment pliku konfiguracyjnego serwera w systemie Linux. Jaką usługi dotyczy ten fragment?

option domain-name "meinheimnetz";

ddns-update-style none;

default-lease-time 14400;

subnet 192.168.1.0 netmask 255.255.255.0 {

range 192.168.1.10 192.168.1.20;

default-lease-time 14400;

max-lease-time 172800;

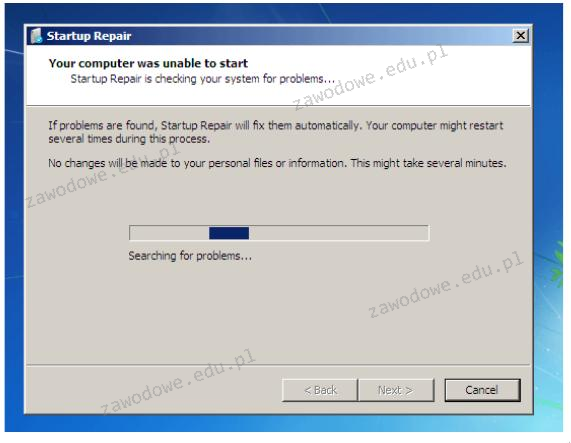

}Komunikat, który pojawia się po uruchomieniu narzędzia do naprawy systemu Windows, może sugerować

Domyślnie w programie Eksplorator Windows przy użyciu klawisza F5 uruchamiana jest funkcja

Rodzaj systemu plików, który w systemie Windows pozwala na kompresję danych oraz przydzielanie uprawnień do plików i folderów, to

Po wykonaniu podanego polecenia w systemie Windows: ```net accounts /MINPWLEN:11``` liczba 11 zostanie przydzielona dla

Jakie porty powinny być odblokowane w ustawieniach firewalla na komputerze, na którym działa usługa serwera WWW?

Jak najlepiej chronić zebrane dane przed dostępem w przypadku kradzieży komputera?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakiego rodzaju plik należy stworzyć w systemie operacyjnym, aby zautomatyzować rutynowe działania, takie jak kopiowanie lub tworzenie plików oraz folderów?