Pytanie 1

Wyższą efektywność aplikacji multimedialnych w systemach z rodziny Windows zapewnia technologia

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Wyższą efektywność aplikacji multimedialnych w systemach z rodziny Windows zapewnia technologia

Bęben światłoczuły stanowi kluczowy element w funkcjonowaniu drukarki

Jaką konfigurację sieciową może posiadać komputer, który należy do tej samej sieci LAN co komputer z adresem 192.168.1.10/24?

Aby przywrócić dane, które zostały usunięte dzięki kombinacji klawiszy Shift+Delete, trzeba

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Niekorzystną właściwością macierzy RAID 0 jest

Trzech użytkowników komputera z systemem operacyjnym Windows XP Pro posiada swoje foldery z dokumentami w głównym katalogu dysku C:. Na dysku znajduje się system plików NTFS. Użytkownicy mają utworzone konta z ograniczonymi uprawnieniami. Jak można zabezpieczyć folder każdego z użytkowników, aby inni nie mieli możliwości modyfikacji jego zawartości?

W komputerze użyto płyty głównej widocznej na obrazku. Aby podnieść wydajność obliczeniową maszyny, zaleca się

W którym z rejestrów wewnętrznych procesora są przechowywane dodatkowe informacje o wyniku realizowanej operacji?

Na diagramie okablowania strukturalnego przy jednym z komponentów znajduje się oznaczenie MDF. Z którym punktem dystrybucji jest powiązany ten komponent?

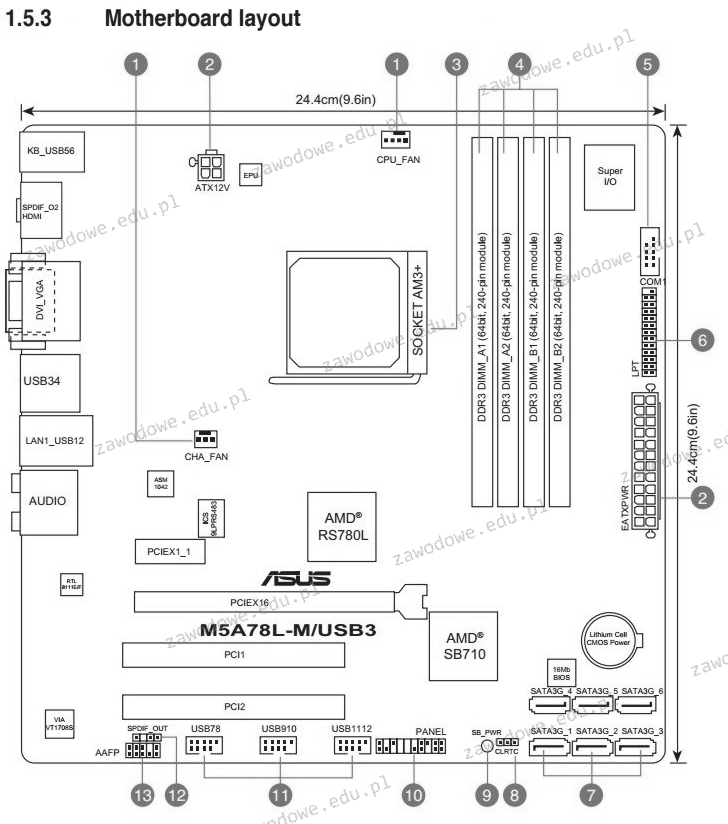

Jaki procesor powinien być zastosowany podczas składania komputera stacjonarnego opartego na płycie głównej Asus M5A78L-M/USB3 AMD760G socket AM3+?

Jak nazywa się bezklasowa metoda podziału przestrzeni adresowej IPv4?

Pamięć podręczna Intel Smart Cache, która znajduje się w procesorach wielordzeniowych, takich jak Intel Core Duo, to pamięć

Aby uniknąć uszkodzenia sprzętu podczas modernizacji komputera przenośnego polegającej na wymianie modułów pamięci RAM należy

Jakie narzędzie służy do usuwania izolacji z włókna światłowodowego?

NAT64 (Network Address Translation 64) to proces, który dokonuje mapowania adresów

W schemacie logicznym struktury okablowania, zgodnie z polską terminologią zawartą w normie PN-EN 50174, cechą kondygnacyjnego punktu dystrybucyjnego jest to, że

Internet Relay Chat (IRC) to protokół wykorzystywany do

Która z licencji na oprogramowanie wiąże je trwale z zakupionym komputerem i nie pozwala na przenoszenie praw użytkowania programu na inny komputer?

Członkowie grupy Pracownicy nie mają możliwości drukowania dokumentów za pośrednictwem serwera wydruku w systemie Windows Server. Posiadają jedynie przydzielone uprawnienia 'Zarządzanie dokumentami'. Co trzeba zrobić, aby rozwiązać ten problem?

W którym miejscu w edytorze tekstu należy wprowadzić tekst lub ciąg znaków, który ma być widoczny na wszystkich stronach dokumentu?

Jakie medium transmisyjne powinno być użyte do połączenia dwóch punktów dystrybucyjnych oddalonych od siebie o 600m?

Przedstawione na ilustracji narzędzie służy do

Jak w systemie Windows zmienić port drukarki, która została zainstalowana?

Na wydruku z drukarki laserowej występują jasne i ciemne fragmenty. Jakie działania należy podjąć, by poprawić jakość druku oraz usunąć problemy z nieciągłością?

Jakie parametry można śledzić w przypadku urządzenia przy pomocy S.M.A.R.T.?

Jaki typ zabezpieczeń w sieciach WiFi oferuje najwyższy poziom ochrony?

Aby przygotować do pracy skaner, którego opis zawarto w tabeli, należy w pierwszej kolejności

| Skaner przenośny IRIScanBook 3 |

| Bezprzewodowy, zasilany baterią i bardzo lekki. Można go przenosić w dowolne miejsce! |

| Idealny do skanowania książek, czasopism i gazet |

| Rozdzielczość skanowania 300/600/900 dpi |

| Prędkość skanowania: 2 sek. dla tekstów biało-czarnych / 3 sek. dla tekstów kolorowych |

| Bezpośrednie skanowanie do formatu PDF i JPEG |

| Zapis skanu na kartę microSD ™ (w zestawie) |

| Kolorowy ekran (do podglądu zeskanowanych obrazów) |

| 3 baterie alkaliczne AAA (w zestawie) |

Aby wykonać ręczne ustawienie interfejsu sieciowego w systemie LINUX, należy użyć polecenia

Aby zapewnić największe bezpieczeństwo danych przy wykorzystaniu dokładnie 3 dysków, powinny one być zapisywane w macierzy dyskowej

Który z podanych adresów protokołu IPv4 jest adresem klasy D?

Program testujący wydajność sprzętu komputerowego to

Który algorytm służy do weryfikacji, czy ramka Ethernet jest wolna od błędów?

Ile portów USB może być dostępnych w komputerze wyposażonym w tę płytę główną, jeśli nie używa się huba USB ani dodatkowych kart?

W sytuacji, gdy brakuje odpowiedniej ilości pamięci RAM do przeprowadzenia operacji, takiej jak uruchomienie aplikacji, system Windows pozwala na przeniesienie nieużywanych danych z pamięci RAM do pliku

Aby móc zakładać konta użytkowników, komputerów oraz innych obiektów i centralnie gromadzić o nich informacje, należy zainstalować rolę na serwerze Windows

Jakie znaczenie ma parametr NEXT w kontekście pomiarów systemów okablowania strukturalnego?

Wskaż podzespół niekompatybilny z płytą główną o przedstawionych w tabeli parametrach.

| Podzespół | Parametry |

|---|---|

| Płyta główna GIGABYTE | 4x DDR4, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8x USB 2.0, S-AM3+ |

Do dynamicznej obsługi sprzętu w Linuxie jest stosowany system

Przesyłanie danych przez router, które wiąże się ze zmianą adresów IP źródłowych lub docelowych, określa się skrótem