Pytanie 1

Jakie jest zadanie programu Wireshark?

Wynik: 7/40 punktów (17,5%)

Wymagane minimum: 20 punktów (50%)

Jakie jest zadanie programu Wireshark?

Graficzny symbol odnosi się do standardów sprzętowych

Element płyty głównej odpowiedzialny za wymianę danych między mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej jest na rysunku oznaczony numerem

Jakie polecenie w systemie Windows służy do monitorowania bieżących połączeń sieciowych?

W komputerze połączonym z Internetem, w oprogramowaniu antywirusowym aktualizację bazy wirusów powinno się przeprowadzać minimum

Który z podanych adresów IPv4 stanowi adres publiczny?

Główny sposób zabezpieczania danych w sieciach komputerowych przed dostępem nieautoryzowanym to

Grupa protokołów, która charakteryzuje się wspólną metodą szyfrowania, to

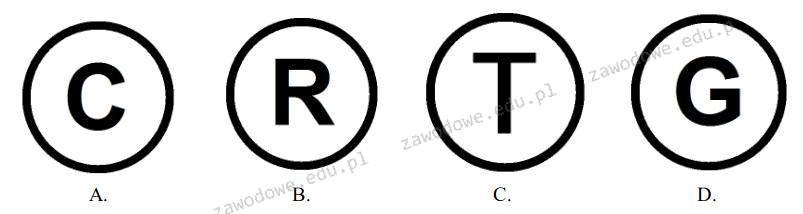

Który symbol wskazuje na zastrzeżenie praw autorskich?

Jakie polecenie powinien zastosować użytkownik systemu Linux, aby wydobyć zawartość archiwum o nazwie dane.tar?

Aby zwiększyć wydajność komputera, można zainstalować procesor obsługujący technologię Hyper-Threading, która pozwala na

Po skompresowaniu adresu 2001:0012:0000:0000:0AAA:0000:0000:000B w protokole IPv6 otrzymujemy formę

Jakie urządzenie w warstwie łącza danych modelu OSI analizuje adresy MAC zawarte w ramkach Ethernet i na tej podstawie decyduje o przesyłaniu sygnału między segmentami sieci lub jego blokowaniu?

Urządzenie przedstawione na ilustracji oraz jego dane techniczne mogą być użyte do pomiarów rodzaju okablowania

Pamięć, która działa jako pośrednik pomiędzy pamięcią operacyjną a procesorem o dużej prędkości, to

Nie wykorzystuje się do zdalnego kierowania stacjami roboczymi

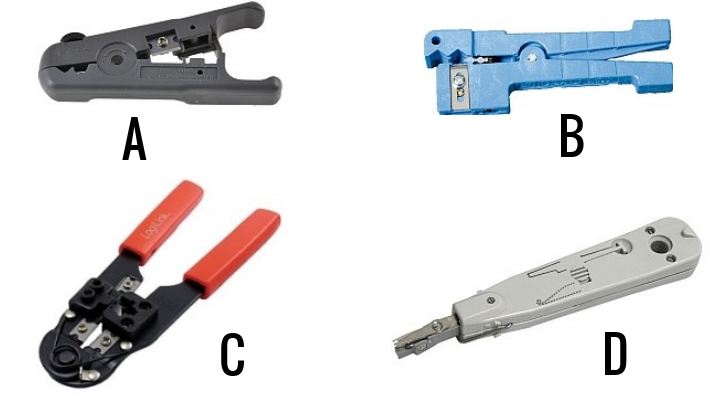

Jakie narzędzie wykorzystuje się do przytwierdzania kabla w module Keystone?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Które urządzenie może zostać wykorzystane do rutowania ruchu sieciowego między sieciami VLAN?

Do przeprowadzenia aktualizacji systemów Linux można zastosować aplikacje

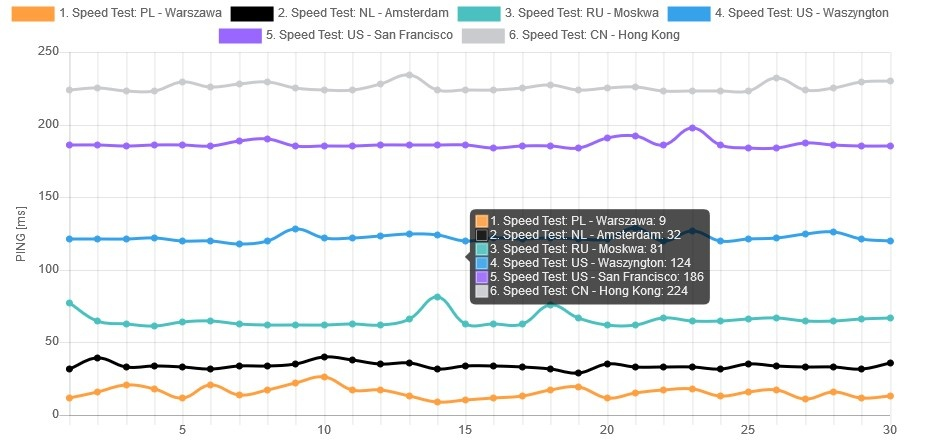

Na podstawie przedstawionego na ilustracji okna aplikacji do monitorowania łącza internetowego można określić

W systemie Windows zastosowanie zaprezentowanego polecenia spowoduje chwilową modyfikację koloru

Microsoft Windows [Version 10.0.14393] (c) 2016 Microsoft Corporation. Wszelkie prawa zastrzeżone. C:\Users\ak>color 1

Uszkodzenie czego może być przyczyną awarii klawiatury?

W układzie SI jednostką, która mierzy napięcie, jest

W którym trybie działania procesora Intel x86 uruchamiane były aplikacje 16-bitowe?

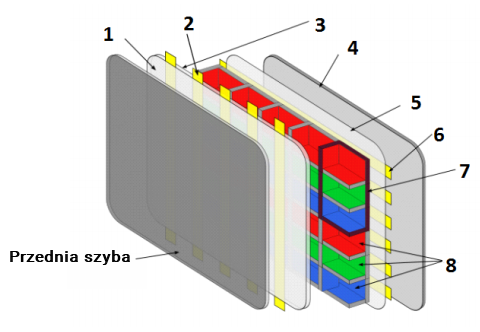

Na diagramie przedstawiającym zasadę funkcjonowania monitora plazmowego, oznaczenie numer 6 dotyczy

Która z poniższych opcji nie jest usługą katalogową?

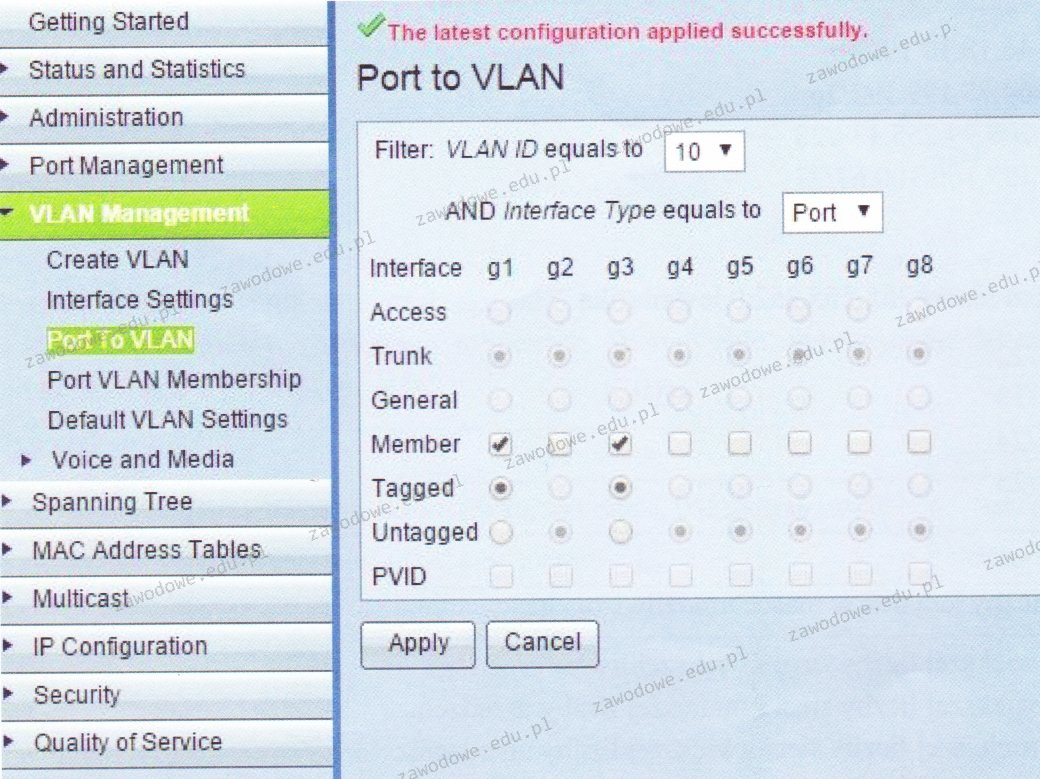

Na ilustracji przedstawiona jest konfiguracja

Który z poniższych adresów IPv4 należy do klasy C?

Aby w przeglądarce internetowej wyczyścić dane dotyczące adresów przeglądanych witryn, należy między innymi podać

Jakiego typu macierz RAID nie zapewnia odporności na awarie żadnego z dysków tworzących jej strukturę?

W celu zainstalowania serwera proxy w systemie Linux, należy wykorzystać oprogramowanie

Zużyty sprzęt elektryczny lub elektroniczny, na którym znajduje się symbol zobrazowany na ilustracji, powinien być

W systemie operacyjnym Ubuntu konto użytkownika student można wyeliminować przy użyciu komendy

W którym z rejestrów wewnętrznych procesora są przechowywane dodatkowe informacje o wyniku realizowanej operacji?

Zjawisko, w którym pliki przechowywane na dysku twardym są umieszczane w nieprzylegających do siebie klastrach, nosi nazwę

Atak DDoS (ang. Disributed Denial of Service) na serwer doprowadzi do

Jakie cechy posiadają procesory CISC?

Jakie oznaczenie powinien mieć komputer, aby mógł zostać sprzedany na terenie Polski, zgodnie z Dyrektywami Rady Europy?

Ile adresów można przypisać urządzeniom działającym w sieci o adresie IP 192.168.20.0/26?