Pytanie 1

Zachowanie kopii często odwiedzanych witryn oraz zwiększenie ochrony przez filtrowanie pewnych treści witryn internetowych można osiągnąć dzięki

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Zachowanie kopii często odwiedzanych witryn oraz zwiększenie ochrony przez filtrowanie pewnych treści witryn internetowych można osiągnąć dzięki

Komunikat tekstowy KB/Interface error, wyświetlony na ekranie komputera z BIOS POST firmy AMI, informuje o błędzie

Pliki specjalne urządzeń, tworzone podczas instalacji sterowników w systemie Linux, są zapisywane w katalogu

W systemie Linux do śledzenia wykorzystania procesora, pamięci, procesów oraz obciążenia systemu wykorzystuje się polecenie

W klasycznym adresowaniu, adres IP 74.100.7.8 przynależy do

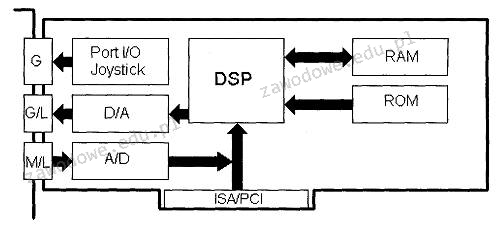

Element funkcjonalny opisany jako DSP w załączonym diagramie blokowym to

ACPI to akronim, który oznacza

W systemie Linux do bieżącego śledzenia działających procesów wykorzystuje się polecenie:

Zasadniczym sposobem zabezpieczenia danych przechowywanych na serwerze jest

Menadżer rozruchu, który umożliwia wybór systemu operacyjnego Linux do załadowania, to

Na ilustracji ukazano kartę

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie urządzenia wyznaczają granice domeny rozgłoszeniowej?

Z jakim protokołem związane są terminy "Sequence number" oraz "Acknowledgment number"?

Pracownik serwisu komputerowego podczas wykonywania konserwacji i czyszczenia drukarki laserowej, odłączonej od źródła zasilania, może wykorzystać jako środek ochrony indywidualnej

Programem wykorzystywanym w systemie Linux do odtwarzania muzyki jest

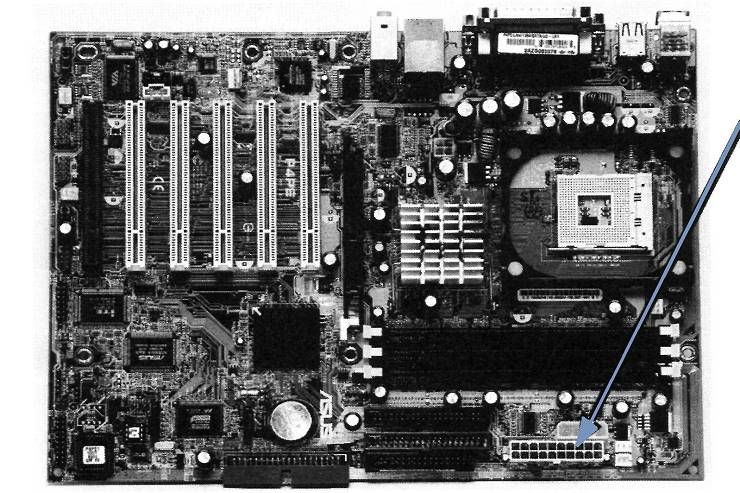

Na zdjęciu widać płytę główną komputera. Strzałka wskazuje na

Na zdjęciu ukazano złącze zasilające

W jakim trybie pracy znajduje się system Linux, kiedy osiągalny jest tylko minimalny zestaw funkcji systemowych, często używany do napraw?

Jakie jest źródło pojawienia się komunikatu na ekranie komputera, informującego o wykryciu konfliktu adresów IP?

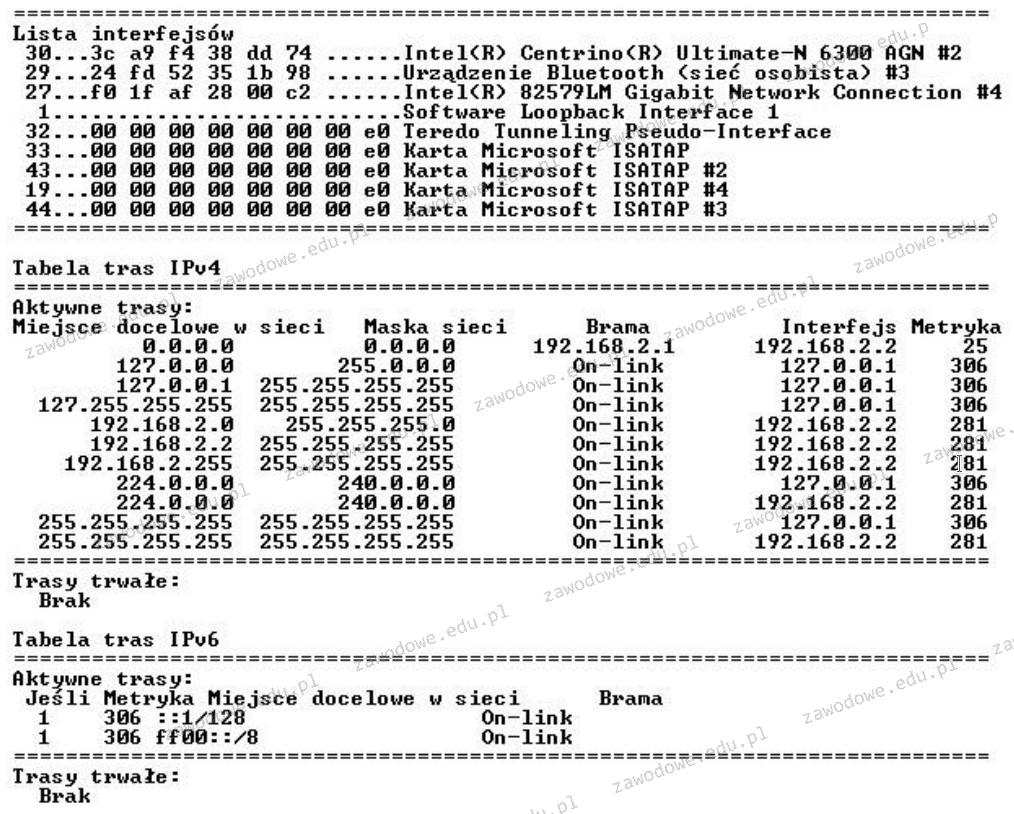

Jaki jest rezultat realizacji którego polecenia w systemie operacyjnym z rodziny Windows, przedstawiony na poniższym rysunku?

Aby zmierzyć moc zużywaną przez komputer, należy zastosować

Aby oddzielić komputery pracujące w sieci z tym samym adresem IPv4, które są podłączone do przełącznika zarządzalnego, należy przypisać

Planowanie wykorzystania przestrzeni na dysku komputera do gromadzenia i udostępniania informacji takich jak pliki oraz aplikacje dostępne w sieci, a także ich zarządzanie, wymaga skonfigurowania komputera jako

Pozyskiwanie surowców z odpadów w celu ich ponownego zastosowania to

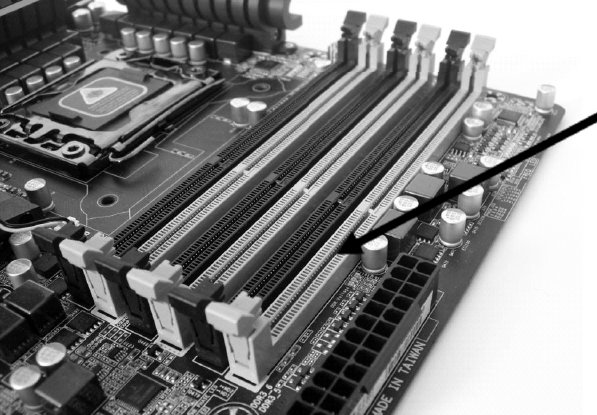

Jaki typ pamięci powinien być umieszczony na płycie głównej komputera w miejscu, które wskazuje strzałka?

Czym jest dziedziczenie uprawnień?

Aby przygotować do pracy skaner, którego opis zawarto w tabeli, należy w pierwszej kolejności

| Skaner przenośny IRIScanBook 3 |

| Bezprzewodowy, zasilany baterią i bardzo lekki. Można go przenosić w dowolne miejsce! |

| Idealny do skanowania książek, czasopism i gazet |

| Rozdzielczość skanowania 300/600/900 dpi |

| Prędkość skanowania: 2 sek. dla tekstów biało-czarnych / 3 sek. dla tekstów kolorowych |

| Bezpośrednie skanowanie do formatu PDF i JPEG |

| Zapis skanu na kartę microSD ™ (w zestawie) |

| Kolorowy ekran (do podglądu zeskanowanych obrazów) |

| 3 baterie alkaliczne AAA (w zestawie) |

Który z wymienionych parametrów procesora AMD APU A10 5700 3400 nie ma bezpośredniego wpływu na jego wydajność?

| Częstotliwość | 3400 MHz |

| Proces technologiczny | 32 nm |

| Architektura | 64 bit |

| Ilość rdzeni | 4 |

| Ilość wątków | 4 |

| Pojemność pamięci L1 (instrukcje) | 2x64 kB |

| Pojemność pamięci L1 (dane) | 4x16 kB |

| Pojemność Pamięci L2 | 2x2 MB |

Wymianę uszkodzonych kondensatorów karty graficznej umożliwi

Jakie medium transmisyjne nosi nazwę 100BaseTX i jaka jest maksymalna prędkość danych, która może być w nim osiągnięta?

Aby powiększyć lub zmniejszyć rozmiar ikony na pulpicie, trzeba obracać rolką myszki, trzymając jednocześnie klawisz

Jakie medium transmisyjne w sieciach LAN zaleca się do użycia w budynkach zabytkowych?

Kable łączące dystrybucyjne punkty kondygnacyjne z głównym punktem dystrybucji są określane jako

Oprogramowanie komputerowe, które można używać bezpłatnie i bez czasowych ograniczeń, jest udostępniane na mocy licencji typu

Jakie działanie może skutkować nieodwracalną utratą danych w przypadku awarii systemu plików?

Na diagramie zaprezentowano strukturę

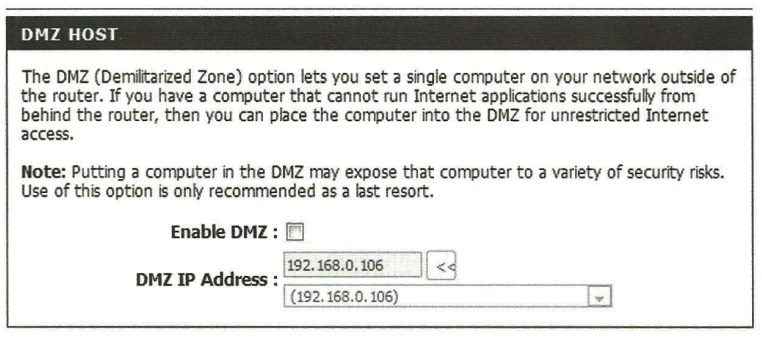

Na ilustracji zaprezentowano zrzut ekranu z ustawień DMZ na routerze. Aktywacja opcji "Enable DMZ" spowoduje, że komputer o adresie IP 192.168.0.106

Jakie pole znajduje się w nagłówku protokołu UDP?

Aby zwiększyć efektywność komputera, można w nim zainstalować procesor wspierający technologię Hyper-Threading, co umożliwia