Pytanie 1

Fale mózgowe alfa, beta, gamma, delta i theta są rejestrowane w

Wynik: 2/40 punktów (5,0%)

Wymagane minimum: 20 punktów (50%)

Fale mózgowe alfa, beta, gamma, delta i theta są rejestrowane w

Technologia OLED znajduje zastosowanie w

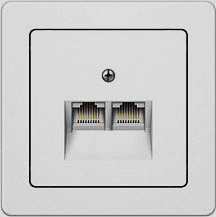

W sieci centralnego monitoringu zamontowane są gniazda przedstawione na rysunku. Jakiego typu wtykami muszą być zakończone kable?

Zjawisko polegające na zmianie częstotliwości fali odbitej od poruszającego się obiektu jest wykorzystywane w

Jak nazywa się w programowaniu obiektowym instancję klasy?

Moduł EKG do badań wysiłkowych został wyposażony w interfejs Bluetooth w celu przesyłania wyników badań. Aby połączyć moduł z stanowiskiem komputerowym, należy wybrać interfejs oznaczony symbolem

W celu archiwizacji danych w systemie Linux wymagane jest utworzenie archiwum. Korzystając z zamieszczonej w ramce pomocy dobierz odpowiednie polecenie.

| -c, --create | utworzenie nowego archiwum |

| -z, --gzip | filtrowanie archiwum przez gzip |

| -v, --verbose | wypisywanie szczegółów o przetwarzanych plikach |

| -f, --file=ARCHIWUM | użycie pliku lub urządzenia ARCHIWUM |

| -x, --extract | rozpakowanie plików z archiwum |

| -t, --list | wypisanie zawartości archiwum |

| -r, --append | dołączenie plików na końcu archiwum |

| -u, --update | dołączenie tylko plików nowszych niż kopie w archiwum |

Brak odpowiedzi na to pytanie.

Zaćma fotochemiczna jest wywoływana promieniowaniem

Brak odpowiedzi na to pytanie.

Podczas tworzenia tabeli w bazie danych klucz podstawowy określa się jako

Brak odpowiedzi na to pytanie.

Dokręcenie śrub mocujących z wartością momentu 6 Nm, zgodnie z instrukcją montażową, należy wykonać kluczem

Brak odpowiedzi na to pytanie.

Który system montażu urządzeń przedstawiono na rysunku?

Brak odpowiedzi na to pytanie.

Zapis w dokumentacji układu holterowskiego „metoda pomiaru – oscylometryczna” świadczy o możliwości monitorowania

Brak odpowiedzi na to pytanie.

Zapis w dokumentacji technicznej elektrokardiografu określający V1, V2, …V6 dotyczy odprowadzeń

Brak odpowiedzi na to pytanie.

Ile elektrod wykorzystuje się podczas wykonywania standardowego badania EKG przy pomocy 12 odprowadzeń?

Brak odpowiedzi na to pytanie.

Urządzenie, którego dotyczy fragment podanej specyfikacji, jest przystosowane do

| ■ Architektura sieci LAN: | Wireless IEEE 802.11ac, Wireless IEEE 802.11a, Wireless IEEE 802.11b, Wireless IEEE 802.11g, Wireless IEEE 802.11n |

| ■ Dodatkowe informacje: | PoE, RJ-45 Serial |

| ■ Typ urządzenia: | Bezprzewodowy kontroler |

| ■ Typ złącza anteny zewnętrznej: | 3x3 MIMO |

Brak odpowiedzi na to pytanie.

Największą zdolność pochłaniania promieniowania rentgenowskiego o energii 60–160 keV wykazuje tkanka

Brak odpowiedzi na to pytanie.

Do zaktualizowania rekordu tabeli należy zastosować polecenie

Brak odpowiedzi na to pytanie.

W programowaniu obiektowym zmienne widoczne w ramach klasy oraz poza nią nazywane są

Brak odpowiedzi na to pytanie.

Zestaw przedstawiony na rysunku przeznaczony jest do przeprowadzania testu aparatu

Brak odpowiedzi na to pytanie.

Do kruszenia kamieni w pęcherzu moczowym stosowane są fale

Brak odpowiedzi na to pytanie.

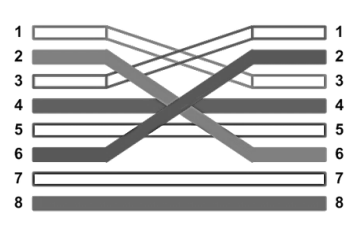

Kabel krosowany jest wykorzystany do połączenia

Brak odpowiedzi na to pytanie.

Pod wpływem bodźca świetlnego, dźwiękowego lub czuciowego mózg generuje elektryczne potencjały wywołane rejestrowane przez

Brak odpowiedzi na to pytanie.

Technologia dual channel dotyczy pracy dwóch takich samych

Brak odpowiedzi na to pytanie.

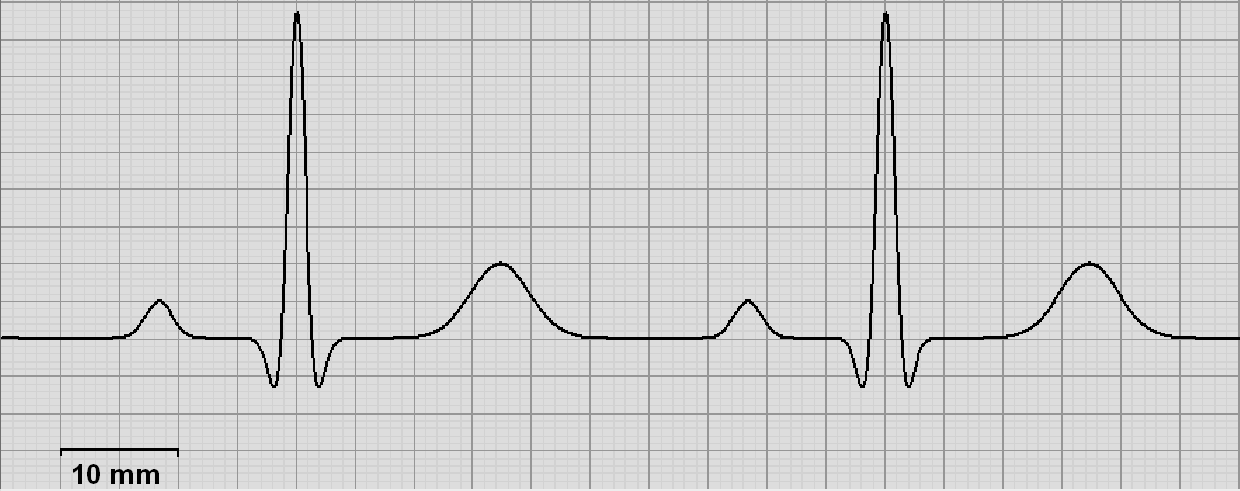

Jaka jest prędkość przesuwu prezentowanego elektrokardiogramu, jeżeli zmierzona częstotliwość rytmu serca wynosi 60 uderzeń na minutę?

Brak odpowiedzi na to pytanie.

Organizm człowieka ma zakłóconą zdolność do termoregulacji, gdy wartość temperatury wewnętrznej organizmu spada poniżej

Brak odpowiedzi na to pytanie.

Promieniowanie IR jest wykorzystywane w

Brak odpowiedzi na to pytanie.

Która magistrala służy do szeregowej transmisji danych?

Brak odpowiedzi na to pytanie.

W celu wyszukania błędów w programie wykorzystuje się

Brak odpowiedzi na to pytanie.

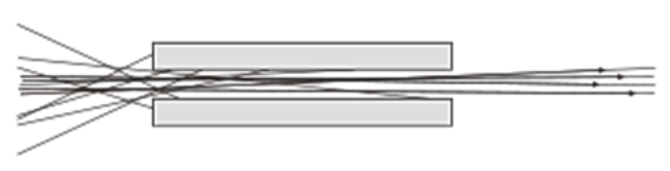

Przedstawiony na rysunku kolimator stanowi część

Brak odpowiedzi na to pytanie.

Do pomiaru częstotliwości rezonansowej generatora kwarcowego w kardiotokografii należy zastosować

Brak odpowiedzi na to pytanie.

Podczas wymiany podzespołów elektronicznych czułych na wyładowania elektrostatyczne należy zastosować

Brak odpowiedzi na to pytanie.

Zmienne definiowane w programie głównym na zewnątrz wszystkich funkcji i procedur lub innych bloków programu określamy jako zmienne

Brak odpowiedzi na to pytanie.

Który sterownik odpowiada za bezpośredni dostęp do pamięci?

Brak odpowiedzi na to pytanie.

W urządzeniu medycznym wyznaczono charakterystykę filtru jak na rysunku. Jest to filtr

Brak odpowiedzi na to pytanie.

Wynikiem działania funkcji F(n) będzie

funkcja F(n) jeżeli n>1 F(n)=3*F(n-1) w przeciwnym wypadku F(n)=3 |

Brak odpowiedzi na to pytanie.

Zasilacz, który podczas normalnej pracy zasila urządzenie, jednocześnie ładując akumulator, a podczas awarii zasilania sieciowego zasila urządzenie z akumulatora, oznaczany jest skrótem

Brak odpowiedzi na to pytanie.

Urządzenie przedstawione na rysunku jest przeznaczone do

Brak odpowiedzi na to pytanie.

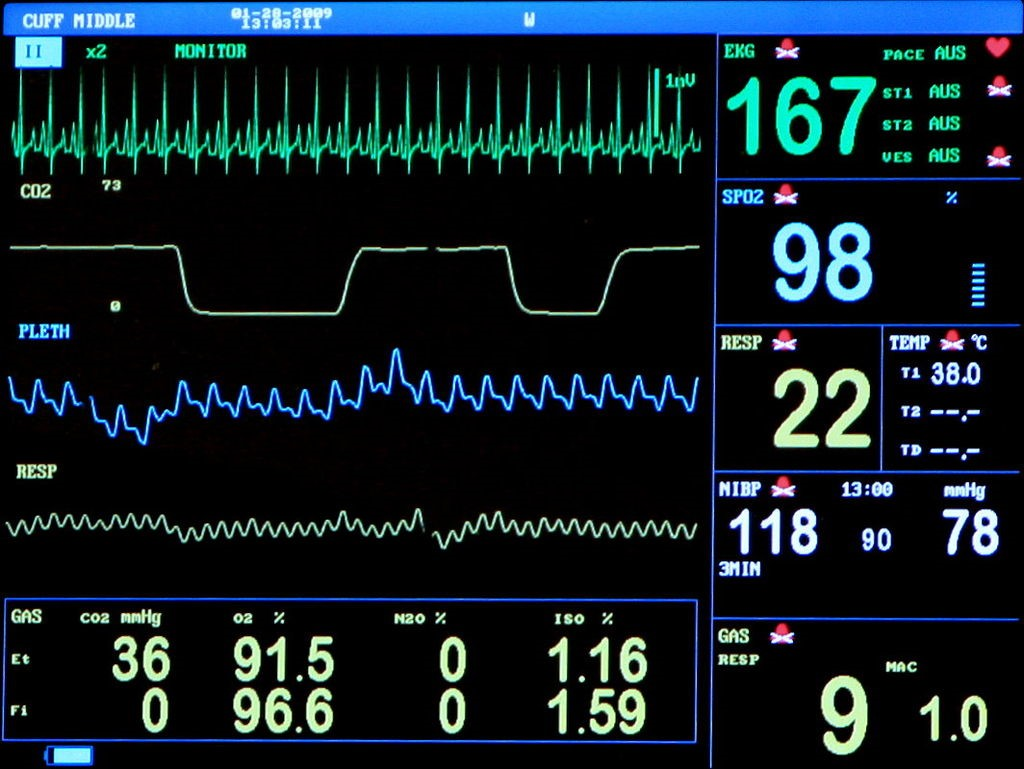

Z ekranu urządzenia wynika, że pełni ono między innymi funkcję

Brak odpowiedzi na to pytanie.

W celu zmiany hasła użytkownika w systemie Linux należy użyć polecenia

Brak odpowiedzi na to pytanie.

Który zasilacz pozwala na tymczasowe utrzymanie zasilania akumulatorowego w razie braku zasilania sieciowego?

Brak odpowiedzi na to pytanie.