Pytanie 1

W systemie SI jednostką do mierzenia napięcia jest

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

W systemie SI jednostką do mierzenia napięcia jest

Zewnętrzny dysk 3,5 cala o pojemności 5 TB, przeznaczony do archiwizacji lub tworzenia kopii zapasowych, dysponuje obudową z czterema różnymi interfejsami komunikacyjnymi. Który z tych interfejsów powinno się użyć do podłączenia do komputera, aby uzyskać najwyższą prędkość transferu?

Industry Standard Architecture to standard magistrali, który określa, że szerokość szyny danych wynosi:

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Do realizacji iloczynu logicznego z negacją należy użyć funktora

Karta sieciowa przedstawiona na ilustracji ma zdolność przesyłania danych z maksymalną prędkością

Klient dostarczył niesprawny sprzęt komputerowy do serwisu. Serwisant w trakcie procedury przyjęcia sprzętu, lecz przed przystąpieniem do jego naprawy, powinien

Czym jest układ RAMDAC?

Jaką najwyższą liczbę urządzeń można przypisać w sieci z adresacją IPv4 klasy C?

Aby umożliwić transfer danych między siecią w pracowni a siecią ogólnoszkolną o innej adresacji IP, należy zastosować

Jaka usługa musi być aktywna na serwerze, aby stacja robocza mogła automatycznie uzyskać adres IP?

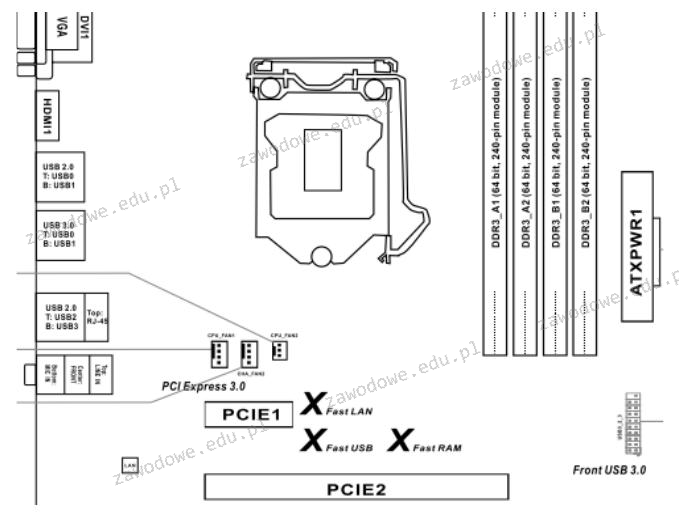

Na wskazanej płycie głównej możliwe jest zainstalowanie procesora w obudowie typu

Jaką inną formą można zapisać 2^32 bajtów?

Procesem nieodwracalnym, całkowicie uniemożliwiającym odzyskanie danych z dysku twardego, jest

Graficzny symbol ukazany na ilustracji oznacza

Transmisję danych bezprzewodowo realizuje interfejs

PCI\VEN_10EC&DEV_8168&SUBSYS_05FB1028&REV_12

Przedstawiony zapis jest

Narzędzie System Image Recovery dostępne w zaawansowanych opcjach uruchamiania systemu Windows 7 pozwala na

Minimalną wartość długości hasła użytkownika w systemie Windows można ustawić poprzez komendę

Tworzenie zaszyfrowanych połączeń pomiędzy hostami przez publiczną sieć Internet, wykorzystywane w rozwiązaniach VPN (Virtual Private Network), to

Głowica drukująca, składająca się z wielu dysz zintegrowanych z mechanizmem drukarki, wykorzystywana jest w drukarce

Aby na Pasku zadań pojawiły się ikony z załączonego obrazu, trzeba w systemie Windows ustawić

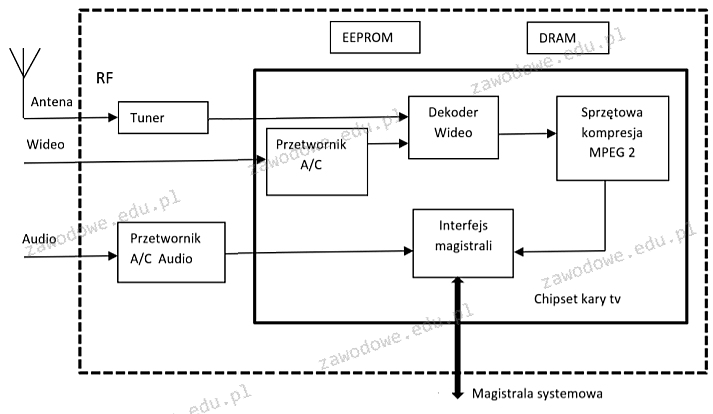

Ustawienia przedstawione na diagramie dotyczą

Aby serwer z systemem Linux mógł udostępniać pliki i drukarki komputerom klienckim z systemem Windows, należy zainstalować na nim

Jaki system plików powinien być wybrany przy instalacji systemu Linux?

Która z licencji ma charakter grupowy i pozwala instytucjom komercyjnym oraz organizacjom edukacyjnym, państwowym i charytatywnym na zakup większej ilości oprogramowania firmy Microsoft na korzystnych zasadach?

Na jakich nośnikach pamięci masowej jednym z najczęstszych powodów uszkodzeń jest zniszczenie powierzchni?

Jak nazywa się topologia fizyczna, w której wszystkie urządzenia końcowe są bezpośrednio połączone z jednym punktem centralnym, takim jak koncentrator lub przełącznik?

Partycja w systemie Linux, która tymczasowo przechowuje dane w przypadku niedoboru pamięci RAM, to

Który zakres adresów IPv4 jest poprawnie przypisany do danej klasy?

| Zakres adresów IPv4 | Klasa adresu IPv4 | |

|---|---|---|

| A. | 1.0.0.0 ÷ 127.255.255.255 | A |

| B. | 128.0.0.0 ÷ 191.255.255.255 | B |

| C. | 192.0.0.0 ÷ 232.255.255.255 | C |

| D. | 233.0.0.0 ÷ 239.255.255.255 | D |

Na ilustracji zaprezentowano schemat blokowy karty

Jakie urządzenie należy zastosować do pomiaru mocy zużywanej przez komputer?

Aby podczas prac montażowych zabezpieczyć szczególnie wrażliwe podzespoły elektroniczne komputera przed wyładowaniem elektrostatycznym, należy stosować

Transmisja danych typu półduplex to transmisja

Wykonanie polecenia attrib +h +s +r przykład.txt w terminalu systemu Windows spowoduje

Wskaź na błędny układ dysku z użyciem tablicy partycji MBR?

Shareware to typ licencji, która polega na

Najskuteczniejszym sposobem na wykonanie codziennego archiwizowania pojedynczego pliku o wielkości 4,8 GB, na jednym komputerze bez dostępu do Internetu jest

Oblicz koszt wykonania okablowania strukturalnego od 5 punktów abonenckich do panelu krosowego wraz z wykonaniem kabli połączeniowych dla stacji roboczych. W tym celu wykorzystano 50 m skrętki UTP. Punkt abonencki składa się z 2 gniazd typu RJ

| Materiał | Jednostka | Cena |

|---|---|---|

| Gniazdo podtynkowe 45x45, bez ramki, UTP 2xRJ45 kat.5e | szt. | 17 zł |

| UTP kabel kat.5e PVC 4PR 305m | karton | 305 zł |

| RJ wtyk UTP kat.5e beznarzędziowy | szt. | 6 zł |

Użytkownik dysponuje komputerem o podanej konfiguracji i systemie Windows 7 Professional 32bit. Która z opcji modernizacji komputera NIE przyczyni się do zwiększenia wydajności?

| Płyta główna | ASRock Z97 Anniversary Z97 DualDDR3-1600 SATA3 RAID HDMI ATX z czterema slotami DDR3 i obsługą RAID poziomu 0,1 |

| Procesor | i3 |

| Pamięć | 1 x 4 GB DDR3 |

| HDD | 2 x 1 TB |