Pytanie 1

Napięcie dostarczane do poszczególnych elementów komputera w zasilaczu komputerowym w standardzie ATX jest zmniejszane z wartości 230V między innymi do wartości

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Napięcie dostarczane do poszczególnych elementów komputera w zasilaczu komputerowym w standardzie ATX jest zmniejszane z wartości 230V między innymi do wartości

Jakie polecenie w systemach Windows/Linux jest zazwyczaj wykorzystywane do monitorowania trasy pakietów w sieciach IP?

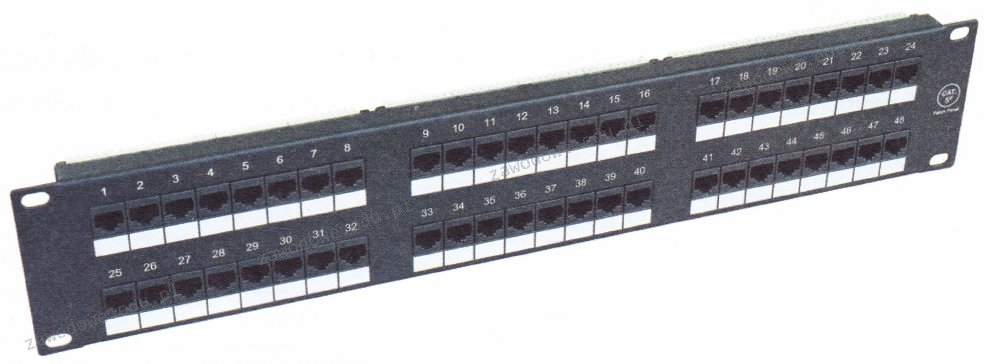

Na ilustracji widoczny jest

Na ilustracji zaprezentowane jest urządzenie, które to

Ustawienie rutingu statycznego na ruterze polega na

Który z adresów protokołu IP w wersji 4 jest poprawny pod względem struktury?

Gdy komputer się uruchamia, na ekranie wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

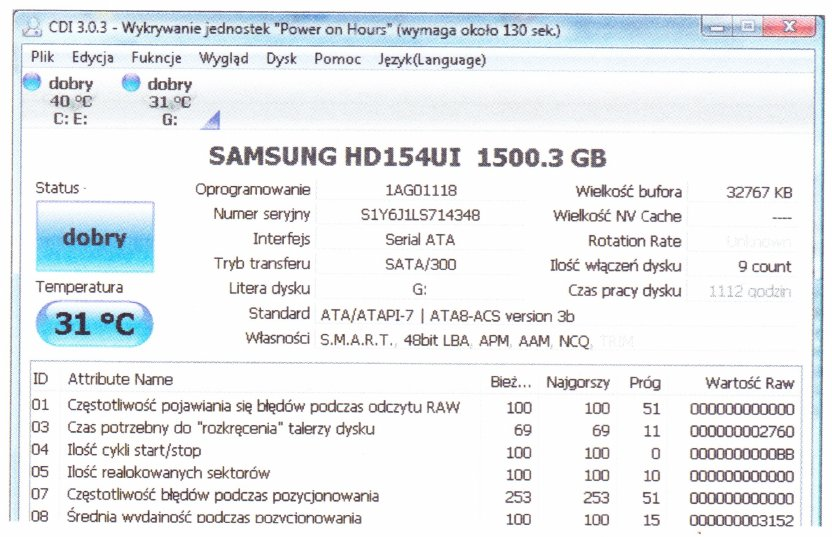

Na ilustracji zaprezentowano system monitorujący

Interfejs SATA 2 (3 Gb/s) gwarantuje prędkość transferu

W drukarce laserowej do utrwalenia wydruku na papierze stosuje się

Czym jest OTDR?

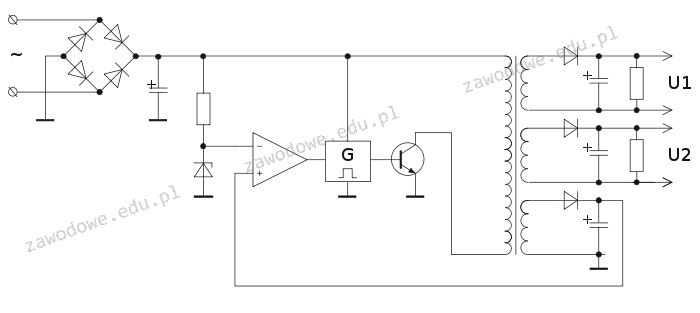

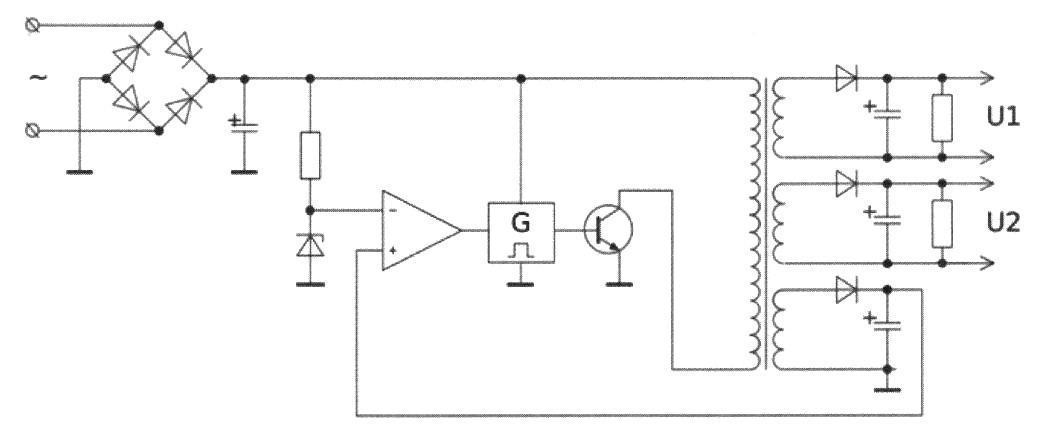

Na rysunku ukazano diagram

Na rysunku zobrazowano schemat

Jakie są nazwy licencji, które umożliwiają korzystanie z programu w pełnym zakresie, ale ograniczają liczbę uruchomień do określonej, niewielkiej ilości od momentu instalacji?

Który profil użytkownika ulega modyfikacji i jest zapisywany na serwerze dla klienta działającego w sieci Windows?

Jaką normę stosuje się w przypadku okablowania strukturalnego w sieciach komputerowych?

Urządzeniem wejściowym komputera, realizującym z najwyższą precyzją funkcje wskazujące w środowisku graficznym 3D, jest

W których nośnikach pamięci masowej jedną z najczęstszych przyczyn uszkodzeń jest uszkodzenie powierzchni?

W klasycznym adresowaniu, adres IP 74.100.7.8 przynależy do

Parametr pamięci RAM określany czasem jako opóźnienie definiuje się jako

Jakie będą całkowite koszty materiałów potrzebnych do stworzenia sieci lokalnej dla 6 komputerów, jeśli do budowy sieci wymagane jest 100 m kabla UTP kat. 5e oraz 20 m kanału instalacyjnego? Ceny komponentów sieci przedstawiono w tabeli.

| Elementy sieci | j.m. | cena brutto |

|---|---|---|

| Kabel UTP kat. 5e | m | 1,00 zł |

| Kanał instalacyjny | m | 8,00 zł |

| Gniazdo komputerowe | szt. | 5,00 zł |

Który z komponentów nie jest zgodny z płytą główną MSI A320M Pro-VD-S socket AM4, 1 x PCI-Ex16, 2 x PCI-Ex1, 4 x SATA III, 2 x DDR4- maks. 32 GB, 1 x D-SUB, 1x DVI-D, ATX?

W protokole IPv4 adres broadcastowy, zapisany w formacie binarnym, bez podziału na podsieci, w sekcji przeznaczonej dla hosta zawiera

Wskaż adresy podsieci, które powstaną po podziale sieci o adresie 172.16.0.0/22 na 4 równe podsieci.

W przypadku adresacji IPv6, zastosowanie podwójnego dwukropka służy do

Jak prezentuje się adres IP 192.168.1.12 w formacie binarnym?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Podczas pracy dysk twardy wydaje stukanie, a uruchamianie systemu oraz odczyt danych są znacznie spowolnione. W celu naprawienia tej awarii, po wykonaniu kopii zapasowej danych na zewnętrznym nośniku należy

Użytkownik drukarki samodzielnie i prawidłowo napełnił pojemnik z tonerem. Po jego zamontowaniu drukarka nie podejmuje próby drukowania. Przyczyną tej usterki może być

Dysk znajdujący się w komputerze ma zostać podzielony na partycje. Jaką maksymalną liczbę partycji rozszerzonych można utworzyć na jednym dysku?

Wyjście audio dla słuchawek lub głośników minijack na karcie dźwiękowej oznaczone jest jakim kolorem?

W skład sieci komputerowej wchodzi 3 komputery stacjonarne oraz drukarka sieciowa, które są połączone kablem UTP z routerem mającym porty 1 x WAN oraz 5 x LAN. Które urządzenie sieciowe pozwoli na dołączenie kablem UTP dwóch dodatkowych komputerów do tej sieci?

Która norma w Polsce definiuje zasady dotyczące okablowania strukturalnego?

Który zakres adresów pozwala na komunikację multicast w sieciach z użyciem adresacji IPv6?

Jaką rolę serwera trzeba zainstalować w systemach z linii Windows Server, aby mogła zostać utworzona nowa strona FTP?

Komunikat o błędzie KB/Interface, wyświetlany na monitorze komputera podczas BIOS POST firmy AMI, wskazuje na problem

Symbol umieszczony na urządzeniach, który stanowi certyfikat potwierdzający zgodność w zakresie emisji promieniowania, ergonomii, efektywności energetycznej i ekologicznych norm, został przedstawiony na ilustracji

Jakie jest maksymalne dozwolone promień gięcia przy układaniu kabla U/UTP kat.5E?

Jakie znaczenie ma parametr NVP (Nominal Velocity of Propagation) podczas pomiarów okablowania strukturalnego?

Atak DDoS (ang. Disributed Denial of Service) na serwer doprowadzi do