Pytanie 1

Osoba pragnąca wydrukować dokumenty w oryginale oraz w trzech egzemplarzach na papierze samokopiującym powinna zainwestować w drukarkę

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

Osoba pragnąca wydrukować dokumenty w oryginale oraz w trzech egzemplarzach na papierze samokopiującym powinna zainwestować w drukarkę

Aby uzyskać największą prędkość przepływu danych w przypadku, gdy domowy ruter pracuje w paśmie częstotliwości 5 GHz, do notebooka powinno się zamontować bezprzewodową kartę sieciową pracującą w standardzie

Do akumulatora w jednostce ALU wprowadzono liczbę dziesiętną 253. Jak wygląda jej reprezentacja binarna?

W standardzie Ethernet 100BaseTX konieczne jest użycie kabli skręconych

Na urządzeniu znajduje się symbol, który stanowi certyfikat potwierdzający zgodność sprzętu w zakresie emisji promieniowania, ergonomii, efektywności energetycznej oraz ekologii, co przedstawiono na rysunku

Do wymiany uszkodzonych kondensatorów w karcie graficznej potrzebne jest

Program WinRaR pokazał okno informacyjne przedstawione na ilustracji. Jakiego rodzaju licencję na oprogramowanie użytkownik stosował do tej pory?

Które systemy operacyjne są atakowane przez wirusa MS Blaster?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakiej klasy adresów IPv4 dotyczą adresy, które mają dwa najbardziej znaczące bity ustawione na 10?

Jaki adres IP w systemie dziesiętnym odpowiada adresowi IP 10101010.00001111.10100000.11111100 zapisanemu w systemie binarnym?

Podczas uruchamiania komputera wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue, press Del to setup) naciśnięcie klawisza Del skutkuje

Możliwość bezprzewodowego połączenia komputera z siecią Internet za pomocą tzw. hotspotu będzie dostępna po zainstalowaniu w nim karty sieciowej posiadającej

Tryb użytkownika w przełączniku CISCO (User EXEC Mode) umożliwia

Rysunek obrazuje zasadę działania drukarki

Przedstawiony symbol znajdujący się na obudowie komputera stacjonarnego oznacza ostrzeżenie przed

Administrator dostrzegł, że w sieci LAN występuje wiele kolizji. Jakie urządzenie powinien zainstalować, aby podzielić sieć lokalną na mniejsze domeny kolizji?

Jakim sposobem zapisuje się dane na nośnikach BD-R?

Topologia fizyczna, w której wszystkie urządzenia końcowe są bezpośrednio połączone z jednym punktem centralnym, takim jak koncentrator lub switch, to topologia

Aktualizacja systemów operacyjnych to proces, którego głównym zadaniem jest

Zabrudzony czytnik w napędzie optycznym powinno się czyścić

Fizyczna architektura sieci, inaczej określana jako topologia fizyczna sieci komputerowych, definiuje

Ile bitów trzeba wydzielić z części hosta, aby z sieci o adresie IPv4 170.16.0.0/16 utworzyć 24 podsieci?

Jaką normę odnosi się do okablowania strukturalnego?

W dokumentacji dotyczącej karty dźwiękowej można znaleźć informację: częstotliwość próbkowania 22 kHz oraz rozdzielczość próbkowania 16 bitów. Jaka będzie przybliżona objętość pliku audio z 10-sekundowym nagraniem mono (jednokanałowym)?

Urządzeniem w zestawie komputerowym, które obsługuje zarówno dane wejściowe, jak i wyjściowe, jest

Komputer A, który musi wysłać dane do komputera B znajdującego się w sieci z innym adresem IP, najpierw przekazuje pakiety do adresu IP

Program df działający w systemach z rodziny Linux pozwala na wyświetlenie

W nagłówku ramki standardu IEEE 802.3 w warstwie łącza danych znajduje się

GRUB, LILO, NTLDR to

Jaki akronim odnosi się do przepustowości sieci oraz usług, które mają między innymi na celu nadawanie priorytetów przesyłanym pakietom?

W drukarce laserowej do stabilizacji druku na papierze używane są

Jak przywrócić stan rejestru systemowego w edytorze Regedit, wykorzystując wcześniej utworzoną kopię zapasową?

Które urządzenie może zostać wykorzystane do rutowania ruchu sieciowego między sieciami VLAN?

Który protokół przesyła datagramy bez gwarancji ich dostarczenia?

Jakie miejsce nie powinno być wykorzystywane do przechowywania kopii zapasowych danych z dysku twardego komputera?

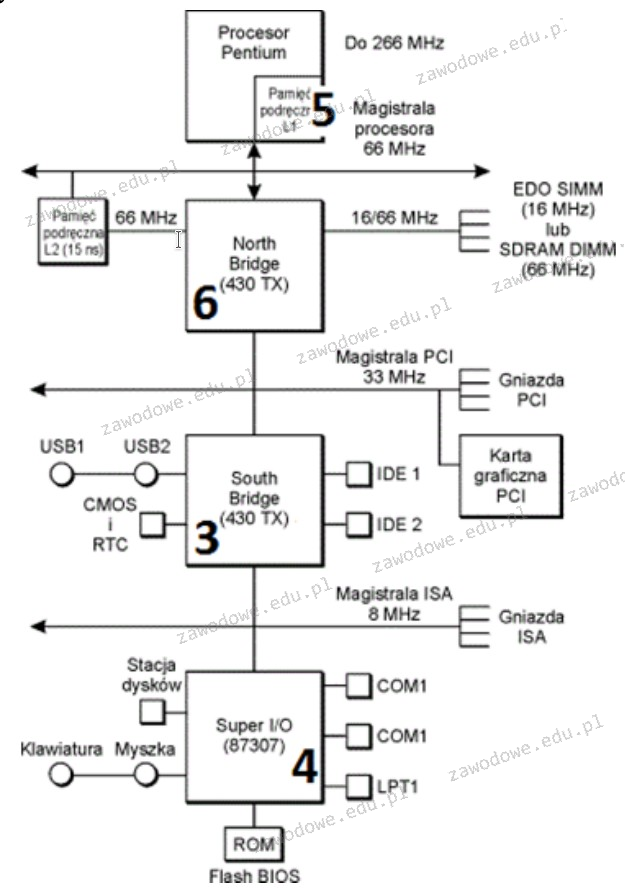

Część płyty głównej, która odpowiada za transmisję danych pomiędzy mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej, jest oznaczona na rysunku numerem

Medium transmisyjne oznaczone symbolem S/FTP to skrętka

W systemie Windows Server, możliwość udostępnienia folderu jako zasobu sieciowego, który jest widoczny na stacji roboczej jako dysk oznaczony literą, można uzyskać poprzez realizację czynności