Pytanie 1

Po dokonaniu eksportu klucza HKCU powstanie kopia rejestru zawierająca dane dotyczące ustawień

Wynik: 14/40 punktów (35,0%)

Wymagane minimum: 20 punktów (50%)

Po dokonaniu eksportu klucza HKCU powstanie kopia rejestru zawierająca dane dotyczące ustawień

Aby aktywować funkcję S.M.A.R.T. dysku twardego, która odpowiada za monitorowanie i wczesne ostrzeganie przed awariami, należy skorzystać z

Prawo osobiste twórcy do oprogramowania komputerowego

Aby procesor działał poprawnie, konieczne jest podłączenie złącza zasilania 4-stykowego lub 8-stykowego o napięciu

Usterka przedstawiona na ilustracji, widoczna na monitorze komputera, nie może być spowodowana przez

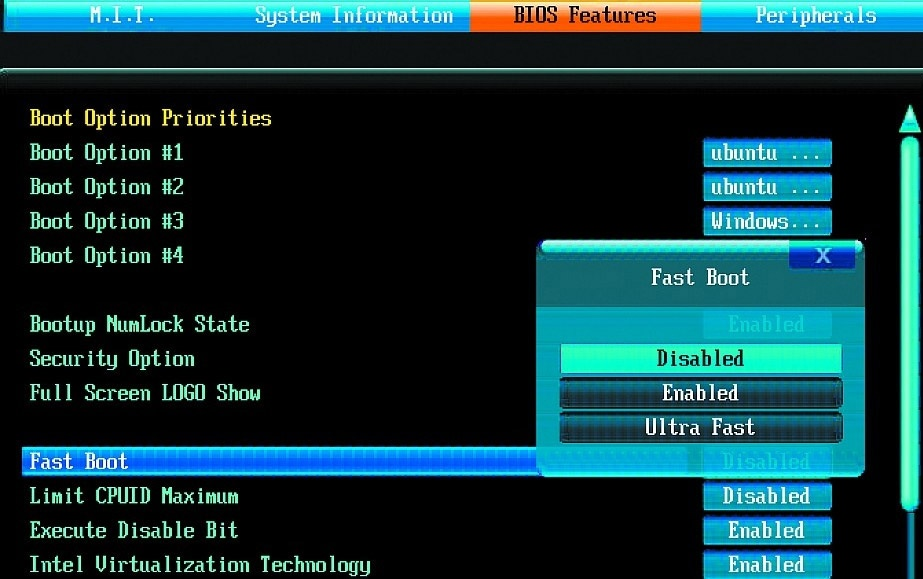

Co spowoduje zmiana opcji Fast Boot na wartość Enabledw konfiguracji BIOS przedstawionej na ilustracji?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Wyjście audio dla słuchawek lub głośników minijack na karcie dźwiękowej oznaczone jest jakim kolorem?

Który z protokołów będzie wykorzystany przez administratora do przesyłania plików na serwer?

Które narzędzie należy wykorzystać do uzyskania wyników testu POST dla modułów płyty głównej?

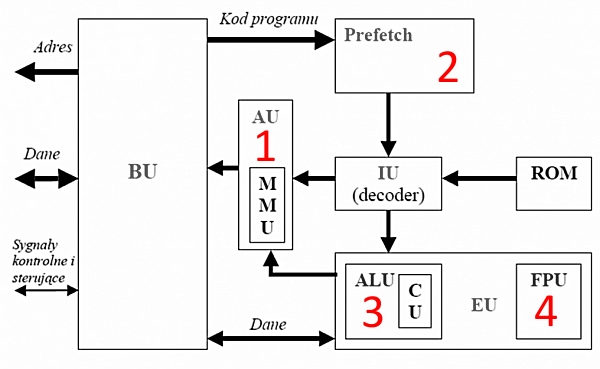

Koprocesor arytmetyczny, który pełni funkcję wykonywania obliczeń na liczbach zmiennoprzecinkowych w mikroprocesorze, został na schemacie oznaczony cyfrą

Aby zmienić istniejące konto użytkownika przy użyciu polecenia net user oraz wymusić reset hasła po kolejnej sesji logowania użytkownika, jaki parametr należy dodać do tego polecenia?

Który rodzaj kopii zapasowej należy wybrać, aby wykonać przyrostową kopię danych?

Interfejs SATA 2 (3 Gb/s) gwarantuje prędkość transferu

Co nie wpływa na utratę z pamięci masowej HDD?

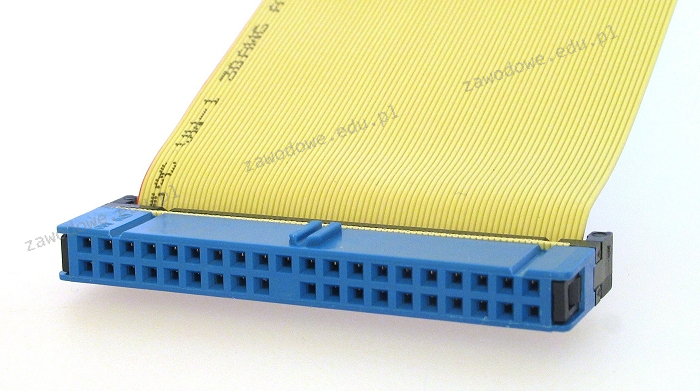

Jakiego rodzaju interfejsem jest UDMA?

Nieprawidłowa forma zapisu liczby 778 to

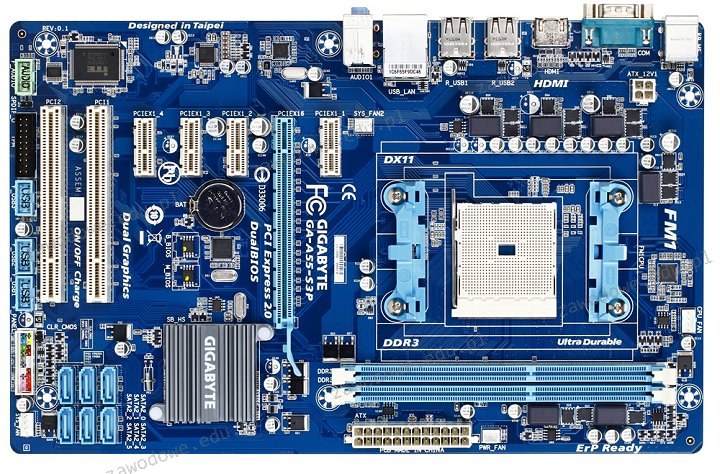

Wskaż komponent, który nie jest zgodny z płytą główną o parametrach przedstawionych w tabeli

| Podzespół | Parametry |

|---|---|

| Płyta główna GIGABYTE | 4x DDR4, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8 x USB 2.0, S-AM3+ |

Jakim interfejsem można przesyłać dane między płyta główną, przedstawioną na ilustracji, a urządzeniem zewnętrznym, nie zasilając jednocześnie tego urządzenia przez ten interfejs?

Na ilustracji przedstawiono taśmę (kabel) złącza

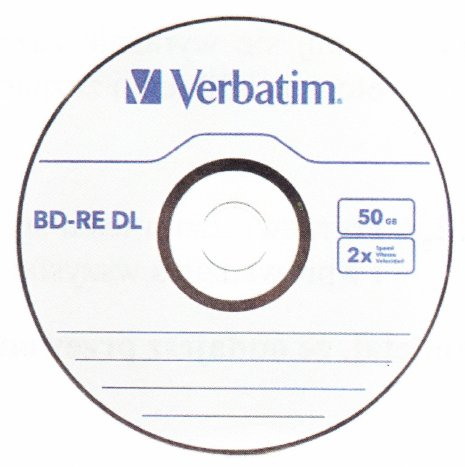

Aby nagrać dane na nośniku przedstawionym na ilustracji, konieczny jest odpowiedni napęd

Technologia procesorów serii Intel Core stosowana w modelach i5, i7 oraz i9, pozwalająca na zwiększenie taktowania w przypadku gdy komputer potrzebuje wyższej mocy obliczeniowej, to

Jaką topologię fizyczną sieci komputerowej przedstawia rysunek?

W jaki sposób powinno się wpisać w formułę arkusza kalkulacyjnego odwołanie do komórki B3, aby przy przenoszeniu tej formuły w inne miejsce arkusza odwołanie do komórki B3 pozostało stałe?

Thunderbolt jest typem interfejsu:

Jakie urządzenie jest kluczowe do połączenia pięciu komputerów w sieci o topologii gwiazdy?

Komputer jest podłączony do sieci Internet, a na jego pokładzie brak oprogramowania antywirusowego. Jak można sprawdzić, czy ten komputer jest zainfekowany wirusem, nie zmieniając ustawień systemowych?

Podczas zamykania systemu operacyjnego na ekranie pojawił się błąd, tak zwany bluescreen, 0x000000F3 Bug Check 0xF3 DISORDERLY_SHUTDOWN – niepowodzenie zamykania systemu, spowodowane brakiem pamięci. Błąd ten może wskazywać na

Które z poniższych wskazówek jest NIEWłaściwe w kontekście konserwacji skanera płaskiego?

Aktualizacja systemów operacyjnych to proces, którego głównym zadaniem jest

Który z poniższych systemów operacyjnych nie jest wspierany przez system plików ext4?

Dostosowywanie parametrów TCP/IP hosta w oparciu o adres MAC karty sieciowej to funkcjonalność jakiego protokołu?

Jakie z podanych urządzeń stanowi część jednostki centralnej?

Kluczowy sposób zabezpieczenia danych w sieci komputerowej przed nieautoryzowanym dostępem to

Jakie polecenie w systemie operacyjnym Linux służy do monitorowania komunikacji protokołów TCP/IP lub innych przesyłanych lub odbieranych w sieci komputerowej, do której jest podłączony komputer użytkownika?

Tworzenie zaszyfrowanych połączeń pomiędzy hostami przez publiczną sieć Internet, wykorzystywane w rozwiązaniach VPN (Virtual Private Network), to

Jaką konfigurację sieciową powinien mieć komputer, który jest częścią tej samej sieci LAN co komputer z adresem 10.8.1.10/24?

Jakie polecenie używa się do tworzenia kopii danych na pamięci USB w systemie Linux?

Jak nazywa się materiał używany w drukarkach 3D?

Aby umożliwić diagnozę systemu operacyjnego Windows oraz utworzyć plik zawierający listę wszystkich zaczytywanych sterowników, należy uruchomić system w trybie