Pytanie 1

Fragment konfiguracji pliku httpd.conf dla serwera Apache wygląda następująco Listen 8012 Server Name localhost:8012 Aby zweryfikować prawidłowe działanie witryny WWW na serwerze, należy wpisać w przeglądarkę

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Fragment konfiguracji pliku httpd.conf dla serwera Apache wygląda następująco Listen 8012 Server Name localhost:8012 Aby zweryfikować prawidłowe działanie witryny WWW na serwerze, należy wpisać w przeglądarkę

W jakiej logicznej topologii działa sieć Ethernet?

Organizacja zajmująca się międzynarodową normalizacją, która stworzyła 7-warstwowy Model Referencyjny Połączonych Systemów Otwartych, to

W systemie Windows powiązanie rozszerzeń plików z odpowiednimi programami realizuje się za pomocą polecenia

Jak nazywa się seria procesorów produkowanych przez firmę Intel, charakteryzująca się małymi wymiarami oraz niskim zużyciem energii, zaprojektowana z myślą o urządzeniach mobilnych?

Jakie znaczenie ma skrót MBR w kontekście technologii komputerowej?

Narzędzie systemu Windows wykorzystywane do interpretacji poleceń, stosujące logikę obiektową oraz cmdlety, to

Gdy komputer się uruchamia, na ekranie wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Jakie jest adres rozgłoszeniowy sieci, w której funkcjonuje host z adresem IP 195.120.252.32 oraz maską podsieci 255.255.255.192?

Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

Czym jest kopia różnicowa?

Możliwość odzyskania listy kontaktów z telefonu komórkowego działającego na systemie Android występuje, gdy użytkownik wcześniej przeprowadził synchronizację danych urządzenia z Google Drive przy użyciu

Po przeprowadzeniu diagnostyki komputerowej ustalono, że temperatura pracy karty graficznej z wyjściami HDMI oraz D-SUB, zainstalowanej w gnieździe PCI Express komputera stacjonarnego, wynosi 87°C. W związku z tym, serwisant powinien

Na podstawie przedstawionego w tabeli standardu opisu pamięci PC-100 wskaż pamięć, która charakteryzuje się maksymalnym czasem dostępu wynoszącym 6 nanosekund oraz minimalnym opóźnieniem między sygnałami CAS i RAS równym 2 cyklom zegara?

| Specyfikacja wzoru: PC 100-abc-def jednolitego sposobu oznaczania pamięci. | ||

| a | CL (ang. CAS Latency) | minimalna liczba cykli sygnału taktującego, liczona podczas operacji odczytu, od momentu uaktywnienia sygnału CAS, do momentu pojawienia się danych na wyjściu modułu DIMM (wartość CL wynosi zwykle 2 lub 3); |

| b | tRCD (ang. RAS to CAS Delay) | minimalne opóźnienie pomiędzy sygnałami RAS i CAS, wyrażone w cyklach zegara systemowego; |

| c | tRP (ang. RAS Precharge) | czas wyrażony w cyklach zegara taktującego, określający minimalną pauzę pomiędzy kolejnymi komendami, wykonywanymi przez pamięć; |

| d | tAC | Maksymalny czas dostępu (wyrażony w nanosekundach); |

| e | SPD Rev | specyfikacja komend SPD (parametr może nie występować w oznaczeniach); |

| f | Parametr zapasowy | ma wartość 0; |

Topologia fizyczna, w której każdy węzeł łączy się z wszystkimi innymi węzłami, to topologia

Jaką funkcję pełni serwer ISA w systemie Windows?

Aby zredukować kluczowe zagrożenia związane z bezpieczeństwem podczas pracy na komputerze podłączonym do sieci Internet, należy przede wszystkim

Wtyczka zaprezentowana na fotografii stanowi element obwodu elektrycznego zasilającego

Najwyższą prędkość transmisji danych w sieciach bezprzewodowych zapewnia standard

Który standard implementacji sieci Ethernet określa sieć wykorzystującą kabel koncentryczny, z maksymalną długością segmentu wynoszącą 185 m?

Aby utworzyć programową macierz RAID-1, potrzebne jest minimum

Jaką maksymalną liczbę hostów można przypisać w sieci o adresie IP klasy B?

Systemy operacyjne należące do rodziny Linux są dystrybuowane na mocy licencji

Jak najlepiej chronić zgromadzone dane przed ich odczytem w przypadku kradzieży komputera?

Na przedstawionym rysunku widoczna jest karta rozszerzeń z systemem chłodzenia

Do konserwacji elementów łożyskowanych oraz ślizgowych w urządzeniach peryferyjnych stosuje się

Aby podłączyć drukarkę igłową o wskazanych parametrach do komputera, należy umieścić kabel dołączony do drukarki w porcie

Aby połączyć projektor multimedialny z komputerem, złącze, którego NIEDOZWOLONO użyć to

Protokół transportowy bezpołączeniowy to

Administrator sieci lokalnej zauważył, że urządzenie typu UPS przełączyło się w tryb awaryjny. Oznacza to awarię systemu

Główny księgowy powinien mieć możliwość przywracania zawartości folderów z kopii zapasowej plików. Do jakiej grupy użytkowników w systemie MS Windows XP powinien zostać przypisany?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Który standard IEEE 802.3 powinien być użyty w sytuacji z zakłóceniami elektromagnetycznymi, jeżeli odległość między punktem dystrybucyjnym a punktem abonenckim wynosi 200 m?

Udostępnienie drukarki sieciowej codziennie o tej samej porze należy ustawić we właściwościach drukarki, w zakładce

Urządzenie sieciowe działające w trzeciej warstwie modelu ISO/OSI, obsługujące adresy IP, to

Na podstawie oznaczenia pamięci DDR3 PC3-16000 można określić, że ta pamięć

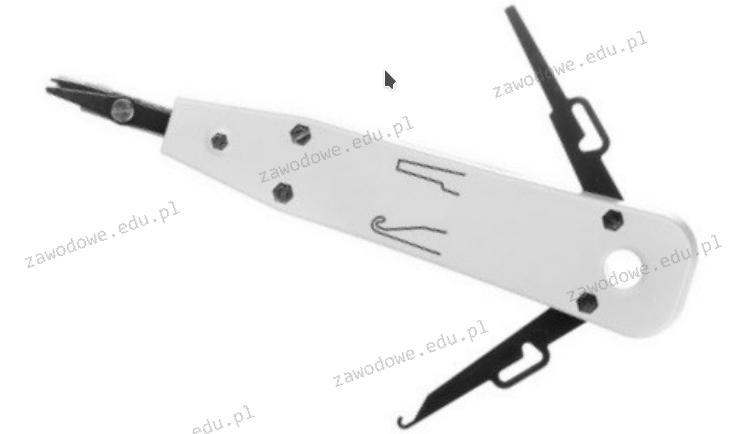

Urządzenie pokazane na ilustracji służy do

Jakie polecenie w systemie operacyjnym Linux służy do monitorowania komunikacji protokołów TCP/IP lub innych przesyłanych lub odbieranych w sieci komputerowej, do której jest podłączony komputer użytkownika?

Aby uzyskać uprawnienia administratora w systemie Linux, należy w terminalu wpisać polecenie

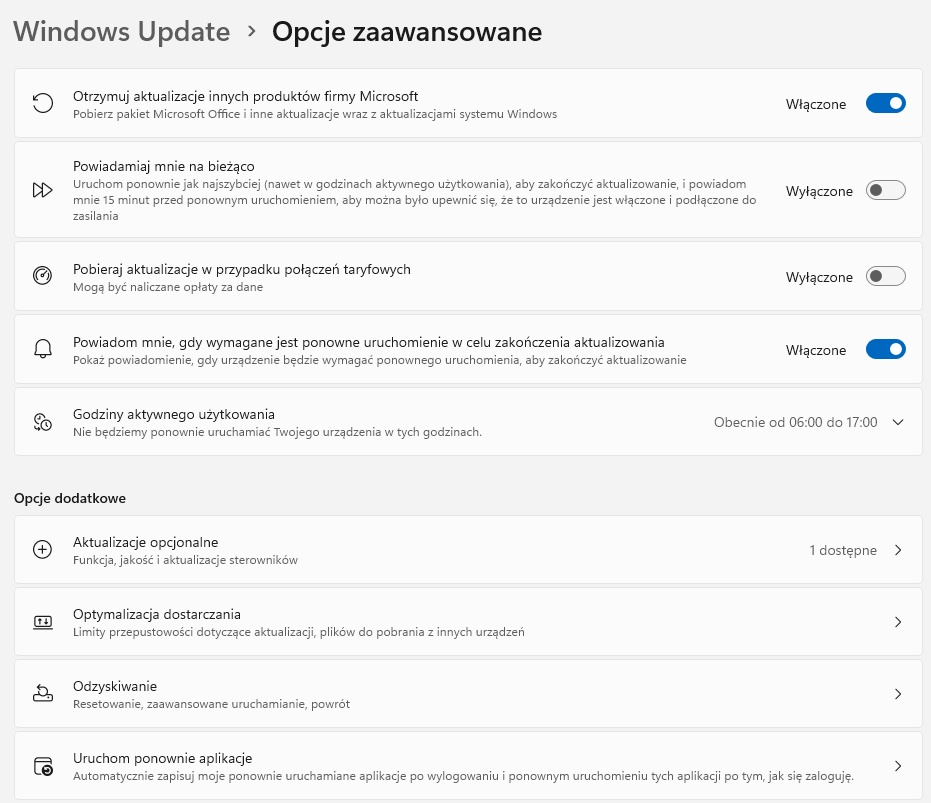

Biorąc pod uwagę konfigurację wykonywaną na ilustracji, administrator po zainstalowaniu systemu operacyjnego uznał za istotne, aby