Pytanie 1

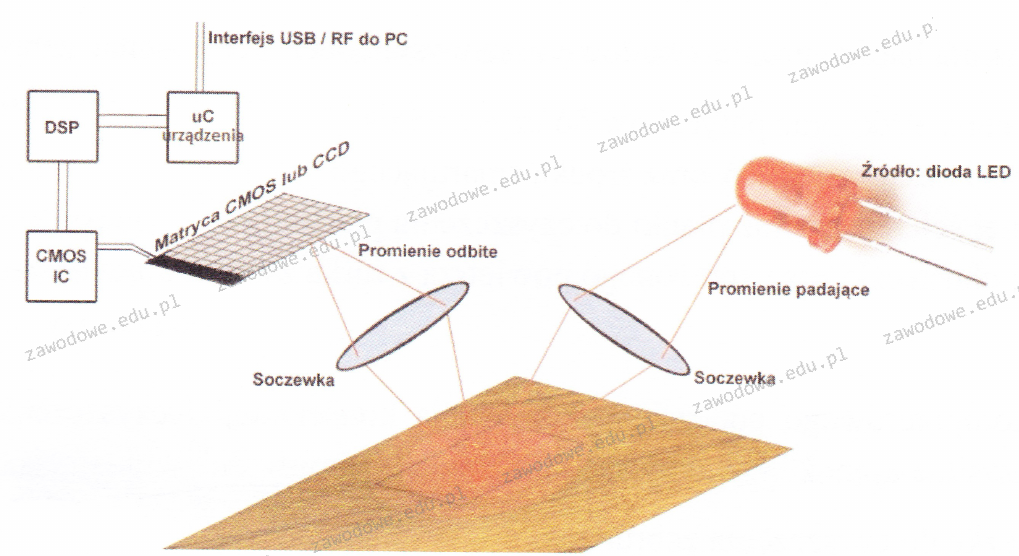

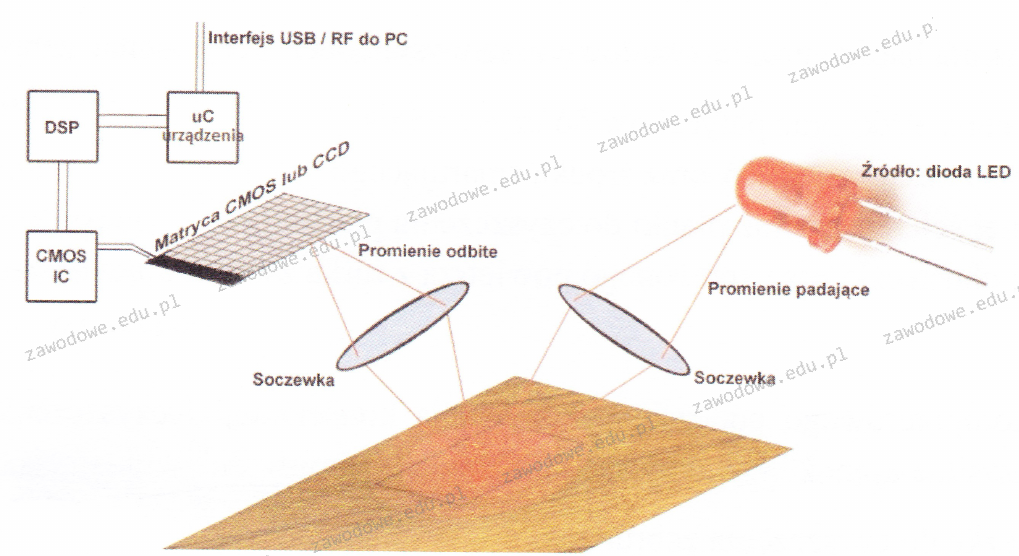

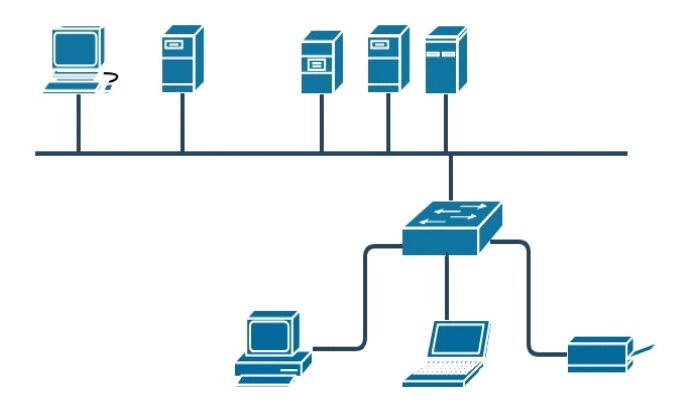

Zilustrowany schemat przedstawia zasadę funkcjonowania

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Zilustrowany schemat przedstawia zasadę funkcjonowania

Gdy komputer się uruchamia, na ekranie wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Która z wymienionych czynności nie jest związana z personalizacją systemu operacyjnego Windows?

Zasilacz UPS o mocy rzeczywistej 480 W nie jest przeznaczony do podłączenia

Narzędziem służącym do tworzenia logicznych podziałów na dysku twardym w systemie GNU/Linux jest

Program CHKDSK jest wykorzystywany do

Jakim systemem operacyjnym jest system czasu rzeczywistego?

W klasycznym adresowaniu, adres IP 74.100.7.8 przynależy do

Dokument służący do zaprezentowania oferty cenowej dla inwestora dotyczącej wykonania robót instalacyjnych sieci komputerowej, to

Atak typu hijacking na serwer internetowy charakteryzuje się

Administrator dostrzegł, że w sieci LAN występuje znaczna ilość kolizji. Jakie urządzenie powinien zainstalować, aby podzielić sieć lokalną na mniejsze domeny kolizji?

W sieci o adresie 192.168.20.0 użyto maski podsieci 255.255.255.248. Jak wiele adresów IP będzie dostępnych dla urządzeń?

Jaką klasę reprezentuje adres IPv4 w postaci binarnej 00101000 11000000 00000000 00000001?

Domyślnie dostęp anonimowy do zasobów serwera FTP umożliwia

Jakie zdanie charakteryzuje SSH Secure Shell?

Jakim poleceniem w systemie Linux można utworzyć nowych użytkowników?

Ile bitów trzeba wydzielić z części hosta, aby z sieci o adresie IPv4 170.16.0.0/16 utworzyć 24 podsieci?

Do serwisu komputerowego przyniesiono laptop z matrycą, która bardzo słabo wyświetla obraz. Dodatkowo obraz jest niezwykle ciemny i widoczny jedynie z bliska. Co może być przyczyną tej usterki?

Protokół, który umożliwia po połączeniu z serwerem pocztowym przesyłanie na komputer tylko nagłówków wiadomości, a wysyłanie treści oraz załączników następuje dopiero po otwarciu konkretnego e-maila, to

Który typ drukarki stosuje metodę przenoszenia stałego pigmentu z taśmy na papier odporny na wysoką temperaturę?

W schemacie logicznym okablowania strukturalnego, zgodnie z terminologią polską zawartą w normie PN-EN 50174, cechą kondygnacyjnego punktu dystrybucyjnego jest to, że

Schemat blokowy ilustruje

Wprowadzając w wierszu poleceń systemu Windows Server komendę convert, można wykonać

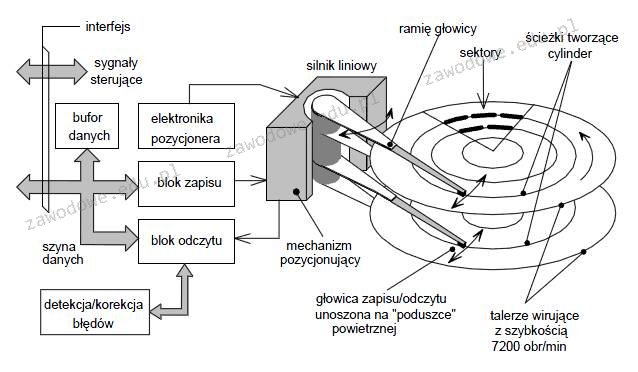

Komputery K1 i K2 nie są w stanie nawiązać komunikacji. Adresy urządzeń zostały przedstawione w tabeli. Co należy zmienić, aby przywrócić połączenie w sieci?

Jeżeli rozmiar jednostki alokacji wynosi 1024 bajty, to ile klastrów zajmą pliki umieszczone w tabeli na dysku?

| Nazwa | Wielkość |

|---|---|

| Ala.exe | 50 B |

| Dom.bat | 1024 B |

| Wirus.exe | 2 kB |

| Domes.exr | 350 B |

W systemie Windows informacje o aktualnym użytkowniku komputera są przechowywane w gałęzi rejestru o skróconej nazwie:

Termin określający wyrównanie tekstu do prawego i lewego marginesu to

Jakie właściwości charakteryzują pojedyncze konto użytkownika w systemie Windows Serwer?

Ilustracja pokazuje schemat fizycznej topologii będącej kombinacją topologii

Który protokół jest wykorzystywany do konwersji między adresami IP publicznymi a prywatnymi?

Aby wymusić na użytkownikach lokalnych systemów z rodziny Windows Server regularną zmianę haseł oraz stosowanie haseł o odpowiedniej długości, które spełniają kryteria złożoności, należy ustawić

Aby odzyskać dane ze sformatowanego dysku twardego, należy wykorzystać program

Spuchnięte kondensatory elektrolityczne w sekcji zasilania monitora LCD mogą spowodować uszkodzenie

Płyta główna wyposażona w gniazdo G2 będzie współpracowała z procesorem

Aby przetestować w systemie Windows poprawność działania nowo zainstalowanej drukarki, należy

Po wykonaniu eksportu klucza HKCU zostanie zapisana kopia rejestru zawierająca informacje, dotyczące konfiguracji

Zgodnie ze specyfikacją JEDEC typowe napięcie zasilania modułów niskonapięciowych pamięci RAM DDR3L wynosi

Podczas normalnego działania systemu operacyjnego w laptopie pojawił się komunikat o konieczności formatowania wewnętrznego dysku twardego. Wskazuje on na

Funkcja failover usługi DHCP umożliwia

Wskaż usługę, którą należy skonfigurować na serwerze aby blokować ruch sieciowy?